Owl-Bench

收藏github2023-09-01 更新2025-02-08 收录

下载链接:

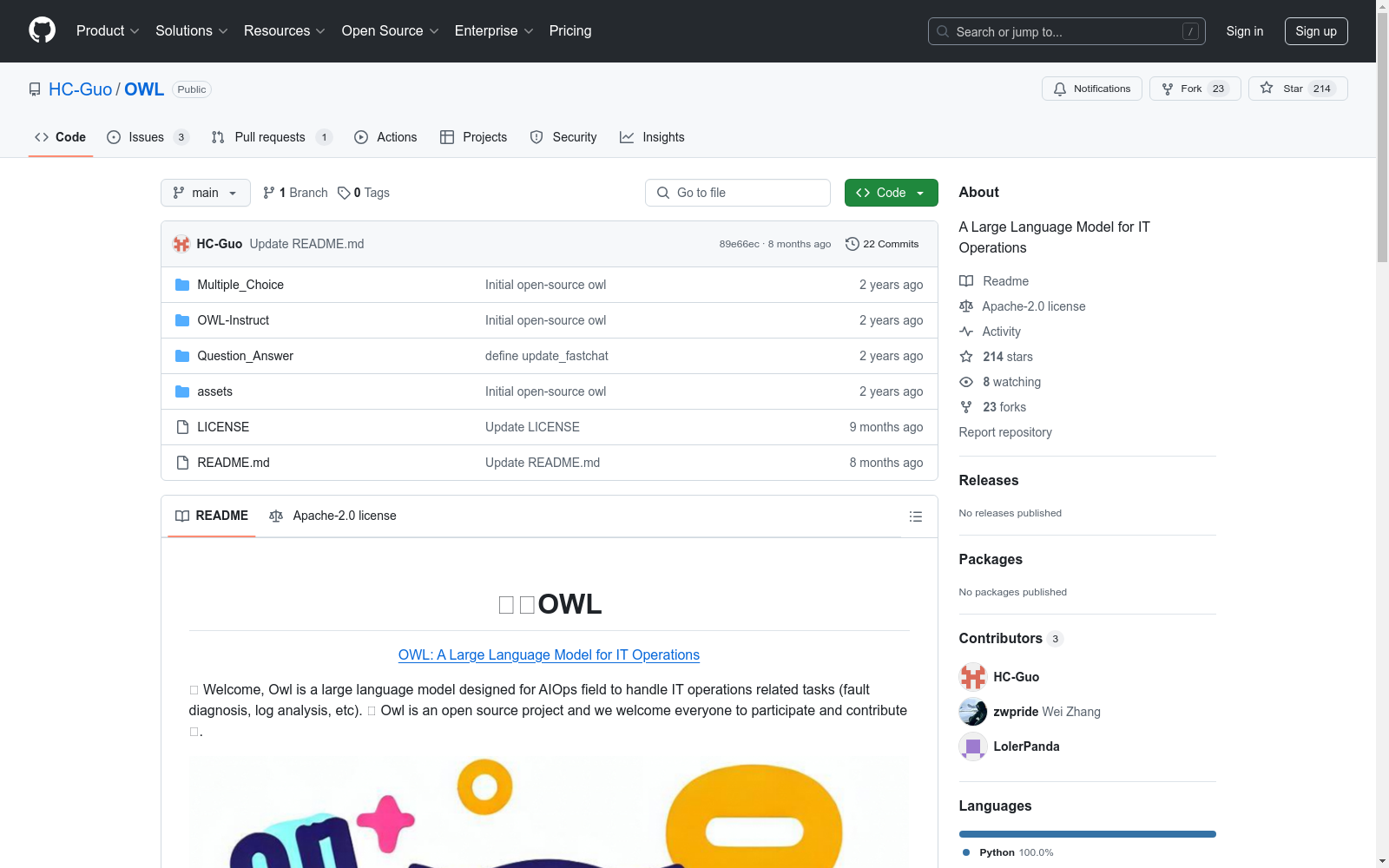

https://github.com/HC-Guo/Owl

下载链接

链接失效反馈资源简介:

Owl-Bench数据集是一个为信息技术运维场景量身定制的双语评估基准。它包含了317个问答对,以及1000道多项选择题。这些任务涵盖了众多真实世界工业场景,涉及九个不同的子领域:信息安全、应用、系统架构、软件架构、中间件、网络、操作系统、基础设施和数据库。

The Owl-Bench dataset is a bilingual evaluation benchmark meticulously tailored for information technology operations and maintenance scenarios. It encompasses 317 question-answer pairs and 1000 multiple-choice questions. These tasks span a multitude of real-world industrial scenarios, covering nine distinct subfields: information security, applications, system architecture, software architecture, middleware, networking, operating systems, infrastructure, and databases.

提供机构:

北京航空航天大学

创建时间:

2023-09-01

原始信息汇总

OWL数据集概述

数据集简介

- 名称:OWL (A Large Language Model for IT Operations)

- 领域:IT运维领域(AIOps)

- 主要功能:处理IT运维相关任务(故障诊断、日志分析等)

- 项目性质:开源项目

核心内容

-

模型特点

- 基于构建的OWL-Instruct数据集训练

- 提出HMCE方法(Homogeneous Markov Context Extension)解决输入长度限制问题

- 采用混合适配器策略(mixture-of-adapter)提高跨域/跨任务的参数效率调优

-

评估基准

- OWL-Bench(包含两部分):

- 开放IT相关基准测试

-

性能表现

- 在IT任务上表现优于现有模型

- 论文已被ICLR 2024接收

数据构建流程

- OWL-Instruct构建四阶段:

- 数据生成

- GPT4筛选

- 人工验证

- 监督微调

- 提供数据:

- 双语指令数据(ops001)

使用指南

引用信息

bibtex @inproceedings{ guo2024owl, title={{OWL}: A Large Language Model for {IT} Operations}, author={Hongcheng Guo and Jian Yang and Jiaheng Liu and Liqun Yang and Linzheng Chai and Jiaqi Bai and Junran Peng and Xiaorong Hu and Chao Chen and Dongfeng Zhang and xu Shi and Tieqiao Zheng and liangfan zheng and Bo Zhang and Ke Xu and Zhoujun Li}, booktitle={The Twelfth International Conference on Learning Representations}, year={2024}, url={https://openreview.net/forum?id=SZOQ9RKYJu} }

联系方式

- 邮箱:hongchengguo@buaa.edu.cn

搜集汇总

数据集介绍

构建方式

Owl-Bench数据集的构建过程体现了高度的系统性和严谨性。该数据集通过四个主要阶段完成构建:数据生成、GPT4筛选、人工验证以及监督微调。在数据生成阶段,团队收集了大量与IT运维相关的信息,确保数据的广泛性和代表性。随后,利用GPT4进行初步筛选,剔除不符合标准的数据。人工验证阶段进一步确保了数据的准确性和可靠性,最后通过监督微调优化模型性能。这一系列步骤确保了数据集的高质量和实用性。

特点

Owl-Bench数据集具有显著的特点,主要体现在其专注于IT运维领域的任务,如故障诊断和日志分析等。数据集分为两个主要部分:多项选择题和问答题,涵盖了广泛的IT运维场景。此外,数据集采用了双语指令数据,增强了其国际适用性。通过Homogeneous Markov Context Extension (HMCE)方法,数据集在处理长文本输入时表现出色,确保了模型在不同任务中的高效性和准确性。

使用方法

使用Owl-Bench数据集的方法相对直观且灵活。对于多项选择题部分,用户可以参考MC_readme文件中的详细说明进行操作。对于问答题部分,QA_readme文件提供了具体的指导。数据集提供了示例验证数据,方便用户快速上手并进行模型测试。用户可以根据实际需求选择不同的测试类型,灵活应用于各种IT运维任务中。通过这种方式,Owl-Bench不仅为研究人员提供了丰富的实验数据,也为实际应用中的模型优化和性能评估提供了有力支持。

背景与挑战

背景概述

随着信息技术的迅猛发展,IT运维领域面临着日益增长的数据处理与分析需求。传统的自然语言处理技术虽然在多个任务中展现了卓越的能力,但在专门针对IT运维的大规模语言模型(LLMs)开发方面仍存在显著空白。为此,研究团队于2024年推出了OWL,这是一个专为AIOps(人工智能运维)设计的大规模语言模型,旨在处理故障诊断、日志分析等IT运维相关任务。OWL模型基于OWL-Instruct数据集进行训练,该数据集包含了广泛的IT相关信息,并通过创新的同质马尔可夫上下文扩展方法(HMCE)解决了输入长度限制的问题。OWL的推出不仅填补了该领域的技术空白,也为IT运维技术的革新提供了新的视角。

当前挑战

OWL-Bench数据集的构建与应用面临多重挑战。首先,IT运维领域的数据具有高度的专业性和复杂性,如何有效地收集、整理和标注这些数据是一个巨大的挑战。其次,由于IT运维任务的多样性和动态性,模型需要具备跨领域和跨任务的适应能力,这对模型的参数效率调优提出了更高要求。此外,OWL-Bench的评估框架需要涵盖多种任务类型,如多项选择题和问答题,这对数据集的多样性和全面性提出了挑战。最后,如何在实际应用中验证和优化模型的性能,确保其在真实场景中的有效性和可靠性,也是该数据集面临的重要挑战。

常用场景

经典使用场景

Owl-Bench数据集在AIOps领域中被广泛应用于故障诊断和日志分析等任务。通过提供多选和问答两种形式的测试数据,研究人员能够评估和优化大型语言模型在IT操作中的表现。该数据集的设计使得模型能够在复杂的IT环境中进行高效的数据处理和分析,从而提升自动化运维的准确性和效率。

解决学术问题

Owl-Bench数据集解决了IT操作领域中缺乏专门针对大型语言模型评估的基准问题。通过提供丰富的IT相关任务数据,该数据集帮助研究人员验证模型在故障诊断、日志分析等任务中的性能,填补了现有模型在特定领域应用的空白。其引入的Homogeneous Markov Context Extension方法(HMCE)和混合适配器策略进一步提升了模型在不同任务中的参数效率调优能力。

衍生相关工作

Owl-Bench数据集的发布推动了AIOps领域的多项研究进展。基于该数据集,研究人员开发了多种改进的故障诊断和日志分析模型,进一步提升了IT操作的自动化水平。此外,该数据集还激发了更多关于大型语言模型在特定领域应用的探索,例如在网络安全和云计算中的应用,为相关领域的研究提供了新的思路和工具。

以上内容由遇见数据集搜集并总结生成