COYO-700M

收藏github2022-11-30 更新2024-05-31 收录

下载链接:

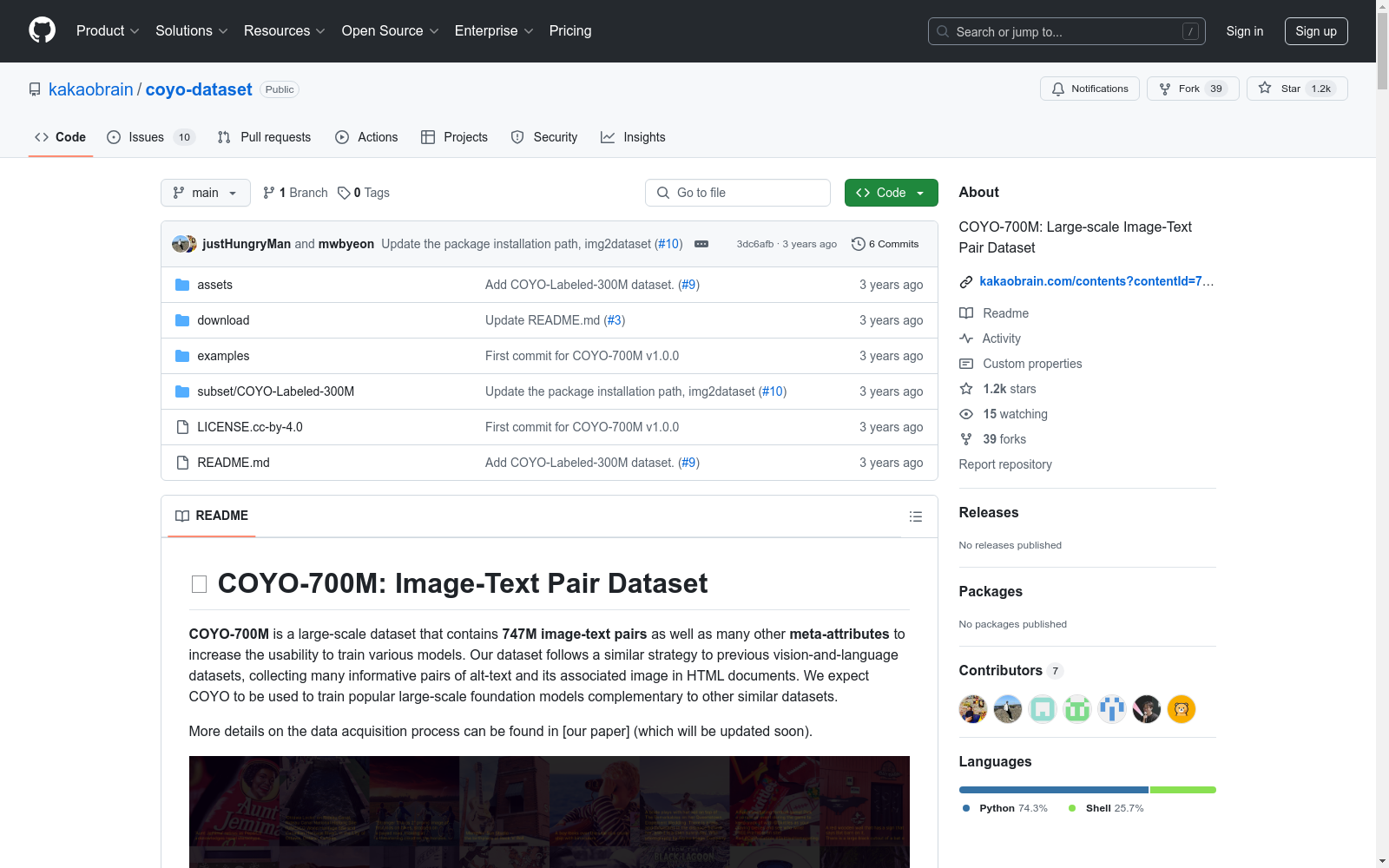

https://github.com/kakaobrain/coyo-dataset

下载链接

链接失效反馈资源简介:

COYO-700M是一个大规模数据集,包含747M图像-文本对以及其他多种元属性,用于训练各种模型。该数据集通过收集HTML文档中的替代文本及其关联图像来构建,旨在用于训练大型基础模型,与其他类似数据集互补。

COYO-700M is a large-scale dataset comprising 747 million image-text pairs along with various other metadata attributes, designed for training a wide range of models. This dataset was constructed by gathering alternative texts from HTML documents and their associated images, aiming to train large foundational models and complement other similar datasets.

创建时间:

2022-08-31

原始信息汇总

数据集概述

数据集名称

COYO-700M

数据集内容

- 747M 图像-文本对,包含多种元属性以增强模型的训练效果。

- 数据收集自HTML文档中的alt-text和相关图像。

数据收集过程

- 从2020年10月至2021年8月,从CommonCrawl收集约100亿对alt-text和图像源。

- 通过图像和文本级过滤过程,以最小成本消除不具信息性的对。

数据过滤

图像级

- 包括所有Pillow库可解码的图像格式(JPEG, WEBP, PNG, BMP等)。

- 移除小于5KB的图像。

- 移除宽高比大于3.0的图像。

- 移除最小边长小于200的图像。

- 移除OpenNSFW2或GantMan/NSFW评分高于0.5的图像。

- 基于pHash值移除重复图像。

文本级

- 仅收集英语文本。

- 处理文本格式,移除长度小于5的文本。

- 移除不包含名词形式的文本。

- 移除单词数少于3或多于256的文本。

- 移除出现超过10次的文本。

- 移除包含NSFW词汇的文本。

图像-文本级

- 基于(image_phash, text)移除重复样本。

数据集预览

数据集包含图像URL、文本、图像尺寸、图像pHash值等详细信息,以及文本长度、单词数、Bert和GPT模型下的token数等元属性。

数据集统计

- 746,972,269 图像-文本对。

- 656,114,783 唯一URL。

- 579,679,137 唯一图像pHash。

- 566,253,888 唯一文本。

元属性

- id: 唯一64位整数ID。

- url: 图像URL。

- text: alt文本。

- width, height: 图像尺寸。

- image_phash: 图像的感知哈希值。

- text_length, word_count: 文本长度和单词数。

- num_tokens_bert, num_tokens_gpt: 使用Bert和GPT模型的token数。

- num_faces: 图像中检测到的人脸数。

- clip_similarity_vitb32, clip_similarity_vitl14: 使用OpenAI CLIP模型的图像和文本相似度。

- nsfw_score_opennsfw2, nsfw_score_gantman: 图像的NSFW评分。

- watermark_score: 图像的加水印概率。

AI搜集汇总

数据集介绍

构建方式

COYO-700M数据集的构建过程基于大规模网络爬取与精细过滤策略。研究者从CommonCrawl中提取了约100亿对HTML文档中的图像与替代文本(alt-text)对,时间跨度为2020年10月至2021年8月。通过图像与文本层面的多重过滤机制,剔除了低质量、重复或不适宜的内容。图像过滤包括格式、尺寸、长宽比及NSFW评分等标准,而文本过滤则聚焦于语言、长度、重复性及内容适宜性。最终,数据集保留了747M对高质量的图像-文本对,确保了数据的多样性与实用性。

使用方法

COYO-700M数据集适用于训练与评估多模态模型,特别是视觉-语言联合学习任务。用户可通过加载数据集中的图像-文本对,结合附带的元属性信息,进行模型预训练、微调或生成任务。数据集的丰富元属性(如CLIP嵌入相似度、NSFW评分等)可用于优化模型性能或进行特定任务的分析。此外,数据集的分割与子集(如COYO-Labeled-300M)为特定研究需求提供了灵活性。使用时可结合常见深度学习框架(如PyTorch、TensorFlow)及多模态模型库(如Hugging Face Transformers)进行高效开发。

背景与挑战

背景概述

COYO-700M数据集是一个大规模图像-文本对数据集,包含747M对图像-文本数据及其丰富的元属性,旨在提升模型训练的可用性。该数据集由研究人员在2020年10月至2021年8月期间从CommonCrawl中收集HTML文档中的图像和替代文本对,并通过多层次的过滤机制筛选出高质量的数据。COYO-700M的发布为视觉-语言模型的研究提供了重要的数据支持,特别是在大规模基础模型的训练中,能够与其他类似数据集形成互补。该数据集的构建策略借鉴了先前视觉-语言数据集的经验,进一步推动了多模态学习领域的发展。

当前挑战

COYO-700M数据集在构建过程中面临多重挑战。首先,数据收集阶段需要从海量的HTML文档中提取图像和文本对,并确保数据的多样性和代表性。其次,数据过滤过程复杂,涉及图像和文本的多层次筛选,包括图像格式、尺寸、重复性以及文本的语言、长度和内容质量等。此外,如何有效去除不适宜内容(如NSFW图像和文本)也是一个重要挑战。最后,数据集的规模庞大,如何高效存储、管理和分发这些数据,同时确保数据的完整性和一致性,也是构建过程中需要解决的关键问题。这些挑战不仅影响数据集的构建效率,也直接关系到其在实际应用中的效果。

常用场景

经典使用场景

COYO-700M数据集在视觉与语言模型的训练中扮演着重要角色。其包含的747M图像-文本对为多模态学习提供了丰富的资源,尤其是在图像生成、文本到图像检索以及跨模态理解等任务中,COYO-700M能够显著提升模型的泛化能力和表现。通过其多样化的数据分布和高质量的过滤机制,该数据集成为训练大规模基础模型的理想选择。

解决学术问题

COYO-700M解决了多模态学习中的关键问题,如数据稀缺性和数据质量不一致性。通过从CommonCrawl中提取并过滤大量图像-文本对,该数据集为研究者提供了一个高质量、多样化的训练资源,显著提升了模型在跨模态任务中的表现。此外,其丰富的元属性信息为模型优化和评估提供了更多维度的支持。

实际应用

在实际应用中,COYO-700M被广泛用于图像生成、内容推荐系统以及智能搜索引擎的开发。例如,在电子商务平台中,该数据集可用于训练图像-文本匹配模型,从而提升商品推荐的相关性。此外,其高质量的数据也为社交媒体内容审核和自动化图像标注系统提供了有力支持。

数据集最近研究

最新研究方向

近年来,随着多模态学习在计算机视觉和自然语言处理领域的快速发展,COYO-700M数据集因其大规模图像-文本对及其丰富的元属性,成为训练多模态基础模型的重要资源。该数据集通过从CommonCrawl中提取HTML文档中的图像和替代文本,经过严格的图像和文本过滤,确保了数据的高质量和多样性。当前的研究方向主要集中在利用COYO-700M提升多模态模型的泛化能力,特别是在图像生成、文本到图像检索以及跨模态理解等任务中。此外,COYO-700M的元属性(如CLIP相似度、NSFW评分等)为模型训练提供了额外的监督信号,推动了多模态模型在细粒度任务中的表现。随着多模态预训练模型的广泛应用,COYO-700M在推动视觉-语言联合建模领域的前沿研究中扮演了关键角色。

以上内容由AI搜集并总结生成