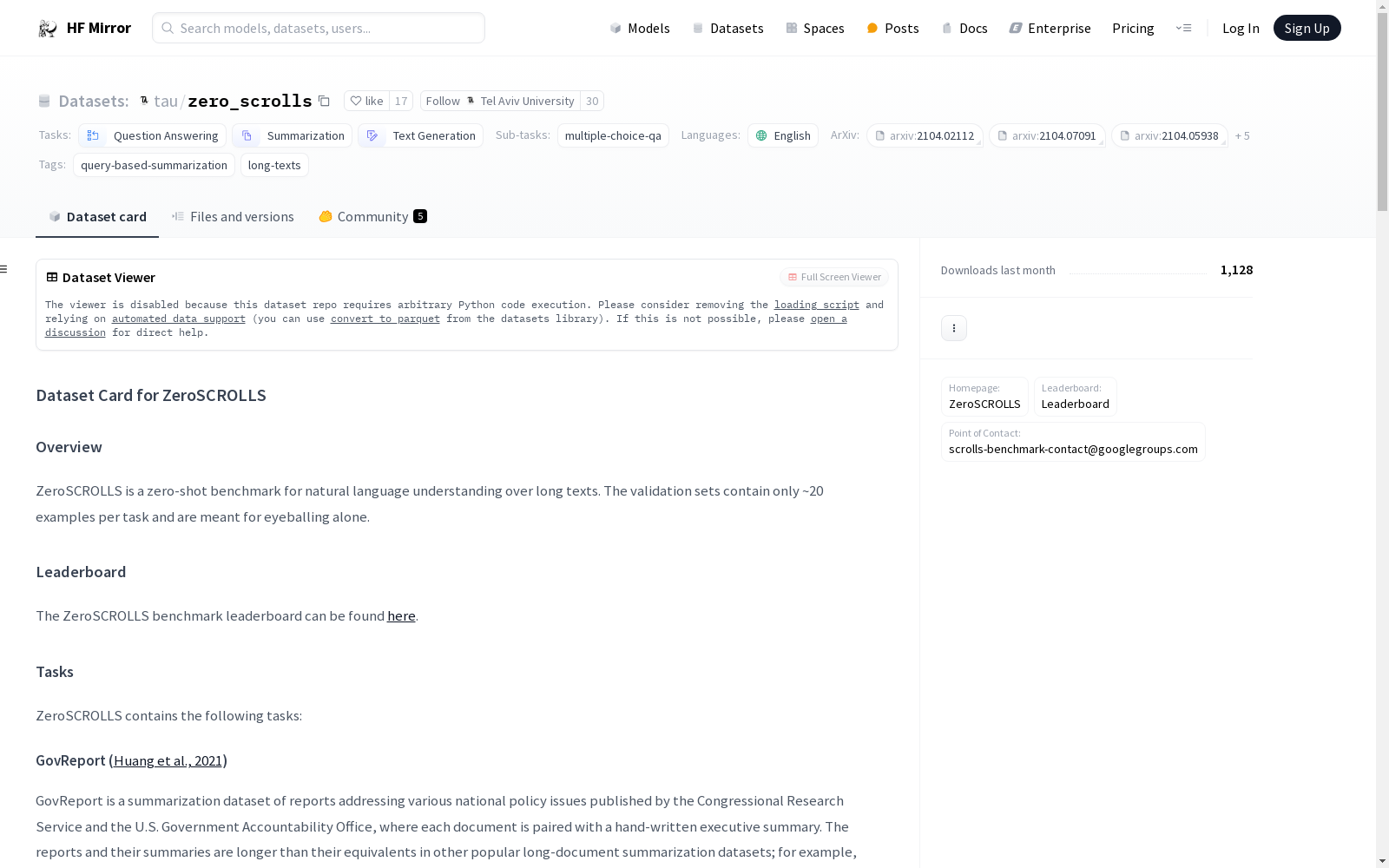

tau/zero_scrolls

收藏Hugging Face2025-07-20 更新2024-03-04 收录

下载链接:

https://hf-mirror.com/datasets/tau/zero_scrolls

下载链接

链接失效反馈资源简介:

ZeroSCROLLS是一个针对长文本的自然语言理解零样本基准测试。它包含了多种任务,如摘要、问题回答和文本生成。数据集中的文本较长,涵盖了政府报告、电视剧剧本、会议记录、学术文章、故事书等多种来源。每个任务都有其独特的特点,例如GovReport数据集包含了政府发布的报告和手写的摘要,而SummScreenFD数据集则是关于电视剧剧本的摘要。ZeroSCROLLS旨在测试模型在没有特定任务训练的情况下,对长文本的理解能力。

ZeroSCROLLS is a zero-shot benchmark for natural language understanding over long texts. It includes a variety of tasks such as summarization, question-answering, and text-generation. The dataset features long texts from various sources including government reports, TV scripts, meeting transcripts, academic papers, and stories. Each task has its unique characteristics, for instance, GovReport contains government-issued reports paired with hand-written summaries, while SummScreenFD focuses on episode recaps of TV shows. ZeroSCROLLS is designed to test the ability of models to understand long texts without specific task training.

提供机构:

tau

原始信息汇总

数据集概述

基本信息

- 语言: 英语

- 任务类别: 问答、摘要生成、文本生成

- 任务ID: 多选题问答

- 标签: 基于查询的摘要生成、长文本

数据集描述

- 名称: ZeroSCROLLS

- 类型: 零样本基准,用于长文本的自然语言理解

- 验证集: 每个任务约20个示例,仅用于初步检查

任务详情

1. GovReport

- 来源: 美国国会研究服务部和美国政府问责局的报告

- 特点: 每份文档配有手写执行摘要,文档长度约为其他流行长文档摘要数据集的1.5至2.5倍

2. SummScreenFD

- 领域: 电视剧集

- 任务: 根据特定剧集的转录生成剧情回顾

- 数据集分割: 使用ForeverDreaming (FD)子集,包含88个不同的节目

3. QMSum

- 类型: 基于查询的摘要生成

- 内容: 包含232个会议记录,涉及多个领域

4. SQuALITY

- 任务: 根据Project Gutenberg的故事和引导问题生成摘要

- 特点: 问题和摘要由经验丰富的作家创作,确保需要阅读故事的大部分内容才能正确回答

5. Qasper

- 领域: 自然语言处理论文

- 任务: 基于论文标题和摘要提出问题,另一组专家提供答案

- 问题类型: 抽象、提取、是/否及不可回答问题

6. NarrativeQA

- 内容: 来自Project Gutenberg的整本书和不同网站的电影剧本

- 任务: 根据Wikipedia的摘要生成问题-答案对

7. QuALITY

- 类型: 多选题问答

- 来源: Project Gutenberg、Open American National Corpus等

- 特点: 问题由经验丰富的作家创作,确保需要阅读大部分文档才能正确回答

8. MuSiQue

- 类型: 多跳问答

- 任务: 基于20个Wikipedia段落回答需要跨段落跳转的问题

9. SpaceDigest

- 任务: 基于Space数据集的50个酒店评论(无评分),确定正面评论的百分比

10. BookSumSort

- 任务: 根据BookSum数据集中的章节摘要,重新排序以匹配原始顺序

数据字段

-

通用字段:

input: 输入文档output: 输出(在ZeroSCROLLS中始终为None)id: 唯一标识符pid: 与id相同,用于多参考评估document_start_index,document_end_index: 文档起始和结束索引query_start_index,query_end_index: 查询起始和结束索引truncation_seperator: 用于标记被截断的上下文的字符串

-

特殊字段(适用于包含多个文档的数据集,如MuSiQue, SpaceDigest, BookSumSort):

inner_docs_start_indices: 内部文档的起始索引序列

搜集汇总

数据集介绍

构建方式

ZeroSCROLLS数据集通过整合多个领域的长文本数据构建而成,涵盖了政府报告、电视节目、会议记录、文学作品、科学论文等多种文本类型。每个任务的数据集均源自特定的学术研究或实际应用场景,如GovReport基于美国政府发布的政策报告,SummScreenFD则基于电视剧的剧本。数据集的构建过程中,研究人员精心设计了多种任务类型,包括摘要生成、问答、多选题等,确保每个任务的数据集具有高度的多样性和复杂性。此外,数据集的验证集仅包含约20个示例,主要用于初步评估模型的表现。

特点

ZeroSCROLLS数据集的主要特点在于其零样本学习的设定,即模型在训练阶段未接触过任何目标任务的数据,直接在测试集上进行评估。此外,数据集涵盖了多种长文本处理任务,如长文档摘要、基于查询的摘要生成、多跳问答等,这些任务要求模型具备较强的自然语言理解和推理能力。数据集中的每个任务都具有独特的挑战性,例如GovReport中的文档长度远超其他常见的长文档摘要数据集,而MuSiQue则要求模型在多个段落之间进行多跳推理。

使用方法

使用ZeroSCROLLS数据集时,用户首先需要根据任务类型选择合适的数据集子集,如GovReport用于长文档摘要,Qasper用于科学论文的问答。每个数据集子集均提供了详细的输入输出格式,包括文档的起始和结束索引、查询的起始和结束索引等,便于用户进行数据解析和模型训练。由于数据集仅包含测试集,用户需自行准备训练和验证数据。此外,数据集的评估主要依赖于在验证集上的表现,用户可通过官方提供的排行榜查看模型的性能排名。

背景与挑战

背景概述

ZeroSCROLLS数据集是由Uri Shaham、Maor Ivgi、Avia Efrat、Jonathan Berant和Omer Levy等研究人员于2023年创建的,旨在为长文本的自然语言理解提供一个零样本基准。该数据集包含了多个任务,如问答、摘要和文本生成,涵盖了从政府报告到电视剧本等多种领域。其核心研究问题是如何在零样本学习环境下,评估和提升模型对长文本的理解能力。ZeroSCROLLS的推出,为自然语言处理领域提供了一个新的评估标准,特别是在处理长文本和复杂查询方面,具有重要的研究价值和实际应用意义。

当前挑战

ZeroSCROLLS数据集在构建过程中面临多项挑战。首先,长文本的处理本身就是一个复杂的问题,涉及文本分割、信息提取和上下文理解等多个方面。其次,零样本学习的设定要求模型在没有特定任务训练数据的情况下进行表现评估,这增加了模型泛化能力的难度。此外,数据集中的多样化任务和领域,如政府报告、电视剧本和学术会议记录,要求模型具备高度的领域适应性和鲁棒性。最后,数据集的验证集仅包含约20个样本,这使得模型性能的评估更加依赖于高质量的标注和严格的验证方法。

常用场景

经典使用场景

ZeroSCROLLS数据集在自然语言理解领域中,以其对长文本的零样本基准测试而著称。其经典使用场景包括多选题问答、基于查询的摘要生成以及长文本生成等任务。例如,在GovReport任务中,数据集提供了关于国家政策报告的摘要生成,要求模型从长篇报告中提取关键信息并生成简洁的执行摘要。

实际应用

在实际应用中,ZeroSCROLLS数据集可用于开发和优化面向长文本的自动化摘要工具、问答系统和内容生成器。例如,在法律、医疗和新闻等领域,这些工具可以帮助专业人士快速获取和理解大量文本信息,提高工作效率和决策质量。

衍生相关工作

ZeroSCROLLS数据集的发布催生了一系列相关研究工作。例如,研究者们基于GovReport和QMSum等任务,开发了新的摘要生成和问答模型,这些模型在处理长文本时表现出色。此外,数据集还激发了对零样本学习和长文本处理技术的深入研究,推动了自然语言处理领域的技术进步。

以上内容由遇见数据集搜集并总结生成