MME-Reasoning

收藏github2025-05-23 更新2025-05-24 收录

下载链接:

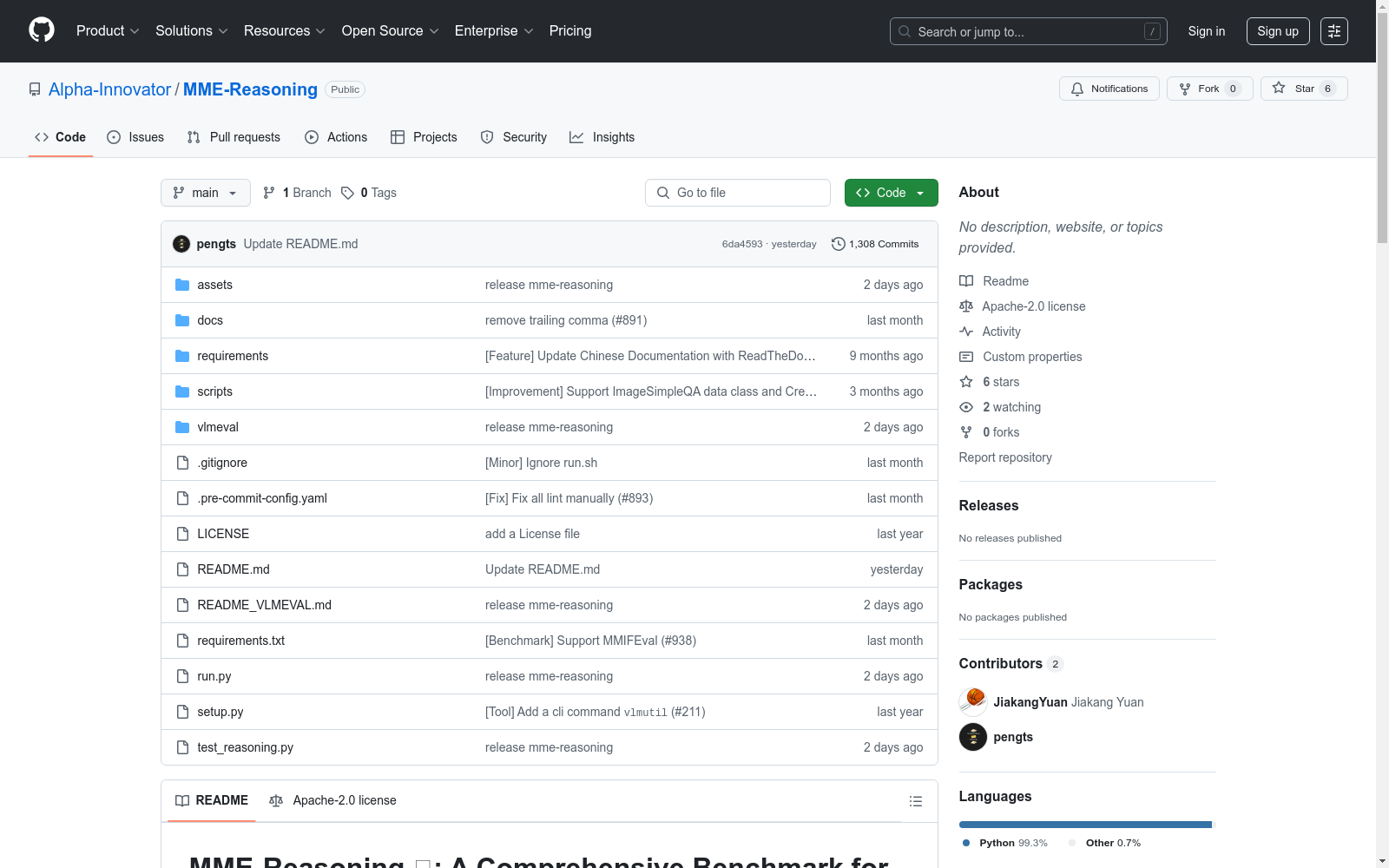

https://github.com/Alpha-Innovator/MME-Reasoning

下载链接

链接失效反馈官方服务:

资源简介:

MME-Reasoning是一个全面评估多模态大语言模型(MLLMs)逻辑推理能力的基准测试。它包含1,188个精心设计的问题,系统覆盖了归纳、演绎和溯因三种逻辑推理类型,并涵盖不同难度级别。

MME-Reasoning is a benchmark for comprehensively evaluating the logical reasoning capabilities of multimodal large language models (MLLMs). It comprises 1,188 meticulously designed questions that systematically cover three categories of logical reasoning: inductive, deductive, and abductive, and spans multiple difficulty levels.

创建时间:

2025-05-22

原始信息汇总

MME-Reasoning 数据集概述

基本信息

- 数据集名称: MME-Reasoning

- 任务类型: 多模态推理 (Multimodal Reasoning)、视觉推理 (Visual Reasoning)

- 官方仓库: GitHub

- 项目页面: Project Page

- 论文链接: Paper

- Huggingface数据集: Huggingface Dataset

- 排行榜: Leaderboard

数据集简介

MME-Reasoning 是一个全面评估多模态大语言模型 (MLLMs) 推理能力的基准测试。该数据集包含 1,188 个精心设计的问题,系统覆盖了三种逻辑推理类型(归纳、演绎和溯因),并涵盖不同难度级别。

关键特点

- 推理类型: 归纳推理、演绎推理、溯因推理

- 难度级别: 涵盖多个难度级别

- 实验模型: 包括 OpenAI o4-mini、Seed1.5-VL-Thinking、Gemini2.5-Pro-Thinking 等

主要发现

- MLLMs 在推理能力上存在显著局限性和明显的不平衡。

- 溯因推理是当前 MLLMs 的主要瓶颈。

- 推理长度与任务难度相关,但伴随边际效应和令牌效率下降。

使用说明

-

按照 VLMEvalKit 设置环境。

-

从 huggingface 下载 MME-Reasoning 数据和元数据。

-

设置环境变量

LMUData。 -

在

vlmeval/dataset/mmereasoning/mmereasoning.py中设置元数据路径。 -

运行推理脚本: python python run.py --data MMEReasoning --model your_model --mode infer --verbose

-

提取和评估最终结果: python python test_mme_reasoning.py --file_path response_file

贡献与引用

- 贡献排行榜: 欢迎通过邮件 jkyuan112@gmail.com 或 pengts521@gmail.com 提交预测文件。

- 引用: 提供 BibTeX 引用格式(具体内容见官方仓库)。

搜集汇总

数据集介绍

构建方式

在人工智能领域,多模态大语言模型(MLLMs)的推理能力评估一直面临挑战。MME-Reasoning基准通过系统化的方法构建,研究人员精心设计了1,188个涵盖归纳、演绎和溯因三种逻辑推理类型的问题。这些问题经过严格筛选,确保覆盖不同难度级别,并采用标准化的标注流程进行验证,最终形成具有代表性的评估样本集合。

特点

作为专门针对MLLMs逻辑推理能力设计的评估基准,MME-Reasoning展现出鲜明的特色。该数据集不仅首次系统划分了三种基本逻辑推理类型,还通过精心设计的难度梯度,全面检测模型在不同认知层次的表现。特别值得注意的是,数据集中包含大量需要复杂多步推理的问题,能够有效揭示模型在长程逻辑推理中的薄弱环节。

使用方法

使用MME-Reasoning进行评估需要遵循标准化的流程。研究人员需先配置VLMEvalKit评估环境,下载数据集至指定目录。通过设置环境变量和修改配置文件路径后,即可运行评估脚本对目标模型进行测试。评估结果将自动生成包含详细评分的Excel文件,用户可通过专用脚本解析最终性能指标。该基准还支持研究者提交模型预测结果至官方排行榜,促进学术交流与比较。

背景与挑战

背景概述

MME-Reasoning是由Alpha Innovator团队于2025年5月推出的多模态大语言模型逻辑推理评估基准。作为人工智能领域的重要基础设施,该数据集旨在系统评估MLLMs在归纳、演绎和溯因三类逻辑推理任务中的表现。研究团队通过1,188道精心设计的题目,首次构建了覆盖完整推理类型和难度谱系的多维度评估体系,填补了现有基准在推理能力细粒度测评方面的空白。其创新性工作为揭示MLLMs的认知局限提供了实证基础,对推动多模态推理的理论研究和应用落地具有里程碑意义。

当前挑战

该数据集主要应对两大核心挑战:在领域问题层面,当前MLLMs存在推理能力不均衡、溯因推理表现薄弱等显著缺陷,且推理长度与任务难度间的非线性关系尚未明确;在构建过程中,需突破多模态数据协同标注的技术瓶颈,确保不同推理类型题目在语义复杂度和视觉线索呈现上的精确平衡。此外,维持评估框架的扩展性以适配开源与闭源模型的异构架构,也是实现全面测评的关键难点。

常用场景

经典使用场景

在人工智能领域,多模态大语言模型(MLLMs)的推理能力评估一直是研究热点。MME-Reasoning数据集通过精心设计的1,188个问题,系统覆盖了归纳、演绎和溯因三种逻辑推理类型,为研究者提供了一个全面评估MLLMs推理能力的基准工具。该数据集广泛应用于模型性能测试、推理能力对比研究以及新型推理算法的开发验证。

实际应用

在实际应用中,MME-Reasoning数据集被广泛用于智能对话系统、教育辅助工具和决策支持系统的开发测试。通过该数据集的评估,开发者能够准确识别模型在复杂推理任务中的薄弱环节,针对性优化模型架构和训练策略。多家科技企业已将该数据集纳入其多模态产品的标准测试流程。

衍生相关工作

基于MME-Reasoning数据集,研究者们开展了一系列创新性工作。包括开发专门针对溯因推理的增强算法、设计更高效的推理评估框架,以及探索推理长度与任务难度之间的关系。这些工作显著推进了多模态推理领域的发展,部分成果已被整合到主流MLLMs的训练和评估流程中。

以上内容由遇见数据集搜集并总结生成