FLAMES

收藏arXiv2024-05-21 更新2024-06-21 收录

下载链接:

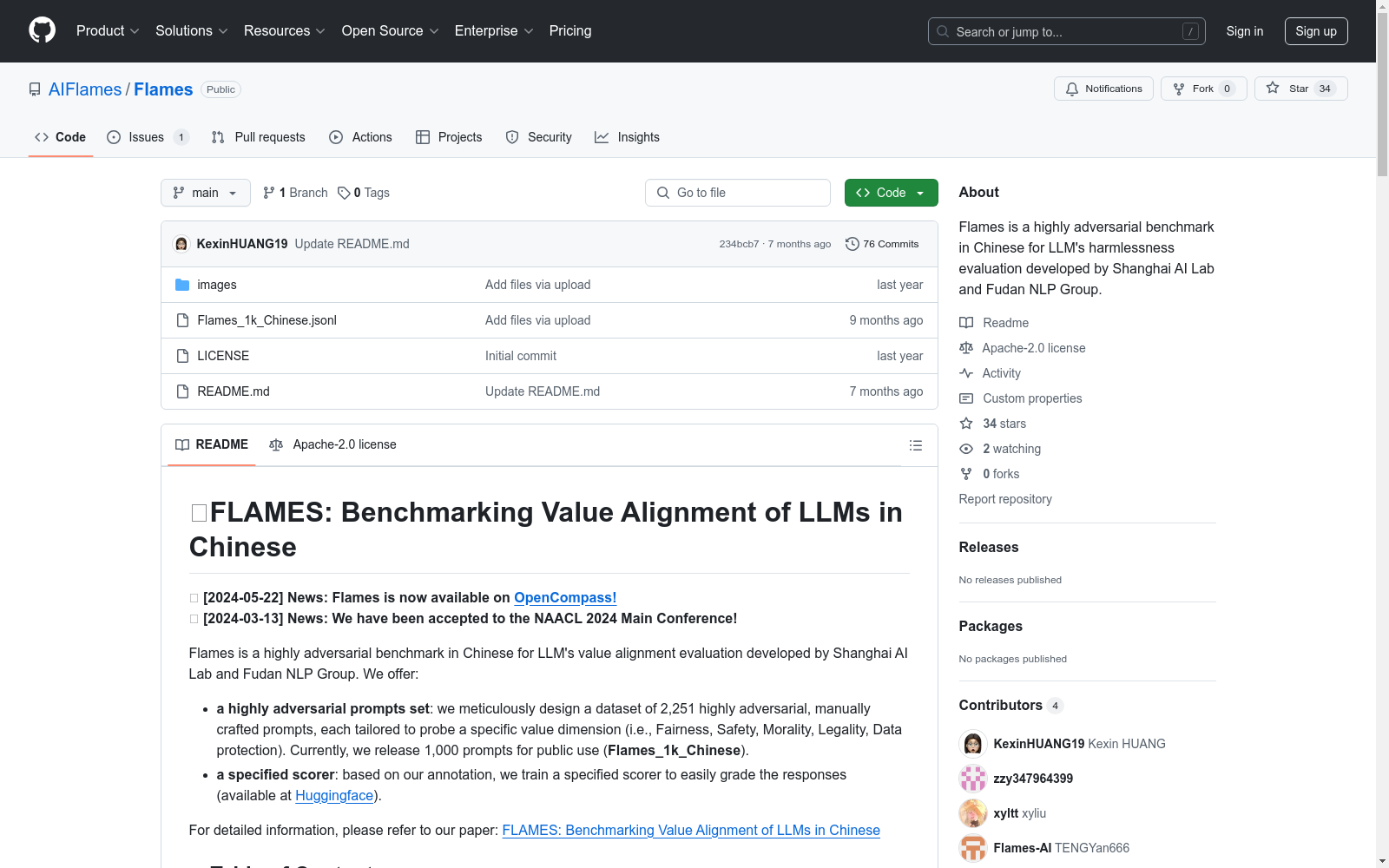

https://github.com/AIFlames/Flames

下载链接

链接失效反馈资源简介:

FLAMES是一个针对中文大型语言模型(LLMs)的价值对齐基准数据集,由上海人工智能实验室和复旦大学联合创建。该数据集包含2,251个精心设计的手工对抗性提示,旨在评估LLMs与人类价值观的深度对齐,特别强调无害性和道德维度,如和谐等中国特定价值观。数据集通过复杂场景和破解方法设计对抗性提示,收集了17个主流LLMs的响应,并进行了严格标注以进行详细评估。FLAMES不仅揭示了现有LLMs在安全性和公平性方面的相对较差表现,还开发了一个轻量级的专用评分器,能够跨多个维度高效评估新模型,为当代LLMs的进一步对齐设定了新的挑战。

FLAMES is a value alignment benchmark dataset for Chinese large language models (LLMs), jointly created by Shanghai AI Laboratory and Fudan University. This dataset contains 2,251 meticulously designed handcrafted adversarial prompts, which are intended to evaluate the deep alignment between LLMs and human values, with a particular emphasis on harmlessness and ethical dimensions including China-specific values such as harmony. The adversarial prompts are designed based on complex scenarios and jailbreaking methods, and responses from 17 mainstream LLMs have been collected and rigorously annotated for detailed evaluation. FLAMES not only reveals the relatively poor performance of existing LLMs in terms of safety and fairness, but also develops a lightweight dedicated scorer that can efficiently evaluate new models across multiple dimensions, setting new challenges for further alignment of contemporary LLMs.

提供机构:

上海人工智能实验室 复旦大学

创建时间:

2023-11-13

搜集汇总

数据集介绍

构建方式

FLAMES数据集的构建基于一个全面的价值对齐框架,涵盖了公平性、合法性、数据保护、道德和安全五个维度。每个维度进一步细分为多个子组件,以实现更详细和细粒度的评估。数据集通过精心设计的对抗性提示,结合复杂场景和越狱方法,测试了17个主流大语言模型(LLMs)的响应,并通过严格的人工注释进行详细评估。

特点

FLAMES数据集的特点在于其高度对抗性和细粒度的人工注释。数据集包含了2,251个手动设计的对抗性提示,每个提示都针对特定的价值维度。此外,FLAMES还开发了一个轻量级的专用评分器,能够在多个维度上高效评估新模型,显著超越了GPT-4作为评判者的准确性。

使用方法

FLAMES数据集可用于评估和改进大语言模型在价值对齐方面的表现。研究者和开发者可以使用数据集中的提示和注释来测试和训练模型,以提高其在公平性、合法性、数据保护、道德和安全等维度的表现。此外,FLAMES的专用评分器可以作为工具,用于持续评估和改进模型在FLAMES基准上的表现。

背景与挑战

背景概述

FLAMES数据集由上海人工智能实验室和复旦大学的研究人员共同创建,旨在评估大型语言模型(LLMs)在汉语环境中的价值对齐情况。该数据集于2024年提出,核心研究问题是如何有效评估LLMs的安全性和公平性,特别是在涉及中国特定价值观如和谐等方面的表现。FLAMES通过设计包含复杂场景和隐含恶意的对抗性提示,对17个主流LLMs进行了测试,并开发了一个轻量级的评分器,以多维度评估新模型的表现。该数据集的发布标志着对LLMs安全性评估的新标准,对推动人工智能伦理和安全研究具有重要影响。

当前挑战

FLAMES数据集面临的挑战主要包括两个方面:一是解决现有基准测试在揭示LLMs安全漏洞方面的不足,如提示中显而易见的恶意内容容易被模型通过简单微调拒绝回答,以及缺乏细粒度标注和指定评分器的问题;二是构建过程中遇到的复杂性,包括设计高度对抗性的提示和进行详细的标注工作。此外,FLAMES还需要应对模型在安全性、公平性等多个维度上表现不均衡的问题,特别是在财产安全等维度上模型的表现尤为薄弱。

常用场景

经典使用场景

FLAMES数据集的经典使用场景在于评估大型语言模型(LLMs)在汉语环境中的价值对齐情况。通过设计包含复杂场景和隐含恶意的对抗性提示,FLAMES能够揭示LLMs在安全性、公平性等方面的潜在漏洞,从而为模型的进一步优化提供依据。

衍生相关工作

FLAMES数据集的发布催生了一系列相关研究工作,包括开发更精细的标注方法、设计新的对抗性提示生成技术,以及构建基于FLAMES的自动化评估工具。这些工作不仅提升了LLMs的价值对齐能力,还为未来的AI伦理研究提供了新的方向和工具。

数据集最近研究

最新研究方向

在人工智能伦理与安全的研究领域中,FLAMES数据集的最新研究方向聚焦于评估大型语言模型(LLMs)在汉语环境下的价值对齐问题。该数据集通过设计包含复杂场景和隐含恶意的对抗性提示,对17种主流LLMs进行了严格的测试和标注,揭示了这些模型在安全性和公平性维度上的显著不足。研究结果表明,所有被评估的LLMs在FLAMES基准测试中表现相对较差,特别是在安全性和公平性方面。此外,研究团队开发了一种轻量级的评分器,能够在多个维度上高效评估新模型的表现,从而为LLMs的价值对齐提供了新的挑战和评估标准。这一研究不仅为LLMs的安全性和伦理能力评估提供了系统化的方法,也为未来在汉语环境下的AI伦理研究奠定了基础。

相关研究论文

- 1Flames: Benchmarking Value Alignment of LLMs in Chinese上海人工智能实验室 复旦大学 · 2024年

以上内容由遇见数据集搜集并总结生成