ToolBench

收藏github2023-07-01 更新2025-02-07 收录

下载链接:

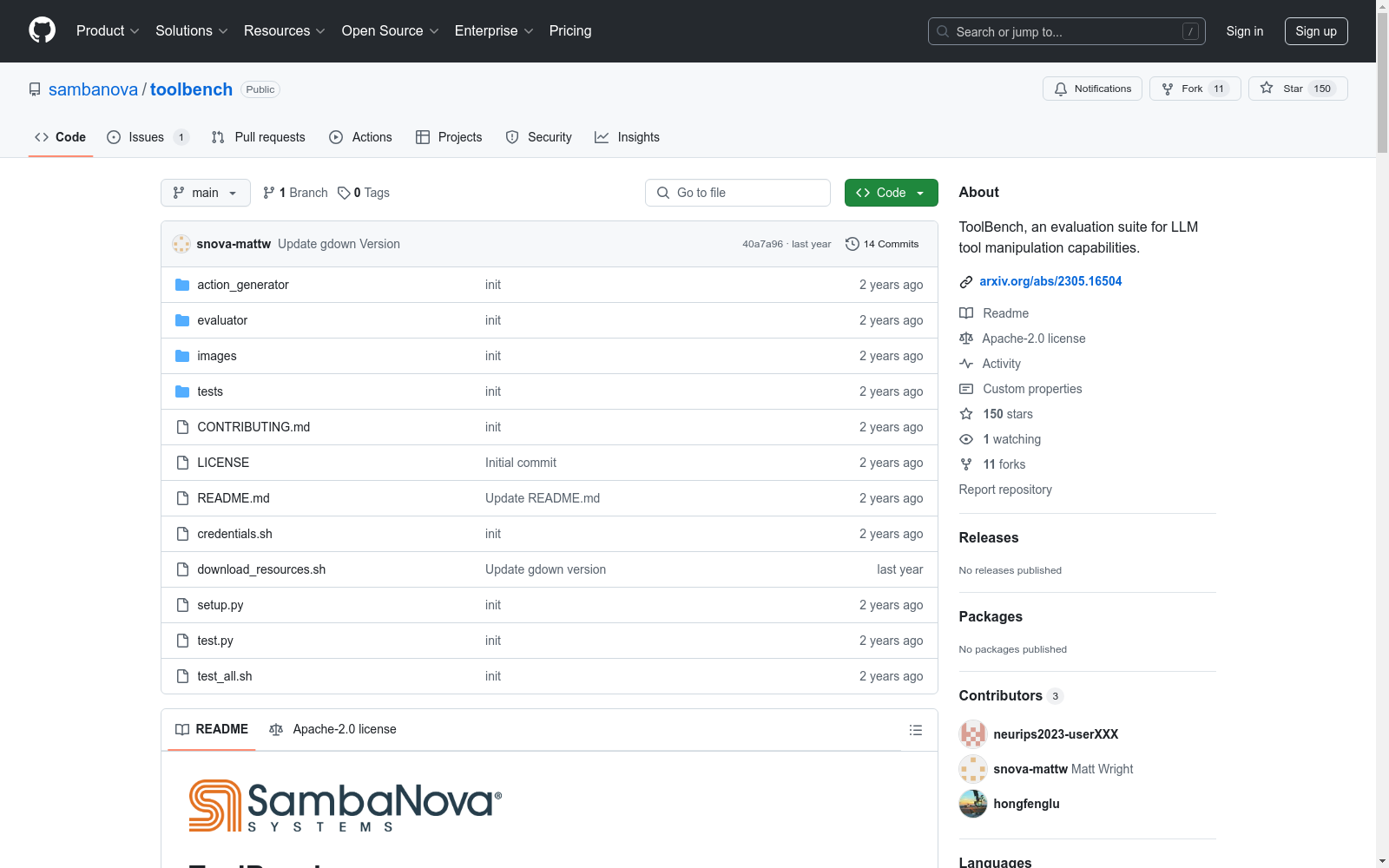

https://github.com/sambanova/toolbench

下载链接

链接失效反馈资源简介:

ToolBench 数据集是一个由模型自动生成的工具使用数据集。其构建过程主要包括三个阶段:首先,收集了16,464个真实的工具API,涵盖49个类别;其次,利用模型为这些API生成各种指令,包括单工具和多工具场景;最后,利用模型为每条指令搜索有效的解决方案路径。该数据集总共包含12.6万个实例,为工具调用提供了一个丰富的资源。

The ToolBench dataset is a tool usage dataset automatically generated by models. Its construction process consists of three main phases: first, 16,464 real tool APIs from 49 categories were collected; second, various instructions, including single-tool and multi-tool scenarios, were generated for these APIs by the model; finally, effective solution paths for each instruction were searched using the model. The dataset contains a total of 126,000 instances, providing a rich resource for tool invocation.

提供机构:

清华大学

创建时间:

2023-07-01

原始信息汇总

ToolBench 数据集概述

数据集简介

ToolBench 是一个用于评估大型语言模型(LLMs)在软件工具操作任务上表现的基准测试集。该数据集旨在研究开源LLMs与闭源模型在工具操作能力上的差距,并促进开源LLMs的发展。

数据集特点

- 包含多样化的真实世界软件工具任务

- 提供易于使用的基础设施直接评估模型执行成功率

- 支持多种工具和模型的评估

包含工具

- OpenWeather

- The Cat API

- Home Search

- Trip Booking

- Google Sheet

- VirtualHome

- Webshop

- Tabletop

数据集结构

每个任务在data/目录下按以下结构组织:

<task>/<version>/ ├── examples/ │ ├── 0_0.txt │ ├── ... ├── functions/ │ ├── search │ ├── ... └── test.jsonl

评估方法

使用test.py脚本评估模型在指定工具上的API函数调用成功率,支持以下参数配置:

- 任务选择

- 模型选择

- API检索数量

- 提示中的示例数量

使用示例

bash python test.py --task open_weather --version v0 --top_k_api 10 --top_k_example 3 --num_test_samples -1 --client_name "openai" --model_name text-davinci-003 --max_output_token 128

数据示例

每个任务提供API文档和使用示例,例如:

- OpenWeather: 获取天气和空气污染数据

- The Cat API: 管理喜欢的猫图片

- Home Search: 房屋搜索条件设置

- Trip Booking: 旅行票务和酒店预订

- Google Sheets: 电子表格操作

系统要求

- Conda (anaconda)

- Java >= 11.0.13

- 需要注册多个API密钥

安装步骤

- 创建虚拟环境

- 下载资源

- 安装依赖

- 运行测试验证安装

贡献

欢迎贡献新的动作生成算法和测试任务。

搜集汇总

数据集介绍

构建方式

ToolBench数据集的构建旨在填补开源大语言模型(LLMs)在工具操作能力上的研究空白。该数据集通过整合多样化的软件工具,涵盖了从天气查询到虚拟家居操作等真实世界任务。构建过程中,研究团队精心设计了多个任务版本,并为每个任务提供了详细的API文档和示例用例,确保数据集能够全面评估模型在工具调用和执行上的表现。

使用方法

使用ToolBench数据集时,用户首先需要配置相关API密钥和软件环境,如OpenAI、Google Cloud等。随后,通过提供的`test.py`脚本,用户可以针对特定任务和模型进行测试。测试过程中,用户可以通过调整参数(如API调用数量、示例数量等)来定制评估方案。测试结果将自动记录并缓存,便于后续分析和比较。此外,数据集还支持对HuggingFace模型的本地评估,进一步扩展了其应用场景。

背景与挑战

背景概述

ToolBench数据集由SambaNova Systems的研究团队创建,旨在解决大型语言模型(LLMs)在软件工具操作中的性能差距问题。近年来,尽管闭源模型(如OpenAI)在工具操作任务上表现出色,但开源模型的表现却显著落后。为了探究这一差距的根本原因,并推动开源模型在工具操作能力上的发展,ToolBench应运而生。该数据集包含多样化的软件工具任务,涵盖了从天气查询到虚拟家居操作等多个领域,旨在为研究人员提供一个标准化的评估平台,促进开源模型的进步。

当前挑战

ToolBench面临的挑战主要集中在两个方面。首先,开源模型在工具操作任务上的表现与闭源模型存在显著差距,如何缩小这一差距是当前研究的核心问题。其次,数据集的构建过程中,如何确保任务的多样性和复杂性,以真实反映现实世界的工具操作需求,也是一个重要的挑战。此外,数据集的评估基础设施需要支持多种模型和任务的灵活测试,这对系统的可扩展性和易用性提出了较高要求。

常用场景

经典使用场景

ToolBench数据集主要用于评估大型语言模型(LLMs)在处理多样化软件工具时的表现。通过提供一系列真实世界任务,如天气查询、房屋搜索、旅行预订等,ToolBench能够全面测试模型在调用API、生成代码和执行任务方面的能力。这一数据集特别适用于研究开源LLMs在工具操作上的表现,帮助开发者识别和解决模型在实际应用中的瓶颈。

解决学术问题

ToolBench数据集解决了开源大型语言模型在工具操作能力上与闭源模型之间的显著差距问题。通过提供多样化的任务和API调用场景,ToolBench帮助研究者深入分析模型在工具操作中的失败原因,并推动开源模型的改进。该数据集的出现填补了学术界在工具操作评估领域的空白,为开源LLMs的发展提供了重要的基准和参考。

实际应用

ToolBench数据集在实际应用中具有广泛的潜力。它可以用于开发智能助手、自动化工具调用系统以及多任务处理平台。例如,基于ToolBench的模型可以集成到智能家居系统中,帮助用户通过自然语言指令控制家电、查询天气或预订旅行。此外,该数据集还可用于企业级应用,如自动化办公工具的开发,提升工作效率和用户体验。

数据集最近研究

最新研究方向

在大型语言模型(LLMs)与软件工具交互的研究领域,ToolBench数据集的出现为开源模型的工具操作能力提供了新的评估基准。当前研究热点集中在探索开源模型与封闭模型API(如OpenAI)在工具操作准确性上的差距,并试图通过ToolBench的多样化任务集来揭示这一差距的根本原因。该数据集不仅涵盖了从天气查询到虚拟家居控制等多种现实任务,还提供了便捷的基础设施以评估模型的执行成功率。随着开源LLMs的快速发展,ToolBench的研究方向正逐步向提升模型在复杂任务中的泛化能力和工具操作的精确性迈进,这对于推动开源模型的广泛应用具有重要意义。

以上内容由遇见数据集搜集并总结生成