OpenCSG Chinese Corpus

收藏arXiv2025-01-14 更新2025-01-16 收录

下载链接:

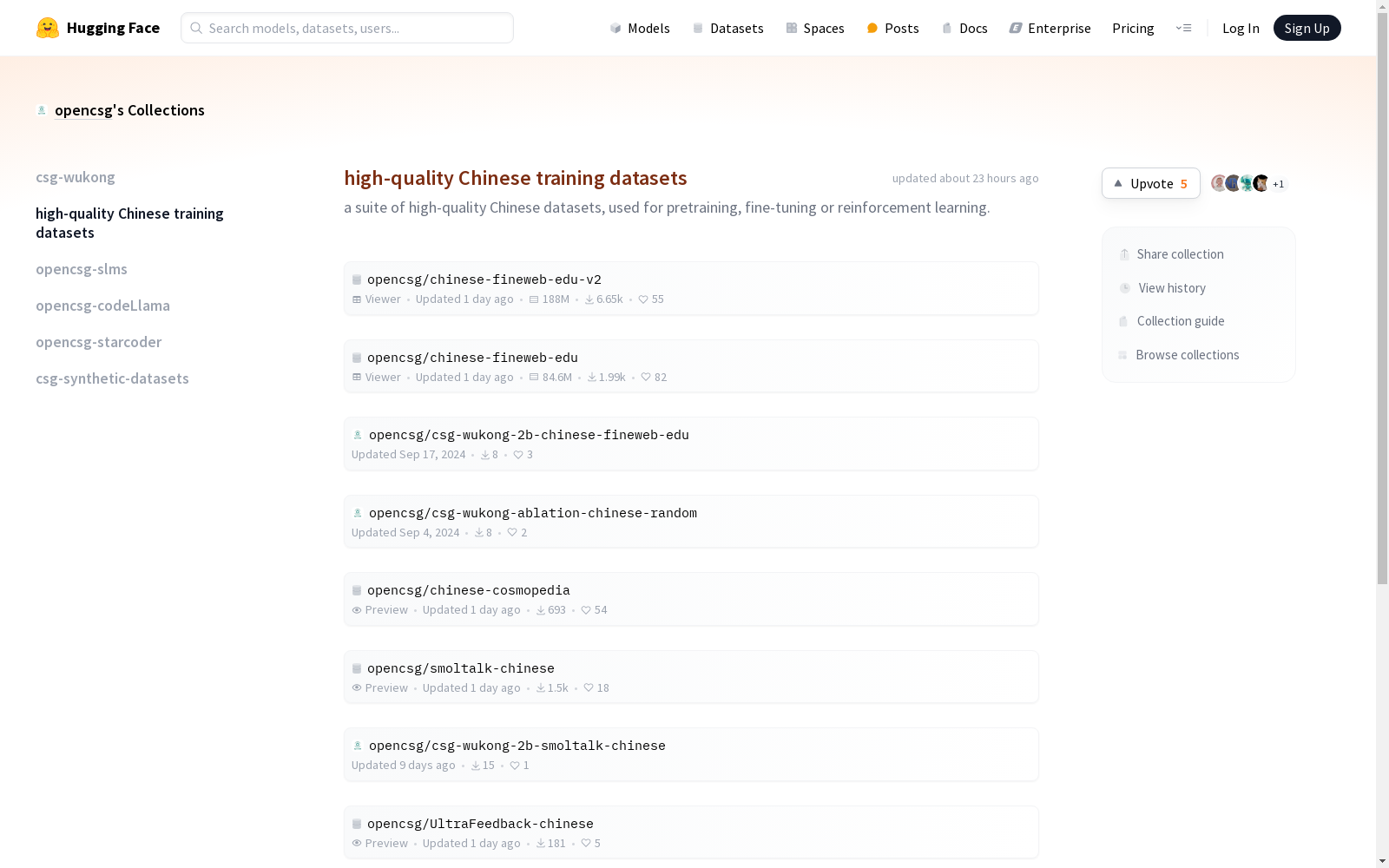

https://huggingface.co/collections/opencsg/high-quality-chinese-training-datasets-66cfed105f502ece8f29643e

下载链接

链接失效反馈资源简介:

OpenCSG中文语料库由清华大学和OpenCSG联合创建,旨在为大语言模型的训练提供高质量的中文数据集。该语料库包含四个数据集:Fineweb-edu-chinese、Fineweb-edu-chinese-v2、Cosmopedia-chinese和Smoltalk-chinese。Fineweb-edu数据集专注于从多样化的中文网络资源中筛选高质量内容,Cosmopedia-chinese提供合成教材风格的数据,Smoltalk-chinese则强调多样化的聊天格式数据。数据集通过自动化评分和合成文本生成技术构建,具有高质量、多样性和开放性,适用于中文大语言模型的预训练、后训练和微调。

The OpenCSG Chinese Corpus, jointly created by Tsinghua University and OpenCSG, is designed to provide high-quality Chinese datasets for the training of large language models. The corpus encompasses four datasets: Fineweb-edu-chinese, Fineweb-edu-chinese-v2, Cosmopedia-chinese, and Smoltalk-chinese. The Fineweb-edu dataset focuses on selecting high-quality content from diverse Chinese online resources, Cosmopedia-chinese offers synthetic teaching material-style data, and Smoltalk-chinese emphasizes diverse chat format data. The datasets are constructed through automated scoring and synthetic text generation techniques, featuring high quality, diversity, and openness, and are suitable for pre-training, post-training, and fine-tuning of Chinese large language models.

提供机构:

清华大学, OpenCSG

创建时间:

2025-01-14

搜集汇总

数据集介绍

构建方式

OpenCSG Chinese Corpus的构建过程结合了自动化评分模块、合成文本生成和领域导向的筛选方法。Fineweb-edu-chinese数据集通过随机采样、数据池构建、标注和评分等步骤,使用Qwen2-7b-instruct模型对样本进行教育价值评分,并通过BERT模型进行过滤和去重。Cosmopedia-chinese数据集则通过高质量的种子数据生成合成文本,使用glm4-9b-longwriter模型生成教科书风格的内容。Smoltalk-chinese数据集则通过系统提示和高级中文LLM生成多轮对话,结合自动化评分和去重技术,确保数据的多样性和质量。

特点

OpenCSG Chinese Corpus的特点在于其高质量、多样性和开放性。Fineweb-edu-chinese数据集专注于教育和技术领域的高质量内容,经过严格的筛选和去重,确保数据的教育价值。Cosmopedia-chinese数据集提供了丰富的合成文本,涵盖科学、文学和实用知识等多个领域,适合知识密集型任务。Smoltalk-chinese数据集则强调多样化的对话格式,涵盖多种任务类型,适合自然语言理解和生成任务。整个数据集通过可扩展和可复制的数据整理流程,确保了数据的高质量和广泛覆盖。

使用方法

OpenCSG Chinese Corpus的使用方法包括预训练、后训练和微调。Fineweb-edu-chinese数据集适用于预训练,能够显著提升模型在C-Eval和CMMLU等基准测试中的表现。Cosmopedia-chinese数据集适合用于知识密集型任务的训练,能够生成结构化和知识丰富的文本。Smoltalk-chinese数据集则适合用于指令微调,能够提升模型在多轮对话和复杂任务中的表现。用户可以通过Hugging Face平台获取这些数据集,并根据具体任务需求进行模型训练和评估。

背景与挑战

背景概述

OpenCSG Chinese Corpus是由清华大学与OpenCSG团队于2025年推出的一个高质量中文数据集系列,旨在为大语言模型(LLM)的预训练、后训练和微调提供支持。该数据集包括Fineweb-edu-chinese、Fineweb-edu-chinese-v2、Cosmopedia-chinese和Smoltalk-chinese四个子集,分别针对不同领域和任务设计。Fineweb-edu系列专注于从多样化的中文网络资源中提取高质量内容,Cosmopedia-chinese则通过合成方式生成教科书风格的知识密集型数据,而Smoltalk-chinese则侧重于多样化的对话格式数据。OpenCSG Chinese Corpus的推出填补了中文高质量数据集的空白,显著提升了中文大语言模型的性能,尤其是在C-Eval等任务上的表现。该数据集的开源性质也为中文自然语言处理(NLP)社区提供了宝贵的资源。

当前挑战

OpenCSG Chinese Corpus在构建过程中面临了多重挑战。首先,中文高质量数据的稀缺性使得数据收集和标注变得尤为困难,尤其是在需要领域专家参与的情况下。其次,数据集的构建需要强大的计算基础设施来处理大规模数据,这对资源提出了极高的要求。此外,数据版权和许可问题也限制了数据的公开分发,尤其是在非英语语料如中文数据中。尽管现有的中文大语言模型(如Qwen2、GLM和Deepseek)表现出色,但它们大多依赖专有数据,限制了社区的访问和进展。OpenCSG Chinese Corpus通过引入自动化评分模块、合成文本生成和领域导向的筛选方法,成功应对了这些挑战,但其在数据多样性、风格一致性和内容深度方面仍需进一步优化。

常用场景

经典使用场景

OpenCSG Chinese Corpus 数据集在中文自然语言处理(NLP)领域中被广泛用于大规模语言模型(LLM)的预训练、后训练和微调。其经典使用场景包括通过 Fineweb-edu-chinese 和 Fineweb-edu-chinese-v2 数据集进行教育类文本的预训练,Cosmopedia-chinese 数据集用于知识密集型任务的训练,而 Smoltalk-chinese 数据集则专注于多轮对话生成和任务导向的微调。这些数据集通过高质量、多样化的文本内容,显著提升了中文语言模型在复杂任务中的表现。

实际应用

在实际应用中,OpenCSG Chinese Corpus 被广泛用于教育、知识问答、对话系统等领域。Fineweb-edu-chinese 数据集可用于开发智能教育助手,帮助学生理解复杂概念;Cosmopedia-chinese 数据集则适用于知识库的构建,支持知识密集型应用的开发;Smoltalk-chinese 数据集则被用于开发智能客服和对话系统,提升多轮对话的流畅性和任务完成率。这些应用场景展示了该数据集在提升中文语言模型实际应用效果中的重要作用。

衍生相关工作

OpenCSG Chinese Corpus 的发布推动了多个相关研究工作的进展。基于该数据集,研究人员开发了多个高性能的中文语言模型,如 Qwen2 和 Deepseek-V2.5。此外,该数据集还启发了更多关于中文数据生成和过滤技术的研究,如 Magpie 和 Cosmopedia 等合成数据生成方法。这些衍生工作不仅扩展了中文 NLP 的研究边界,还为其他语言的数据集构建提供了宝贵的经验。

以上内容由遇见数据集搜集并总结生成