【我遇到的问题】 • 现象:该数据集的下载链接已失效 【相关信息】 • 可考虑访问这个链接获取类似文件~https://www.selectdataset.com/dataset/3688356173feccbcf1f1e490ddc6bc72

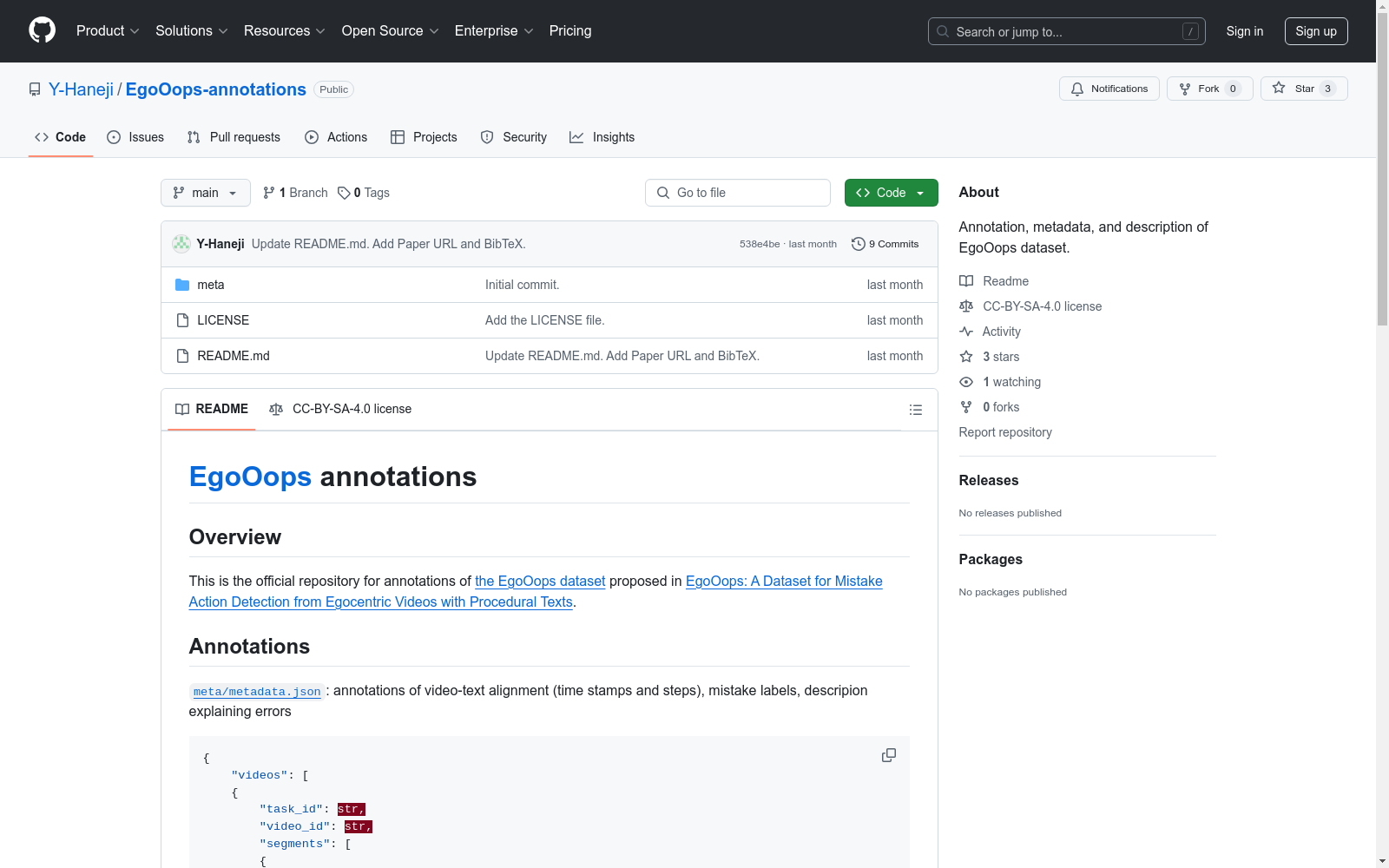

EgoOops

收藏EgoOops 数据集

概述

EgoOops 数据集用于从第一人称视角视频中检测错误动作,并结合过程文本进行标注。该数据集由 Yuto Haneji 等人提出,相关论文发表在 arXiv 上,题为《EgoOops: A Dataset for Mistake Action Detection from Egocentric Videos with Procedural Texts》。

标注文件

-

meta/metadata.json: 包含视频与文本对齐的标注(时间戳和步骤)、错误标签以及错误描述。 json { "videos": [ { "task_id": str, "video_id": str, "segments": [ { "startTime": float (seconds), "endTime": float (seconds), "instruction": int (zero-based index), "labels": list[int] (zero-based index, 空列表表示正确步骤), "caption": str (空字符串表示正确步骤), }, ... ], }, ... ], "instructions": { "blacklight": list[str], ... } } -

meta/microqr/${task_id}.json: 包含嵌入在 QR 码中的编号与对象名称的对齐信息。 -

meta/mistake_classes.json: 包含标注的错误类别名称列表。

视频文件

视频文件可以从以下链接下载: http://www.lsta.media.kyoto-u.ac.jp/resource/data/EgoOops/videos-processed-720p.zip

任务名称转换表

数据集中的任务名称与论文中使用的名称不同,参考下表:

| 数据集 | 论文 |

|---|---|

| blacklight | ionic reaction experiments (IR) |

| cardboard | cardboard crafts (CB) |

| electronics | electrical circuits (EC) |

| ion | ionic reaction experiments (IR) |

| tsumiki | toy block building (BB) |

许可证

EgoOops 数据集采用 CC BY-SA 4.0 许可证。

BibTeX

bibtex @misc{haneji2024egooopsdatasetmistakeaction, title={EgoOops: A Dataset for Mistake Action Detection from Egocentric Videos with Procedural Texts}, author={Yuto Haneji and Taichi Nishimura and Hirotaka Kameko and Keisuke Shirai and Tomoya Yoshida and Keiya Kajimura and Koki Yamamoto and Taiyu Cui and Tomohiro Nishimoto and Shinsuke Mori}, year={2024}, eprint={2410.05343}, archivePrefix={arXiv}, primaryClass={cs.CV}, url={https://arxiv.org/abs/2410.05343}, }