PromptBench

收藏github2023-06-01 更新2025-02-08 收录

下载链接:

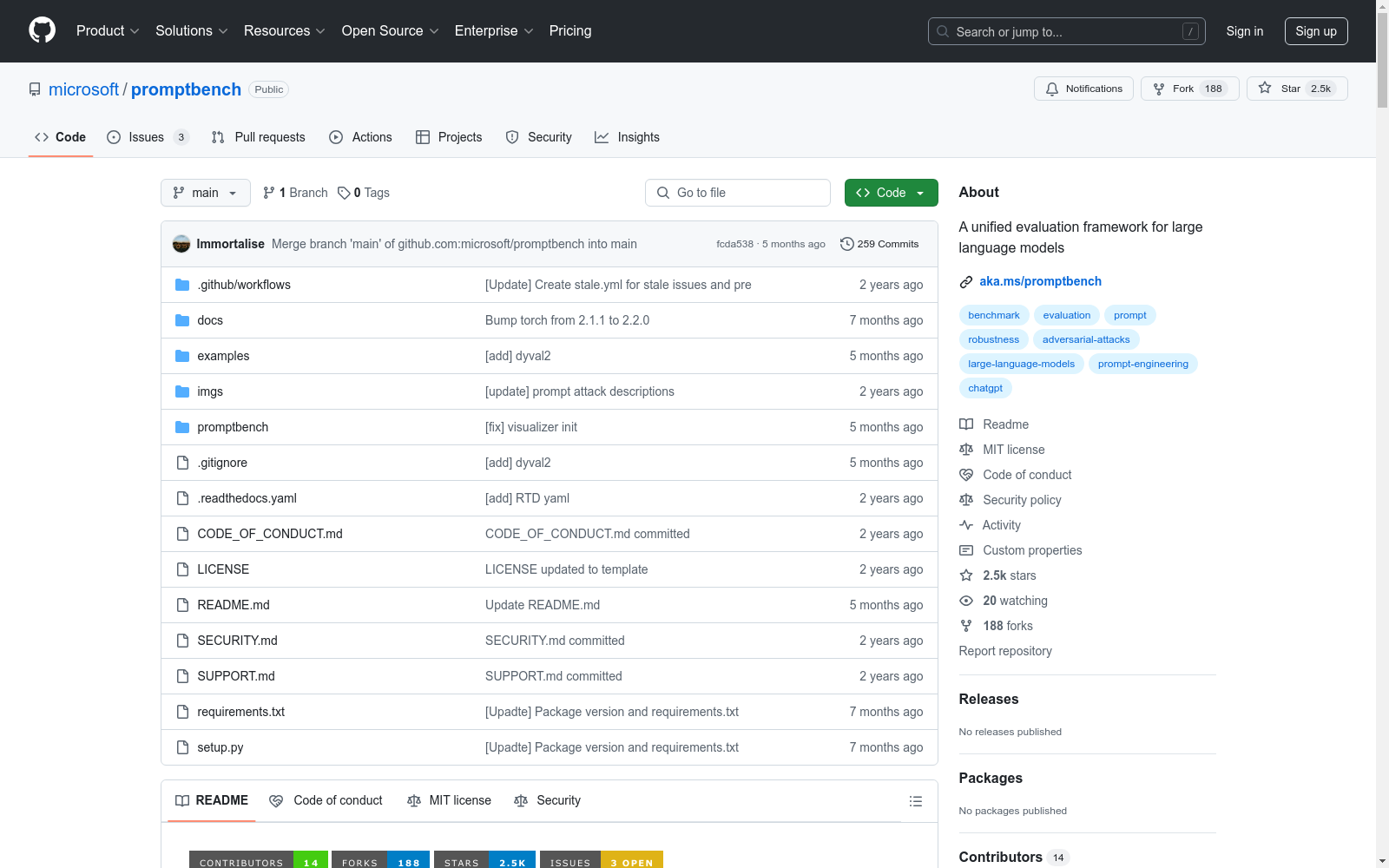

https://github.com/microsoft/promptbench

下载链接

链接失效反馈资源简介:

PromptBench数据集广泛研究了大型语言模型(LLMs)在面对七种不同类型的对抗性提示时的鲁棒性。同时,该数据集还分析了由不同模型生成的对抗性提示的可转移性。鲁棒性测试涵盖了十三个开源数据集中的八种不同的自然语言处理(NLP)任务,涉及情感分析、多任务知识、阅读理解、数学等多个领域。

The PromptBench dataset extensively investigates the robustness of large language models (LLMs) against seven distinct types of adversarial prompts. It also analyzes the transferability of adversarial prompts generated by different models. The robustness tests encompass eight natural language processing (NLP) tasks across thirteen open-source datasets, involving domains such as sentiment analysis, multi-task knowledge, reading comprehension, and mathematics.

提供机构:

Microsoft Research et al.

创建时间:

2023-06-01

原始信息汇总

PromptBench 数据集概述

基本信息

- 名称: PromptBench

- 类型: 大型语言模型评估库

- 开发者: Microsoft

- 技术报告: arXiv:2312.07910

- 文档: promptbench.readthedocs.io

- 排行榜: llm-eval.github.io

主要功能

- 快速模型性能评估

- 提示工程方法实现

- 对抗性提示评估

- 动态评估框架(DyVal)

- 高效多提示评估(PromptEval)

支持的数据集

语言数据集

- GLUE系列: SST-2, CoLA, QQP, MRPC, MNLI, QNLI, RTE, WNLI

- MMLU

- BIG-Bench Hard (布尔逻辑、有效括号、日期等)

- 数学数据集: Math, GSM8K

- SQuAD V2

- 翻译数据集: IWSLT 2017, UN Multi

- 常识推理: CSQA, Numersense, QASC

- 其他: Last Letter Concatenate

多模态数据集

- VQAv2

- NoCaps

- MMMU

- MathVista

- AI2D

- ChartQA

- ScienceQA

支持的模型

语言模型

- 开源模型:

- Flan-T5, Dolly, Llama2系列

- Vicuna, Cerebras-GPT, GPT-NeoX

- Flan-UL2, Phi系列

- 专有模型:

- PaLM 2, GPT-3.5/4, Gemini Pro

多模态模型

- 开源模型:

- BLIP2, LLaVA, Qwen-VL系列

- InternLM-XComposer2-VL

- 专有模型:

- GPT-4v, Gemini Pro Vision

- Qwen-VL-Max/Plus

提示工程技术

- 思维链(Chain-of-Thought)

- 情感提示(EmotionPrompt)

- 专家提示(Expert Prompting)

- 零样本思维链

- 生成知识(Generated Knowledge)

- 由简至繁(Least to Most)

对抗性攻击方法

- 字符级攻击: DeepWordBug, TextBugger

- 词级攻击: TextFooler, BertAttack

- 句子级攻击: CheckList, StressTest

- 语义级攻击: 人工构建攻击

评估协议与分析

- 标准评估

- 动态评估

- 语义评估

- 基准测试结果

- 可视化分析

- 可转移性分析

- 词频分析

AI搜集汇总

数据集介绍

构建方式

PromptBench数据集的构建基于PyTorch框架,旨在为大语言模型(LLMs)的评估提供统一且用户友好的API。该数据集通过整合多种提示工程方法、对抗性提示攻击以及动态评估框架,确保了评估的全面性和灵活性。研究人员可以通过简单的Python接口快速构建模型、加载数据集并进行性能评估。此外,数据集还支持多模态模型和数据集,进一步扩展了其应用范围。

使用方法

PromptBench数据集的使用方法简单直观,用户可以通过pip安装或从GitHub克隆代码库进行安装。安装后,用户可以通过Python接口快速导入并使用数据集。数据集提供了详细的教程和示例代码,帮助用户构建评估管道、测试不同提示技术、评估模型对抗性以及使用DyVal进行动态评估。用户还可以通过提供的Jupyter Notebook示例快速上手,进行多模态评估和高效的多提示评估。

背景与挑战

背景概述

PromptBench是由微软研究院于2023年推出的一个基于PyTorch的Python库,旨在为大语言模型(LLMs)的评估和理解提供统一框架。该数据集的核心研究问题在于如何通过系统化的评估方法,提升大语言模型在多样化任务中的表现,并深入理解其在不同提示工程和对抗攻击下的鲁棒性。PromptBench的创建标志着大语言模型评估领域的一个重要里程碑,其影响力不仅体现在学术界,还广泛应用于工业界的模型优化和部署中。通过集成多种提示工程方法、对抗攻击模拟以及动态评估框架,PromptBench为研究人员提供了一个全面的工具集,推动了LLMs在实际应用中的可靠性和可解释性研究。

当前挑战

PromptBench面临的挑战主要集中在两个方面。首先,在领域问题方面,大语言模型的评估涉及多样化的任务和数据集,如何设计统一的评估框架以覆盖不同领域的复杂性是一个关键挑战。其次,在构建过程中,PromptBench需要处理大量异构数据,并确保评估结果的准确性和可重复性。此外,对抗攻击的模拟和动态评估框架的实现也带来了技术上的复杂性,尤其是在保持评估过程高效性的同时,确保其能够适应不断变化的模型和数据集。这些挑战要求研究人员在数据预处理、模型集成和评估方法上不断创新,以应对日益增长的大语言模型评估需求。

常用场景

经典使用场景

PromptBench作为一个统一的库,主要用于评估和理解大型语言模型(LLMs)的性能。其经典使用场景包括通过用户友好的API快速构建模型、加载数据集并评估模型表现。研究人员可以利用该库进行多种提示工程方法的实验,如Few-shot Chain-of-Thought、Emotion Prompt和Expert Prompting等,从而深入分析不同提示策略对模型输出的影响。此外,PromptBench还支持对抗性提示攻击的模拟,帮助研究人员评估模型在面对恶意输入时的鲁棒性。

解决学术问题

PromptBench解决了多个学术研究中的关键问题,尤其是在大型语言模型评估领域。首先,它提供了动态评估框架DyVal,能够生成具有可控复杂度的评估样本,有效缓解测试数据污染问题。其次,通过集成PromptEval方法,研究人员可以在仅采样5%数据的情况下,准确预测模型在未见数据上的表现,显著降低了评估成本。此外,PromptBench还支持对抗性提示攻击的评估,帮助研究人员理解模型在面对恶意输入时的脆弱性,从而推动模型鲁棒性的提升。

实际应用

在实际应用中,PromptBench被广泛用于企业和研究机构对大型语言模型的性能评估和优化。例如,企业可以利用该库快速评估不同提示策略对模型输出的影响,从而优化客户服务聊天机器人的响应质量。研究机构则可以通过对抗性提示攻击的模拟,评估模型在面对恶意输入时的鲁棒性,为模型的安全部署提供依据。此外,PromptBench还支持多模态模型的评估,使其在图像和文本结合的复杂任务中具有广泛的应用前景。

数据集最近研究

最新研究方向

PromptBench作为一个专注于大语言模型(LLMs)评估的统一库,近年来在自然语言处理领域引起了广泛关注。其最新研究方向主要集中在多模态模型的评估、动态评估框架的优化以及对抗性提示攻击的鲁棒性测试。通过集成DyVal 2和PromptEval等创新方法,PromptBench不仅能够动态生成评估样本,还能通过少量数据预测模型在未见数据上的表现,显著提升了评估效率。此外,PromptBench还支持多种提示工程技术,如Few-shot Chain-of-Thought和Emotion Prompt,进一步推动了LLMs在复杂任务中的表现优化。这些研究方向的进展不仅为LLMs的评估提供了更全面的工具,也为模型在实际应用中的鲁棒性和适应性提供了重要参考。

以上内容由AI搜集并总结生成