SpaceSGG|场景图生成数据集|空间关系建模数据集

收藏LLaVA-SpaceSGG 数据集概述

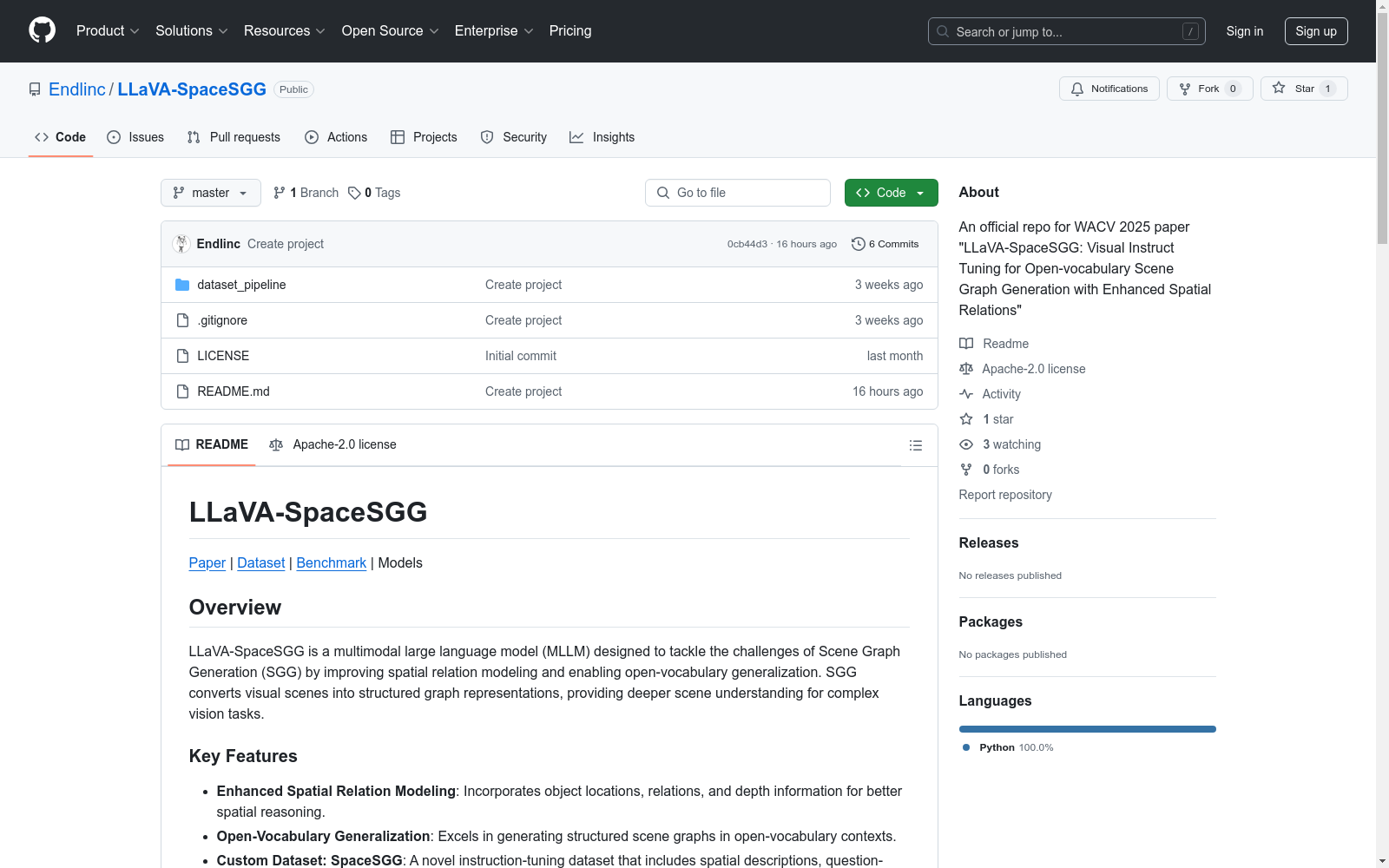

概述

LLaVA-SpaceSGG 是一个多模态大语言模型(MLLM),旨在通过改进空间关系建模和实现开放词汇泛化来解决场景图生成(SGG)的挑战。SGG 将视觉场景转换为结构化的图表示,为复杂的视觉任务提供更深入的场景理解。

关键特性

- 增强的空间关系建模:结合对象位置、关系和深度信息,以更好地进行空间推理。

- 开放词汇泛化:擅长在开放词汇环境中生成结构化的场景图。

- 自定义数据集:SpaceSGG:一个新颖的指令调优数据集,包含空间描述、问答(QA)和对话。

- 两阶段训练范式:通过利用 MLLM 的固有能力,提高模型在 SGG 任务中的可迁移性。

成就

- 性能:LLaVA-SpaceSGG 在召回率上比现有方法高出 4.5%,在平均召回率上提高了 1.4%。

- 数据集:SpaceSGG 是通过一个集成对象位置、空间关系和深度信息的管道构建的,使用了公共数据集和开源模型。

数据准备

阶段 1:生成点云和分层对象

-

从 RGB 和深度图像生成点云: bash python d2p.py --dataset-path dataset/coco --scale-factor 5000 --world-coordinates

-

按深度聚类对象为分层: bash python layers_aggregation.py --input-file asv2_level.json --depth-dir ./depth-output --mask-dir ./mask-output --output-file processed_annotations.json --dataset-base /home/ming/Datasets/all-seeing-v2/materials/ --data-prefix ../data/

-

生成多视角分层对象: bash python multiview_layers.py --input-file asv2_level.json --point-cloud-dir ./point_clouds --mask-dir ./mask-output --output-file processed_annotations.json --dataset-base /home/ming/Datasets/all-seeing-v2/materials/ --data-prefix ../data/

阶段 2:生成训练数据格式

-

生成分层描述: bash python llm_based_query.py --anno-file annotations.json --prompt-function create_layer_prompt --output-file layer_description.json

-

生成问答(QA)数据: bash python llm_based_query.py --anno-file annotations.json --prompt-function create_between_prompt --output-file between_qa.json

-

生成对话数据: bash python llm_based_query.py --anno-file annotations.json --prompt-function create_rotation_prompt --output-file rotation_prompts.json

引用

如果您在研究中使用了 LLaVA-SpaceSGG 或 SpaceSGG 数据集,请引用我们的工作: bibtex @inproceedings{llava_spacesgg2025, title={LLaVA-SpaceSGG: Visual Instruct Tuning for Open-vocabulary Scene Graph Generation with Enhanced Spatial Relations}, author={Your Name and Co-authors}, booktitle={Proceedings of WACV 2025}, year={2025} }

许可证

该项目基于 Apache License 许可。

联系方式

如有问题或反馈,请联系 parasolohalo@gmail.com。

Open Power System Data

Open Power System Data is a free-of-charge data platform dedicated to electricity system researchers. We collect, check, process, document, and publish data that are publicly available but currently inconvenient to use. The project is a service provider to the modeling community: a supplier of a public good. Learn more about its background or just go ahead and explore the data platform.

re3data.org 收录

LFW

人脸数据集;LFW数据集共有13233张人脸图像,每张图像均给出对应的人名,共有5749人,且绝大部分人仅有一张图片。每张图片的尺寸为250X250,绝大部分为彩色图像,但也存在少许黑白人脸图片。 URL: http://vis-www.cs.umass.edu/lfw/index.html#download

AI_Studio 收录

中国食物成分数据库

食物成分数据比较准确而详细地描述农作物、水产类、畜禽肉类等人类赖以生存的基本食物的品质和营养成分含量。它是一个重要的我国公共卫生数据和营养信息资源,是提供人类基本需求和基本社会保障的先决条件;也是一个国家制定相关法规标准、实施有关营养政策、开展食品贸易和进行营养健康教育的基础,兼具学术、经济、社会等多种价值。 本数据集收录了基于2002年食物成分表的1506条食物的31项营养成分(含胆固醇)数据,657条食物的18种氨基酸数据、441条食物的32种脂肪酸数据、130条食物的碘数据、114条食物的大豆异黄酮数据。

国家人口健康科学数据中心 收录

Figshare

Figshare是一个在线数据共享平台,允许研究人员上传和共享各种类型的研究成果,包括数据集、论文、图像、视频等。它旨在促进科学研究的开放性和可重复性。

figshare.com 收录

LinkedIn Salary Insights Dataset

LinkedIn Salary Insights Dataset 提供了全球范围内的薪资数据,包括不同职位、行业、地理位置和经验水平的薪资信息。该数据集旨在帮助用户了解薪资趋势和市场行情,支持职业规划和薪资谈判。

www.linkedin.com 收录