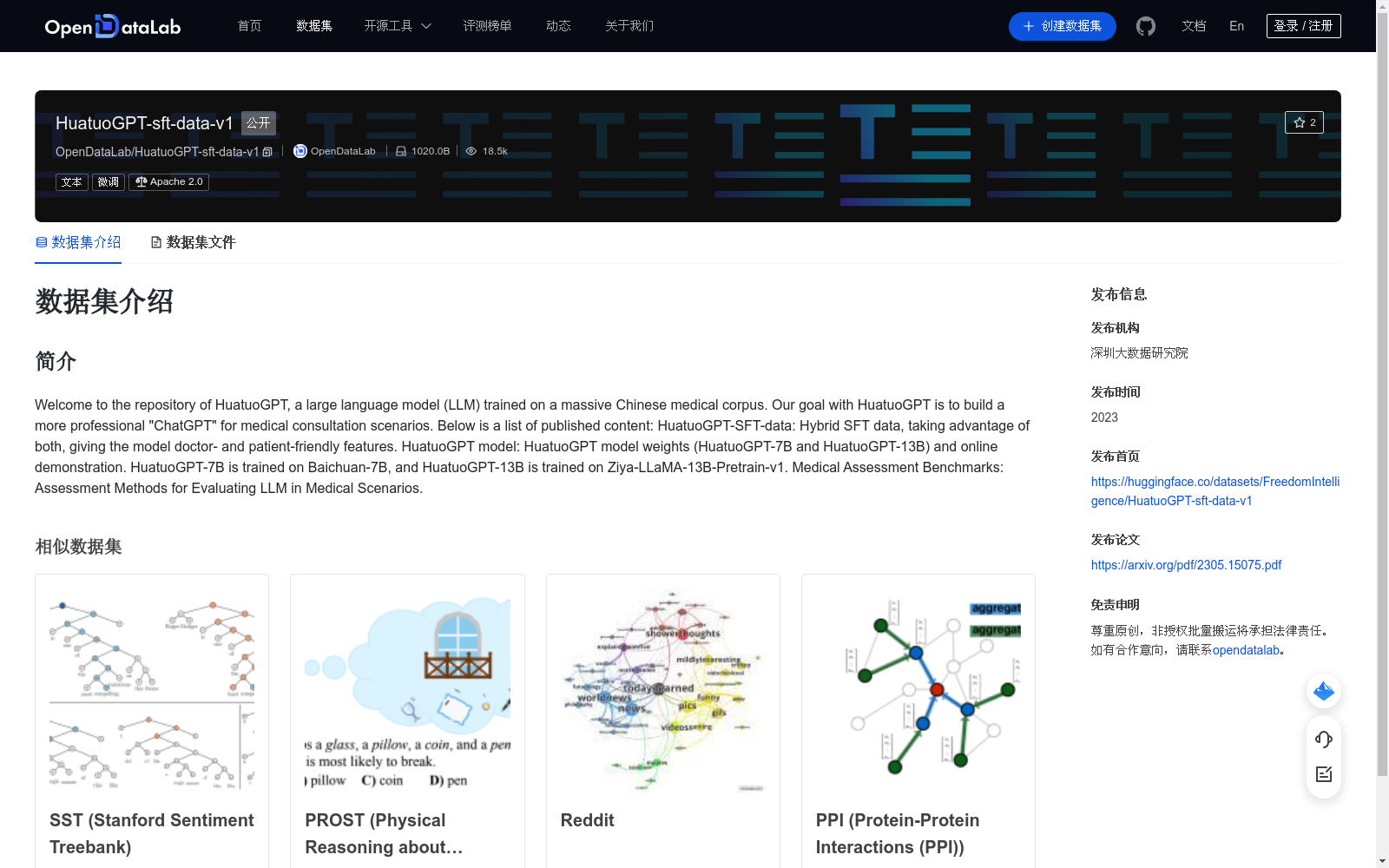

HuatuoGPT-sft-data-v1

收藏OpenDataLab2026-04-12 更新2024-05-09 收录

下载链接:

https://opendatalab.org.cn/OpenDataLab/HuatuoGPT-sft-data-v1

下载链接

链接失效反馈资源简介:

Welcome to the repository of HuatuoGPT, a large language model (LLM) trained on a massive Chinese medical corpus. Our goal with HuatuoGPT is to build a more professional "ChatGPT" for medical consultation scenarios.

Below is a list of published content:

HuatuoGPT-SFT-data: Hybrid SFT data, taking advantage of both, giving the model doctor- and patient-friendly features.

HuatuoGPT model: HuatuoGPT model weights (HuatuoGPT-7B and HuatuoGPT-13B) and online demonstration. HuatuoGPT-7B is trained on Baichuan-7B, and HuatuoGPT-13B is trained on Ziya-LLaMA-13B-Pretrain-v1.

Medical Assessment Benchmarks: Assessment Methods for Evaluating LLM in Medical Scenarios.

欢迎来到华佗GPT(HuatuoGPT)的开源仓库,该模型是基于大规模中文医学语料训练得到的大语言模型(Large Language Model,LLM)。华佗GPT的研发目标,是打造面向医疗咨询场景的专业化类ChatGPT工具。

以下为已公开的项目内容清单:

华佗GPT监督微调数据集(HuatuoGPT-SFT-data):采用混合式监督微调数据,兼具双重优势,可为模型赋予适配医患双方的交互特性。

华佗GPT模型(HuatuoGPT model):包含模型权重文件(HuatuoGPT-7B与HuatuoGPT-13B)以及在线演示工具。其中HuatuoGPT-7B基于Baichuan-7B基座训练得到,HuatuoGPT-13B则基于Ziya-LLaMA-13B-Pretrain-v1基座完成训练。

医学评估基准集(Medical Assessment Benchmarks):用于评估医疗场景下大语言模型的方法体系。

提供机构:

OpenDataLab

创建时间:

2023-12-06

搜集汇总

数据集介绍

以上内容由遇见数据集搜集并总结生成