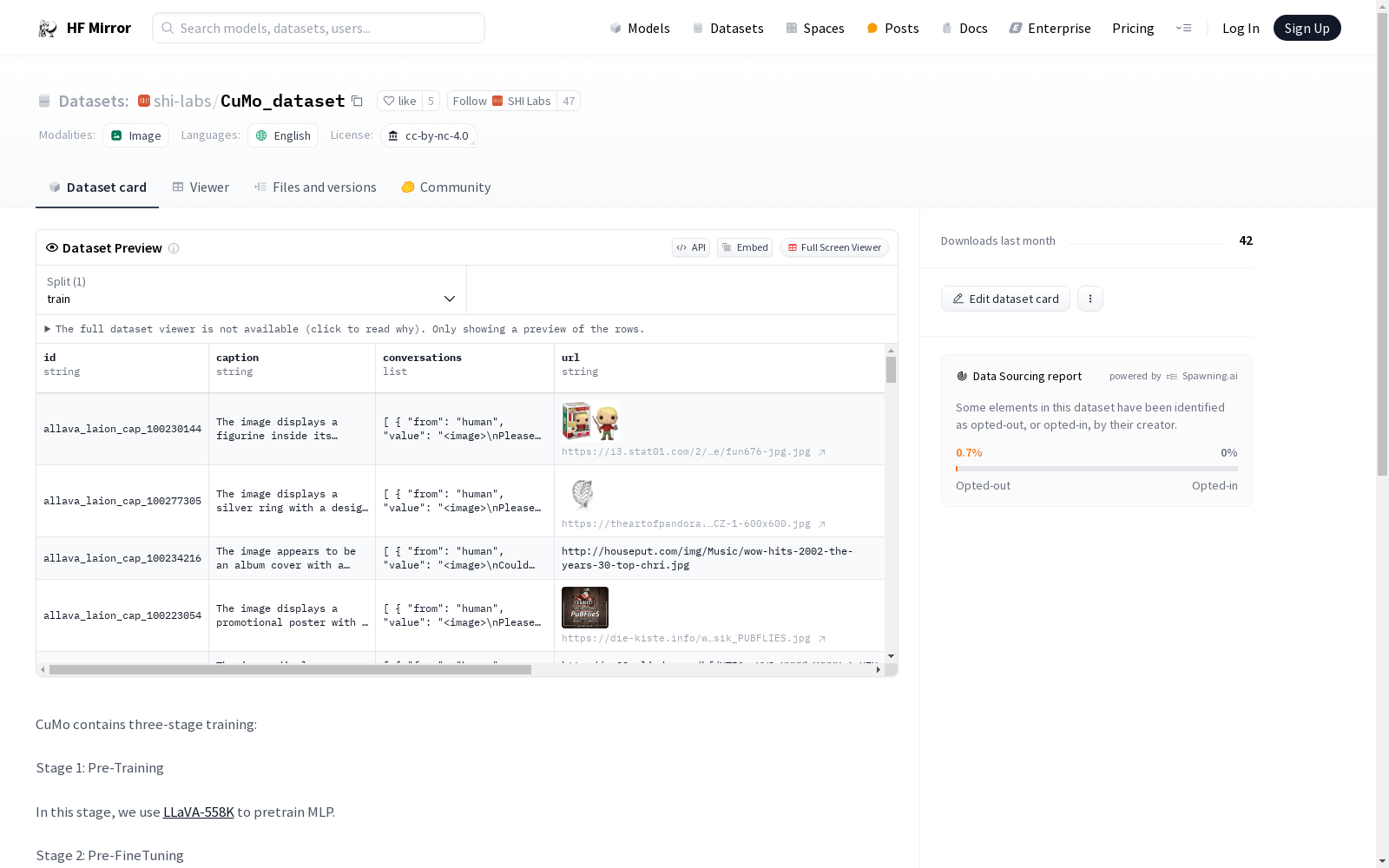

shi-labs/CuMo_dataset

收藏Hugging Face2024-05-06 更新2024-06-12 收录

下载链接:

https://hf-mirror.com/datasets/shi-labs/CuMo_dataset

下载链接

链接失效反馈资源简介:

---

license: cc-by-nc-4.0

language:

- en

---

CuMo contains three-stage training:

Stage 1: Pre-Training

In this stage, we use [LLaVA-558K](https://huggingface.co/datasets/liuhaotian/LLaVA-Pretrain) to pretrain MLP.

Stage 2: Pre-FineTuning

For pre-finetuning, we use the [ALLaVA](https://huggingface.co/datasets/FreedomIntelligence/ALLaVA-4V) caption data, you may use the original one or the cumo_pft_allava.json in this repo.

Stage 3: Visual Instruction Tuning

- [LLaVA-665K](https://huggingface.co/datasets/liuhaotian/LLaVA-Instruct-150K/blob/main/llava_v1_5_mix665k.json)

- [ShareGPT4V](https://sharegpt4v.github.io/)

- [LAION GPT4V](https://huggingface.co/datasets/laion/gpt4v-dataset)

- [DocVQA](https://www.docvqa.org/datasets/docvqa)

- [SynDog-EN](https://huggingface.co/datasets/naver-clova-ix/synthdog-en)

- [ChartQA](https://github.com/vis-nlp/ChartQA)

- [DVQA](https://github.com/kushalkafle/DVQA_dataset)

- [AI2D](https://allenai.org/data/diagrams)

- [InfoVQA](https://www.docvqa.org/datasets/infographicvqa)

- [ALLaVA](https://huggingface.co/datasets/FreedomIntelligence/ALLaVA-4V)

- [LIMA](https://huggingface.co/datasets/GAIR/lima)

Please download these datasets following the instructions and cumo_vit_1649K.json for visual instruction tuning.

CuMo utilizes these datasets that are subject to their respective original licenses. Users must comply with all terms and conditions specified in these original licenses.

许可证:cc-by-nc-4.0

语言:

- 英语(en)

CuMo 采用三阶段训练流程:

阶段1:预训练(Pre-Training)

本阶段使用[LLaVA-558K](https://huggingface.co/datasets/liuhaotian/LLaVA-Pretrain)数据集对多层感知机(MLP)进行预训练。

阶段2:预微调(Pre-FineTuning)

预微调阶段采用[ALLaVA](https://huggingface.co/datasets/FreedomIntelligence/ALLaVA-4V)字幕数据集,使用者可选择使用原始数据集,或是本仓库内的`cumo_pft_allava.json`文件。

阶段3:视觉指令微调(Visual Instruction Tuning)

- [LLaVA-665K](https://huggingface.co/datasets/liuhaotian/LLaVA-Instruct-150K/blob/main/llava_v1_5_mix665k.json)

- [ShareGPT4V](https://sharegpt4v.github.io/)

- [LAION GPT4V](https://huggingface.co/datasets/laion/gpt4v-dataset)

- [DocVQA](https://www.docvqa.org/datasets/docvqa)

- [SynDog-EN](https://huggingface.co/datasets/naver-clova-ix/synthdog-en)

- [ChartQA](https://github.com/vis-nlp/ChartQA)

- [DVQA](https://github.com/kushalkafle/DVQA_dataset)

- [AI2D](https://allenai.org/data/diagrams)

- [InfoVQA](https://www.docvqa.org/datasets/infographicvqa)

- [ALLaVA](https://huggingface.co/datasets/FreedomIntelligence/ALLaVA-4V)

- [LIMA](https://huggingface.co/datasets/GAIR/lima)

请按照相关说明下载上述数据集,以及用于视觉指令微调的`cumo_vit_1649K.json`文件。

CuMo 所使用的上述数据集均受其各自原始许可证条款约束,使用者必须严格遵守这些原始许可证中规定的全部条款与条件。

提供机构:

shi-labs

原始信息汇总

数据集概述

CuMo 数据集包含三个阶段的训练:

阶段 1:预训练

- 使用 LLaVA-558K 进行 MLP 的预训练。

阶段 2:预微调

- 使用 ALLaVA 的描述数据进行预微调,可以使用原始数据或本仓库中的 cumo_pft_allava.json。

阶段 3:视觉指令调优

- 使用以下数据集进行视觉指令调优:

请按照说明下载这些数据集,并使用 cumo_vit_1649K.json 进行视觉指令调优。

CuMo 利用的这些数据集受其各自原始许可证的约束。用户必须遵守这些原始许可证中规定的所有条款和条件。

AI搜集汇总

数据集介绍

构建方式

CuMo数据集的构建过程分为三个阶段。首先,在预训练阶段,利用LLaVA-558K数据集对多层感知器(MLP)进行预训练。其次,在预微调阶段,采用ALLaVA数据集的标注数据进行预微调,用户可选择使用原始数据或本仓库中的cumo_pft_allava.json文件。最后,在视觉指令调优阶段,整合了多个数据集,包括LLaVA-665K、ShareGPT4V、LAION GPT4V等,通过cumo_vit_1649K.json文件进行视觉指令调优。

使用方法

使用CuMo数据集时,用户需遵循各阶段的具体步骤。首先,下载并使用LLaVA-558K数据集进行预训练。接着,选择ALLaVA数据集或cumo_pft_allava.json文件进行预微调。最后,整合多个数据集,通过cumo_vit_1649K.json文件进行视觉指令调优。用户需确保遵守各数据集的原始许可协议,以符合法律和伦理要求。

背景与挑战

背景概述

CuMo数据集由Shi Labs团队创建,旨在通过多阶段的训练过程提升多模态学习模型的性能。该数据集的开发始于对现有数据集如LLaVA-558K和ALLaVA的预训练和微调,进一步整合了包括LLaVA-665K、ShareGPT4V、LAION GPT4V等在内的多个视觉指令调优数据集。CuMo的构建不仅涉及文本和图像数据的处理,还包括对复杂视觉信息的解析,如DocVQA、ChartQA等,这些数据集的应用显著增强了模型在多模态任务中的表现。CuMo的发布标志着在多模态学习领域的一次重要尝试,其对提升模型在视觉指令理解和生成方面的能力具有重要意义。

当前挑战

CuMo数据集的构建面临多重挑战。首先,整合来自不同数据集的数据需要解决数据格式和许可证的兼容性问题,确保所有数据的使用符合各自的原始许可证要求。其次,多阶段的训练过程要求高度的技术集成和数据管理能力,特别是在预训练和微调阶段,如何有效利用和优化这些数据资源是一个技术难题。此外,视觉指令调优阶段涉及的数据集如DocVQA和ChartQA等,其复杂性和多样性对模型的理解和生成能力提出了更高的要求,如何在保持数据多样性的同时确保模型性能的提升,是CuMo数据集面临的重要挑战。

常用场景

经典使用场景

在自然语言处理领域,CuMo数据集的经典使用场景主要体现在多阶段训练过程中。首先,通过预训练阶段使用LLaVA-558K数据集,CuMo能够有效地初始化多层感知器(MLP)。随后,在预微调阶段,利用ALLaVA数据集的标注数据进行进一步优化,确保模型在视觉指令调优前具备良好的基础性能。最后,通过整合LLaVA-665K、ShareGPT4V等多样化数据集,CuMo在视觉指令调优阶段实现了对复杂视觉信息的精准理解和响应。

解决学术问题

CuMo数据集在学术研究中解决了多模态数据融合与处理的难题。通过整合多种高质量数据集,如LLaVA-665K和ALLaVA,CuMo为研究者提供了一个全面的多模态学习平台,有助于推动视觉与语言模型的协同发展。此外,CuMo的多阶段训练策略也为解决模型泛化能力和鲁棒性问题提供了新的思路,对提升多模态AI系统的性能具有重要意义。

实际应用

CuMo数据集在实际应用中展现出广泛的应用潜力。例如,在智能客服系统中,CuMo能够通过理解用户提供的图文信息,提供更加精准和个性化的服务。在教育领域,CuMo可以用于开发智能教学助手,通过分析学生的学习材料和互动行为,提供定制化的学习建议。此外,CuMo在医疗影像分析、智能文档处理等领域也有着广泛的应用前景。

数据集最近研究

最新研究方向

在自然语言处理与计算机视觉交叉领域,CuMo数据集的最新研究方向聚焦于多阶段训练策略的优化与应用。该数据集通过预训练、预微调和视觉指令调优三个阶段,整合了多种高质量数据源,如LLaVA-558K、ALLaVA、ShareGPT4V等,旨在提升多模态模型的性能。这一研究方向不仅推动了多模态学习技术的发展,还为跨领域应用提供了新的可能性,特别是在视觉问答、文档理解等前沿任务中展现出显著的应用潜力。

以上内容由AI搜集并总结生成