Neurosync_Audio2Face_Dataset

收藏github2025-02-16 更新2025-02-14 收录

下载链接:

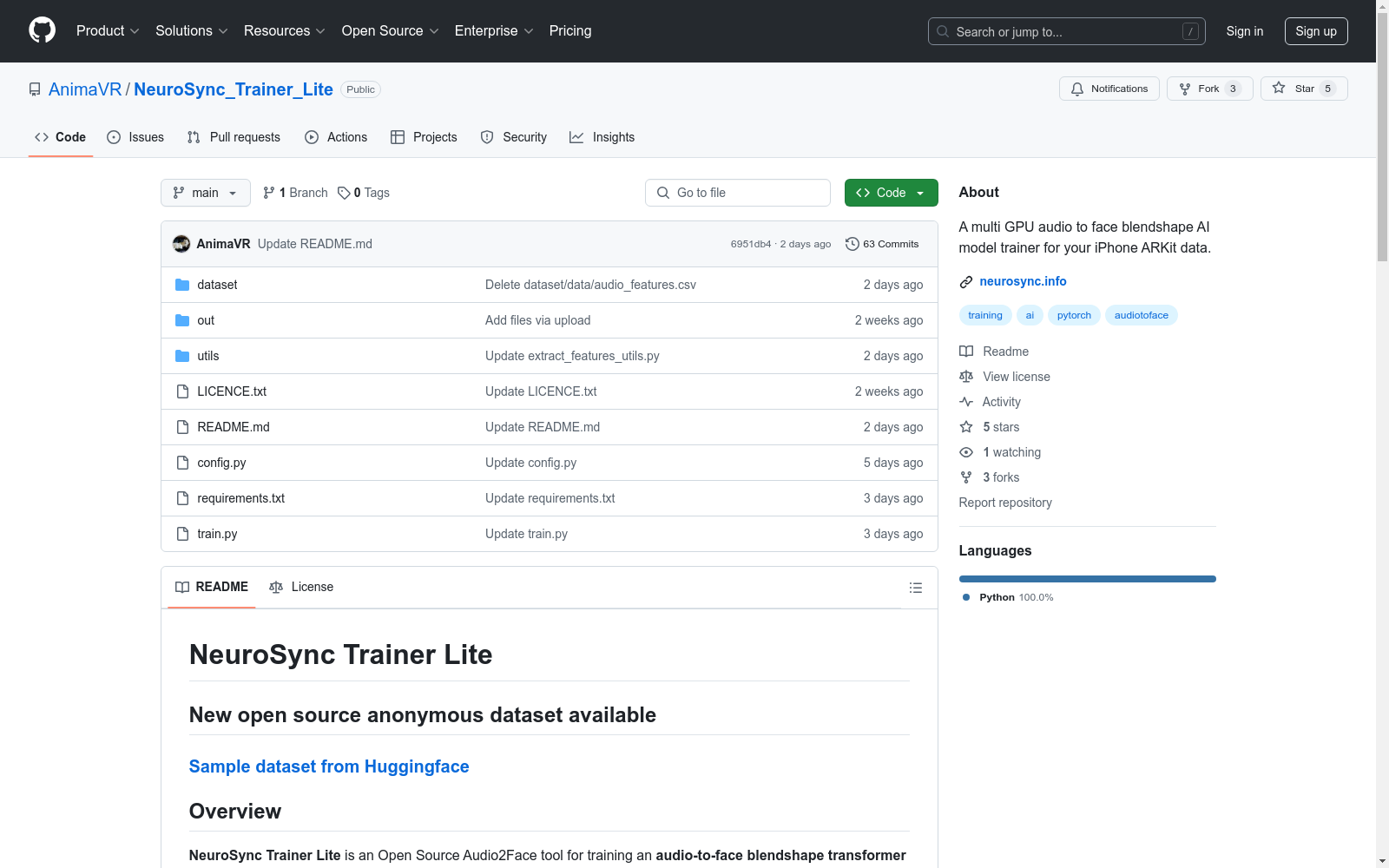

https://github.com/AnimaVR/NeuroSync_Trainer_Lite

下载链接

链接失效反馈资源简介:

这是一个用于训练音频到面部表情转换模型的开源匿名数据集,适用于实时应用如虚拟化身、游戏角色和动画管道。

This is an open-source anonymized dataset for training audio-to-facial expression conversion models, suitable for real-time applications such as virtual avatars, game characters, and animation pipelines.

创建时间:

2025-01-31

原始信息汇总

NeuroSync Trainer Lite 数据集概述

数据集简介

- 数据集名称:NeuroSync Trainer Lite

- 数据集类型:音频驱动的面部动画数据集

- 应用场景:虚拟头像、游戏角色、动画管线等实时应用

- 数据集来源:Huggingface

特征

- 音频驱动的面部动画:基于音频输入生成逼真的面部混合形状动画

- 多GPU支持:支持使用多达4个GPU进行高效训练

- 与Unreal Engine集成:通过NeuroSync Local API和NeuroSync Player将训练后的动画数据发送至Unreal Engine

- 优化iPhone面部数据:轻松处理来自iPhone的面部运动捕捉数据

快速开始

- 安装依赖:Python 3.9+、CUDA支持的PyTorch、NumPy、Pandas、Librosa、OpenCV、Matplotlib等库

- 数据收集与准备:需要音频和校准后的面部混合形状数据,使用iPhone和LiveLink应用记录数据,确保至少30分钟的数据量

- 模型训练:准备就绪后,通过运行

python train.py开始训练

多GPU训练

- 修改

config.py文件,设置use_multi_gpu = True和定义GPU数量,最高支持4个GPU

使用NeuroSync模型

- 生成音频对应的面部混合形状并发送到Unreal Engine需要使用NeuroSync Local API和NeuroSync Player

许可

- 对于年收入低于$1M的个人和企业,遵循MIT许可,可免费使用、修改、分发和集成软件

- 对于年收入$1M或以上的企业,需获取商业许可

版权

- 版权所有 © 2025 NeuroSync Trainer Lite

搜集汇总

数据集介绍

构建方式

Neurosync_Audio2Face_Dataset 数据集的构建采取开源方式,旨在训练音频驱动的面部动画转换模型。数据集通过收集并校准iPhone的ARKit Blendshapes面部运动捕捉数据与对应音频数据,经过处理后形成可用于模型训练的数据对,支持多GPU加速训练,以实现高效的数据处理和模型训练。

特点

该数据集具备以下显著特点:支持音频驱动的面部动画,能够生成逼真的面部表情动画;具备多GPU训练支持,提升训练效率;与Unreal Engine兼容,便于将训练后的动画数据应用于虚拟角色和动画制作;针对iPhone面部数据进行了优化处理,简化数据采集流程。

使用方法

使用该数据集首先需要安装相关依赖,包括Python 3.9+、CUDA支持的PyTorch、NumPy等库,以及FFMPEG工具。随后,通过iPhone和LiveLink应用记录面部和音频数据,并按照指定格式整理至数据集文件夹中。数据准备完成后,可通过运行train.py脚本来训练模型。对于多GPU训练,需在配置文件中设置相关参数。训练完成后,可通过NeuroSync Local API和NeuroSync Player将生成的面部动画数据实时传输至Unreal Engine或其他兼容LiveLink的软件。

背景与挑战

背景概述

Neurosync_Audio2Face_Dataset是一个开源的数据集,由AnimaVR团队创建,旨在为音频驱动的面部动画提供训练数据。该数据集的创建,响应了虚拟现实、游戏以及动画领域中,对真实面部动画的强烈需求。自发布以来,它为研究人员和开发者提供了一个重要的资源,以训练音频到面部混合变形转换模型,进而生成逼真的面部动画。该数据集的构建时间为近年来,且与NeuroSync Trainer Lite工具紧密结合,后者是一个用于训练音频到面部混合变形转换模型的工具,支持多GPU训练,并能与Unreal Engine集成,优化了iPhone面部数据的处理。这一数据集的问世,对推动相关领域的技术进步和创新发展具有重要影响力。

当前挑战

尽管Neurosync_Audio2Face_Dataset为面部动画领域提供了宝贵的资源,但在使用该数据集时也面临一些挑战。首先,数据集的构建过程中,对iPhone面部数据的优化要求较高的数据质量和校准精度,这对数据采集提出了挑战。其次,为了训练一个通用的模型,需要大量的数据,例如,八个声道的30分钟数据可能需要256GB的系统内存,这对硬件资源提出了较高的要求。此外,数据集在音频质量上的要求,也对数据预处理和音频同步提出了挑战。这些挑战需要研究人员和开发者具备相应的技术能力和资源,才能充分利用这一数据集进行研究和开发。

常用场景

经典使用场景

在虚拟现实与动画制作领域,Neurosync_Audio2Face_Dataset数据集的典型应用场景在于,通过音频输入生成逼真的面部动画。该数据集支持训练音频驱动的面部动画转换模型,进而实现虚拟角色、游戏角色以及动画渲染流程中的实时面部动画生成。

衍生相关工作

基于Neurosync_Audio2Face_Dataset数据集,研究者们已衍生出多项相关工作,包括改进模型结构以提升动画质量,开发新型面部捕捉技术,以及将模型应用于更多元化的虚拟交互场景中,进一步拓宽了数据集的应用范围和影响力。

数据集最近研究

最新研究方向

NeuroSync_Audio2Face_Dataset 数据集近期研究方向主要聚焦于音频驱动的面部动画技术。该技术通过训练音频到面部混合变形转换模型,实现从音频输入生成逼真的面部动画,广泛应用于虚拟角色、游戏角色以及动画制作流程中。研究者们正致力于优化模型训练效率,实现多GPU并行训练,并探索与虚幻引擎的无缝集成,以提升实时面部动画生成的效果和适用性。此外,该数据集针对iPhone面部数据进行了优化,使得从移动设备收集的数据能够得到更有效的利用,为相关领域的研究提供了重要支撑。

以上内容由遇见数据集搜集并总结生成