JAAD

收藏github2024-05-16 更新2024-05-31 收录

下载链接:

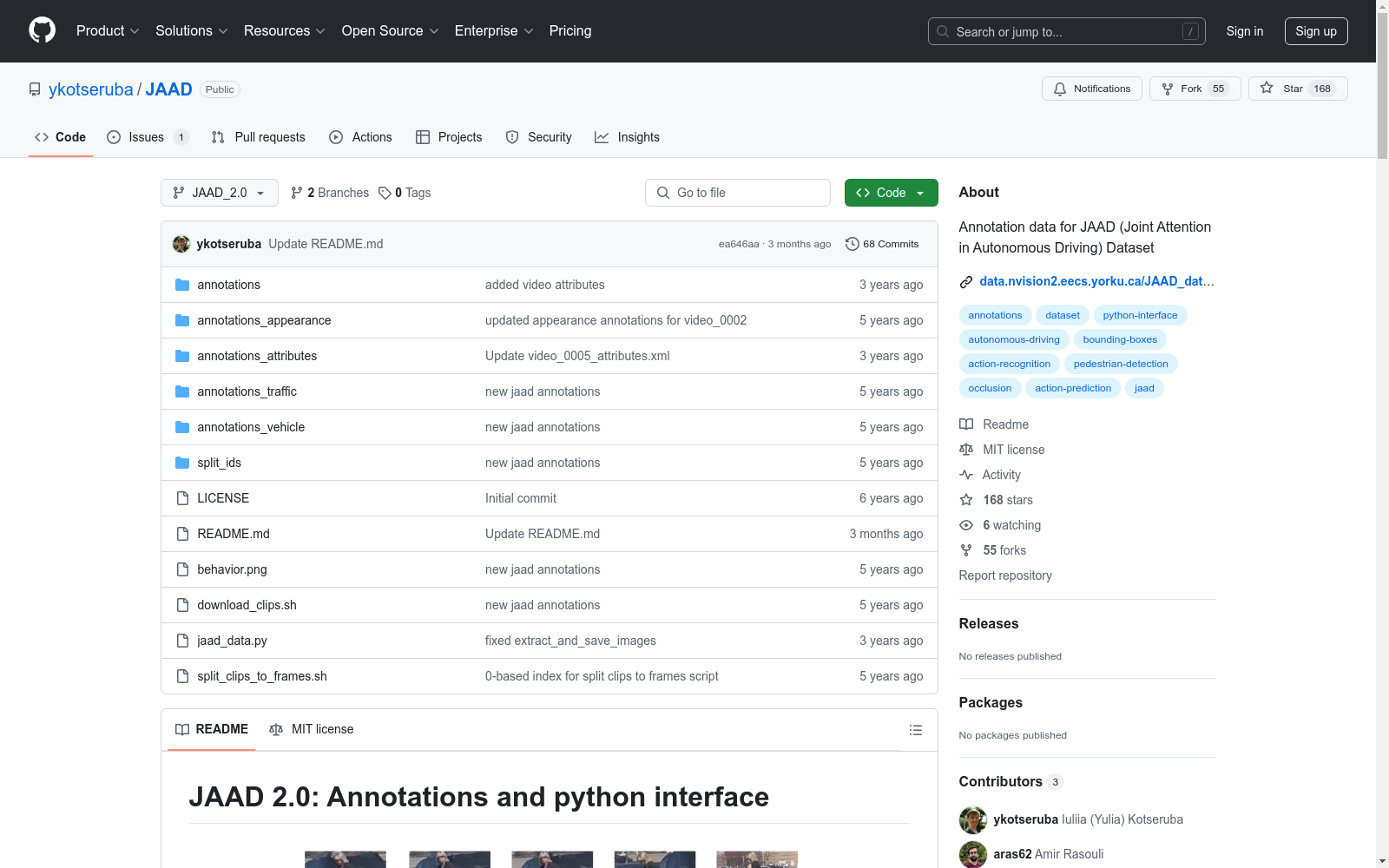

https://github.com/ykotseruba/JAAD_dataset

下载链接

链接失效反馈资源简介:

JAAD数据集专注于自动驾驶中的联合注意力,包含346个视频片段,每个片段都有详细的注释,包括行人的行为、外观、交通和车辆信息等。数据集用于研究自动驾驶系统中对行人行为的理解和预测。

The JAAD dataset focuses on joint attention in autonomous driving, comprising 346 video clips, each annotated with detailed information including pedestrian behavior, appearance, traffic, and vehicle information. This dataset is utilized for research on understanding and predicting pedestrian behavior in autonomous driving systems.

创建时间:

2018-03-06

原始信息汇总

数据集概述

数据集名称

JAAD 2.0: Annotations and python interface

数据集内容

- Annotations: 包含视频属性(时间、天气、位置)、行人边界框坐标、遮挡信息和活动(如行走、观看)。活动仅针对部分行人提供。

- Attributes: 仅针对有行为注释的行人,包括行人的人口统计信息、穿越点、穿越特征等。

- Appearance: 仅针对高可见度视频,包括行人外观信息,如姿态、服装、携带物品。

- Traffic: 提供每帧的交通信息,如标志、交通灯。

- Vehicle: 提供每帧的车辆动作,如快速移动、加速。

视频剪辑

- 数量: 346个视频剪辑

- 存储: 应下载并放置在

JAAD_clips文件夹中,格式为JAAD_clips/video_0001.mp4等。

接口

- 依赖: Python 3.5及以下库:opencv-python, numpy, scikit-learn。

- 功能:

- 提取图像: 使用

split_clips_to_frames.sh脚本或接口将视频剪辑转换为图像。 - 使用接口: 通过配置参数(如

fstride,sample_type,subset等)进行数据提取和分析。

- 提取图像: 使用

注释格式

- 组织: 根据视频剪辑名称组织。

- 类型: 行人(有行为注释的样本)、peds(远离且不与驾驶员互动的旁观者)、people(一组行人)。

- ID格式:

0_<video_id>_< pedestrian_number>[b/p],其中b表示有行为注释,p表示一组行人。 - 边界框: 使用两点坐标(左上角、右下角)

[x1, y1, x2, y2]。 - 遮挡标签: 0(无遮挡)、1(部分遮挡>25%)、2(完全遮挡>75%)。

下载链接

- 视频剪辑: YorkU服务器 | Google Drive

搜集汇总

数据集介绍

构建方式

JAAD数据集的构建基于对346个视频片段的详细标注,这些视频片段涵盖了自动驾驶场景中的行人行为。标注内容包括行人的边界框坐标、遮挡信息、活动状态(如行走、观察)以及视频属性(如时间、天气、地点)。此外,还提供了行人的外观特征、交通信息和车辆动作的标注。这些标注以XML格式存储,并通过一个新引入的Python接口进行访问和处理。

特点

JAAD数据集的显著特点在于其丰富的标注内容和多层次的信息结构。数据集不仅包含了行人的基本行为和外观特征,还提供了交通和车辆动作的详细信息,这为研究自动驾驶中的行人行为提供了全面的数据支持。此外,数据集的标注方式灵活,支持多种数据提取和分析方法,如序列分析和检测数据生成。

使用方法

使用JAAD数据集时,首先需要下载视频片段并将其转换为图像格式。通过Python接口,用户可以方便地提取和保存图像,并生成包含所有标注信息的字典数据库。接口提供了多种配置参数,如采样类型、数据分割方式和序列类型,用户可以根据研究需求灵活调整。此外,接口还支持自定义数据生成器和检测数据生成,极大地扩展了数据集的应用范围。

背景与挑战

背景概述

JAAD数据集,全称为Joint Attention in Autonomous Driving,由约克大学(York University)的Amir Rasouli、Iuliia Kotseruba和John K. Tsotsos等人创建。该数据集专注于自动驾驶领域中的行人行为分析,特别是行人与车辆之间的交互行为。JAAD数据集的核心研究问题是如何准确预测行人的过街意图,这对于提高自动驾驶系统的安全性和可靠性至关重要。该数据集的发布填补了自动驾驶领域在行人行为预测方面的数据空白,为相关研究提供了宝贵的资源。

当前挑战

JAAD数据集在构建过程中面临多项挑战。首先,行人行为的多样性和复杂性使得数据标注变得异常困难,尤其是在处理不同天气、时间和地点的场景时。其次,数据集需要处理大量的视频片段,并从中提取关键帧和行人信息,这对数据处理和存储技术提出了高要求。此外,JAAD数据集还需要解决行人遮挡、光照变化等实际场景中的常见问题,以确保标注的准确性和可靠性。这些挑战不仅影响了数据集的构建效率,也对后续的模型训练和验证提出了更高的要求。

常用场景

经典使用场景

JAAD数据集在自动驾驶领域中被广泛用于行人行为分析。其经典使用场景包括行人检测、行为预测和交互行为识别。通过分析视频片段中的行人轨迹、姿态和动作,研究人员可以构建模型来预测行人的未来行为,从而提高自动驾驶系统的安全性和可靠性。

衍生相关工作

JAAD数据集的发布催生了一系列相关研究工作。例如,基于该数据集的行人行为预测模型已被广泛应用于自动驾驶系统的开发中。此外,研究人员还利用JAAD数据集进行行人检测算法的改进和优化,进一步提升了自动驾驶系统的性能。这些衍生工作不仅丰富了自动驾驶领域的研究内容,还推动了相关技术的实际应用。

数据集最近研究

最新研究方向

在自动驾驶领域,JAAD数据集的最新研究方向主要集中在行人行为预测和交互分析上。随着自动驾驶技术的快速发展,准确预测行人的行为对于确保行车安全至关重要。JAAD数据集通过提供详细的行人行为注释,包括行走、观察等动作,以及行人的遮挡情况和活动特征,为研究人员提供了丰富的数据资源。这些注释不仅有助于开发更精确的行人检测算法,还能推动行人意图预测模型的进步。此外,JAAD数据集的Python接口使得数据处理和分析更加便捷,促进了跨学科研究的发展,特别是在计算机视觉和机器学习领域。通过这些研究,JAAD数据集为提升自动驾驶系统的安全性和可靠性提供了重要的数据支持。

以上内容由遇见数据集搜集并总结生成