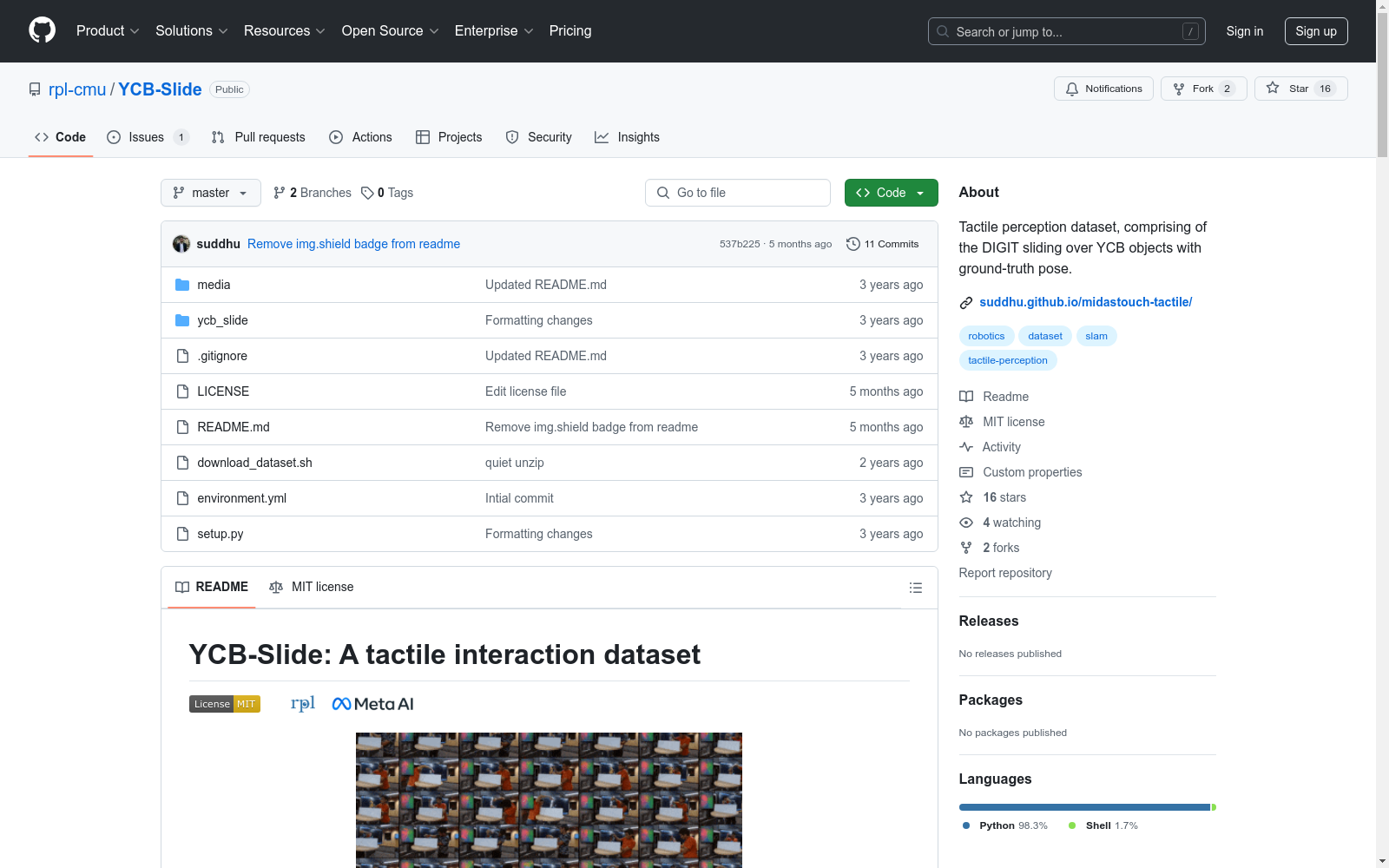

YCB-Slide|触觉感知数据集|机器人技术数据集

收藏YCB-Slide 数据集概述

数据集简介

- 名称:YCB-Slide

- 简介:YCB-Slide 是一个关于触觉交互的数据集,包含 DIGIT 滑动交互在 YCB 对象上的数据。数据集提供了 DIGIT 图像、传感器姿态、RGB 视频馈送、地面真实网格模型以及地面真实高度图和接触掩码(仅限模拟)。

数据集构成

- YCB 对象:选择了 10 种具有不同几何形状的 YCB 对象进行测试。

- 模拟数据:使用 TACTO 模拟滑动物理交互,生成固定长度的路径,并添加高斯噪声。

- 真实世界数据:通过手持 DIGIT 进行滑动实验,使用 OptiTrack 系统进行时间同步的传感器姿态记录。

数据目录格式

- 模拟:包含接触掩码、深度图、RGB DIGIT 图像等文件夹。

- 真实世界:包含 DIGIT 图像、Webcam 图像、姿态信息、视频文件等文件夹。

数据获取

- 下载脚本:通过

download_dataset.sh脚本下载,需要先运行pip install gdown。 - 单独对象数据:可以直接下载特定对象的数据。

许可

- 许可证:MIT License

引用

- 论文引用:在使用 YCB-Slide 数据集的研究中,请引用相关论文。

YCB-Slide 数据集概述

数据集简介

- 名称:YCB-Slide

- 简介:YCB-Slide 是一个关于触觉交互的数据集,包含 DIGIT 滑动交互在 YCB 对象上的数据。数据集提供了 DIGIT 图像、传感器姿态、RGB 视频馈送、地面真实网格模型以及地面真实高度图和接触掩码(仅限模拟)。

数据集构成

- YCB 对象:选择了 10 种具有不同几何形状的 YCB 对象进行测试。

- 模拟数据:使用 TACTO 模拟滑动物理交互,生成固定长度的路径,并添加高斯噪声。

- 真实世界数据:通过手持 DIGIT 进行滑动实验,使用 OptiTrack 系统进行时间同步的传感器姿态记录。

数据目录格式

- 模拟:包含接触掩码、深度图、RGB DIGIT 图像等文件夹。

- 真实世界:包含 DIGIT 图像、Webcam 图像、姿态信息、视频文件等文件夹。

数据获取

- 下载脚本:通过

download_dataset.sh脚本下载,需要先运行pip install gdown。 - 单独对象数据:可以直接下载特定对象的数据。

许可

- 许可证:MIT License

引用

- 论文引用:在使用 YCB-Slide 数据集的研究中,请引用相关论文。

FER2013

FER2013数据集是一个广泛用于面部表情识别领域的数据集,包含28,709个训练样本和7,178个测试样本。图像属性为48x48像素,标签包括愤怒、厌恶、恐惧、快乐、悲伤、惊讶和中性。

github 收录

1963-2015年中国主要木本植物春季物候(展叶和开花始期)格网数据产品(V1)

中国物候观测网1963–2015年白蜡、垂柳、刺槐、合欢、桑树、榆树、杏树、紫荆、紫丁香和加拿大杨10种木本植物的展叶始期和开花始期格网数据,时间分辨率为逐年,空间分辨率为0.5°×0.5°。数据集组成包括:(1)数据头文件,内含物种物候期和分布范围格网的头文件信息;(2)物种物候期,内含每个物种展叶始期和开花始期1963–2015年的逐年文件;(3)物种分布范围,内含每个物种的实际分布范围格网。

地球大数据科学工程 收录

中国食物成分数据库

食物成分数据比较准确而详细地描述农作物、水产类、畜禽肉类等人类赖以生存的基本食物的品质和营养成分含量。它是一个重要的我国公共卫生数据和营养信息资源,是提供人类基本需求和基本社会保障的先决条件;也是一个国家制定相关法规标准、实施有关营养政策、开展食品贸易和进行营养健康教育的基础,兼具学术、经济、社会等多种价值。 本数据集收录了基于2002年食物成分表的1506条食物的31项营养成分(含胆固醇)数据,657条食物的18种氨基酸数据、441条食物的32种脂肪酸数据、130条食物的碘数据、114条食物的大豆异黄酮数据。

国家人口健康科学数据中心 收录

LEVIR-CD

LEVIR-CD 是一个新的大规模遥感建筑变化检测数据集。引入的数据集将成为评估变化检测 (CD) 算法的新基准,尤其是基于深度学习的算法。 LEVIR-CD 由 637 个非常高分辨率(VHR,0.5m/像素)Google Earth (GE) 图像块对组成,大小为 1024 × 1024 像素。这些时间跨度为 5 到 14 年的双时相图像具有显着的土地利用变化,尤其是建筑增长。 LEVIR-CD涵盖别墅住宅、高层公寓、小型车库和大型仓库等各类建筑。在这里,我们关注与建筑相关的变化,包括建筑增长(从土壤/草地/硬化地面或在建建筑到新建筑区域的变化)和建筑衰退。这些双时相图像由遥感图像解释专家使用二进制标签(1 表示变化,0 表示不变)进行注释。我们数据集中的每个样本都由一个注释器进行注释,然后由另一个注释器进行双重检查以产生高质量的注释。完整注释的 LEVIR-CD 总共包含 31,333 个单独的变更构建实例。

OpenDataLab 收录

HazyDet

HazyDet是由解放军工程大学等机构创建的一个大规模数据集,专门用于雾霾场景下的无人机视角物体检测。该数据集包含383,000个真实世界实例,收集自自然雾霾环境和正常场景中人工添加的雾霾效果,以模拟恶劣天气条件。数据集的创建过程结合了深度估计和大气散射模型,确保了数据的真实性和多样性。HazyDet主要应用于无人机在恶劣天气条件下的物体检测,旨在提高无人机在复杂环境中的感知能力。

arXiv 收录