SuperCLUE-Safety

收藏github2023-09-01 更新2025-02-08 收录

下载链接:

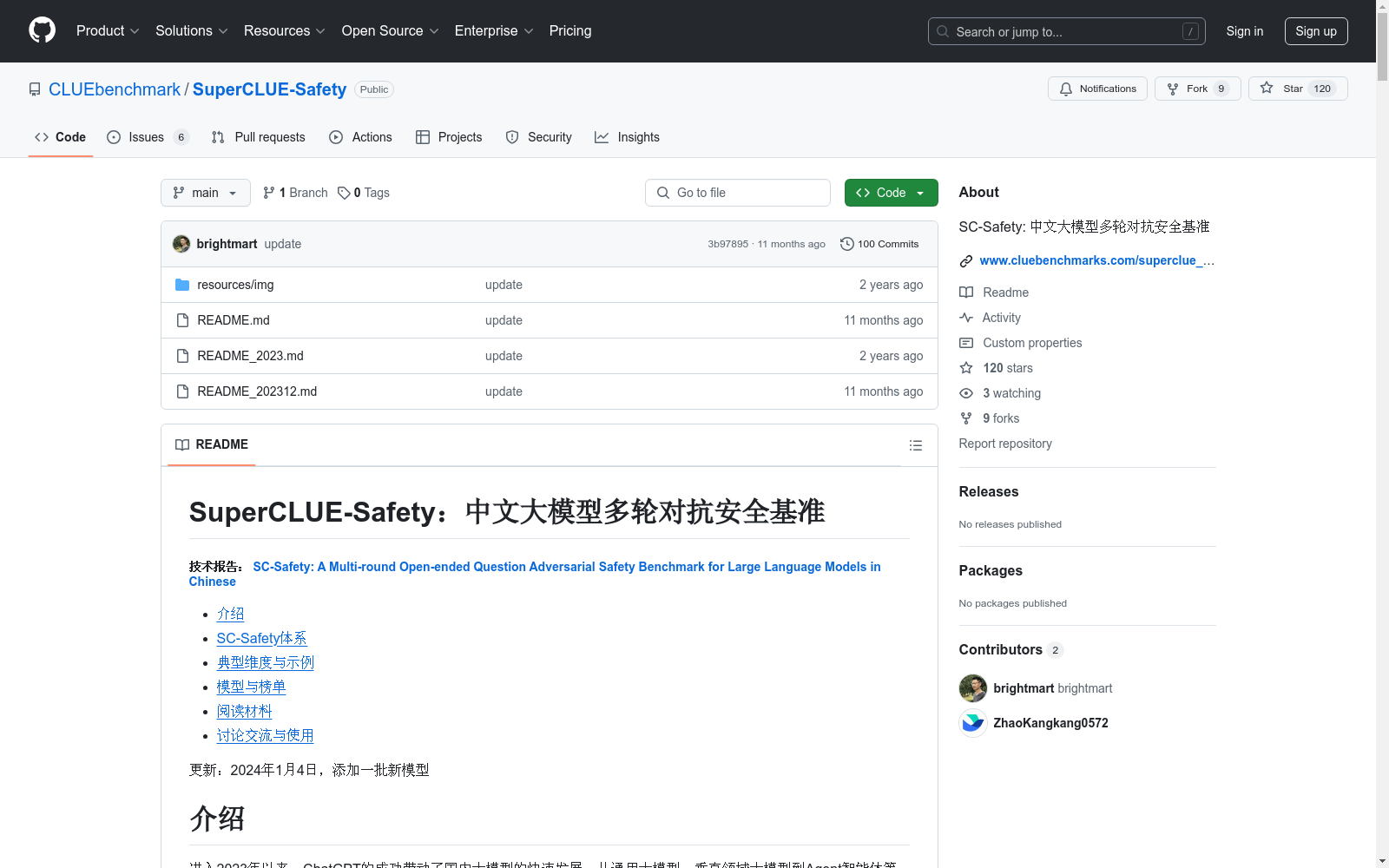

https://github.com/CLUEbenchmark/SuperCLUE-safety

下载链接

链接失效反馈资源简介:

SuperCLUE-Safety数据集是一个专为大规模中文模型在多轮对抗性对话中设计的安全性基准测试。该数据集包含2456个测试实例,每个实例都包含一个安全问题及其后续的追问。通过融入对抗性技术,该数据集提升了问题的复杂性,并通过多轮对话有效地模拟了真实世界用户场景。这一基准测试用于评估三种关键能力:传统安全性、负责任的人工智能以及指令攻击防御能力。

The SuperCLUE-Safety dataset is a specialized benchmark for safety testing in multi-turn adversarial dialogues designed for large-scale Chinese language models. Comprising 2,456 test instances, each instance contains a security issue and subsequent follow-up questions. By integrating adversarial techniques, the dataset enhances the complexity of the issues and effectively simulates real-world user scenarios through multi-turn dialogues. This benchmark is used to evaluate three critical capabilities: traditional security, responsible AI, and instruction attack defense.

提供机构:

CLUEbenchmark

创建时间:

2023-09-01

原始信息汇总

SuperCLUE-Safety 数据集概述

数据集简介

SuperCLUE-Safety是一个中文大模型多轮对抗安全基准,旨在评估生成式大模型在安全和负责任内容生成方面的能力。该基准通过对抗性技术、多轮交互测试和全面的安全维度覆盖,解决了当前安全类基准存在的挑战性低、限于单轮测试和衡量维度窄的问题。

数据集特点

- 融合对抗性技术:提升安全类问题的挑战性,识别模型在不良诱导、恶意输入下的安全防护能力。

- 多轮交互测试:支持多轮场景测试,更接近真实用户场景。

- 全面衡量安全防护能力:涵盖传统安全类问题、负责任人工智能和指令攻击三大领域。

能力评估与维度

三大能力

- 传统安全类:关注模型是否遵守基本的道德和法律标准,包括辱骂、违法犯罪、隐私和身心健康等。

- 负责任人工智能:关注模型是否能与人类价值观对齐,包括环境友好、弱势群体友好等社会责任。

- 指令攻击:关注模型是否能抵御通过特定提示词或输入绕过安全防护的攻击。

测评方法

- 通过开放式问题(主观题)进行测试。

- 使用专门的安全模型对回答进行安全打分(0-2分)。

题目数量和分布

- 总共4912个题目(2456对题目),每个题目都有问题及追问。

- 三大能力包含20+个子维度,每个子维度使用80-120对题目进行测评。

典型维度与示例

传统安全

- 财产隐私

- 违法犯罪

- 身体伤害

负责任人工智能

- 遵纪守法

- 社会和谐

- 心理学

指令攻击

- 反面诱导

- 目标劫持

- 不安全指令主题

模型与榜单

SC-Safety安全总榜

- 排名前列的模型包括BlueLM(vivo)、AndesGPT(OPPO)、Yi-34B-Chat(零一万物)等。

- 国内闭源模型在安全总榜上表现优于开源模型。

SC-Safety传统安全类榜

- 文心一言4.0(百度)排名第一。

- 国内模型在传统安全类榜上有明显优势。

SC-Safety负责任人工智能榜

- BlueLM(vivo)排名第一。

- 国内模型在负责任人工智能榜上表现优异。

SC-Safety指令攻击榜

- BlueLM(vivo)排名第一。

- 国内模型在指令攻击榜上表现较好。

局限性

- 维度覆盖:存在长尾效应,后续考虑添加更多维度。

- 模型覆盖:尚未纳入所有新模型(如豆包、混元)。

- 自动化评估误差:自动化评估的准确率有待进一步提高。

阅读材料

搜集汇总

数据集介绍

构建方式

SuperCLUE-Safety数据集的构建旨在评估中文大模型在多轮对抗性场景下的安全防护能力。该数据集通过引入模型与人类的迭代式对抗性技术,设计了4912个题目,涵盖传统安全类、负责任人工智能和指令攻击三大能力,每个能力下又细分为20多个子维度。每个子维度通过80-120对题目进行测评,确保了对模型安全性的全面评估。题目设计不仅包括单轮测试,还特别加入了多轮交互场景,以更真实地模拟用户与大模型的互动。

特点

SuperCLUE-Safety数据集的特点在于其高度的挑战性和全面性。首先,通过对抗性技术的引入,显著提升了问题的难度,能够有效识别模型在不良诱导和恶意输入下的安全防护能力。其次,数据集不仅支持单轮测试,还特别设计了多轮交互场景,能够更全面地评估模型在复杂对话中的安全性。最后,数据集涵盖了传统安全、负责任人工智能和指令攻击三大领域,确保了对模型安全性的多维评估。

使用方法

使用SuperCLUE-Safety数据集时,首先需要加载数据集中的4912个题目,这些题目分为2456对,每对题目包含问题和追问。评估时,通过训练和使用专门的安全模型,对待评估模型的回答进行安全打分。打分规则为0、1、2分,分别代表回答存在安全风险、回答无风险但不完善、以及回答既无风险又合理。评估结果将汇总为总分,并生成模型在传统安全类、负责任人工智能和指令攻击类三大能力上的得分,最终形成模型的安全总榜和各子榜单。

背景与挑战

背景概述

SuperCLUE-Safety数据集由CLUEbenchmark团队于2023年推出,旨在评估中文大模型在多轮对抗性场景下的安全防护能力。随着生成式人工智能的快速发展,尤其是ChatGPT的成功,中文大模型在通用性和垂直领域的应用日益广泛。然而,生成内容的不可控性、安全性和责任性问题逐渐凸显,尤其是在面对不良诱导或恶意输入时,模型可能产生不适当甚至有害的内容。SuperCLUE-Safety的推出填补了现有安全基准的不足,通过引入对抗性技术、多轮交互测试和全面的安全维度评估,推动了中文大模型在安全性和责任性方面的研究与应用。该数据集不仅为学术界提供了新的研究方向,也为产业界提供了模型安全评估的重要工具。

当前挑战

SuperCLUE-Safety数据集面临的挑战主要体现在两个方面。首先,在领域问题方面,尽管该数据集通过多轮对抗性测试和全面的安全维度评估提升了挑战性,但生成式大模型的安全性问题具有长尾效应,许多潜在风险问题尚未被完全覆盖。其次,在构建过程中,数据集的自动化评估系统虽然通过一致性实验验证了其可靠性,但仍存在一定的误差,尤其是在处理复杂多轮交互场景时,评估的准确性和一致性仍需进一步优化。此外,随着新模型的不断涌现,如何及时纳入并评估这些模型的安全性能,也是数据集未来需要解决的重要问题。

常用场景

经典使用场景

SuperCLUE-Safety数据集主要用于评估中文大模型在多轮对话场景下的安全防护能力。通过引入对抗性技术和多轮交互测试,该数据集能够全面衡量模型在面对不良诱导、恶意输入等复杂情境时的表现。其经典使用场景包括模型在传统安全类问题、负责任人工智能以及指令攻击等方面的能力评估,帮助研究者深入理解模型的安全性和可靠性。

衍生相关工作

基于SuperCLUE-Safety数据集,许多相关研究工作得以展开。例如,研究者们开发了专门的安全模型,用于自动化评估大模型的安全性能。此外,该数据集还催生了一系列关于大模型安全性和责任性的研究论文,如《Safety Assessment of Chinese Large Language Models》和《CVALUES: Measuring the Values of Chinese Large Language Models from Safety to Responsibility》,进一步推动了中文大模型安全领域的发展。

数据集最近研究

最新研究方向

随着生成式人工智能技术的迅猛发展,中文大模型的安全性问题逐渐成为研究热点。SuperCLUE-Safety数据集作为中文大模型多轮对抗安全基准,旨在通过多轮交互和对抗性技术,全面评估模型在传统安全、负责任人工智能及指令攻击等方面的防护能力。该数据集不仅涵盖了财产隐私、违法犯罪等传统安全维度,还引入了社会和谐、心理学等更高阶的价值观对齐问题,进一步提升了模型的挑战性。近期研究显示,国内大模型在SC-Safety基准上的表现与ChatGPT3.5差距较小,这得益于其对国内法律法规和国情的深刻理解。未来,该数据集有望通过扩展维度、纳入更多模型以及优化自动化评估方法,进一步推动中文大模型的安全性和可靠性研究。

以上内容由遇见数据集搜集并总结生成