Faces in Things

收藏arXiv2024-09-24 更新2024-09-26 收录

下载链接:

https://aka.ms/faces-in-things

下载链接

链接失效反馈官方服务:

资源简介:

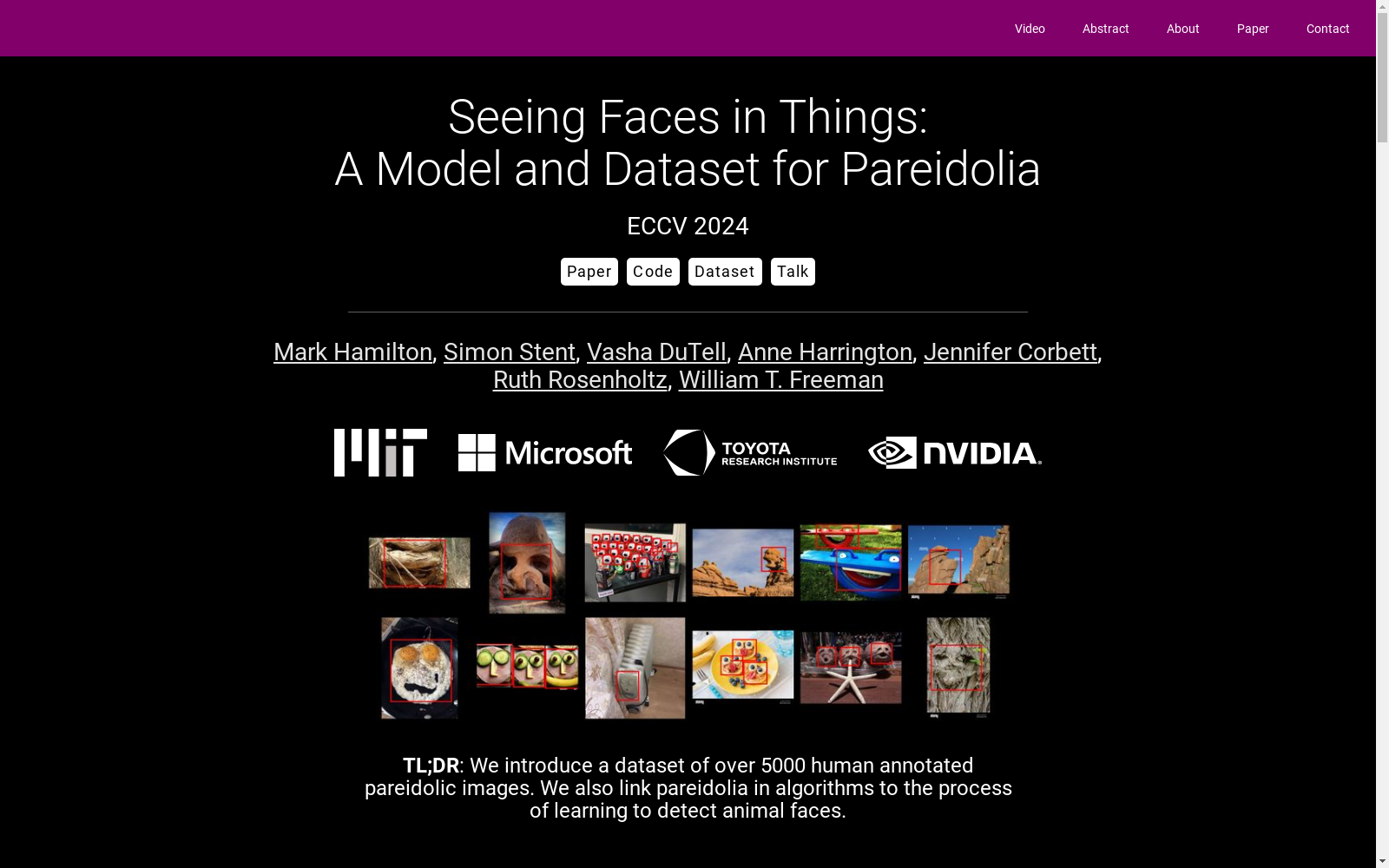

Faces in Things数据集由麻省理工学院和微软等机构创建,包含5000张标注了人脸幻觉(pareidolia)的网络图片。该数据集用于研究计算机视觉中的人脸检测系统是否表现出类似人类的幻觉现象。数据集内容包括图片的边界框和基本面部属性,如情感、性别和意图。创建过程涉及从LAION-5B数据集中采样候选图片,并通过人工标注去除包含实际人类或动物面部的图片。该数据集主要应用于计算机视觉领域,旨在解决人脸检测系统中的幻觉现象,并探索如何改进这些系统的性能。

The Faces in Things dataset was created by institutions such as the Massachusetts Institute of Technology (MIT) and Microsoft. It contains 5000 web images annotated for pareidolia (face illusions). This dataset is designed to investigate whether face detection systems in computer vision exhibit pareidolia similar to that observed in humans. The dataset includes bounding boxes of the images and basic facial attributes including emotion, gender, and intent. Its creation involved sampling candidate images from the LAION-5B dataset, followed by manual annotation to remove images containing actual human or animal faces. Primarily applied in the field of computer vision, this dataset aims to address pareidolia in face detection systems and explore ways to improve the performance of such systems.

提供机构:

麻省理工学院, 微软, 丰田研究院, NVIDIA

创建时间:

2024-09-24

原始信息汇总

FacesInThings 数据集概述

数据集简介

- 名称: FacesInThings

- 描述: 一个包含超过5000张人类标注的幻觉人脸图像的数据集,用于研究幻觉人脸现象(pareidolia)。

- 来源: 数据集基于LAION-5B数据集,并进行了关键人脸属性和边界框的标注。

数据集内容

- 图像数量: 5000+

- 标注信息: 包含人脸属性和边界框的标注。

研究目标

- 主要研究方向: 从计算机视觉角度研究幻觉人脸现象。

- 研究内容:

- 评估现有最先进的人脸检测器在幻觉人脸检测中的表现。

- 探索通过在动物人脸数据上微调人脸检测器来改进幻觉人脸检测的方法。

- 提出一个简单的统计模型来预测图像中幻觉人脸的出现。

相关资源

- 论文: Seeing Faces in Things: A Model and Dataset for Pareidolia

- 代码: GitHub 代码库

- 数据集下载: FacesInThings 数据集

- 视频讲解: YouTube 视频

作者信息

- 主要作者:

- Mark Hamilton

- Simon Stent

- Vasha DuTell

- Anne Harrington

- Jennifer Corbett

- Ruth Rosenholtz

- William T. Freeman

联系信息

- 联系人: Mark Hamilton

- 邮箱: markth@mit.edu

搜集汇总

数据集介绍

构建方式

Faces in Things数据集的构建基于对五千张网络图像的精心筛选与标注。研究团队从LAION-5B数据集中采样候选图像,通过CLIP检索技术筛选出与‘pareidolia’、‘faces in things’等关键词相关的图像。随后,这些图像经过去重、尺寸调整及手动标注,确保每张图像中不包含真实的人类或动物面孔。标注过程包括对图像中面孔的边界框标注及基本面部属性的描述,如情感、性别和意图。最终,数据集被随机分为训练集(70%)和测试集(30%),以支持后续的实验与分析。

特点

Faces in Things数据集的显著特点在于其专注于面孔错觉(pareidolia)现象,提供了丰富的标注信息。每张图像不仅包含面孔的边界框,还详细标注了面孔的情感、性别和意图等属性,这些信息为研究面孔错觉的机制提供了宝贵的数据支持。此外,数据集的构建过程中严格排除了真实面孔的干扰,确保了数据集的纯净性和研究目标的单一性。

使用方法

Faces in Things数据集可用于多种计算机视觉研究,特别是面孔检测和错觉现象的研究。研究者可以利用该数据集训练和评估面孔检测算法,探索机器与人类在面孔识别上的差异。此外,数据集中的详细标注信息可用于情感分析、性别识别等高级视觉任务。通过分析数据集中的面孔错觉现象,研究者还可以深入理解人类视觉系统的特性,从而改进现有的计算机视觉模型,提升其在复杂环境下的鲁棒性和准确性。

背景与挑战

背景概述

Faces in Things数据集由Mark Hamilton、Simon Stent、Vasha DuTell等研究人员于2024年创建,旨在从计算机视觉的角度研究面孔错觉现象(pareidolia)。该数据集包含了五千张经过人工标注的网络图片,这些图片中包含了人类在随机刺激中感知到的面孔。通过这一数据集,研究团队探讨了最先进的面部检测器在面孔错觉现象中的表现,并发现人类与机器之间存在显著的行为差异。这一研究不仅揭示了人类视觉系统对面孔检测的进化需求,还提出了一个简单的统计模型来解释图像中的面孔错觉现象。Faces in Things数据集的发布为计算机视觉社区提供了宝贵的资源,有助于进一步探索和理解面孔错觉现象及其在视觉感知中的作用。

当前挑战

Faces in Things数据集面临的挑战主要集中在两个方面。首先,面孔错觉现象的领域问题本身具有高度复杂性和主观性,这使得数据集的构建和标注过程充满了挑战。其次,在构建过程中,研究人员必须确保数据集中的图片不包含真实的人类或动物面孔,这增加了数据筛选和处理的难度。此外,面孔错觉现象的检测与传统的面部检测任务不同,现有的面部检测器在处理这类数据时表现不佳,这要求研究者开发新的模型和方法来弥合这一差距。通过Faces in Things数据集,研究者不仅需要解决技术上的挑战,还需深入理解人类视觉系统的内在机制,以推动计算机视觉技术的发展。

常用场景

经典使用场景

Faces in Things数据集的经典使用场景在于研究人脸错觉现象,即人脸在非人脸物体中的识别。通过该数据集,研究者可以评估最先进的人脸检测算法在识别错觉人脸时的表现,并探索人类与机器在人脸检测上的行为差异。此外,数据集还可用于开发和验证新的算法,以提高机器在复杂视觉环境中的鲁棒性和准确性。

衍生相关工作

Faces in Things数据集的发布催生了一系列相关研究工作,包括对人脸错觉现象的深入神经科学研究,以及开发新的计算机视觉算法以模拟人类视觉系统的行为。此外,该数据集还激发了对跨模态识别和跨描绘问题的研究,探索如何在不同视觉表现形式中识别相同对象。这些研究不仅扩展了计算机视觉的边界,也为人工智能在复杂视觉环境中的应用提供了新的思路。

数据集最近研究

最新研究方向

在人脸识别领域,Faces in Things数据集的最新研究方向聚焦于探索人脸幻觉(pareidolia)现象的计算机视觉模型。该数据集由五千张包含人类标注的幻觉人脸的网络图像组成,旨在研究现代人脸检测系统在多大程度上表现出幻觉现象。研究发现,尽管最先进的人脸检测神经网络在常规人脸检测基准上表现出色,但在检测幻觉人脸时存在显著的行为差异。研究进一步提出,人类对动物面孔的检测需求可能解释了这一差异,并提出了一个简单的统计模型来描述图像中的幻觉现象。通过人类受试者和幻觉人脸检测器的研究,验证了模型关于引发幻觉的最佳图像条件的预测。这些研究不仅有助于理解人类视觉系统的鲁棒性,还为减少人脸检测中的幻觉误报提供了新的视角。

相关研究论文

- 1Seeing Faces in Things: A Model and Dataset for Pareidolia麻省理工学院, 微软, 丰田研究院, NVIDIA · 2024年

以上内容由遇见数据集搜集并总结生成