STAR|卫星图像分析数据集|场景图生成数据集

收藏github2024-07-03 更新2024-07-04 收录

下载链接:

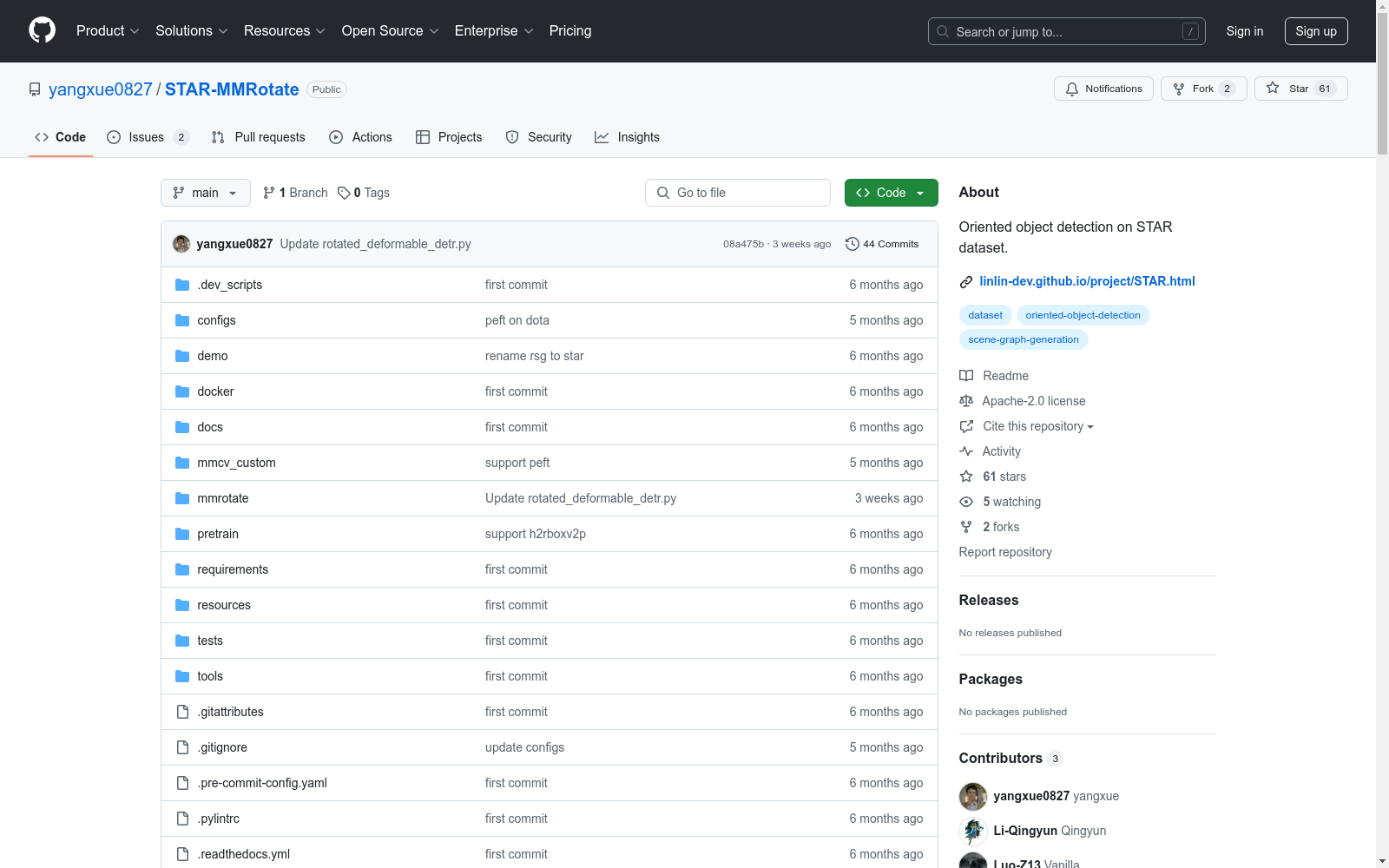

https://github.com/yangxue0827/STAR-MMRotate

下载链接

链接失效反馈资源简介:

STAR是一个用于大型卫星图像中场景图生成(SGG)的首个大规模数据集,包含超过210,000个对象和超过400,000个三元组,跨越全球1,273个复杂场景。

创建时间:

2024-06-12

原始信息汇总

STAR: 大型卫星图像场景图生成数据集及基准

概述

STAR数据集是首个针对大型高分辨率卫星图像(VHR SAI)场景图生成(SGG)的大规模数据集。该数据集包含超过210,000个对象和400,000个关系三元组,覆盖全球1,273个复杂场景。

数据集特点

- 规模:包含超过210,000个对象和400,000个关系三元组。

- 图像尺寸:图像大小从512 × 768像素到27,860 × 31,096像素不等。

- 复杂性:对象在尺度和宽高比上变化大,且对象间存在丰富的关系。

数据集构建

- 目的:促进从感知到认知的地理空间场景理解。

- 方法:提出一个上下文感知的级联认知(CAC)框架,用于对象检测(OBD)、配对修剪和关系预测。

数据集和工具包

- 数据集和工具包链接:STAR数据集和工具包

使用说明

- 安装和使用:详细安装、预训练模型、训练和评估指南请参考MMRotate 0.3.4。

发布模型

定向对象检测

以下是一些已发布的定向对象检测模型及其性能指标:

| 检测器 | mAP | 配置文件 | 下载链接 | 备注 |

|---|---|---|---|---|

| Deformable DETR | 17.1 | 配置 | 日志 | 模型 |

| ARS-DETR | 28.1 | 配置 | 日志 | 模型 |

| RetinaNet | 21.8 | 配置 | 日志 | 模型 |

| ATSS | 20.4 | 配置 | 日志 | 模型 |

| KLD | 25.0 | 配置 | 日志 | 模型 |

| GWD | 25.3 | 配置 | 日志 | 模型 |

| KFIoU | 25.5 | 配置 | 日志 | 模型 |

| DCFL | 29.0 | 配置 | 日志 | 模型 |

| R<sup>3</sup>Det | 23.7 | 配置 | 日志 | 模型 |

| S2A-Net | 27.3 | 配置 | 日志 | 模型 |

| FCOS | 28.1 | 配置 | 日志 | 模型 |

| CSL | 27.4 | 配置 | 日志 | 模型 |

| PSC | 30.5 | 配置 | 日志 | 模型 |

| H2RBox-v2 | 27.3 | 配置 | 日志 | 模型 |

| RepPoints | 19.7 | 配置 | 日志 | 模型 |

| CFA | 25.1 | 配置 | 日志 | 模型 |

| Oriented RepPoints | 27.0 | 配置 | 日志 | 模型 |

| G-Rep | 26.9 | 配置 | 日志 | 模型 |

| SASM | 28.2 | 配置 | 日志 | 模型 |

| Faster RCNN | 32.6 | 配置 | 日志 | 模型 |

| Gliding Vertex | 30.7 | 配置 | 日志 | 模型 |

| Oriented RCNN | 33.2 | 配置 | 日志 | 模型 |

| RoI Transformer | 35.7 | [配置](configs/roi_trans/roi_trans_r50_ |

AI搜集汇总

数据集介绍

构建方式

在遥感图像分析领域,STAR数据集的构建旨在填补大型卫星图像场景图生成(SGG)的空白。该数据集通过收集全球1,273个复杂场景的卫星图像,涵盖了从512 × 768到27,860 × 31,096像素的图像尺寸,包含超过210,000个对象和400,000个关系三元组。构建过程中,采用了上下文感知的级联认知(CAC)框架,以实现对卫星图像的对象检测、配对修剪和关系预测,从而生成高质量的场景图。

特点

STAR数据集的显著特点在于其大规模和高分辨率,适用于处理复杂的地理空间场景。数据集中的对象具有极大的尺度和纵横比变化,且对象间存在丰富的关系,包括空间上不连续的对象之间的关系。此外,STAR数据集还提供了一个面向卫星图像的SGG工具包,包含约30种对象检测和10种SGG方法,这些方法需要进一步适应STAR数据集的挑战性。

使用方法

使用STAR数据集时,首先需克隆GitHub仓库并创建一个conda虚拟环境。随后,安装PyTorch及相关依赖,包括MMRotate框架。数据集提供了多种预训练模型,用户可以根据需求选择合适的模型进行训练和评估。具体操作包括配置文件的设置、模型的下载与加载,以及训练和评估脚本的执行。详细的安装和使用说明可参考README_en.md文件。

背景与挑战

背景概述

STAR数据集是首个针对大尺寸卫星图像场景图生成的大规模基准数据集,由Yang Xue等研究人员于2024年创建。该数据集包含超过210,000个对象和400,000个三元组,覆盖全球1,273个复杂场景。其核心研究问题在于解决大尺寸高分辨率卫星图像中的场景图生成,这一领域此前缺乏相应的数据集。STAR数据集的推出极大地推动了从感知到认知的地球空间场景理解,为相关领域的研究提供了宝贵的资源和基准。

当前挑战

STAR数据集面临的主要挑战包括:1) 大尺寸卫星图像中对象的尺度与纵横比变化极大,且对象间存在丰富的关系,甚至包括空间上不连续的对象,这增加了场景图生成的复杂性;2) 现有的小尺寸自然图像场景图生成模型无法直接应用于大尺寸卫星图像,需要开发新的模型和方法;3) 数据集构建过程中,挖掘三元组<subject, relationship, object>依赖于长距离的上下文推理,这一过程极具挑战性。此外,数据集的规模和复杂性也对模型的训练和评估提出了更高的要求。

常用场景

经典使用场景

在遥感图像分析领域,STAR数据集的经典使用场景主要集中在场景图生成(SGG)任务上。该数据集通过提供大规模的高分辨率卫星图像,涵盖了全球1,273个复杂场景,包含超过210,000个对象和400,000个关系三元组。这些数据为研究人员提供了丰富的资源,用于开发和验证针对大尺寸卫星图像的场景图生成模型。通过STAR数据集,研究者可以训练和评估模型在复杂地理空间场景中的对象检测、关系预测和整体场景理解能力。

衍生相关工作

基于STAR数据集,研究者们开发了多种先进的场景图生成模型和工具,如上下文感知级联认知(CAC)框架和SAI-oriented SGG工具包。这些工具包整合了约30种对象检测方法和10种SGG方法,并提供了预训练模型和训练评估指南。此外,STAR数据集还激发了一系列相关研究,包括针对大尺寸卫星图像的特定模型优化、多尺度对象检测和复杂关系预测等。这些研究不仅提升了遥感图像分析的性能,也为其他领域的图像理解提供了新的思路和方法。

数据集最近研究

最新研究方向

在卫星遥感图像领域,STAR数据集的引入标志着场景图生成(SGG)技术在大型卫星图像中的应用迈出了重要一步。该数据集不仅包含了超过210,000个对象和400,000个关系三元组,还涵盖了全球1,273个复杂场景,极大地推动了从感知到认知的遥感图像理解。前沿研究方向主要集中在开发适用于大型高分辨率卫星图像的SGG模型,特别是针对对象检测(OBD)、配对修剪和关系预测的上下文感知级联认知(CAC)框架。此外,数据集的发布还促进了多种检测和SGG方法的适应性研究,为未来的遥感图像分析提供了丰富的工具和基准。

以上内容由AI搜集并总结生成