andersonbcdefg/supernatural-instructions-2m

收藏Hugging Face2023-03-30 更新2024-03-04 收录

下载链接:

https://hf-mirror.com/datasets/andersonbcdefg/supernatural-instructions-2m

下载链接

链接失效反馈资源简介:

---

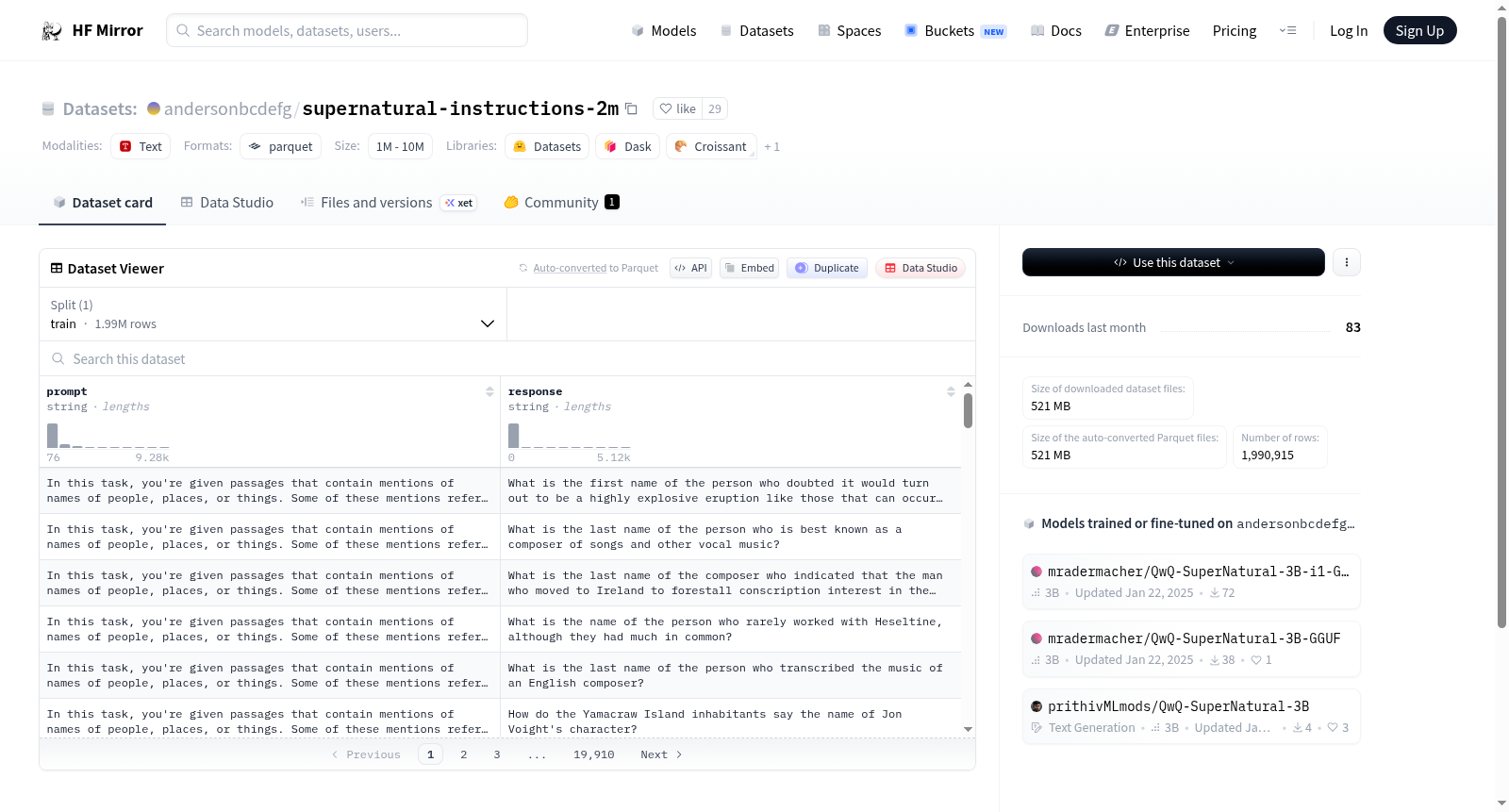

dataset_info:

features:

- name: prompt

dtype: string

- name: response

dtype: string

splits:

- name: train

num_bytes: 1859403487.079275

num_examples: 1990915

download_size: 521457643

dataset_size: 1859403487.079275

---

# Dataset Card for "supernatural-instructions-2m"

[More Information needed](https://github.com/huggingface/datasets/blob/main/CONTRIBUTING.md#how-to-contribute-to-the-dataset-cards)

提供机构:

andersonbcdefg

原始信息汇总

数据集概述

数据集名称

- 名称: supernatural-instructions-2m

数据集特征

- 特征1: prompt

- 数据类型: string

- 特征2: response

- 数据类型: string

数据集分割

- 分割类型: train

- 样本数量: 1990915

- 数据大小: 1859403487.079275 字节

数据集大小

- 下载大小: 521457643 字节

- 总数据大小: 1859403487.079275 字节

搜集汇总

数据集介绍

构建方式

在自然语言处理领域,大规模指令数据集对于提升模型的任务泛化能力至关重要。Supernatural-Instructions-2m数据集通过自动化流程构建,从多样化的网络资源中提取了约199万条指令-响应对。每条数据均包含清晰的提示文本及对应的响应内容,覆盖了广泛的任务类型与语言表达形式,确保了数据在语义和结构上的丰富性。

使用方法

研究者可将该数据集直接用于大规模语言模型的指令微调或监督式学习。典型流程包括加载HuggingFace数据集库中的指定路径,按标准分割获取训练数据。随后,通过预处理将提示与响应格式化为模型输入,进而训练模型理解并执行多样化指令。该资源尤其适用于提升模型在零样本或少样本场景下的任务适应能力。

背景与挑战

背景概述

在自然语言处理领域,指令微调数据集对于提升大型语言模型遵循人类指令的能力至关重要。Supernatural-Instructions-2M数据集由andersonbcdefg于2023年发布,旨在通过大规模、多样化的指令-响应对集合,解决模型泛化与任务适应性不足的核心研究问题。该数据集汇集了数百万条涵盖广泛场景的指令,推动了指令跟随模型的发展,显著增强了模型在零样本和少样本学习中的表现,对对话系统、智能助手等应用产生了深远影响。

当前挑战

该数据集致力于应对开放域指令理解与执行的挑战,包括模型在未见任务上的泛化能力、指令的歧义性处理以及多步骤复杂推理的准确性。在构建过程中,挑战主要集中于数据收集的规模与质量平衡,确保指令的多样性和代表性,同时避免噪声与偏见;此外,标注一致性与响应生成的真实性也是关键难点,需通过精细的流程设计来保障数据可靠性。

常用场景

经典使用场景

在自然语言处理领域,指令微调已成为提升大型语言模型泛化能力的关键技术。Supernatural-Instructions-2m数据集以其海量的指令-响应对,为模型训练提供了丰富的多样化任务示例。该数据集最经典的使用场景在于支持指令跟随模型的监督微调,通过涵盖广泛主题和复杂度的指令,帮助模型学习如何准确理解并执行人类自然语言指令,从而增强其在零样本或少样本设置下的任务适应性。

解决学术问题

该数据集有效解决了指令微调研究中数据稀缺与多样性不足的学术难题。传统指令数据集往往规模有限或任务类型单一,难以全面评估模型的泛化性能。Supernatural-Instructions-2m通过整合数百万条指令,覆盖了从简单问答到复杂推理的连续谱系,为研究指令理解、任务泛化以及模型对齐提供了标准化的基准。其意义在于推动了指令遵循模型的系统性评估,促进了更鲁棒、更可控的人工智能系统发展。

实际应用

在实际应用中,Supernatural-Instructions-2m数据集为构建高效能对话系统和智能助手奠定了数据基础。基于该数据集训练的模型能够更好地理解用户意图,在客服自动化、教育辅导、内容生成等场景中提供精准响应。例如,在客服领域,模型可依据多样化指令学习处理各类查询,提升服务效率与用户体验。这种大规模指令数据驱动的微调方法,正逐步成为工业界部署可靠语言模型的关键环节。

数据集最近研究

最新研究方向

在自然语言处理领域,指令微调数据集正成为推动大语言模型泛化能力的关键资源。Supernatural-Instructions-2m以其大规模、多样化的指令-响应对,为模型在复杂任务中的零样本和少样本学习提供了丰富素材。前沿研究聚焦于利用此类数据集优化指令遵循机制,探索跨领域知识迁移与多轮对话的适应性增强,相关热点事件包括开源社区对指令数据质量的持续改进,以及其在促进模型对齐人类意图方面的显著影响,这为构建更安全、可靠的AI系统奠定了数据基础。

以上内容由遇见数据集搜集并总结生成