ER-REASON

收藏arXiv2025-05-31 更新2025-06-04 收录

下载链接:

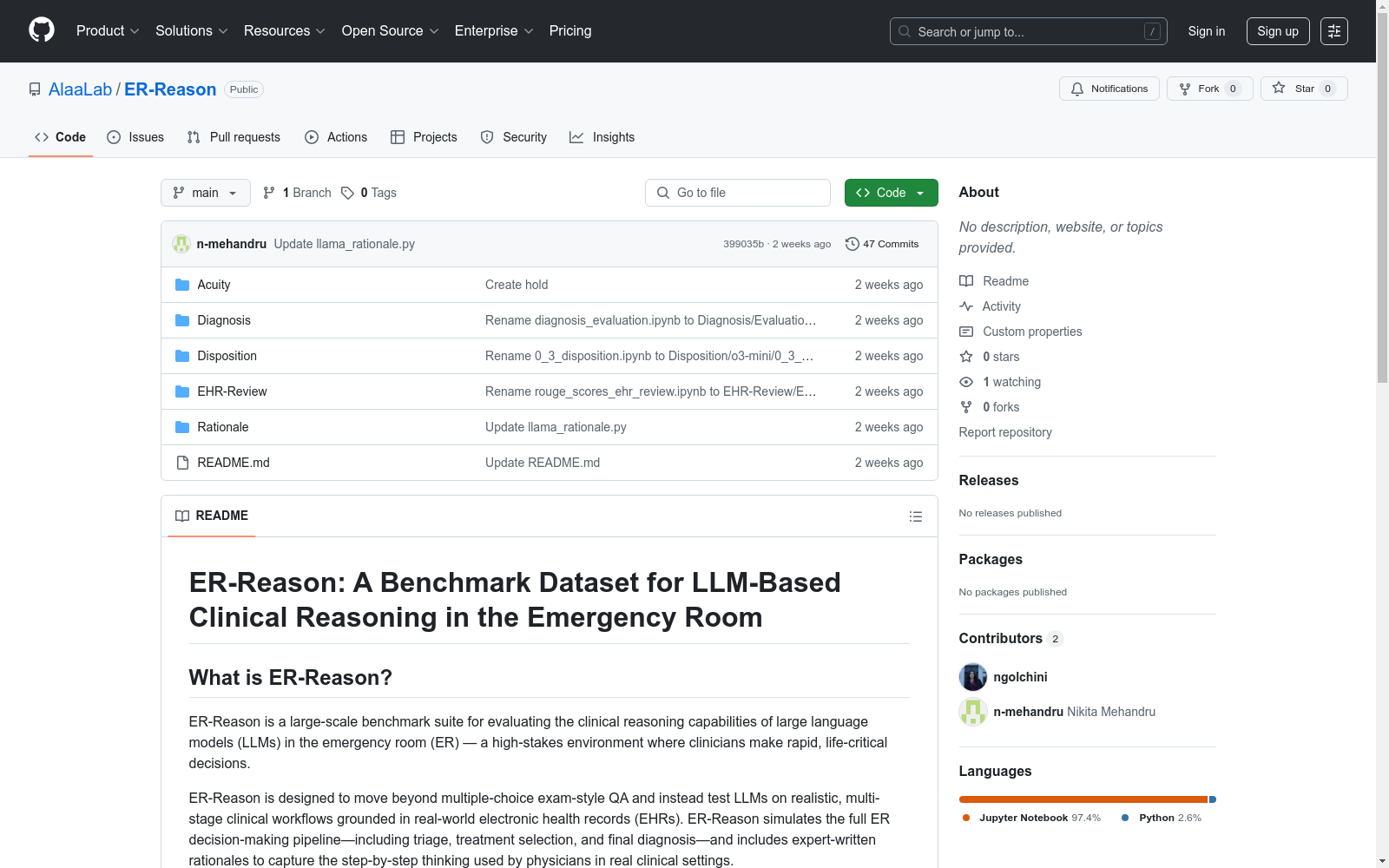

https://github.com/AlaaLab/ER-Reason

下载链接

链接失效反馈官方服务:

资源简介:

ER-REASON是一个旨在评估基于大型语言模型(LLM)的临床推理和决策能力的数据集,特别是在急诊室(ER)这种高风险环境中。该数据集包含来自3984名患者的数据,包括25174条去标识化的纵向临床记录,涵盖了出院摘要、进度笔记、病史和体检记录、咨询记录、超声心动图报告、影像笔记和急诊医生记录等。数据集还包含72位医生撰写的完整理由,解释了推理过程,这些理由模拟了住院医师培训过程中使用的教学方法,通常在急诊室记录中缺失。该数据集旨在解决现有基准测试未能充分捕捉现实世界临床决策复杂性和模糊性的问题,并提供了对LLM生成的临床推理与医生撰写的临床推理之间差距的评价,突出了未来研究的必要性以缩小这一差距。

ER-REASON is a purpose-built dataset for evaluating the clinical reasoning and decision-making abilities of large language models (LLMs), particularly within high-stakes emergency room (ER) environments. This dataset contains data derived from 3,984 patients, including 25,174 de-identified longitudinal clinical records spanning discharge summaries, progress notes, medical and physical examination records, consultation notes, echocardiography reports, imaging notes, emergency physician documentation, and additional relevant clinical materials. It also includes complete rationales written by 72 physicians that explain the underlying clinical reasoning process, simulating the instructional approaches utilized in residency training programs—content that is frequently absent from standard emergency room records. ER-REASON is designed to address a key shortcoming of existing benchmark datasets: their failure to adequately capture the complexity and ambiguity inherent in real-world clinical decision-making. Furthermore, it provides an assessment of the disparity between clinical reasoning generated by LLMs and that authored by human physicians, highlighting the critical need for future research to narrow this gap.

提供机构:

加州大学伯克利分校和旧金山分校

创建时间:

2025-05-29

原始信息汇总

ER-Reason数据集概述

数据集简介

ER-Reason是一个用于评估大型语言模型(LLM)在急诊室(ER)临床推理能力的大规模基准测试套件。该数据集模拟真实的急诊决策流程,包含多阶段临床工作流程和专家撰写的推理过程。

核心特性

数据规模与类型

- 包含3,984名患者的25,174份去标识化纵向临床记录

- 临床记录类型:

- 出院摘要

- 病程记录

- 病史与体格检查(H&P)

- 会诊记录

- 影像学报告

- 超声心动图报告

- 急诊科医生记录

临床推理标注

- 72份由医师撰写的临床决策推理说明

- 推理过程模拟住院医师级别的临床教学

临床任务设计

任务围绕实际急诊护理流程设计:

- 分诊接诊

- 电子健康记录(EHR)审查

- 初步评估

- 治疗计划

- 处置计划(入院、出院、ICU)

- 最终诊断

模型兼容性

- 支持评估以下模型:

- LLaMA 3.2-3B-Instruct

- GPT-4o

- GPT-3.5 Turbo

- O3-Mini

评估任务

- 紧急程度分类:根据症状和临床病史判断患者紧急程度

- EHR摘要:总结患者临床病史的关键方面

- 推理生成:创建与医师思维一致的临床决策推理

- 诊断推断:基于EHR数据和症状推断最可能的诊断

- 处置预测:预测患者应入院、出院或转入ICU

搜集汇总

数据集介绍

构建方式

ER-REASON数据集构建于一个大型学术医疗中心的急诊科,涵盖了3,984名患者的25,174份纵向临床记录。这些记录包括出院摘要、病程记录、病史与体格检查、会诊记录、超声心动图报告、影像学报告以及急诊科医生记录等多种文档类型。数据采集时间跨度为2022年3月至2024年3月,所有记录均经过去标识化处理以符合HIPAA安全港标准。此外,数据集还包含了72份由急诊科医生撰写的详细临床推理过程,这些内容模拟了住院医师培训中的教学流程,弥补了急诊记录中通常缺失的推理细节。

特点

ER-REASON数据集的特点在于其全面覆盖了急诊科工作流程的五个关键阶段:分诊评估、病历回顾、初步诊断、治疗选择和处置计划。每个阶段的任务设计均基于真实患者的纵向临床记录,旨在评估大型语言模型在临床推理和决策制定中的能力。数据集不仅包含了丰富的非结构化文本数据,还通过专家标注的推理过程提供了对临床决策背后逻辑的深入理解。这种结合了实际工作流程和详细推理标注的设计,使ER-REASON成为评估医疗AI系统临床推理能力的独特资源。

使用方法

ER-REASON数据集的使用方法围绕五个核心评估任务展开,这些任务模拟了急诊科的实际工作流程。研究人员可以使用该数据集来测试大型语言模型在分诊评估中的敏锐度判断能力、在病历回顾中的信息摘要能力、在诊断推理中的鉴别诊断能力、在治疗选择中的决策制定能力,以及在最终处置中的患者分流能力。评估指标包括与医生判断的一致性比较(如急诊敏锐度指数评分准确率)、文本摘要质量(如ROUGE分数)以及临床概念匹配度(通过cTAKES工具实现的UMLS概念唯一标识符比对)。数据集还提供了专家评分的幻觉严重性和临床效用指标,为模型输出的实际应用价值提供了参考。

背景与挑战

背景概述

ER-REASON是由加州大学伯克利分校和旧金山分校的研究团队于2025年提出的一个专注于急诊室临床推理的基准数据集。该数据集旨在评估大型语言模型(LLMs)在急诊室这一高风险环境中的临床推理和决策能力。数据集包含3,984名患者的25,174份去标识化的纵向临床记录,涵盖了从分诊到最终诊断的完整急诊工作流程。ER-REASON的提出填补了现有医学基准数据集中在孤立任务上的不足,为研究LLMs在真实临床环境中的应用提供了重要资源。

当前挑战

ER-REASON面临的挑战主要包括两个方面:领域问题的挑战和构建过程中的挑战。在领域问题方面,急诊室的高风险、时间压力和临床数据的碎片化特性使得LLMs的推理能力面临严峻考验,尤其是在模拟临床医生的逐步推理过程(如鉴别诊断和治疗规划)时表现不佳。构建过程中的挑战则包括临床记录的异构性和不完整性,以及获取专家标注的临床推理过程的困难。此外,数据集尚未纳入医院层面的情境因素(如床位可用性和人员配置限制),这些因素在实际临床决策中扮演重要角色。

常用场景

经典使用场景

ER-REASON数据集在急诊医学领域中被广泛用于评估大型语言模型(LLM)的临床推理能力。该数据集通过模拟急诊室(ER)的实际工作流程,包括分诊、初步评估、治疗选择和最终诊断等关键阶段,为研究者提供了一个全面且真实的评估平台。其独特的纵向临床记录和多类型文档结构,使得研究者能够在高度仿真的环境中测试模型对复杂临床情境的理解和推理能力。

解决学术问题

ER-REASON数据集解决了当前医学人工智能研究中临床推理评估的不足问题。传统基准数据集多基于医学执照考试的单选题,无法反映真实临床决策中的复杂性和模糊性。ER-REASON通过整合真实患者的纵向临床记录和专家标注的推理过程,填补了这一空白,为研究LLM在动态、高风险的急诊环境中的表现提供了可靠工具。其意义在于推动了医学AI从知识回忆向临床推理能力的转变。

衍生相关工作

ER-REASON数据集已经衍生出多项重要研究工作。例如,基于该数据集开发的o3-mini模型在急诊敏锐度评估任务中展现了优越性能,推动了专门针对临床推理的模型架构研究。同时,该数据集也促进了临床概念抽取工具(如cTAKES)在医学自然语言处理中的创新应用,为后续如MedArena等交互式医疗评估平台的发展奠定了基础。

以上内容由遇见数据集搜集并总结生成