eMotions

收藏arXiv2025-08-09 更新2025-08-13 收录

下载链接:

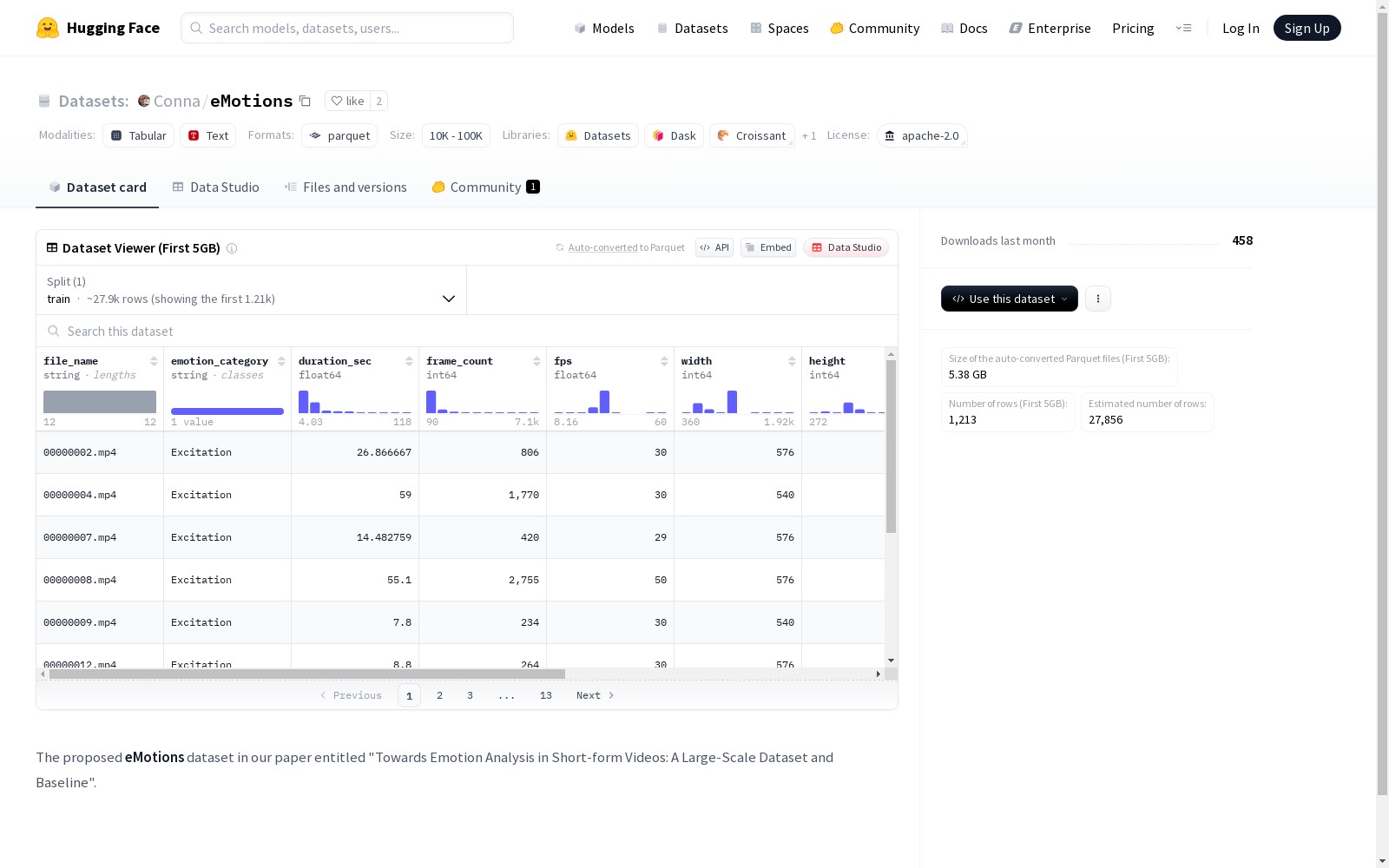

https://huggingface.co/datasets/Conna/eMotions

下载链接

链接失效反馈官方服务:

资源简介:

eMotions数据集是一个专门为短格式视频中的情绪分析而设计的庞大数据库,包含27,996个带有完整标注的视频。该数据集内容丰富,涵盖了多个维度,总时长近198小时。视频来源包括抖音、快手和TikTok等短视频平台。作为首个针对短视频的情绪分析数据集,eMotions是目前具有完整视频级别标注的最大情绪分析数据集。该数据集的构建过程注重人员分配和标注流程的优化,以确保标注质量并减少主观偏差。数据集的内容多样性覆盖了广泛的文化和时间跨度,为研究提供了丰富的数据基础。

The eMotions dataset is a large-scale database specifically designed for emotion analysis in short-form videos, comprising 27,996 fully annotated videos. Boasting rich content across multiple dimensions, the dataset has a total duration of nearly 198 hours. The videos originate from short-video platforms including Douyin, Kuaishou, TikTok and other similar platforms. As the first dataset dedicated to short-form video emotion analysis, eMotions is currently the largest emotion analysis dataset with complete video-level annotations. The development of this dataset emphasizes optimized personnel allocation and annotation procedures to ensure annotation quality and reduce subjective bias. The diverse content spans a wide range of cultural backgrounds and temporal scales, providing a robust data foundation for related research.

提供机构:

IEEE TRANSACTIONS ON CIRCUITS AND SYSTEMS FOR VIDEO TECHNOLOGY

创建时间:

2025-08-09

原始信息汇总

eMotions 数据集概述

基本信息

- 数据集名称: eMotions

- 许可证: Apache 2.0

数据集描述

- 来源论文: "Towards Emotion Analysis in Short-form Videos: A Large-Scale Dataset and Baseline"

- 主要用途: 短格式视频中的情感分析

- 规模: 大规模数据集

搜集汇总

数据集介绍

构建方式

eMotions数据集的构建采用了多阶段、精细化的流程。首先从抖音、快手和TikTok三大短视频平台爬取原始视频,经过严格的数据清洗,剔除重复、损坏及不符合伦理规范的内容。为确保标注质量,研究团队创新性地设计了人员分配策略,通过两阶段交叉检验和一致性评估优化标注团队构成。标注过程采用心理学中的Plutchik六类基本情感模型,通过多阶段人工标注与专家复核相结合的方式,最终构建了包含27,996个视频的大规模数据集。

特点

eMotions作为首个面向短视频场景的大规模情感分析数据集,具有三个显著特征:其内容覆盖45个月的时间跨度和多元文化背景,呈现丰富的场景多样性;通过创新的标注人员动态调整策略,实现了0.55的组内一致性评分,显著优于同类数据集;特别提供类别平衡和测试导向两种变体数据集,支持不同研究需求。与实验室环境采集的传统数据集相比,其野外场景数据更贴近真实应用场景。

使用方法

该数据集支持端到端的音视频情感分析研究,建议采用论文提出的AV-CANet基准网络进行模型开发。使用时需注意视频片段化处理(16段×8帧)和MFCC音频特征提取(32系数)。为应对类别不平衡问题,推荐采用EP-CE损失函数进行三极性(正/中/负)优化。数据集已划分80%训练集和20%测试集,评估指标应包含准确率(ACC)、加权F1值(WA-F1)和未加权平均召回率(UAR)。

背景与挑战

背景概述

eMotions数据集由Xuecheng Wu等研究人员于2025年提出,是首个针对短视频情感分析的大规模数据集,包含来自抖音、快手和TikTok平台的27,996个视频,涵盖六种基本情感类别。该数据集由西安交通大学、复旦大学等多家机构联合构建,旨在解决短视频多模态复杂性带来的情感分析挑战。eMotions通过多阶段标注流程和人员分配优化策略,显著提升了标注质量,为视频情感分析领域提供了重要的基准数据。

当前挑战

eMotions数据集面临的核心挑战包括:1) 领域问题层面,短视频内容多样性导致语义鸿沟扩大,情感相关特征学习困难;2) 构建过程中需克服音频-视觉表达不一致性带来的局部偏差,以及多文化背景下情感标注的主观性影响。此外,数据集中情感类别分布不均衡,负面情感样本相对稀缺,增加了模型训练的难度。

常用场景

经典使用场景

eMotions数据集在情感计算领域具有广泛的应用价值,尤其在短格式视频(Short-form Videos, SVs)的情感分析中表现突出。该数据集通过多模态信息(视觉、听觉)的融合,为研究者提供了丰富的素材,用于探索视频内容如何激发观众的情感反应。其经典使用场景包括情感识别模型的训练与评估,特别是在处理内容多样性强、情感表达复杂的短视频时,eMotions能够提供高质量的标注数据支持。

解决学术问题

eMotions数据集解决了短格式视频情感分析中的多个关键学术问题。首先,它填补了大规模、全标注短视频情感数据集的空白,为研究者提供了可靠的数据基础。其次,通过多阶段标注流程和人员分配优化,有效减少了主观偏差对标注质量的影响。此外,数据集中的音频-视觉共现现象为研究跨模态情感表达不一致性提供了独特视角,推动了多模态情感融合算法的发展。

衍生相关工作

eMotions数据集已经衍生出多项重要研究工作。基于该数据集提出的AV-CANet网络架构,通过局部-全局融合模块和情感极性增强损失函数,显著提升了多模态情感分析的性能。此外,该数据集还启发了对大型语言模型(LLMs)和多模态大语言模型(MLLMs)在情感分析中应用的探索,为同步对齐人类行为与情感表达提供了新的研究思路。

以上内容由遇见数据集搜集并总结生成