【我遇到的问题】 • 现象:该数据集的下载链接已失效 【相关信息】 • 可考虑访问这个链接获取类似文件~https://www.selectdataset.com/dataset/3688356173feccbcf1f1e490ddc6bc72

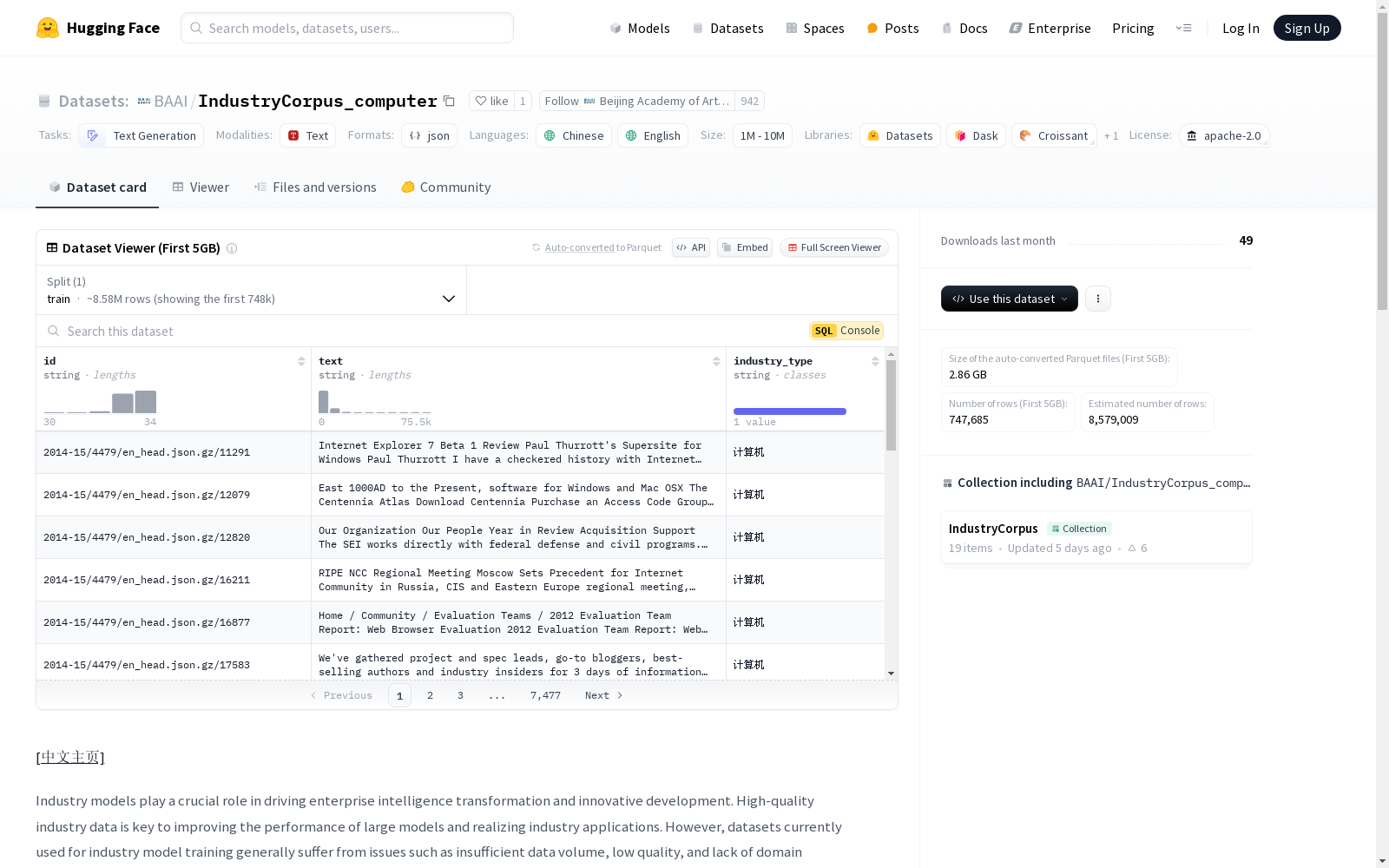

IndustryCorpus_computer

收藏Hugging Face2024-07-26 更新2024-12-12 收录

下载链接:

https://huggingface.co/datasets/BAAI/IndustryCorpus_computer

下载链接

链接失效反馈官方服务:

资源简介:

该数据集是为了解决行业模型训练中数据量不足、质量低和缺乏领域专业知识的问题而构建的。通过应用22个行业数据处理操作符,从超过100TB的开放源数据集中筛选出3.4TB的高质量多行业分类中英文预训练数据集。数据集包括1TB的中文数据和2.4TB的英文数据,并对中文数据进行了12种类型的标签标注,包括字母数字比、平均行长度、语言置信度分数、最大行长度和困惑度等。此外,为了验证数据集的性能,进行了医疗行业示范模型的继续预训练、SFT和DPO训练,结果显示性能有显著提升。数据集涵盖18个行业类别,并进行了基于规则和模型的过滤以及文档级数据去重。

提供机构:

Beijing Academy of Artificial Intelligence

创建时间:

2024-07-25

原始信息汇总

数据集概述

数据集描述

- 语言: 中文和英文

- 数据量: 1TB中文数据,2.4TB英文数据

- 任务类别: 文本生成

- 行业分类: 18个行业类别,包括医疗、教育、文学、金融、旅游、法律、体育、汽车、新闻等

数据处理

- 数据来源: 从超过100TB的开放源数据集中筛选,包括WuDaoCorpora, BAAI-CCI, redpajama, SkyPile-150B

- 数据处理操作: 22个行业数据处理操作符,用于清洗和过滤

- 规则过滤: 传统中文转换、电子邮件移除、IP地址移除、链接移除、Unicode修复等

- 模型过滤: 行业分类语言模型,准确率80%

- 数据去重: MinHash文档级去重

数据标注

- 中文数据标签: 包括字母数字比、平均行长度、语言置信度分数、最大行长度、困惑度、毒性字符比等12种标签

数据集性能验证

- 模型训练: 进行了持续预训练、SFT和DPO训练

- 性能提升: 客观性能提升20%,主观胜率82%

行业分类数据量

| 行业类别 | 数据量 (GB) | 行业类别 | 数据量 (GB) |

|---|---|---|---|

| 编程 | 4.1 | 政治 | 326.4 |

| 法律 | 274.6 | 数学 | 5.9 |

| 教育 | 458.1 | 体育 | 442 |

| 金融 | 197.8 | 文学 | 179.3 |

| 计算机科学 | 46.9 | 新闻 | 564.1 |

| 技术 | 333.6 | 电影与电视 | 162.1 |

| 旅游 | 82.5 | 医学 | 189.4 |

| 农业 | 41.6 | 汽车 | 40.8 |

| 情感 | 31.7 | 人工智能 | 5.6 |

| 总计 (GB) | 3386.5 |

搜集汇总

数据集介绍

构建方式

IndustryCorpus_computer数据集的构建基于对超过100TB开源数据集的深度处理,包括WuDaoCorpora、BAAI-CCI、redpajama和SkyPile-150B等。通过应用22种行业数据处理操作符,对数据进行清洗和过滤,最终从原始数据中提取出3.4TB的高质量多行业分类中英文预训练数据集。其中,中文数据经过12种标签的标注,如字母数字比例、平均行长度、语言置信度分数等,以确保数据的专业性和可用性。

使用方法

IndustryCorpus_computer数据集的使用方法灵活多样,用户可以根据需要下载特定行业的子数据集。数据集适用于文本生成任务,用户可以通过继续预训练、SFT和DPO训练等方式,利用该数据集提升模型的行业应用性能。数据集的分割和标注设计使得用户能够便捷地进行特定领域的模型训练和验证。

背景与挑战

背景概述

IndustryCorpus_computer数据集是在推动企业智能化转型和创新发展的背景下创建的,旨在解决行业模型训练中数据量不足、质量低下以及缺乏领域专业知识的问题。该数据集由多个开源数据集(如WuDaoCorpora、BAAI-CCI、redpajama和SkyPile-150B)经过22种行业数据处理操作符的清洗和过滤,最终生成了3.4TB的高质量多行业分类中英文预训练数据。其中,中文数据1TB,英文数据2.4TB。数据集涵盖了医疗、教育、文学、金融、旅游、法律、体育、汽车、新闻等18个行业类别,并通过标注12种标签(如字母数字比例、平均行长度、语言置信度分数等)进一步提升了数据的可用性。该数据集的构建显著提升了行业模型的性能,特别是在医疗行业示范模型上的实验表明,其客观性能提升了20%,主观胜率达到82%。

当前挑战

IndustryCorpus_computer数据集在构建过程中面临多重挑战。首先,数据清洗和过滤的复杂性较高,需通过传统中文转换、电子邮件移除、IP地址移除、链接移除、Unicode修复等多种规则进行预处理,同时还需使用行业分类语言模型进行基于模型的过滤,以确保数据的准确性和专业性。其次,数据去重和标注工作量大,需通过MinHash文档级去重技术处理海量数据,并为中文数据添加多种标签以支持后续的模型训练。此外,数据集的规模庞大(总计3.4TB),如何高效地存储、分发和管理数据也是一个重要挑战。最后,尽管数据集在多个行业领域表现出色,但在特定领域的深度专业知识覆盖上仍有提升空间,需进一步优化数据分布和质量。

常用场景

经典使用场景

在计算机科学领域,IndustryCorpus_computer数据集被广泛应用于自然语言处理模型的训练与优化。该数据集通过提供大量高质量的计算机行业相关文本,支持文本生成、机器翻译、情感分析等任务的模型训练。其多语言特性(中英文)使得模型能够更好地适应全球化的应用场景,尤其是在跨语言信息处理和多语言对话系统中表现出色。

解决学术问题

IndustryCorpus_computer数据集有效解决了行业模型训练中数据量不足、质量低下以及领域专业知识匮乏的问题。通过引入22种行业数据处理操作符,该数据集从超过100TB的开源数据中筛选出3.4TB的高质量多行业分类数据,显著提升了模型的训练效果。其标注的12种标签进一步增强了数据的可用性,为学术研究提供了丰富的实验基础。

实际应用

在实际应用中,IndustryCorpus_computer数据集被用于构建和优化行业专用的大型语言模型。例如,在医疗行业示范模型的训练中,该数据集通过持续预训练、SFT和DPO训练,使模型在客观性能上提升了20%,主观胜率达到82%。这种性能提升直接推动了行业智能化转型,尤其是在医疗、教育、金融等领域的应用落地。

数据集最近研究

最新研究方向

在计算机科学领域,IndustryCorpus_computer数据集的最新研究方向聚焦于如何通过高质量的多行业分类数据提升大模型的性能。该数据集通过22种行业数据处理操作符对超过100TB的开源数据集进行清洗和过滤,最终构建了3.4TB的高质量中英文预训练数据。特别值得注意的是,中文数据经过12种标签的标注,包括字母数字比例、平均行长度、语言置信度分数等,这些标注为模型训练提供了更为精细的指导。此外,通过在医疗行业示范模型上的持续预训练、SFT和DPO训练,该数据集在客观性能上提升了20%,主观胜率达到了82%。这一成果不仅验证了数据集的有效性,也为计算机科学领域的大模型训练提供了新的数据支持。未来,该数据集有望在更多行业应用中发挥重要作用,推动行业智能化转型和创新发展。

以上内容由遇见数据集搜集并总结生成