VideoNavQA|视觉问答数据集|具身智能数据集

收藏VideoNavQA 数据集概述

数据集简介

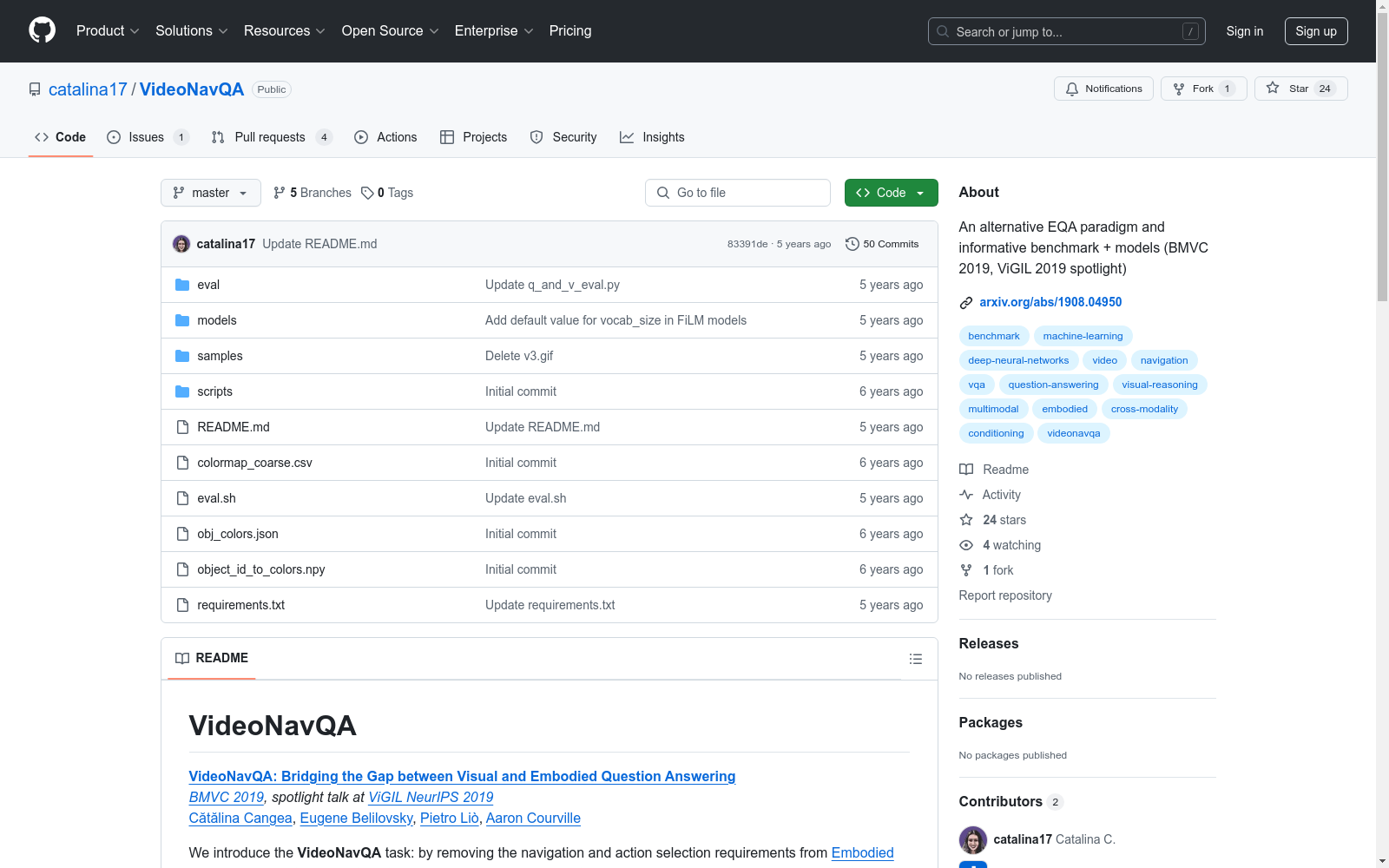

- 名称:VideoNavQA

- 任务:视觉推理任务,专注于回答与视频内容相关的问题,但不涉及导航和动作选择。

- 目标:提高视觉推理的难度,处理更复杂的推理问题。

- 相关论文:VideoNavQA: Bridging the Gap between Visual and Embodied Question Answering (BMVC 2019, ViGIL NeurIPS 2019)

数据集样例

-

-

-

-

样例问题:

- Where is the green rug next to the sofa?

- Are the computer and the bed the same color?

- What is the thing next to the tv stand located in the living room?

数据集获取

bash $ git clone https://github.com/catalina17/VideoNavQA $ virtualenv -p python3 videonavqa $ source videonavqa/bin/activate $ pip install -r requirements.txt

数据集链接

数据集统计

依赖

- 模型评估:

- Faster-RCNN (使用VGG-16预训练权重)

- 预训练对象检测器(从指定checkpoint加载)

- 数据生成工具:

- EmbodiedQA fork

- House3D fork

- SUNCG dataset

- SUNCG toolbox

模型运行

- 使用

eval.sh脚本运行FiLM-based模型 - 使用

q_and_v_test.py脚本进行模型测试

引用

@article{cangea2019videonavqa, title={VideoNavQA: Bridging the Gap between Visual and Embodied Question Answering}, author={Cangea, C{u{a}}t{u{a}}lina and Belilovsky, Eugene and Li{`o}, Pietro and Courville, Aaron}, journal={arXiv preprint arXiv:1908.04950}, year={2019} }

2000-2018年中国典型生态系统植物生长节律数据

该数据集涵盖了森林、草地、荒漠、沼泽、农田生态系统2000年-2020年CERN长期定位监测的植物物候数据和主要作生育期数据,包括木本植物、草本植物、水稻、小麦、玉米物候数据表,木本植物数据表有18个台站、291个物种的芽开放期、展叶期、开花始期、开花盛期、果实或种子成熟期、叶秋季变色期和落叶期共计3814条记录;草本植物数据表有22个台站、312个物种的萌动期、开花期、果实或种子成熟期、种子散布期和黄枯期共计3032条数据;水稻数据表有9个台站的出苗期、拔节期、蜡熟期等10个生育期共551条记录;小麦数据表有9个台站不同生育期382条记录;玉米数据表有18个台站不同生育期532条数据。

地球大数据科学工程 收录

中国行政区划数据

本项目为中国行政区划数据,包括省级、地级、县级、乡级和村级五级行政区划数据。数据来源于国家统计局,存储格式为sqlite3 db文件,支持直接使用数据库连接工具打开。

github 收录

LibriSpeech

LibriSpeech 是一个大约 1000 小时的 16kHz 英语朗读语音语料库,由 Vassil Panayotov 在 Daniel Povey 的协助下编写。数据来自 LibriVox 项目的已读有声读物,并经过仔细分割和对齐。

OpenDataLab 收录

糖尿病预测数据集

糖尿病相关的医学研究或者健康数据

AI_Studio 收录

Duke Lung Cancer Screening Dataset 2024 (DLCS 2024)

Duke Lung Cancer Screening Dataset 2024 (DLCS 2024) 是一个用于肺癌风险分类研究的数据集,随着低剂量胸部CT筛查项目的普及,该数据集变得越来越重要。

github 收录