YeungNLP/firefly-train-1.1M

收藏Hugging Face2023-04-10 更新2024-03-04 收录

下载链接:

https://hf-mirror.com/datasets/YeungNLP/firefly-train-1.1M

下载链接

链接失效反馈资源简介:

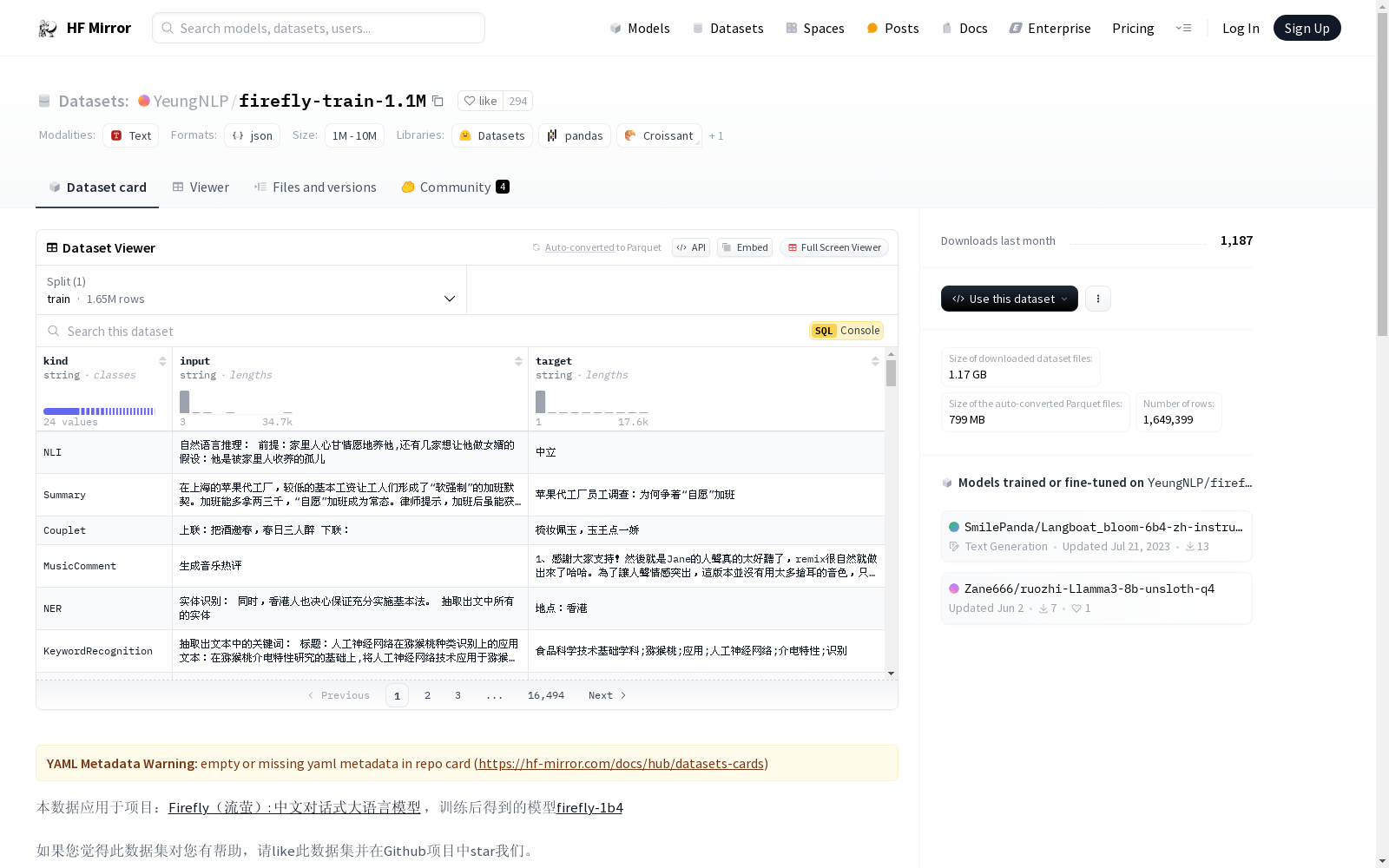

本数据应用于项目:[Firefly(流萤): 中文对话式大语言模型](https://github.com/yangjianxin1/Firefly) ,训练后得到的模型[firefly-1b4](https://huggingface.co/YeungNLP/firefly-1b4)

如果您觉得此数据集对您有帮助,请like此数据集并在Github项目中star我们。

我们收集了23个常见的中文数据集,对于每个任务,由人工书写若干种指令模板,保证数据的高质量与丰富度,数据量为115万 。数据分布如下图所示:

每条数据的格式如下,包含任务类型、输入、目标输出:

```json

{

"kind": "ClassicalChinese",

"input": "将下面句子翻译成现代文:\n石中央又生一树,高百余尺,条干偃阴为五色,翠叶如盘,花径尺余,色深碧,蕊深红,异香成烟,著物霏霏。",

"target": "大石的中央长着一棵树,一百多尺高,枝干是彩色的,树叶有盘子那样大,花的直径有一尺宽,花瓣深蓝色,花中飘出奇异的香气笼罩着周围,如烟似雾。"

}

```

训练数据集的token长度分布如下图所示,绝大部分数据的长度都小于600:

This dataset is developed for the project [Firefly (Liuying): A Chinese Conversational Large Language Model](https://github.com/yangjianxin1/Firefly), and the model trained from this dataset is [firefly-1b4](https://huggingface.co/YeungNLP/firefly-1b4).

If you find this dataset helpful, please like it and star our GitHub repository.

We collected 23 common Chinese datasets. For each task, we manually authored multiple instruction templates to ensure high quality and data richness, with a total of 1.15 million samples. The data distribution is illustrated in the following figure:

The format of each data entry is as follows, including task type, input, and target output:

json

{

"kind": "ClassicalChinese",

"input": "Translate the following sentence into modern Chinese: There grows another tree in the center of the large rock, over a hundred feet tall. Its branches and trunks spread out in five colors, with emerald leaves like plates. The flowers are about one foot in diameter, deep blue in color, with deep red stamens, and a strange fragrance rises like smoke, drifting lightly onto all things.",

"target": "There grows a tree in the center of the large rock, over a hundred feet tall. Its branches and trunks are colored in various hues, with emerald leaves as big as plates. The flowers are about one foot in diameter, with deep blue petals and deep red stamens, and a strange fragrance drifts around like smoke, lightly covering everything."

}

The token length distribution of the training dataset is shown in the figure below, where the vast majority of samples have a length of less than 600:

提供机构:

YeungNLP

原始信息汇总

数据集概述

数据集应用

本数据集应用于项目:Firefly(流萤): 中文对话式大语言模型,训练后得到的模型为firefly-1b4。

数据集内容

- 数据集规模:共收集了23个常见的中文数据集,总数据量为115万。

- 数据质量与丰富度:每个任务由人工书写若干种指令模板,确保数据的高质量与丰富度。

- 数据分布:数据分布详情请参考task_distribution。

数据格式

每条数据包含以下三个主要字段:

- kind (任务类型)

- input (输入)

- target (目标输出)

示例: json { "kind": "ClassicalChinese", "input": "将下面句子翻译成现代文: 石中央又生一树,高百余尺,条干偃阴为五色,翠叶如盘,花径尺余,色深碧,蕊深红,异香成烟,著物霏霏。", "target": "大石的中央长着一棵树,一百多尺高,枝干是彩色的,树叶有盘子那样大,花的直径有一尺宽,花瓣深蓝色,花中飘出奇异的香气笼罩着周围,如烟似雾。" }

数据集特征

- token长度分布:绝大部分数据的长度都小于600,详情请参考len_distribution.png。

搜集汇总

数据集介绍

构建方式

在构建YeungNLP/firefly-train-1.1M数据集时,研究团队精心挑选了23个常见的中文数据集,并针对每个任务设计了多种人工书写的指令模板,以确保数据的高质量和多样性。数据总量达到115万条,涵盖了广泛的任务类型,如古典中文翻译、现代文生成等。每条数据均包含任务类型、输入文本和目标输出,形成了一个结构化的训练集,旨在为中文对话式大语言模型Firefly提供丰富的训练资源。

使用方法

YeungNLP/firefly-train-1.1M数据集适用于训练中文对话式大语言模型,如Firefly。使用时,开发者可以根据数据集提供的任务类型和结构化数据格式,进行模型的训练和微调。数据集的高质量和多样性使得模型能够更好地理解和生成中文文本,适用于多种自然语言处理任务,如文本翻译、生成和对话系统开发。

背景与挑战

背景概述

在自然语言处理领域,特别是中文对话式大语言模型的研究中,YeungNLP团队推出的Firefly-train-1.1M数据集扮演了重要角色。该数据集由YeungNLP团队于近期创建,旨在支持其Firefly项目,一个致力于开发高效中文对话式大语言模型的开源项目。通过整合23个常见的中文数据集,并由人工设计多种指令模板,该数据集确保了数据的高质量和多样性,总数据量达到115万条。此数据集不仅为模型训练提供了丰富的语料,还显著推动了中文自然语言处理技术的发展,尤其是在对话生成和文本翻译等任务上。

当前挑战

尽管Firefly-train-1.1M数据集在丰富性和质量上取得了显著成就,但其构建和应用过程中仍面临若干挑战。首先,数据集的多样性要求在不同任务类型间保持平衡,这需要精确的数据选择和处理策略。其次,人工设计指令模板的过程既耗时又需专业知识,确保模板的高效性和适用性是一大挑战。此外,数据集的token长度分布显示大部分数据长度小于600,这可能限制了模型处理长文本的能力。最后,如何确保数据集在不同应用场景下的通用性和适应性,也是未来研究的重要方向。

常用场景

经典使用场景

在自然语言处理领域,YeungNLP/firefly-train-1.1M数据集被广泛应用于中文对话式大语言模型的训练。该数据集通过整合23个常见的中文数据集,并由人工设计多种指令模板,确保了数据的高质量和多样性。其经典使用场景包括但不限于中文文本翻译、古典文学现代文转换等任务,为模型提供了丰富的训练样本,从而显著提升了模型的语言理解和生成能力。

解决学术问题

YeungNLP/firefly-train-1.1M数据集在学术研究中解决了中文自然语言处理领域中数据稀缺和多样性不足的问题。通过提供高质量、多样化的训练数据,该数据集有助于研究人员开发和优化中文对话式大语言模型,推动了中文自然语言处理技术的发展。其意义在于为学术界提供了一个标准化的数据集,促进了相关研究的深入和创新。

实际应用

在实际应用中,YeungNLP/firefly-train-1.1M数据集训练的模型被广泛应用于中文文本处理、智能客服、教育辅助等多个领域。例如,在智能客服系统中,该模型能够准确理解用户的中文查询并提供相应的解答;在教育领域,模型可以辅助学生进行古典文学的现代文转换,提升学习效率。这些应用场景展示了数据集在实际业务中的巨大潜力和价值。

数据集最近研究

最新研究方向

在自然语言处理领域,YeungNLP/firefly-train-1.1M数据集的最新研究方向主要集中在提升中文对话式大语言模型的性能和多样性。该数据集通过整合23个常见的中文数据集,并设计多种指令模板,确保了数据的高质量和丰富度,从而为模型训练提供了坚实的基础。研究者们正致力于优化模型结构,以更好地处理复杂的中文语境,同时探索如何在保持模型轻量化的同时提升其对话生成能力。此外,数据集的广泛应用也促进了跨领域合作,推动了中文自然语言处理技术的整体进步。

以上内容由遇见数据集搜集并总结生成