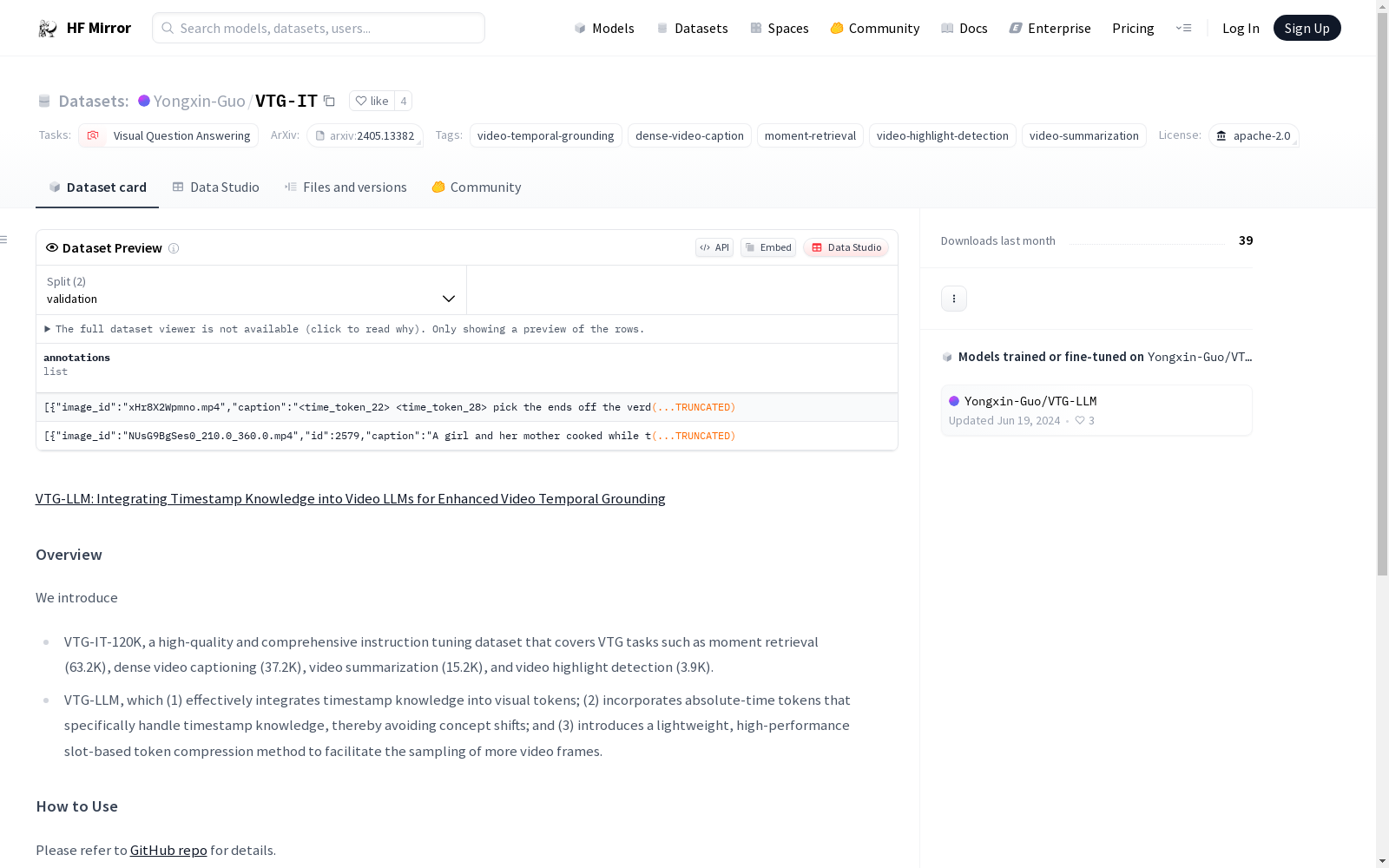

Yongxin-Guo/VTG-IT

收藏Hugging Face2024-06-19 更新2024-06-12 收录

下载链接:

https://hf-mirror.com/datasets/Yongxin-Guo/VTG-IT

下载链接

链接失效反馈资源简介:

VTG-IT-120K是一个高质量且全面的指令调优数据集,涵盖了视频时间定位(VTG)任务,包括时刻检索(63.2K)、密集视频字幕(37.2K)、视频摘要(15.2K)和视频亮点检测(3.9K)。此外,VTG-LLM模型有效地将时间戳知识整合到视觉令牌中,并引入了绝对时间令牌来处理时间戳知识,避免了概念转移,并引入了一种轻量级、高性能的基于槽的令牌压缩方法,以促进更多视频帧的采样。

VTG-IT-120K is a high-quality and comprehensive instruction tuning dataset that covers VTG tasks such as moment retrieval (63.2K), dense video captioning (37.2K), video summarization (15.2K), and video highlight detection (3.9K). Additionally, the VTG-LLM model effectively integrates timestamp knowledge into visual tokens, incorporates absolute-time tokens that specifically handle timestamp knowledge, thereby avoiding concept shifts, and introduces a lightweight, high-performance slot-based token compression method to facilitate the sampling of more video frames.

提供机构:

Yongxin-Guo

原始信息汇总

数据集概述

数据集名称

- VTG-IT-120K

数据集内容

- 包含多种视频时间定位任务的数据,具体包括:

- 时刻检索(63.2K)

- 密集视频字幕(37.2K)

- 视频摘要(15.2K)

- 视频亮点检测(3.9K)

数据集特点

- 高质量和全面性

- 用于指令调优

VTG-LLM技术特点

- 有效整合时间戳知识到视觉令牌中

- 引入绝对时间令牌,专门处理时间戳知识,避免概念偏移

- 采用轻量级、高性能的基于槽的令牌压缩方法,便于采样更多视频帧

引用信息

@article{guo2024vtg, title={VTG-LLM: Integrating Timestamp Knowledge into Video LLMs for Enhanced Video Temporal Grounding}, author={Guo, Yongxin and Liu, Jingyu and Li, Mingda and Tang, Xiaoying and Chen, Xi and Zhao, Bo}, journal={arXiv preprint arXiv:2405.13382}, year={2024} }

AI搜集汇总

数据集介绍

构建方式

Yongxin-Guo/VTG-IT数据集,经过精心策划与构建,涵盖了视频时序定位(VTG)任务的不同方面,包括时序检索、密集视频标注、视频摘要以及视频亮点检测等。该数据集由120K个高质量、综合性的指令调优样本组成,这些样本均匀覆盖了上述各类任务,确保了数据集的全面性和均衡性。

特点

该数据集的特点在于其高质量和综合性,不仅样本量大,而且覆盖了多个视频处理任务,使得它成为一个多功能的资源。VTG-IT-120K特别强调了时间戳知识的整合,通过引入绝对时间标记,避免了概念偏移,并通过轻量级、高性能的槽位基 token 压缩方法,实现了对更多视频帧的采样,提高了模型的泛化能力。

使用方法

使用该数据集时,用户可参考GitHub仓库中的详细说明进行操作。VTG-LLM模型的使用涉及将时间戳知识有效地整合到视觉token中,并通过特定处理保持时间知识的准确性。此外,用户应遵循Apache-2.0许可证的相关规定,合理使用和分享数据集资源。

背景与挑战

背景概述

Yongxin-Guo/VTG-IT数据集,由Guo Yongxin及其团队于2024年创建,旨在为视频时间定位(VTG)任务提供高质量、全面的教学调优数据集。该数据集覆盖了视频领域中的多个任务,包括时刻检索、密集视频注释、视频摘要和视频高亮检测等,包含了120K条指令调优数据。其研究背景源于提升视频语言模型在时间定位任务中的表现,对视频理解和生成领域产生了显著影响。

当前挑战

该数据集在构建过程中面临了诸多挑战,主要包括如何将时间戳知识有效融入视觉符号,处理时间戳知识的概念偏移,以及引入轻量级、高性能的槽位基于令牌压缩方法以实现更多视频帧的采样。此外,数据集所解决的领域问题包括如何提高视频时间定位的准确性和效率,以及如何在视频内容理解和生成中引入时间信息,从而提升模型的表现力和实用性。

常用场景

经典使用场景

在视觉问答领域,Yongxin-Guo/VTG-IT数据集的典型应用场景在于通过视频时间戳信息对视频内容进行精准定位。该数据集集成了多种视频理解任务,使研究者能够在一个统一的框架下,对视频的各个时间片段进行深入分析,从而回答关于视频内容的具体问题。

实际应用

在实际应用中,Yongxin-Guo/VTG-IT数据集可被用于提升视频内容分析系统的智能水平,如视频监控、智能教育、个性化推荐系统等。通过对视频时间片段的精准定位,这些系统能够更加高效地处理和响应用户的需求。

衍生相关工作

Yongxin-Guo/VTG-IT数据集的推出,催生了一系列相关的经典工作,如VTG-LLM模型,该模型将时间戳知识有效地融入视觉语言模型中,显著提升了视频时间定位的准确性,为视频理解领域的研究提供了新的方法和工具。

以上内容由AI搜集并总结生成