Database for Emotional Analysis of Music (DEAM)|音乐情感分析数据集|音频处理数据集

收藏数据集概述

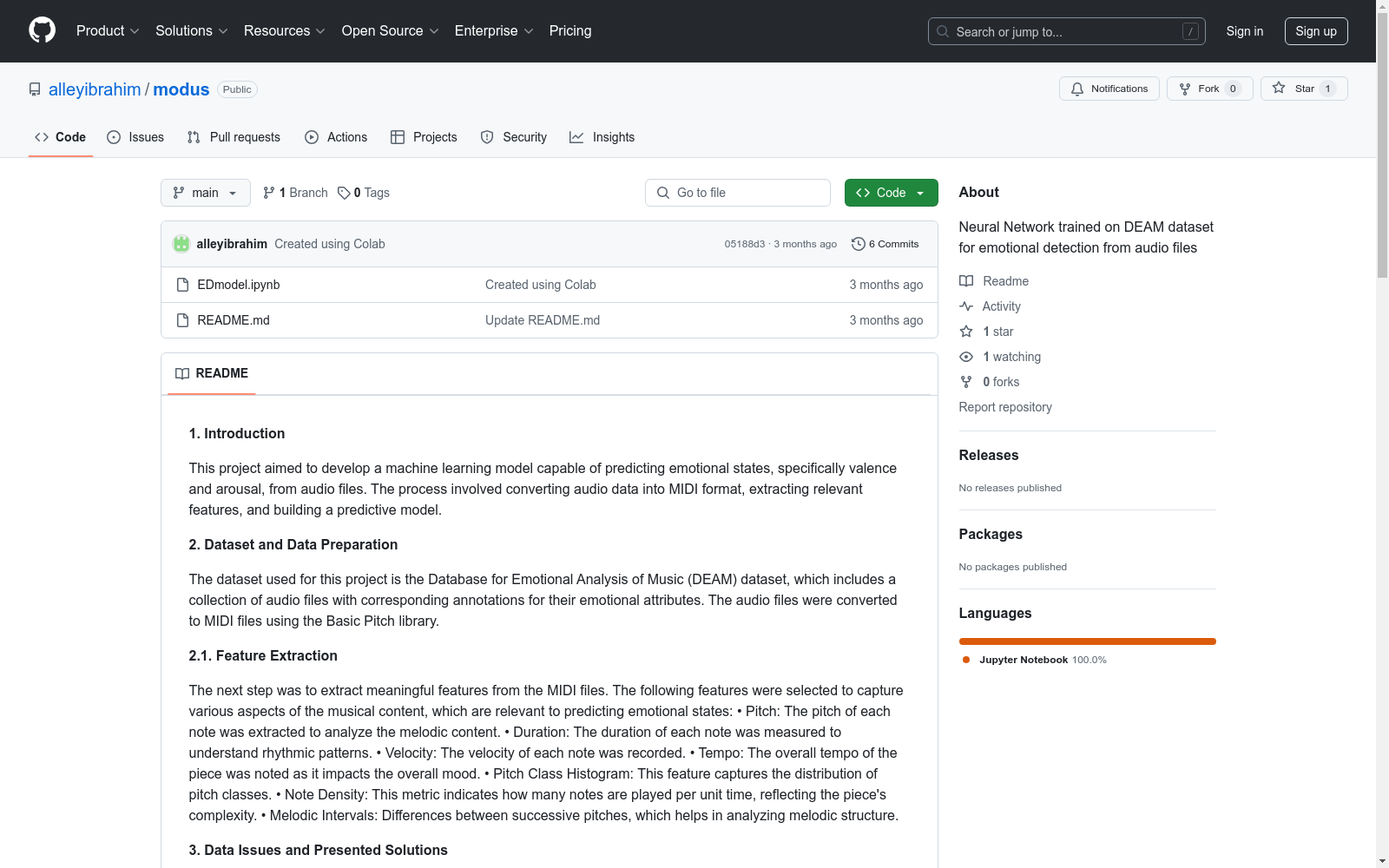

1. 简介

本项目旨在开发一个能够从音频文件中预测情绪状态(特别是情感和唤醒度)的机器学习模型。该过程涉及将音频数据转换为MIDI格式,提取相关特征,并构建预测模型。

2. 数据集和数据准备

本项目使用的数据集是音乐情感分析数据库(DEAM),该数据集包含一系列音频文件及其对应的情感属性注释。音频文件通过Basic Pitch库转换为MIDI文件。

2.1. 特征提取

从MIDI文件中提取了以下特征以捕捉与预测情感状态相关的音乐内容:

- 音高:提取每个音符的音高以分析旋律内容。

- 持续时间:测量每个音符的持续时间以理解节奏模式。

- 速度:记录每个音符的速度。

- 速度:记录每个音符的速度。

- 音调类别直方图:捕捉音调类别的分布。

- 音符密度:指示每单位时间播放的音符数量,反映作品的复杂性。

- 旋律间隔:连续音高之间的差异,有助于分析旋律结构。

3. 数据问题及解决方案

数据集包含缺失值,特别是在时间序列特征中,由于原始音频文件的长度不同,一些MIDI文件不包含连续的音符序列。为了处理这个问题,模型中引入了自定义掩码层以有效管理这些缺失值。

4. 模型架构及问题解决

最初选择了CNN,但经过进一步研究,决定转向RNN,因为RNN更适合处理MIDI特征等时间序列或序列数据。

4.1. 第一模型

第一个RNN模型包含两个SimpleRNN层,每个层有64个单元,并实现了一个掩码层以处理不同的序列长度。最终的密集层用于预测情感和唤醒度的平均值和标准差。

4.1.1. 层

- RNN层:两个SimpleRNN层,每个层有64个单元。

- 掩码层:用于处理不同的序列长度。

- 密集输出层:用于预测情感和唤醒度的平均值和标准差。

4.1.2. 问题

- 零损失:通过调整输入形状、特征表示和数据/模型兼容性问题,重新校准了模型的损失函数。

- 输入形状问题:通过简化模型解决了输入形状问题。

4.2. 第二模型

第二个模型是一个更简化的模型,使用密集神经网络处理固定大小的输入特征。

4.2.1. 层

- 密集层:两个密集层,分别有32和16个神经元,使用ReLU激活函数。

- 自定义激活输出层:确保非负预测。

4.2.2. 问题

- 负预测:通过开发自定义激活函数解决了负预测问题。

4.3. 知识转移

通过理解初始复杂模型的局限性,并将其应用于设计更简单的模型。

5. 模型输出

每个输出对应于特定的属性:

- 情感平均值:指示音乐的平均积极或消极程度。

- 情感标准差:测量情感色调的变化。

- 唤醒度平均值:反映平均能量水平。

- 唤醒度标准差:显示能量水平的变化。

6. 结果

- 模型1(基于RNN):在验证集上实现了0.4437的损失,有效处理了中等范围的情感和唤醒度值。

- 模型2(密集神经网络):实现了约1.057的验证MSE,适用于基于静态特征的快速和高效预测。

Figshare

Figshare是一个在线数据共享平台,允许研究人员上传和共享各种类型的研究成果,包括数据集、论文、图像、视频等。它旨在促进科学研究的开放性和可重复性。

figshare.com 收录

WideIRSTD Dataset

WideIRSTD数据集包含七个公开数据集:SIRST-V2、IRSTD-1K、IRDST、NUDT-SIRST、NUDT-SIRST-Sea、NUDT-MIRSDT、Anti-UAV,以及由国防科技大学团队开发的数据集,包括模拟陆基和太空基数据,以及真实手动标注的太空基数据。数据集包含具有各种目标形状(如点目标、斑点目标、扩展目标)、波长(如近红外、短波红外和热红外)、图像分辨率(如256、512、1024、3200等)的图像,以及不同的成像系统(如陆基、空基和太空基成像系统)。

github 收录

中国近海台风路径集合数据集(1945-2024)

1945-2024年度,中国近海台风路径数据集,包含每个台风的真实路径信息、台风强度、气压、中心风速、移动速度、移动方向。 数据源为获取温州台风网(http://www.wztf121.com/)的真实观测路径数据,经过处理整合后形成文件,如使用csv文件需使用文本编辑器打开浏览,否则会出现乱码,如要使用excel查看数据,请使用xlsx的格式。

国家海洋科学数据中心 收录

Rail-DB

Rail-DB是由深圳技术大学创建的铁路检测数据集,包含7432对图像及其标注,涵盖多种光照、道路结构和视角条件。数据集中的轨道通过多边形进行标注,并根据背景被分为九种场景。Rail-DB旨在推动铁路检测算法的进步和比较,通过提供多样化的真实世界铁路图像,增强算法的鲁棒性。此外,数据集的创建过程包括从真实世界火车视频中获取图像,通过粗略和精细两个阶段进行标注,确保标注的准确性和完整性。Rail-DB的应用领域主要集中在铁路异常检测,特别是铁路区域的识别,以提高铁路安全和维护效率。

arXiv 收录

553个真实世界的半结构化访谈数据集

该数据集包含553个真实世界的半结构化访谈,每个访谈都与临床诊断结果配对,用于评估抑郁症、焦虑症和创伤后应激障碍等精神健康问题的早期诊断。数据集来自美国多个行为研究项目,参与者回答了五个关于日常生活、挑战性事件、应对策略、不愉快事件和积极经历的标准化问题。访谈被记录并转录,每个访谈的平均长度约为2,955个单词。该数据集旨在为自然语言处理模型提供真实且具有生态效度的基准,以评估其从自然语言中推断精神健康问题的能力。

arXiv 收录