MMCU

收藏github2023-04-01 更新2025-02-08 收录

下载链接:

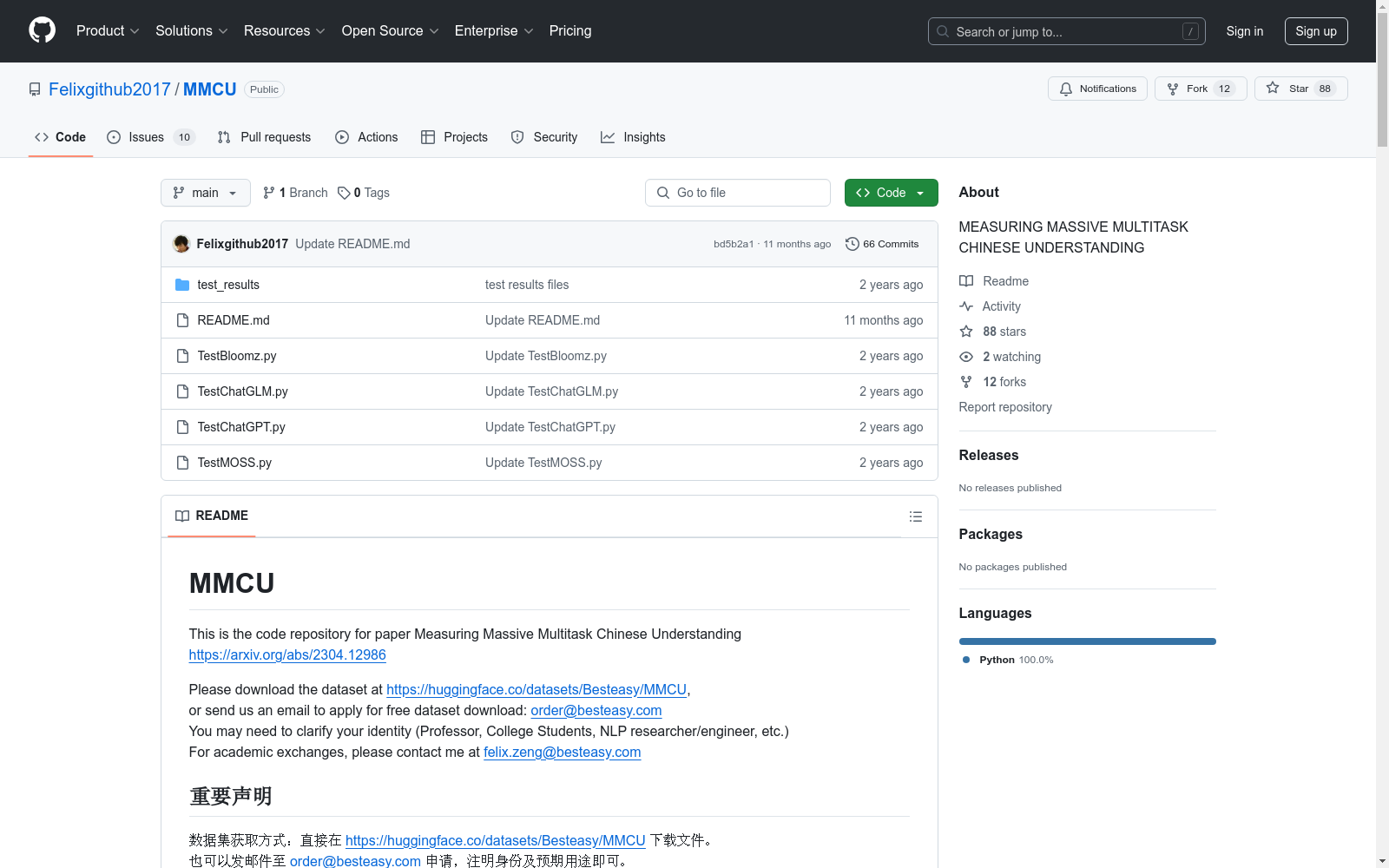

https://github.com/Felixgithub2017/MMCU

下载链接

链接失效反馈资源简介:

MMCU数据集包含了11845道中文选择题,涵盖医学、法律、心理学和教育等学科的25个子任务。这些题目由专家精心整理,手工收集自免费的在线资源库,包括法律资格考试、心理咨询师认证测试和高考等材料。该数据集的评估方法采用基于代码的评估方式。

The MMCU dataset contains 11,845 Chinese multiple-choice questions, covering 25 subtasks across disciplines including medicine, law, psychology, and education. These questions were carefully curated by experts and manually collected from free online resource repositories, such as materials from national legal qualification examinations, psychological counselor certification tests, and the National College Entrance Examination (Gaokao). A code-based evaluation approach is utilized for the assessment of this dataset.

提供机构:

LanguageX AI Lab

创建时间:

2023-04-01

原始信息汇总

MMCU 数据集概述

数据集简介

MMCU(Massive Multitask Chinese Understanding)数据集是一个用于评估大规模多任务中文理解能力的数据集。该数据集旨在测试模型在多个领域(如医疗、法律、心理学、教育等)中的语义理解能力。

数据集获取

- 下载地址:https://huggingface.co/datasets/Besteasy/MMCU

- 申请方式:发送邮件至 order@besteasy.com 申请,需注明身份及预期用途。

数据集用途

- 用于评测模型在中文多任务理解上的性能。

- 帮助研究者验证训练策略的有效性。

- 数据集公开评测方式、评测数据集和评测记录,确保可复现性。

数据集更新

- 2023.8.11:发布中文大模型生成能力自动化评测基准CG-Eval,详见论文 Evaluating the Generation Capabilities of Large Chinese Language Models。

- 2023.5.15:对所有模型进行了重新评测,结果上传至

test_results文件夹。 - 2023.5.13:修正了部分题目的缺失答案。

- 2023.5.12:修正了模型预测答案匹配方法,优化了评测结果文件格式。

评测结果

四大领域平均分数

| 领域 | zero-shot | bloomz_560m | bloomz_1b1 | bloomz_3b | bloomz_7b1_mt | ChatGLM 6B | MOSS 16B | GPT-3.5-turbo |

|---|---|---|---|---|---|---|---|---|

| 医疗 | 0.298 | 0.213 | 0.374 | 0.364 | 0.338 | 0.234 | 0.512 | |

| 法律 | 0.163 | 0.14 | 0.18 | 0.174 | 0.169 | 0.133 | 0.239 | |

| 心理学 | 0.201 | 0.187 | 0.319 | 0.346 | 0.288 | 0.211 | 0.447 | |

| 教育 | 0.247 | 0.275 | 0.315 | 0.316 | 0.333 | 0.253 | 0.455 | |

| 平均 | 0.227 | 0.204 | 0.297 | 0.300 | 0.282 | 0.208 | 0.413 |

医疗领域分数

| 子领域 | zero-shot | bloomz_560m | bloomz_1b1 | bloomz_3b | bloomz_7b1_mt | ChatGLM6B | MOSS 16B | GPT-3.5-turbo |

|---|---|---|---|---|---|---|---|---|

| 医学三基 | 0.311 | 0.274 | 0.375 | 0.415 | 0.371 | 0.231 | 0.552 | |

| 药理学 | 0.265 | 0.235 | 0.38 | 0.36 | 0.255 | 0.285 | 0.52 | |

| 护理学 | 0.33 | 0.278 | 0.372 | 0.368 | 0.339 | 0.238 | 0.516 | |

| 病理学 | 0.312 | 0.267 | 0.392 | 0.341 | 0.358 | 0.278 | 0.506 | |

| 临床医学 | 0.347 | 0.198 | 0.426 | 0.554 | 0.455 | 0.317 | 0.693 | |

| 传染病学 | 0.295 | 0.242 | 0.398 | 0.46 | 0.401 | 0.254 | 0.587 | |

| 外科学 | 0.365 | 0.251 | 0.397 | 0.374 | 0.361 | 0.279 | 0.525 | |

| 解剖学 | 0.182 | 0.136 | 0.227 | 0.227 | 0.273 | 0.136 | 0.5 | |

| 医学影像学 | 0.45 | 0.05 | 0.6 | 0.45 | 0.35 | 0.25 | 0.55 | |

| 寄生虫学 | 0.33 | 0.24 | 0.39 | 0.25 | 0.33 | 0.18 | 0.43 | |

| 免疫学 | 0.282 | 0.147 | 0.331 | 0.344 | 0.319 | 0.178 | 0.515 | |

| 儿科学 | 0.39 | 0.258 | 0.385 | 0.38 | 0.399 | 0.263 | 0.54 | |

| 皮肤性病学 | 0.255 | 0.255 | 0.392 | 0.51 | 0.471 | 0.275 | 0.627 | |

| 组织胚胎学 | 0.058 | 0.13 | 0.208 | 0.188 | 0.149 | 0.143 | 0.364 | |

| 药物分析学 | 0.292 | 0.236 | 0.333 | 0.236 | 0.236 | 0.208 | 0.25 | |

| 医疗平均分 | 0.298 | 0.213 | 0.374 | 0.364 | 0.338 | 0.234 | 0.512 |

教育领域分数

| 子领域 | zero-shot | bloomz_560m | bloomz_1b1 | bloomz_3b | bloomz_7b1_mt | ChatGLM6B | MOSS 16B | GPT-3.5-turbo |

|---|---|---|---|---|---|---|---|---|

| 语文 | 0.233 | 0.283 | 0.248 | 0.205 | 0.256 | 0.233 | 0.31 | |

| 数学 | 0.251 | 0.257 | 0.281 | 0.325 | 0.307 | 0.257 | 0.427 | |

| 物理 | 0.173 | 0.208 | 0.185 | 0.202 | 0.256 | 0.208 | 0.327 | |

| 化学 | 0.28 | 0.34 | 0.28 | 0.14 | 0.3 | 0.28 | 0.44 | |

| 政治 | 0.239 | 0.255 | 0.329 | 0.401 | 0.329 | 0.268 | 0.545 | |

| 历史 | 0.279 | 0.296 | 0.421 | 0.432 | 0.448 | 0.245 | 0.513 | |

| 地理 | 0.255 | 0.271 | 0.336 | 0.411 | 0.346 | 0.284 | 0.478 | |

| 生物 | 0.262 | 0.287 | 0.443 | 0.414 | 0.422 | 0.245 | 0.599 | |

| 平均 | 0.247 | 0.275 | 0.315 | 0.316 | 0.333 | 0.253 | 0.455 |

使用说明

- zero-shot测试:不提供示例。

- few-shot测试:提供五个示例。

示例代码

python

zero-shot test for chatgpt

python TestChatGPT.py

--ntrain 0

--data_dir MMCU_dataset_path

--save_dir path_for_test_results

few-shot test for chatgpt

python TestChatGPT.py

--ntrain 5

--data_dir MMCU_dataset_path

--save_dir path_for_test_results

引用

如果您在研究中使用了该数据集,请引用以下论文:

@misc{zeng2023measuring, title={Measuring Massive Multitask Chinese Understanding}, author={Hui Zeng}, year={2023}, eprint={2304.12986}, archivePrefix={arXiv}, primaryClass={cs.CL} }

许可证

MMCU数据集采用 Creative Commons Attribution-NonCommercial-ShareAlike 4.0 International License 许可。

搜集汇总

数据集介绍

构建方式

MMCU数据集的构建基于大规模多任务中文理解的需求,涵盖了医疗、法律、心理学和教育等多个领域。数据集的构建过程包括从专业文献、教材和实际案例中提取问题,并经过专家团队的严格审核,确保问题的准确性和代表性。每个问题都配有标准答案,并通过多次迭代修正,确保数据的高质量。

使用方法

MMCU数据集的使用方法灵活多样,支持零样本和少样本测试。用户可以通过提供的Python脚本对ChatGPT、Bloomz、ChatGLM和MOSS等模型进行测试。测试时,用户需指定训练样本数量(如零样本或五样本),并设置数据目录和结果保存路径。通过这种方式,研究者可以方便地评估模型在不同任务上的表现,并验证其训练策略的有效性。

背景与挑战

背景概述

MMCU数据集由Hui Zeng及其团队于2023年创建,旨在评估大规模多任务中文理解能力。该数据集由LanguageX AI Lab主导开发,涵盖了医疗、法律、心理学和教育等多个领域,旨在为中文自然语言处理(NLP)领域提供一个全面的评测基准。通过公开数据集和评测结果,MMCU为研究者提供了一个透明且可复现的框架,以验证和改进中文大模型的性能。该数据集的发布不仅推动了中文NLP领域的发展,还为跨领域知识理解提供了新的研究方向。

当前挑战

MMCU数据集在构建和应用过程中面临多重挑战。首先,多领域知识的整合要求数据集具备高度的多样性和复杂性,这对数据标注和验证提出了极高的要求。其次,中文语言的歧义性和多义性增加了模型理解的难度,尤其是在法律和医学等专业领域。此外,数据集的构建过程中,如何确保数据的准确性和一致性也是一个重要挑战,尤其是在处理多选题和复杂语义时。最后,尽管MMCU为中文大模型提供了评测基准,但如何进一步提升模型的泛化能力和跨领域理解能力,仍然是未来研究的关键挑战。

常用场景

经典使用场景

MMCU数据集广泛应用于中文大模型的多任务理解能力评测。通过涵盖医疗、法律、心理学、教育等多个领域的题目,该数据集能够全面评估模型在不同领域的语义理解能力。研究者可以利用该数据集进行零样本或少样本测试,验证模型在未见过任务上的泛化能力。

解决学术问题

MMCU数据集解决了中文大模型在多任务理解能力评测中的标准化问题。通过提供涵盖多个领域的测试题目,该数据集为研究者提供了一个统一的评测基准,帮助评估模型在不同领域的表现。这不仅有助于发现模型的潜在缺陷,还为模型的改进提供了明确的方向,推动了中文自然语言处理领域的发展。

实际应用

在实际应用中,MMCU数据集被广泛用于评估和优化中文大模型的性能。例如,医疗领域的模型可以通过该数据集进行测试,确保其在医学知识理解上的准确性。教育领域的模型也可以通过该数据集进行验证,提升其在教学辅助中的应用效果。此外,该数据集还为法律、心理学等领域的模型提供了重要的评测依据。

数据集最近研究

最新研究方向

近年来,随着中文大模型在自然语言处理领域的快速发展,MMCU数据集作为衡量模型多任务理解能力的重要基准,受到了广泛关注。该数据集涵盖了医疗、法律、心理学和教育等多个领域,旨在全面评估模型在复杂中文语境下的表现。当前的研究热点主要集中在如何通过改进模型架构和训练策略来提升模型在MMCU上的表现,尤其是在零样本和少样本学习场景下的性能优化。此外,随着MMCU姊妹篇CG-Eval的发布,研究者们开始探索模型在生成任务中的能力,进一步推动了中文大模型在理解和生成任务中的协同发展。这些研究不仅为中文大模型的性能评估提供了科学依据,也为未来多模态、多任务学习的研究奠定了基础。

以上内容由遇见数据集搜集并总结生成