Chinese-LiPS

收藏arXiv2025-04-21 更新2025-04-23 收录

下载链接:

https://kiri0824.github.io/Chinese-LiPS/

下载链接

链接失效反馈官方服务:

资源简介:

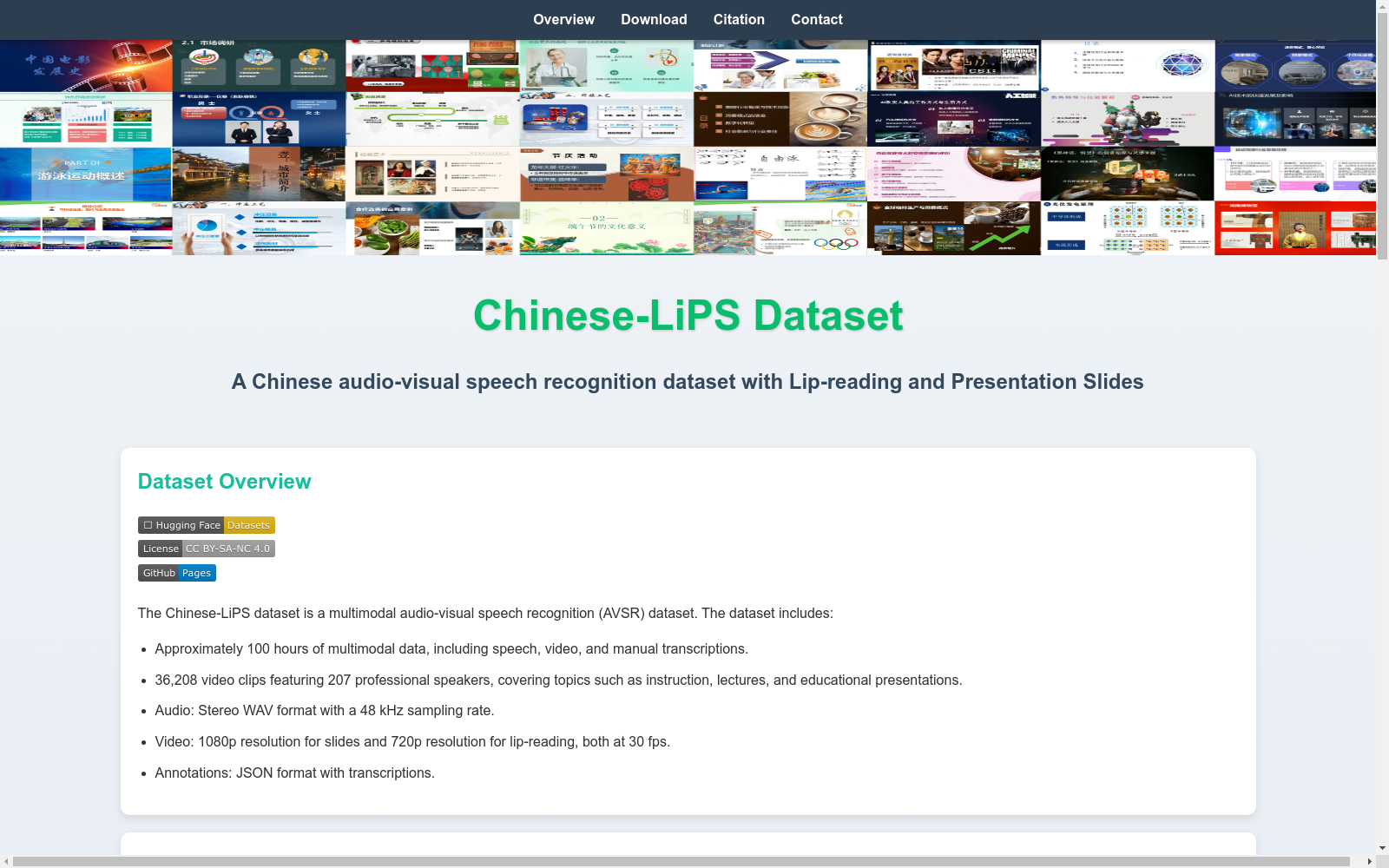

Chinese-LiPS是一个高质量的多模态中文语音识别数据集,包含100小时的语音、视频和相应的手动转录。该数据集独特地结合了唇读视频和演讲者的幻灯片,使音频视觉语音识别任务得到了更全面的探索。幻灯片内容由领域专家精心设计,确保了视觉图像的质量和丰富性。该数据集旨在帮助自动语音识别任务,特别是在处理发音模糊和领域特定术语等挑战时,通过整合所有可能有价值的视觉信息来进一步改善性能。

Chinese-LiPS is a high-quality multimodal Chinese speech recognition dataset containing 100 hours of speech, video, and corresponding manual transcriptions. It uniquely combines lip-reading videos and speakers' slides, enabling a more comprehensive exploration of audio-visual speech recognition tasks. The slide content is meticulously designed by domain experts, ensuring the quality and richness of the visual materials. This dataset aims to facilitate automatic speech recognition (ASR) tasks, particularly when addressing challenges such as indistinct pronunciation and domain-specific terminology, by integrating all potentially valuable visual information to further improve performance.

提供机构:

南开大学计算机学院

创建时间:

2025-04-21

搜集汇总

数据集介绍

构建方式

Chinese-LiPS数据集的构建过程体现了多模态数据采集的前沿方法。研究团队通过专业领域专家精心设计的演示文稿,结合207名专业演讲者在安静环境下的高质量录音,确保了数据源的可靠性和一致性。该数据集包含100小时的语音、视频及人工转录文本,特别之处在于同时采集了唇读视频和演讲者使用的演示幻灯片,形成了独特的视听-文本多模态结构。所有数据组件均经过严格的编辑和对齐处理,保证了时间同步精度,其中演示幻灯片内容避免了大量文本堆积,更注重视觉元素与演讲内容的有机融合。

使用方法

在使用Chinese-LiPS进行语音识别研究时,建议采用多模态融合的技术路线。研究团队提供的LiPS-AVSR流程展示了标准范式:通过PaddleOCR提取幻灯片文本信息,结合InternVL2模型获取视觉语义特征,将两类视觉线索以关键词形式整合至Whisper模型的提示模板中。实际应用中,可根据任务需求灵活配置输入模态,单独使用唇读特征可改善8%的识别准确率,单独使用幻灯片信息可提升25%,而多模态联合训练可实现35%的性能增益。对于中文特定领域术语识别,建议重点利用幻灯片的视觉语义特征;针对口语填充词还原,则更适合发挥唇读模态的优势。

背景与挑战

背景概述

Chinese-LiPS是由南开大学计算机学院的研究团队于2024年发布的首个融合唇读和演示文稿的多模态中文视听语音识别数据集。该数据集包含100小时的专业演讲视频,涵盖9个热门社会领域主题,由207名演讲者在受控环境中录制,并辅以领域专家精心设计的演示文稿。作为中文AVSR领域的重要资源,Chinese-LiPS突破了传统数据集仅关注单一视觉线索的局限,通过同步提供唇部运动视频和演示文稿内容,为探索多模态语音识别中不同视觉线索的互补性提供了全新平台。其创新性的数据构建方式显著提升了模型在专业术语识别和环境鲁棒性方面的表现,为教育、会议等实际应用场景提供了更精准的语音识别解决方案。

当前挑战

Chinese-LiPS主要解决视听语音识别领域的两大核心挑战:在领域问题方面,针对中文语音识别中专业术语识别率低、同音词歧义等问题,数据集通过融合演示文稿的语义信息与唇读的发音特征,有效提升了模型在复杂语境下的理解能力;在构建过程中,研究团队需要克服多模态数据对齐精度控制、跨模态质量一致性维护等技术难题,特别是确保唇读视频的清晰度与演示文稿内容的专业深度。此外,如何平衡不同主题领域的术语覆盖度,以及处理中文特有的声调变化与方言干扰,都成为数据集构建过程中需要精细调控的关键挑战。

常用场景

经典使用场景

在语音识别领域,尤其是在嘈杂环境或特定领域术语较多的场景中,Chinese-LiPS数据集通过整合唇读和演示文稿幻灯片信息,为多模态语音识别研究提供了丰富的数据支持。该数据集特别适用于教育讲座、专业演讲等场景,其中演示文稿的视觉信息与演讲者的唇部动作同步,为模型提供了额外的上下文线索。

解决学术问题

Chinese-LiPS数据集解决了多模态语音识别中视觉信息利用不足的问题。传统方法通常仅依赖唇读或背景视频,而该数据集通过结合唇读和演示文稿幻灯片信息,显著提升了语音识别的准确性和鲁棒性。实验表明,唇读和幻灯片信息分别提升了8%和25%的识别性能,综合提升达到35%,有效应对了模糊语音和领域术语的挑战。

实际应用

在实际应用中,Chinese-LiPS数据集可广泛应用于在线教育、会议记录和实时字幕生成等领域。例如,在教育场景中,通过结合幻灯片内容与教师的唇部动作,系统能够更准确地识别专业术语和复杂概念。此外,该数据集还可用于开发辅助听障人士的技术,提供更精准的语音转文字服务。

数据集最近研究

最新研究方向

随着多模态学习在语音识别领域的深入发展,Chinese-LiPS数据集通过融合唇读和演示文稿幻灯片两种视觉模态,为中文视听语音识别(AVSR)研究开辟了新方向。该数据集不仅填补了高质量中文多模态数据集的空白,更通过实验验证了不同视觉线索的互补性——唇读信息主要解决发音相关的删除错误,而幻灯片提供的语义上下文则有效纠正专业术语的替换错误。当前研究热点集中在如何利用预训练视觉语言模型(如InternVL)提取幻灯片中的深层语义特征,并与传统OCR技术相结合,构建更鲁棒的跨模态注意力机制。这一方向对于教育、会议等场景下的语音识别性能提升具有重要意义,特别是在处理专业词汇、同音词和背景噪声等挑战时展现出独特优势。

相关研究论文

- 1Chinese-LiPS: A Chinese audio-visual speech recognition dataset with Lip-reading and Presentation Slides南开大学计算机学院 · 2025年

以上内容由遇见数据集搜集并总结生成