InstructionWild v2

收藏github2023-06-01 更新2025-01-17 收录

下载链接:

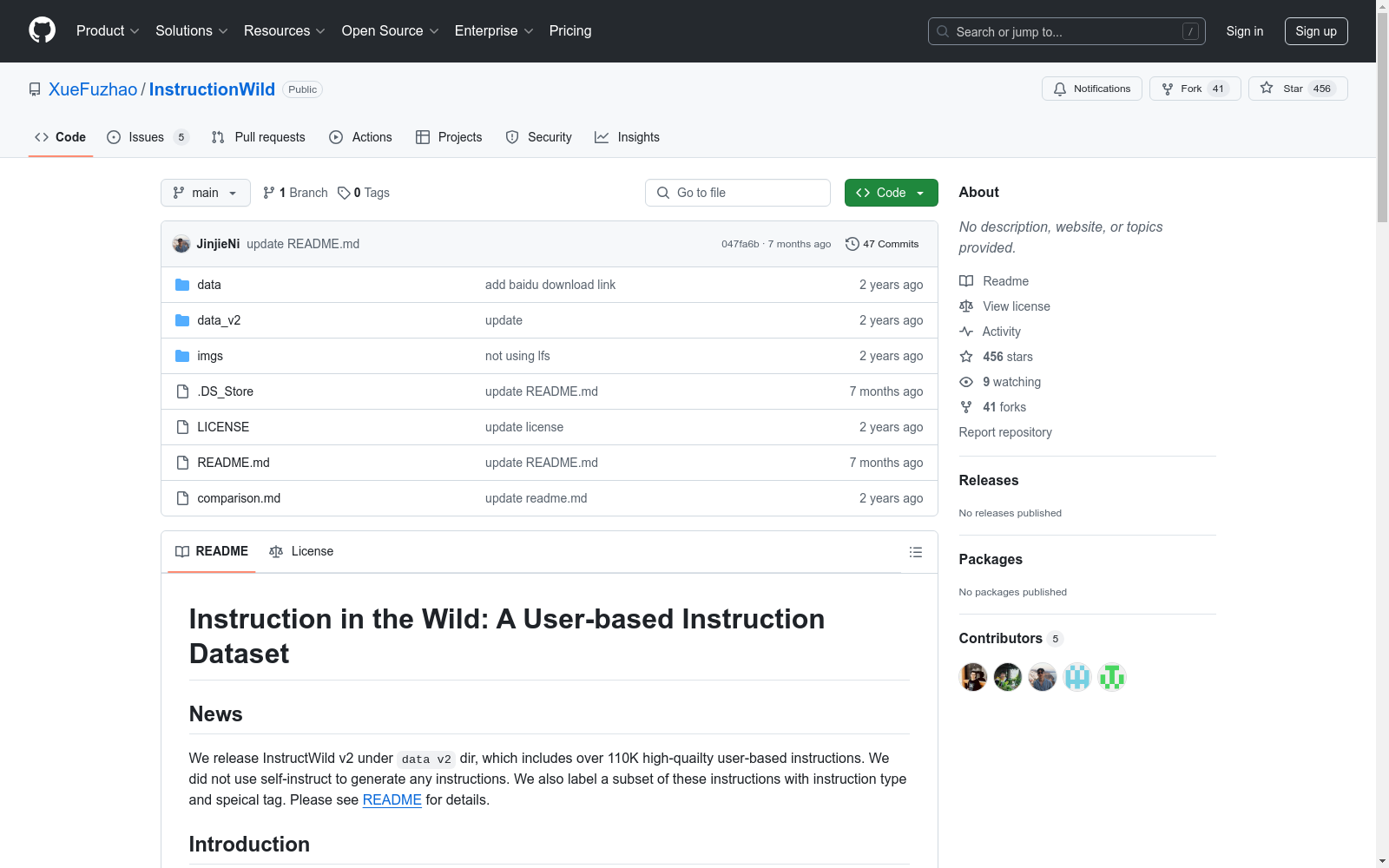

https://github.com/XueFuzhao/InstructionWild

下载链接

链接失效反馈资源简介:

The InstructionWild v2 dataset comprises approximately 110K instructions gathered from sources such as social media and code repositories. It provides additional information, including instruction types and special labels. The dataset is suitable for non-commercial research purposes.

InstructionWild v2数据集包含约11万条采集自社交媒体与代码仓库等数据源的指令。该数据集附带额外信息,涵盖指令类型与特殊标签,仅可用于非商业性研究用途。

提供机构:

National University of Singapore

创建时间:

2023-06-01

原始信息汇总

Instruction in the Wild: A User-based Instruction Dataset

数据集概述

- 数据集名称: Instruction in the Wild

- 版本: v1 和 v2

- 数据量: v2 包含超过 110K 条高质量用户生成的指令,v1 包含 429 条指令

- 语言: 英文和中文

- 数据格式: 与 Alpaca 数据集格式相同,指令没有输入字段

数据集特点

- 多样性: 数据集中的指令非常多样化,涵盖了生成、开放式问答和头脑风暴等类型

- 数据来源: 从 ChatGPT 使用分享中收集,未使用自生成指令

- 标注: v2 数据集中部分指令标注了指令类型和特殊标签

数据收集

- v1 数据收集: 从 Twitter 上抓取了 700 多条噪声指令,经过筛选后保留了 429 条高质量指令

- v2 数据收集: 收集了超过 110K 条指令,未使用自生成指令

数据集应用

- 模型训练: Colossal AI 使用该数据集训练了 ColossalChat 模型

- 模型改进: 数据集在生成、开放式问答和头脑风暴等指令类型上提升了模型的能力

数据集局限性

- LLaMA 微调模型的局限性:

- 缺乏计数能力

- 缺乏逻辑推理和计算能力

- 倾向于重复最后一句话

- 多语言表现不佳

- 数据集的局限性:

- 缺乏总结能力

- 缺乏多轮对话和角色扮演指令

- 缺乏自我认知指令

- 安全性问题:当输入包含虚假事实时,模型会编造虚假事实和解释

未来计划

- 待完成: 更大的数据集

作者

引用

bibtex @misc{instructionwild, author = {Jinjie Ni and Fuzhao Xue and Kabir Jain and Mahir Hitesh Shah and Zangwei Zheng and Yang You }, title = {Instruction in the Wild: A User-based Instruction Dataset}, year = {2023}, publisher = {GitHub}, journal = {GitHub repository}, howpublished = {url{https://github.com/XueFuzhao/InstructionWild}}, }

搜集汇总

数据集介绍

构建方式

InstructionWild v2数据集的构建采用了用户生成的指令数据,而非自生成指令。数据来源主要是ChatGPT的使用分享,涵盖了超过110,000条高质量的指令。数据收集过程中,团队从Twitter等平台爬取了大量指令,并通过筛选保留了高质量的指令。此外,团队还参考了Alpaca数据集的生成方法,使用OpenAI API生成了52,000条指令及其响应,确保了数据的多样性和广泛性。数据集分为英文和中文两个版本,分别独立生成。

特点

InstructionWild v2数据集的特点在于其多样性和高质量。数据集中包含了大量用户生成的指令,涵盖了生成、开放式问答和头脑风暴等多种类型,反映了用户在社交媒体上的真实需求。数据集还标注了部分指令的类型和特殊标签,便于进一步的研究和应用。与Alpaca数据集相比,InstructionWild v2的指令更加多样化,覆盖了更广泛的主题,且无需人工干预生成输出,减少了人为偏差。

使用方法

InstructionWild v2数据集的使用方法与Alpaca数据集保持一致,便于快速上手。数据格式简洁,每条指令仅包含指令内容,不包含输入字段。用户可以直接将数据集用于语言模型的微调,尤其是在生成、开放式问答和头脑风暴等任务上表现出色。此外,数据集还提供了详细的标签信息,用户可以根据需求进行细粒度的任务划分和模型训练。数据集的开源性质也为研究人员提供了便利,能够加速大规模语言模型的研究进程。

背景与挑战

背景概述

InstructionWild v2数据集由Jinjie Ni、Fuzhao Xue等研究人员于2023年发布,旨在为大型语言模型的指令微调提供更丰富和多样化的数据支持。该数据集包含超过110,000条高质量用户生成的指令,涵盖了生成、开放问答和头脑风暴等多种类型。与OpenAI未公开的用户指令数据集不同,InstructionWild v2通过从ChatGPT使用分享中收集数据,避免了自生成指令的局限性。该数据集已被Colossal AI用于训练ColossalChat模型,显著提升了模型在生成和开放问答任务中的表现。

当前挑战

InstructionWild v2数据集在构建和应用过程中面临多重挑战。首先,数据集的多样性依赖于用户生成的内容,可能导致某些指令类型(如总结、多轮对话和角色扮演)的缺失。其次,基于LLaMA微调的模型在逻辑推理、计数能力和多语言处理方面表现不足,反映出预训练阶段知识的局限性。此外,数据集在安全性方面存在缺陷,模型可能生成虚假事实或违反OpenAI政策的内容。这些挑战需要通过进一步的数据扩展和模型优化来解决,以提升数据集在复杂任务中的适用性。

常用场景

经典使用场景

在自然语言处理领域,InstructionWild v2数据集被广泛用于指令微调(Instruction Tuning)任务。通过提供超过110K条高质量的用户生成指令,该数据集为研究人员提供了一个丰富的资源,用于训练和评估大型语言模型(LLMs)在生成、开放问答和头脑风暴等任务中的表现。其多样化的指令类型和广泛的覆盖范围,使得该数据集成为研究指令微调效果的理想选择。

衍生相关工作

InstructionWild v2数据集的发布催生了一系列相关研究工作。例如,Colossal AI团队基于该数据集开发了ColossalChat模型,并在多个任务上进行了性能评估。此外,该数据集还被用于改进其他开源语言模型,如LLaMA和Alpaca,进一步推动了指令微调技术的发展。这些衍生工作不仅验证了InstructionWild v2数据集的有效性,还为未来的研究提供了宝贵的参考和基础。

数据集最近研究

最新研究方向

在自然语言处理领域,InstructionWild v2数据集的最新研究方向聚焦于提升大规模语言模型(LLM)的指令微调能力。该数据集通过收集超过110K条用户生成的指令,涵盖了生成、开放问答和头脑风暴等多种类型,显著增强了模型在这些任务上的表现。与传统的自生成指令数据集不同,InstructionWild v2直接从用户的实际使用场景中提取数据,确保了指令的多样性和实用性。此外,该数据集已被应用于ColossalChat模型的训练中,初步实验表明其在生成能力和开放问答任务上优于基于Alpaca数据集的模型。然而,当前研究也揭示了LLaMA基础模型的局限性,如逻辑推理和多语言处理能力的不足,这为未来的研究提供了重要的改进方向。

以上内容由遇见数据集搜集并总结生成