weibo_senti_100k

收藏魔搭社区2026-01-07 更新2024-05-15 收录

下载链接:

https://modelscope.cn/datasets/swift/weibo_senti_100k

下载链接

链接失效反馈资源简介:

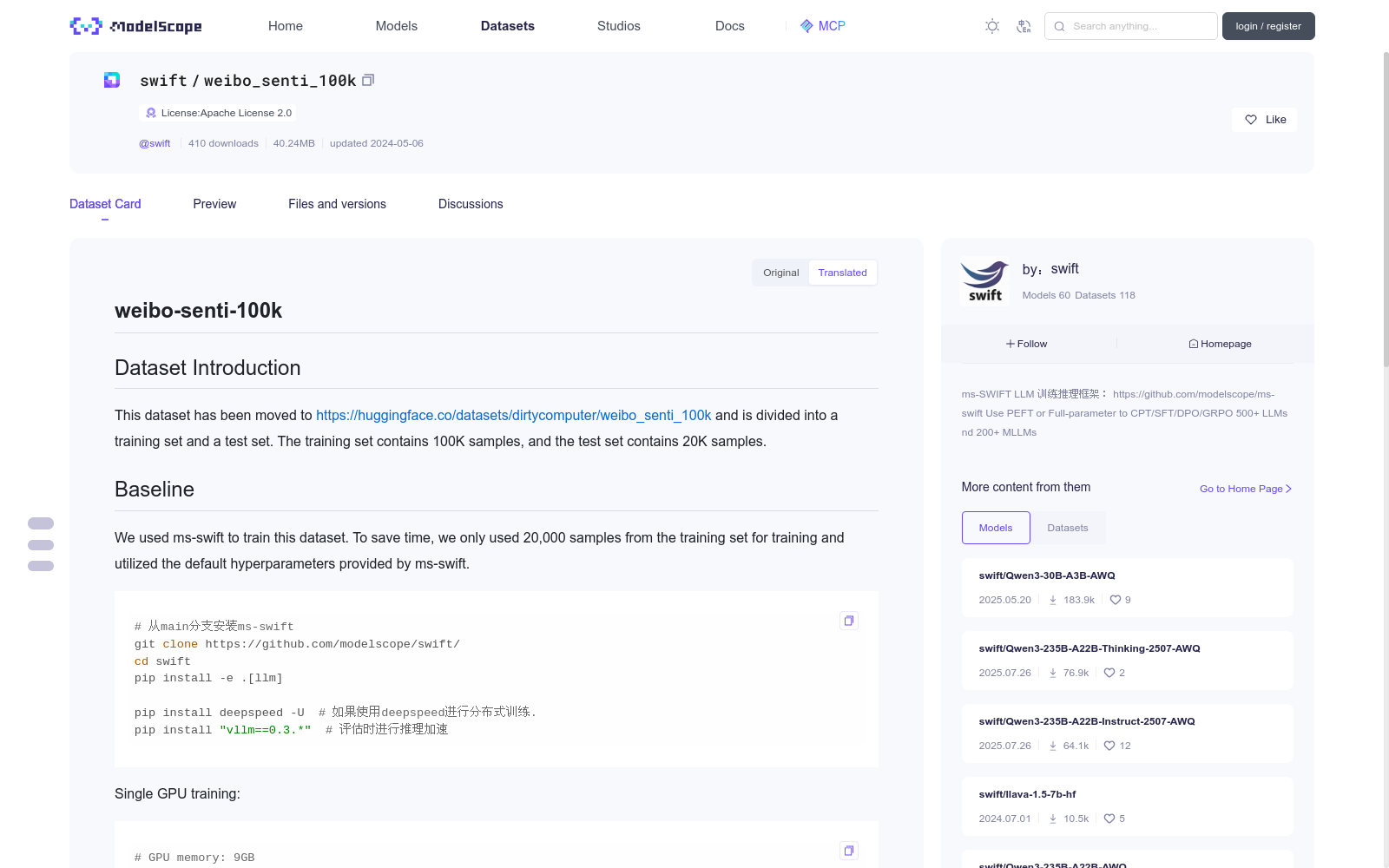

# weibo-senti-100k

## 数据集简介

该数据集迁移至 https://huggingface.co/datasets/dirtycomputer/weibo_senti_100k, 并划分为训练集和测试集. 其中训练集100K条, 测试集20K条.

## Baseline

我们使用ms-swift来对该数据集进行训练. 为了节约时间, 我们只使用了训练集中的20000条的数据进行训练, 并使用了ms-swift提供的默认超参数.

```shell

# 从main分支安装ms-swift

git clone https://github.com/modelscope/swift/

cd swift

pip install -e .[llm]

pip install deepspeed -U # 如果使用deepspeed进行分布式训练.

pip install "vllm==0.3.*" # 评估时进行推理加速

```

单卡训练:

```python

# GPU memory: 9GB

import os

os.environ['CUDA_VISIBLE_DEVICES'] = '0'

from swift.llm import sft_main, SftArguments

sft_main(SftArguments(model_type='qwen1half-1_8b-chat',

dataset='huangjintao/weibo_senti_100k#20000')) # 抽取20000条

```

使用DDP:

```shell

# GPU memory: 9GB

# deepspeed可选. 可去掉

NPROC_PER_NODE=8 \

CUDA_VISIBLE_DEVICES=0,1,2,3,4,5,6,7 \

swift sft \

--model_type qwen1half-1_8b-chat \

--dataset huangjintao/weibo_senti_100k#20000 \

--deepspeed default-zero2

```

评估脚本:

```python

import os

os.environ['CUDA_VISIBLE_DEVICES'] = '0'

# os.system('pip install vllm==0.3.*') # 可选 (vllm进行推理加速)

os.environ['FORCE_REDOWNLOAD'] = '1'

from swift.llm import infer_main, InferArguments, register_dataset

dataset_info = {

"weibo-zh-test": {

"dataset_id": "huangjintao/weibo_senti_100k",

"subsets": ["test"],

"split": ["test"]

}

}

result = infer_main(InferArguments(

ckpt_dir='output/qwen1half-1_8b-chat/vx-xxx/checkpoint-xxx',

do_sample=False, custom_dataset_info=dataset_info, dataset="weibo-zh-test",

show_dataset_sample=-1, merge_lora=True, infer_backend='vllm'))

result = result['result']

count = 0

for i, res in enumerate(result):

if res['response'] == res['label']:

count += 1

print(f'acc: {count / len(result)}')

print() # 0.9815 (baseline)

```

baseline的准确率为:

可改进的地方:

1. 为输入添加prompt.

2. 调节训练的超参数, 例如: 使用全参数训练, lora超参数, 训练超参数, 其他tuners等.

3. 不同的模型选择.

4. ...

# 微博情感100K(weibo-senti-100k)

## 数据集简介

本数据集已迁移至https://huggingface.co/datasets/dirtycomputer/weibo_senti_100k,并划分为训练集与测试集,其中训练集包含100K条样本,测试集包含20K条样本。

## 基线模型

我们采用ms-swift工具开展本数据集的模型训练。为节省训练时长,仅选取训练集中的20000条样本进行训练,并使用ms-swift提供的默认超参数。

shell

# 从main分支安装ms-swift

git clone https://github.com/modelscope/swift/

cd swift

pip install -e .[llm]

pip install deepspeed -U # 若需使用deepspeed开展分布式训练。

pip install "vllm==0.3.*" # 评估阶段用于推理加速

单卡训练:

python

# GPU显存占用:9GB

import os

os.environ['CUDA_VISIBLE_DEVICES'] = '0'

from swift.llm import sft_main, SftArguments

sft_main(SftArguments(model_type='qwen1half-1_8b-chat',

dataset='huangjintao/weibo_senti_100k#20000')) # 选取20000条样本

使用DDP:

shell

# GPU显存占用:9GB

# deepspeed为可选组件,可移除

NPROC_PER_NODE=8

CUDA_VISIBLE_DEVICES=0,1,2,3,4,5,6,7

swift sft

--model_type qwen1half-1_8b-chat

--dataset huangjintao/weibo_senti_100k#20000

--deepspeed default-zero2

评估脚本:

python

import os

os.environ['CUDA_VISIBLE_DEVICES'] = '0'

# os.system('pip install vllm==0.3.*') # 可选(使用vllm实现推理加速)

os.environ['FORCE_REDOWNLOAD'] = '1'

from swift.llm import infer_main, InferArguments, register_dataset

dataset_info = {

"weibo-zh-test": {

"dataset_id": "huangjintao/weibo_senti_100k",

"subsets": ["test"],

"split": ["test"]

}

}

result = infer_main(InferArguments(

ckpt_dir='output/qwen1half-1_8b-chat/vx-xxx/checkpoint-xxx',

do_sample=False, custom_dataset_info=dataset_info, dataset="weibo-zh-test",

show_dataset_sample=-1, merge_lora=True, infer_backend='vllm'))

result = result['result']

count = 0

for i, res in enumerate(result):

if res['response'] == res['label']:

count += 1

print(f'acc: {count / len(result)}')

print() # 输出结果:0.9815(基线模型准确率)

基线模型的准确率为:0.9815

## 可改进方向

1. 为输入文本添加Prompt提示词

2. 调整训练超参数,例如采用全参数微调、LoRA超参数配置、训练超参数调优以及其他微调器(tuners)方案等

3. 尝试不同的预训练模型

4. ……

提供机构:

maas

创建时间:

2024-05-05

AI搜集汇总

数据集介绍

背景与挑战

背景概述

weibo_senti_100k是一个中文微博情感分析数据集,包含100K条训练数据和20K条测试数据,已迁移至新地址并提供了完整的训练和测试划分。数据集附带了基于ms-swift的baseline训练代码和评估方法,baseline准确率达到0.9815,适用于情感分类任务的研究和开发。

以上内容由AI搜集并总结生成