HANDAL Dataset

收藏github2024-05-22 更新2024-05-31 收录

下载链接:

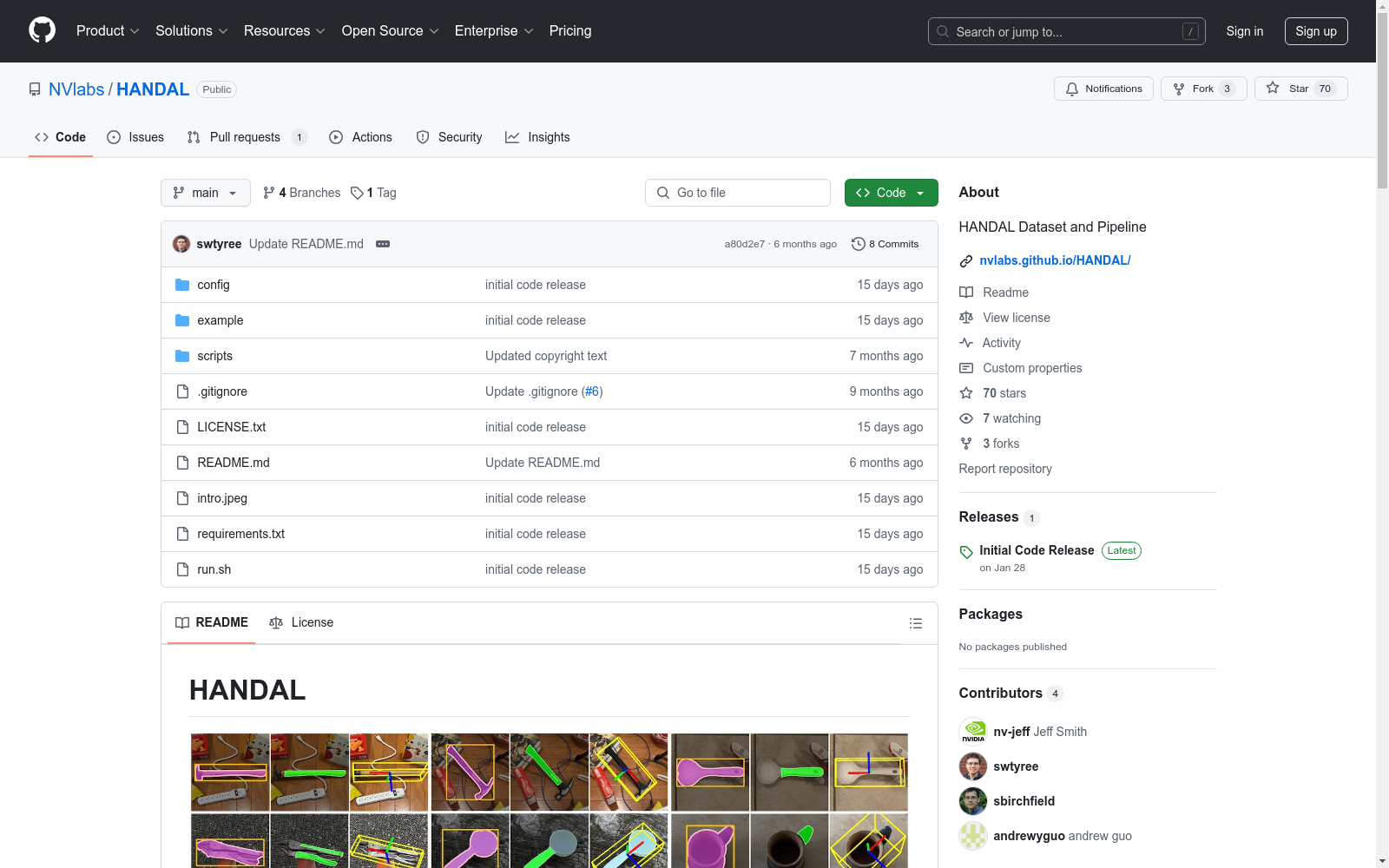

https://github.com/NVlabs/HANDAL

下载链接

链接失效反馈资源简介:

HANDAL数据集是一个类别级数据集,用于物体姿态估计和功能预测,重点关注适合功能性机器人抓取的硬件和厨房工具物体(如钳子、器具和螺丝刀)。该数据集包含来自2.2k视频的308k标注图像帧,涉及17个类别的212个真实世界物体。

The HANDAL dataset is a category-level dataset designed for object pose estimation and functional prediction, with a focus on hardware and kitchen tool objects (such as pliers, utensils, and screwdrivers) that are suitable for functional robotic grasping. The dataset comprises 308k annotated image frames derived from 2.2k videos, encompassing 212 real-world objects across 17 categories.

创建时间:

2023-07-28

原始信息汇总

HANDAL 数据集概述

数据集描述

- 目的: HANDAL 数据集专注于硬件和厨房工具的物体姿态估计和功能预测,适用于功能性机器人抓取。

- 内容: 包含308k个标注图像帧,来自2.2k个视频,涉及212个真实世界物体,分为17个类别。

- 格式: 遵循BOP格式,有以下修改:

- 图像尺寸在

scene_camera.json中提供,因使用多个相机传感器捕捉数据。 - 深度信息通过NeRF重建场景(使用Instant NGP)而非深度传感器获取。

- RGB图像使用JPEG压缩而非PNG。

- 图像尺寸在

数据集获取

- 下载: 数据集可从Google Drive下载。

- 许可证: 数据集发布遵循CC-BY-NC-SA-4.0许可证。

引用信息

bibtex @InProceedings{handaliros23, title={{HANDAL}: A Dataset of Real-World Manipulable Object Categories with Pose Annotations, Affordances, and Reconstructions}, author={Andrew Guo and Bowen Wen and Jianhe Yuan and Jonathan Tremblay and Stephen Tyree and Jeffrey Smith and Stan Birchfield}, booktitle={IROS}, year={2023} }

AI搜集汇总

数据集介绍

构建方式

HANDAL数据集的构建基于对硬件和厨房工具对象的姿态估计和功能性抓取预测。该数据集通过使用多种相机传感器捕捉212个真实世界对象的2.2k视频,生成308k个带注释的图像帧。数据集的深度信息通过NeRF重建场景生成,而非传统的深度传感器。RGB图像采用JPEG压缩,而非PNG格式。整个构建过程依赖于Instant-NGP进行场景重建、深度估计和网格构建,确保了高质量的3D注释。

特点

HANDAL数据集的显著特点在于其专注于硬件和厨房工具对象的姿态估计和功能性抓取预测,涵盖17个类别。数据集采用BOP格式,并进行了一些微调,如提供每个场景的图像尺寸和使用NeRF渲染深度。此外,数据集的注释过程高效,仅需单一商用相机和半自动化处理,避免了众包注释的复杂性。

使用方法

使用HANDAL数据集时,用户需首先安装HANDAL工具包,该工具包依赖于NVIDIA GPU和Instant-NGP。安装完成后,用户可以通过运行示例场景来测试安装。数据集的下载和使用遵循CC-BY-NC-SA-4.0许可证,确保了非商业用途的自由使用和共享。通过交互式工具,用户可以对参考场景进行初始重建和注释,并进一步处理和校准其他场景,生成最终的注释文件。

背景与挑战

背景概述

HANDAL数据集是由NVIDIA实验室于2023年发布的一个专注于物体姿态估计和功能预测的类别级数据集。该数据集主要针对适合机器人抓取的硬件和厨房工具对象,如钳子、餐具和螺丝刀等。HANDAL数据集包含了来自212个真实世界物体的2.2万个视频中的30.8万张标注图像帧,涵盖17个类别。该数据集的发布旨在推动机器人技术在物体识别和操作方面的研究,特别是在复杂环境中的精确姿态估计和功能预测。

当前挑战

HANDAL数据集在构建过程中面临多项挑战。首先,数据集需要处理多种不同形状和大小的物体,这对姿态估计和功能预测算法提出了高要求。其次,数据集的构建依赖于多摄像头的数据采集和NeRF重建技术,这增加了数据处理的复杂性和计算资源的消耗。此外,数据集的标注过程需要高精度的3D标注,而这一过程通常依赖于半自动化的处理方法,这要求在保证标注质量的同时,提高标注效率。最后,数据集的发布和使用需要遵循严格的版权和许可协议,确保数据集的合法性和可持续性。

常用场景

经典使用场景

HANDAL数据集在物体姿态估计和功能预测领域中具有经典应用场景。该数据集专注于硬件和厨房工具类物体,这些物体具有适合机器人抓取的适当尺寸和形状。通过提供308k个带注释的图像帧和2.2k个视频,HANDAL数据集为研究人员提供了丰富的资源,用于训练和验证物体姿态估计模型。这些模型可以用于机器人抓取任务,确保机器人能够准确识别和定位目标物体,从而实现高效的操作。

解决学术问题

HANDAL数据集解决了物体姿态估计和功能预测中的多个学术研究问题。首先,它提供了大量真实世界物体的注释数据,填补了现有数据集在硬件和厨房工具类别上的空白。其次,通过引入NeRF重建的深度信息,HANDAL数据集提高了深度估计的精度,这对于机器人抓取任务至关重要。此外,该数据集的多样性和高质量注释为研究者提供了宝贵的资源,推动了物体识别和姿态估计技术的发展。

衍生相关工作

HANDAL数据集的发布催生了多项相关研究工作。例如,基于该数据集的物体姿态估计模型在机器人抓取任务中表现出色,推动了机器人操作技术的发展。此外,HANDAL数据集的深度信息重建方法也被应用于其他计算机视觉任务,如场景理解和三维重建。研究者们还利用该数据集开发了新的算法,以提高物体识别和姿态估计的准确性和鲁棒性。这些衍生工作进一步扩展了HANDAL数据集的应用范围和影响力。

以上内容由AI搜集并总结生成