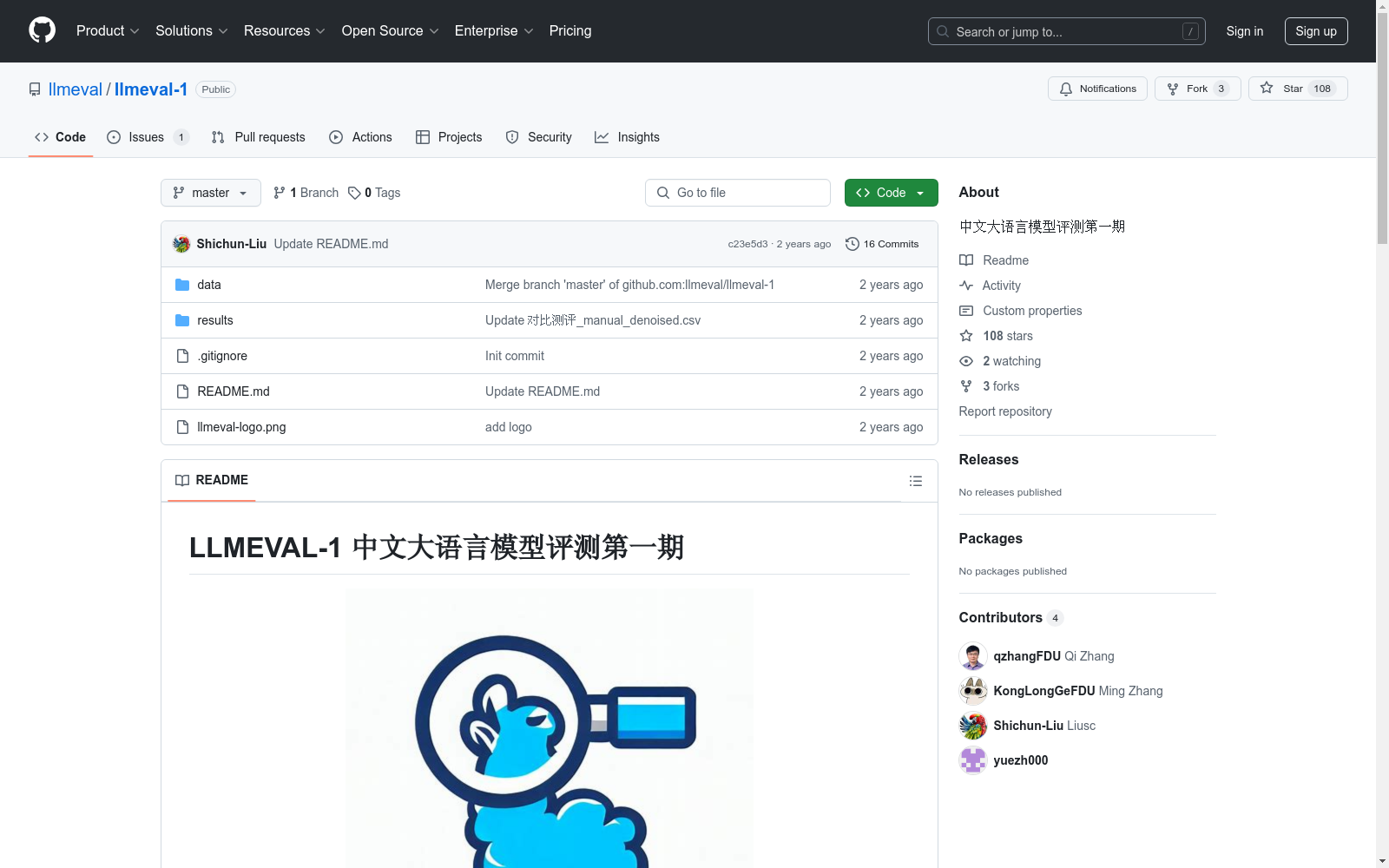

LLMEVAL-1

收藏github2023-05-01 更新2025-02-07 收录

下载链接:

https://github.com/llmeval/llmeval-1

下载链接

链接失效反馈资源简介:

LLMEVAL-1数据集包含了453个中文问题,涵盖17个宽泛的任务类别,包括提供事实性答案、生成框架和创作诗歌等任务。同时,定义了五个评估标准,包括准确性、流畅性、信息量、逻辑性和无害性。评估通过众包比较评估、公开比较评估和GPT-4评分等方法进行。

The LLMEVAL-1 dataset encompasses 453 Chinese questions across 17 broad task categories, including providing factual answers, generating frameworks, and composing poetry. It also defines five evaluation criteria, including accuracy, fluency, informativeness, logical consistency, and harmlessness. Evaluations are conducted through crowd-sourced comparative assessments, public comparative evaluations, and GPT-4 scoring methods.

提供机构:

复旦大学等

创建时间:

2023-05-01

原始信息汇总

LLMEVAL-1 中文大语言模型评测第一期数据集概述

项目背景

- 旨在系统研究大模型评价方法,解决评测方向、方法和排序三大关键问题。

- 针对选择题评测的局限性,重点评估大模型的文本生成能力。

- 通过对比人工评测与GPT-4自动评测的差异,建立更全面的评估体系。

评测内容

- 覆盖领域:17个大类、453个问题,包括:

- 事实性问答

- 阅读理解

- 框架生成

- 段落重写

- 摘要

- 数学解题

- 推理

- 诗歌生成

- 编程等

- 评分维度:5个评分项

- 正确性

- 流畅性

- 信息量

- 逻辑性

- 无害性

评测方法

- 分项评测:针对5个评分项进行独立评估

- 对比评测:

- 众包对比评测

- 公众对比评测

- GPT-4自动分项评测

- GPT-4对比评测

参与模型

评测包含12个主流大语言模型:

- GPT4.0

- GPT3.5

- Xunfei-Xinhuo

- Chat-Baichuan-7B

- ChatGLM-6B

- Chinese-LLAMA-7B

- Ali-Tongyiqianwen

- NewBing

- MOSS-16B

- Linly-ChatFlow-13B

- ChatYuan-Large

- MOSS-w-Plugin-16B

数据规模

- 参与评测用户:2186位

- 人工评测结果:24.3万个

- GPT-4自动评测:5.75万次

时间节点

- 2023.06.19:测试结果正式发布

- 2023.05.24:公布中期进展(完成30%大众评测和40%专业评测)

- 2023.05.01:项目正式启动

引用信息

bibtex @misc{LLMEval1, author = {Ming Zhang and Yue Zhang and Shichun Liu and Haipeng Yuan and Junzhe Wang and Tao Gui and Qi Zhang and Xuanjing Huang}, title = {{LLMEval-1}}, year = {2023}, month = {June}, url = {https://github.com/llmeval/llmeval-1}, }

联系方式

- 项目官网:http://llmeval.com/

- 邮箱:mingzhang23@m.fudan.edu.cn

- 微信:zanyingluan

搜集汇总

数据集介绍

构建方式

LLMEVAL-1数据集的构建基于对大语言模型评测需求的深入分析,特别关注于生成能力的评估。该数据集通过结合众包和专业评测的方式,构建了一个包含17个大类、453个问题的评测集。这些问题涵盖了从事实性问答到编程等多个领域,旨在全面评估模型的多方面能力。此外,数据集还引入了GPT-4自动评测,以提供与人工评测的对比分析,确保评测结果的全面性和准确性。

使用方法

使用LLMEVAL-1数据集时,研究者首先需要访问其GitHub页面获取数据集和相关的评测工具。通过参与评测,研究者可以提交模型的回答,并接收来自众包和专业评测的反馈。此外,数据集还支持使用GPT-4进行自动评测,研究者可以通过API接口提交模型输出,获取自动评测结果。这些评测结果不仅可以帮助研究者了解模型的性能,还可以用于模型的进一步优化和改进。

背景与挑战

背景概述

LLMEVAL-1数据集由复旦大学等机构的研究团队于2023年推出,旨在系统评估大语言模型的多维度能力。该数据集涵盖了17个大类、453个问题,涉及事实性问答、阅读理解、框架生成、段落重写、摘要、数学解题、推理、诗歌生成、编程等多个领域。通过设置正确性、流畅性、信息量、逻辑性和无害性五个评分项,LLMEVAL-1为大模型的生成能力提供了全面的评测框架。该数据集的推出填补了现有评测方法在生成能力评估上的不足,为大模型的研究与应用提供了重要的参考依据。

当前挑战

LLMEVAL-1数据集在构建与应用过程中面临多重挑战。首先,传统评测指标如BLUE值、ROUGE等无法充分反映大模型的生成能力,如何设计科学且全面的评测标准成为核心难题。其次,尽管GPT-4自动评测方法被引入,但其与人工评测结果的一致性仍需验证,数据规模与评测效率之间的平衡亦需优化。此外,数据集的多样性与复杂性对评测任务的标注质量提出了更高要求,如何确保众包与专业评测结果的可信度与一致性也是亟待解决的问题。这些挑战不仅影响评测结果的准确性,也直接关系到数据集在学术与工业界的广泛应用。

常用场景

经典使用场景

在自然语言处理领域,LLMEVAL-1数据集被广泛用于评估大语言模型的生成能力和理解能力。通过涵盖事实性问答、阅读理解、框架生成、段落重写、摘要、数学解题、推理、诗歌生成、编程等多个领域的453个问题,该数据集为研究者提供了一个全面的评测平台,帮助他们在不同任务上测试和比较模型的性能。

解决学术问题

LLMEVAL-1数据集解决了大语言模型评测中的关键问题,如如何全面评估模型的生成能力、如何设计有效的评测方法以及如何确保评测结果的可靠性。通过引入多维度评分标准(正确性、流畅性、信息量、逻辑性和无害性),该数据集为学术界提供了一个标准化的评测框架,有助于推动大模型评测方法的研究和发展。

实际应用

在实际应用中,LLMEVAL-1数据集被用于优化和改进大语言模型的性能。企业和研究机构可以利用该数据集进行模型调优,确保模型在生成文本时的准确性、流畅性和逻辑性。此外,该数据集还可用于教育领域,帮助学生和教师评估和提升语言模型在教学辅助工具中的应用效果。

数据集最近研究

最新研究方向

随着大语言模型(LLM)技术的迅猛发展,如何全面、准确地评估这些模型的性能成为了研究的热点。LLMEVAL-1数据集正是在这一背景下应运而生,旨在通过多维度的评测方法,深入探讨大模型的生成能力、知识覆盖范围及其在实际应用中的表现。该数据集不仅涵盖了事实性问答、阅读理解、框架生成等多个领域,还引入了正确性、流畅性、信息量、逻辑性和无害性五个评分项,为大模型的综合评估提供了科学依据。近期研究显示,LLMEVAL-1的评测结果与人工评测之间的差距逐渐缩小,尤其是在GPT-4自动评测模型的应用下,评测的准确性和效率得到了显著提升。这一进展不仅为大模型的优化提供了有力支持,也为未来更复杂的评测任务奠定了基础。

以上内容由遇见数据集搜集并总结生成