MORE

收藏github2023-12-18 更新2024-05-31 收录

下载链接:

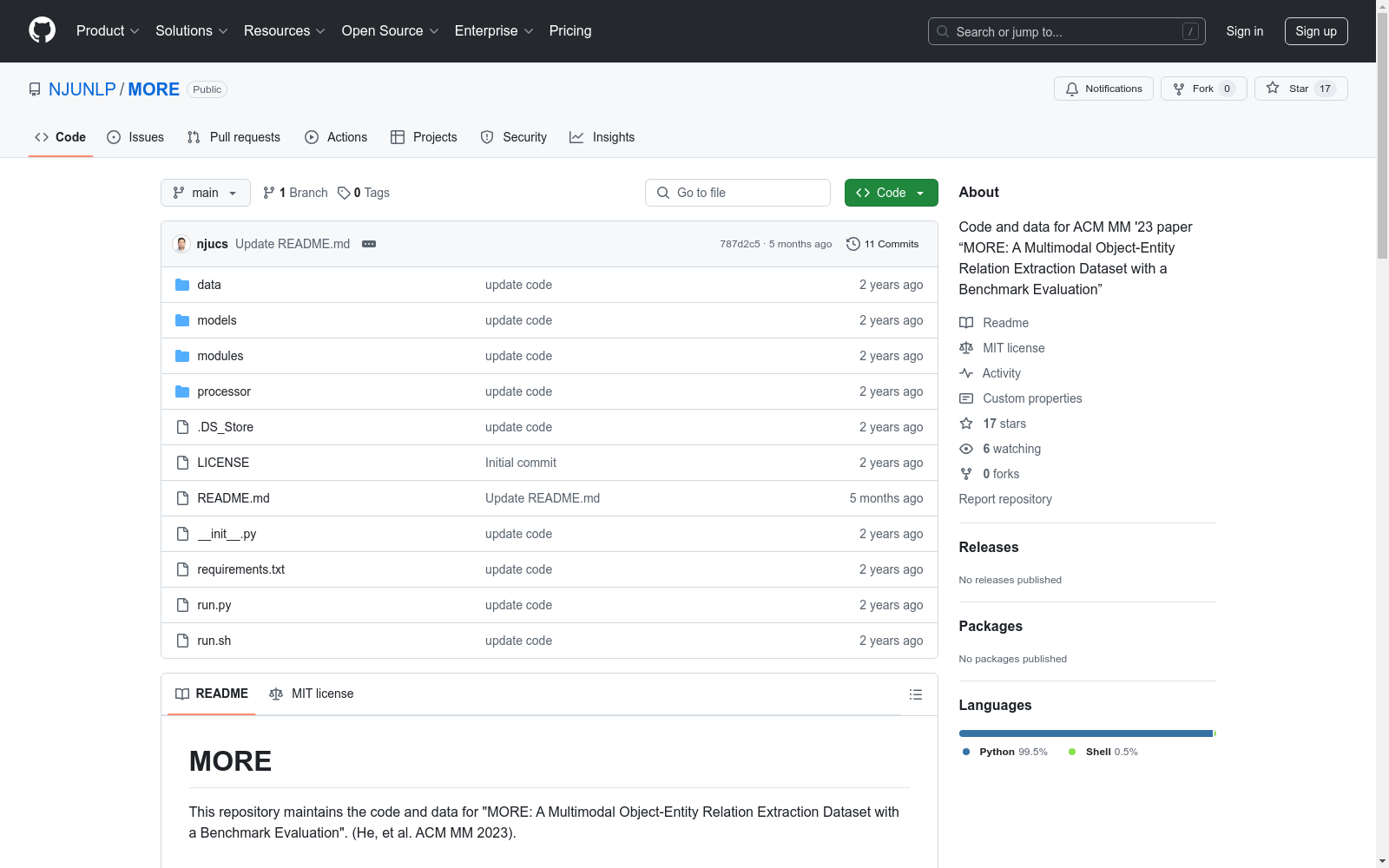

https://github.com/NJUNLP/MORE

下载链接

链接失效反馈资源简介:

MORE是一个多模态对象-实体关系抽取数据集,包含21种不同的关系类型,共有20,264个多模态关系事实,标注在3,559对文本标题和相应的图像上。数据集包括13,520个视觉对象,平均每张图像有3.8个对象。数据集被分为训练集、开发集和测试集,分别包含15,486、1,742和3,036个事实。

MORE is a multimodal object-entity relation extraction dataset, encompassing 21 distinct relation types with a total of 20,264 multimodal relation facts annotated on 3,559 pairs of text titles and corresponding images. The dataset includes 13,520 visual objects, averaging 3.8 objects per image. It is divided into training, development, and test sets, containing 15,486, 1,742, and 3,036 facts respectively.

创建时间:

2023-08-03

原始信息汇总

数据集概述

数据集名称

MORE: A Multimodal Object-Entity Relation Extraction Dataset

数据集内容

- 关系类型数量:21种

- 数据量:包含20,264个多模态关系事实,注释在3,559对文本标题和对应图像上

- 视觉对象数量:13,520个视觉对象(平均每张图像3.8个对象)

- 数据集划分:训练集15,486个事实,开发集1,742个事实,测试集3,036个事实

数据集下载

链接:https://pan.baidu.com/s/1PA6raw1rbQKhPEL1FEEuAw?pwd=taft

数据集更新

- 移除了大部分敏感数据

- 修正了明显的标注错误

- 添加了新数据

- 更新了论文中的所有实验结果

性能评估

-

总体性能:

模型 准确率 精确率 召回率 F1-Score BERT+SG 61.79 29.61 41.27 34.48 BERT+SG+Att 63.74 31.10 39.28 34.71 MEGA 65.97 33.30 38.53 35.72 IFAformer 79.28 55.13 54.24 54.68 MKGformer 80.17 55.76 53.74 54.73 VisualBERT 82.84 58.18 61.22 59.66 ViLBERT 83.50 62.53 59.73 61.10 MOREformer 83.50 62.18 63.34 62.75 -

多实体/对象性能:

情况 准确率 精确率 召回率 F1-Score Ent = 1, Obj = 1 80.00 82.98 82.11 82.54 Ent = 1, Obj > 1 84.57 63.18 66.31 64.71 Ent > 1, Obj = 1 67.55 66.36 72.28 69.19 Ent > 1, Obj > 1 84.43 53.63 52.47 53.04 -

Macro-F1评分:

模型 精确率 召回率 Macro F1-Score MKGformer 48.50 42.60 43.57 ViLBERT 49.13 49.37 48.66 MOREformer 51.02 50.66 50.02 -

多对象消歧分析:

模型 精确率 召回率 F1-Score MKGformer 70.12/66.08 67.58/62.29 68.83/64.13 ViLBERT 75.31/72.30 75.31/70.41 75.31/71.34 MOREformer 72.28/71.43 79.75/76.61 75.84/73.93

AI搜集汇总

数据集介绍

构建方式

MORE数据集是一个多模态对象-实体关系抽取数据集,旨在通过结合文本标题和对应图像来提取多模态关系事实。数据集的构建过程经过了严格的审查,剔除了大部分敏感数据,修正了明显的标注错误,并补充了新的数据。最终,数据集包含了21种不同的关系类型,共计20,264个多模态关系事实,标注在3,559对文本标题和图像上。数据集被划分为训练集、开发集和测试集,分别包含15,486、1,742和3,036个关系事实。

特点

MORE数据集的特点在于其多模态性质,结合了文本和图像信息,能够支持复杂的关系抽取任务。数据集中包含13,520个视觉对象,平均每张图像包含3.8个对象。此外,数据集还提供了多种模型在不同关系类型上的性能评估结果,涵盖了准确率、精确率、召回率和F1分数等指标。这些特点使得MORE数据集成为多模态关系抽取研究的重要基准。

使用方法

使用MORE数据集时,首先需要创建一个Python 3.7的虚拟环境,并安装所需的依赖库,包括transformers、torchvision、scikit-learn等。安装完成后,可以通过运行`run.sh`脚本来启动模型的训练和评估过程。数据集的下载链接和预训练模型的检查点均已提供,用户可以根据需要下载并使用。此外,数据集的使用要求引用相关论文,以确保学术研究的透明性和可追溯性。

背景与挑战

背景概述

MORE数据集是由Liang He等研究人员在2023年ACM国际多媒体会议上提出的,旨在解决多模态对象-实体关系抽取问题。该数据集包含21种不同的关系类型,涵盖了20,264个多模态关系事实,基于3,559对文本标题和对应图像的标注。数据集的构建过程中,研究人员对数据进行了多次校验,剔除了敏感信息并修正了标注错误,最终形成了包含训练集、开发集和测试集的完整数据集。MORE数据集的发布为多模态关系抽取领域提供了重要的基准,推动了该领域的研究进展。

当前挑战

MORE数据集在构建和应用过程中面临多重挑战。首先,多模态数据的对齐与融合是一个核心难题,文本与图像之间的语义关联需要精确捕捉,以确保关系抽取的准确性。其次,数据标注的复杂性较高,尤其是在处理多对象和多实体时,标注的一致性和准确性难以保证。此外,数据集中包含的21种关系类型多样,模型需要具备较强的泛化能力以应对不同关系的抽取任务。最后,尽管现有模型如MOREformer在部分指标上表现优异,但在多对象消歧和复杂关系抽取方面仍有提升空间,如何进一步提升模型的鲁棒性和泛化能力是未来研究的重点。

常用场景

经典使用场景

MORE数据集在多模态对象-实体关系抽取领域具有广泛的应用。其经典使用场景包括通过结合文本标题和对应图像,识别和分类图像中的对象与文本中的实体之间的关系。这种多模态信息的融合使得模型能够更准确地理解复杂的语义关系,适用于新闻图像分析、社交媒体内容理解等场景。

实际应用

在实际应用中,MORE数据集被广泛用于智能图像标注、社交媒体内容分析、新闻事件理解等领域。例如,在新闻图像分析中,模型可以利用该数据集识别图像中的对象与新闻标题中的实体之间的关系,从而自动生成更准确的图像描述或新闻摘要。

衍生相关工作

MORE数据集的发布催生了一系列相关研究工作,如MOREformer模型的提出。该模型通过结合视觉和文本信息,显著提升了多模态关系抽取的性能。此外,基于MORE数据集的研究还推动了多模态预训练模型的发展,如ViLBERT和VisualBERT等,进一步拓展了多模态关系抽取的应用边界。

以上内容由AI搜集并总结生成