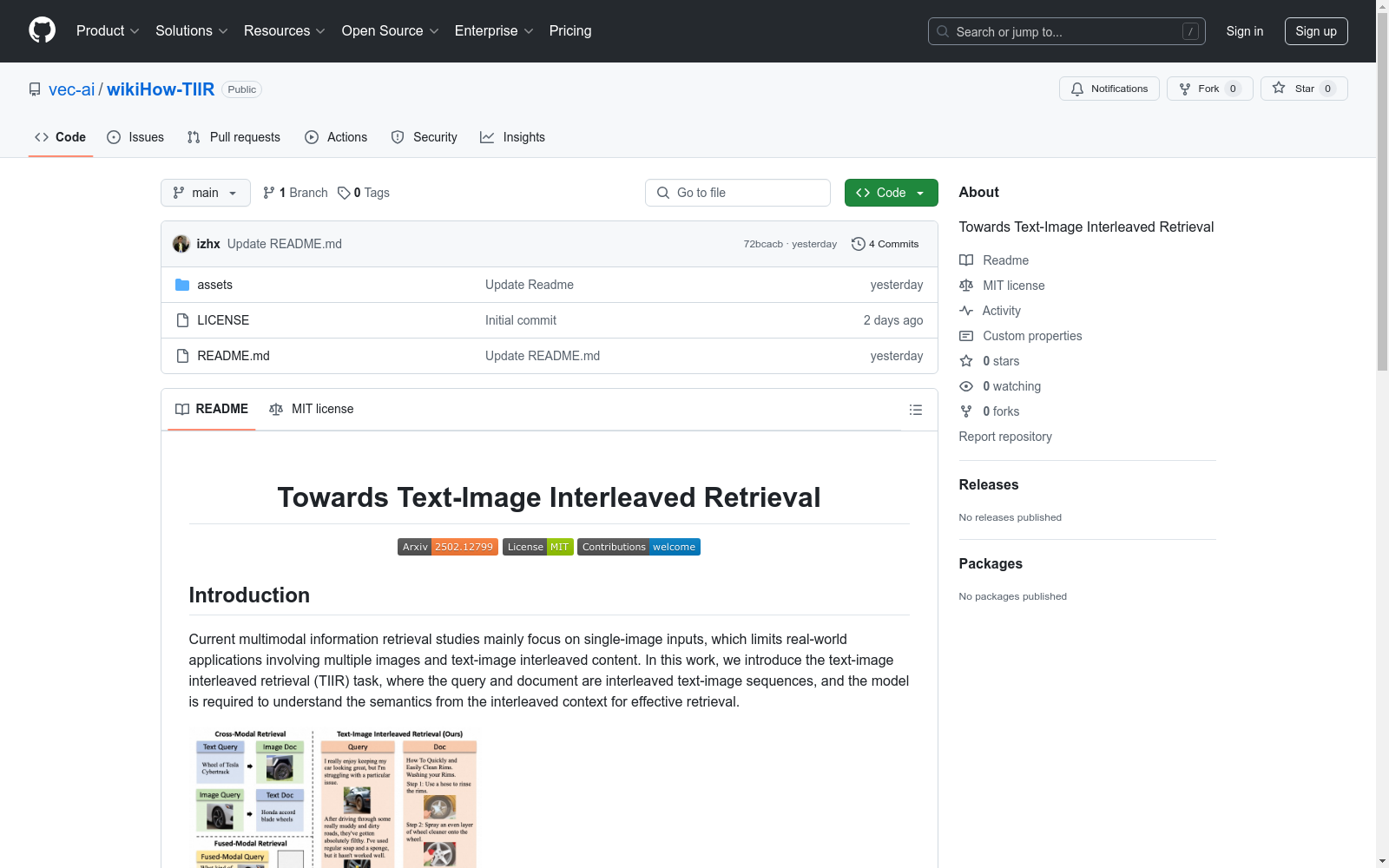

wikiHow-TIIR|文本图像检索数据集|信息检索数据集

收藏

- 1Towards Text-Image Interleaved Retrieval哈尔滨工业大学, 香港理工大学 · 2025年

学生课堂行为数据集 (SCB-dataset3)

学生课堂行为数据集(SCB-dataset3)由成都东软学院创建,包含5686张图像和45578个标签,重点关注六种行为:举手、阅读、写作、使用手机、低头和趴桌。数据集覆盖从幼儿园到大学的不同场景,通过YOLOv5、YOLOv7和YOLOv8算法评估,平均精度达到80.3%。该数据集旨在为学生行为检测研究提供坚实基础,解决教育领域中学生行为数据集的缺乏问题。

arXiv 收录

中国近海台风路径集合数据集(1945-2024)

1945-2024年度,中国近海台风路径数据集,包含每个台风的真实路径信息、台风强度、气压、中心风速、移动速度、移动方向。 数据源为获取温州台风网(http://www.wztf121.com/)的真实观测路径数据,经过处理整合后形成文件,如使用csv文件需使用文本编辑器打开浏览,否则会出现乱码,如要使用excel查看数据,请使用xlsx的格式。

国家海洋科学数据中心 收录

flames-and-smoke-datasets

该仓库总结了多个公开的火焰和烟雾数据集,包括DFS、D-Fire dataset、FASDD、FLAME、BoWFire、VisiFire、fire-smoke-detect-yolov4、Forest Fire等数据集。每个数据集都有详细的描述,包括数据来源、图像数量、标注信息等。

github 收录

LEVIR-CD

LEVIR-CD 是一个新的大规模遥感建筑变化检测数据集。引入的数据集将成为评估变化检测 (CD) 算法的新基准,尤其是基于深度学习的算法。 LEVIR-CD 由 637 个非常高分辨率(VHR,0.5m/像素)Google Earth (GE) 图像块对组成,大小为 1024 × 1024 像素。这些时间跨度为 5 到 14 年的双时相图像具有显着的土地利用变化,尤其是建筑增长。 LEVIR-CD涵盖别墅住宅、高层公寓、小型车库和大型仓库等各类建筑。在这里,我们关注与建筑相关的变化,包括建筑增长(从土壤/草地/硬化地面或在建建筑到新建筑区域的变化)和建筑衰退。这些双时相图像由遥感图像解释专家使用二进制标签(1 表示变化,0 表示不变)进行注释。我们数据集中的每个样本都由一个注释器进行注释,然后由另一个注释器进行双重检查以产生高质量的注释。完整注释的 LEVIR-CD 总共包含 31,333 个单独的变更构建实例。

OpenDataLab 收录

LIDC-IDRI

LIDC-IDRI 数据集包含来自四位经验丰富的胸部放射科医师的病变注释。 LIDC-IDRI 包含来自 1010 名肺部患者的 1018 份低剂量肺部 CT。

OpenDataLab 收录