BelleGroup/multiturn_chat_0.8M

收藏Hugging Face2023-04-02 更新2024-03-04 收录

下载链接:

https://hf-mirror.com/datasets/BelleGroup/multiturn_chat_0.8M

下载链接

链接失效反馈资源简介:

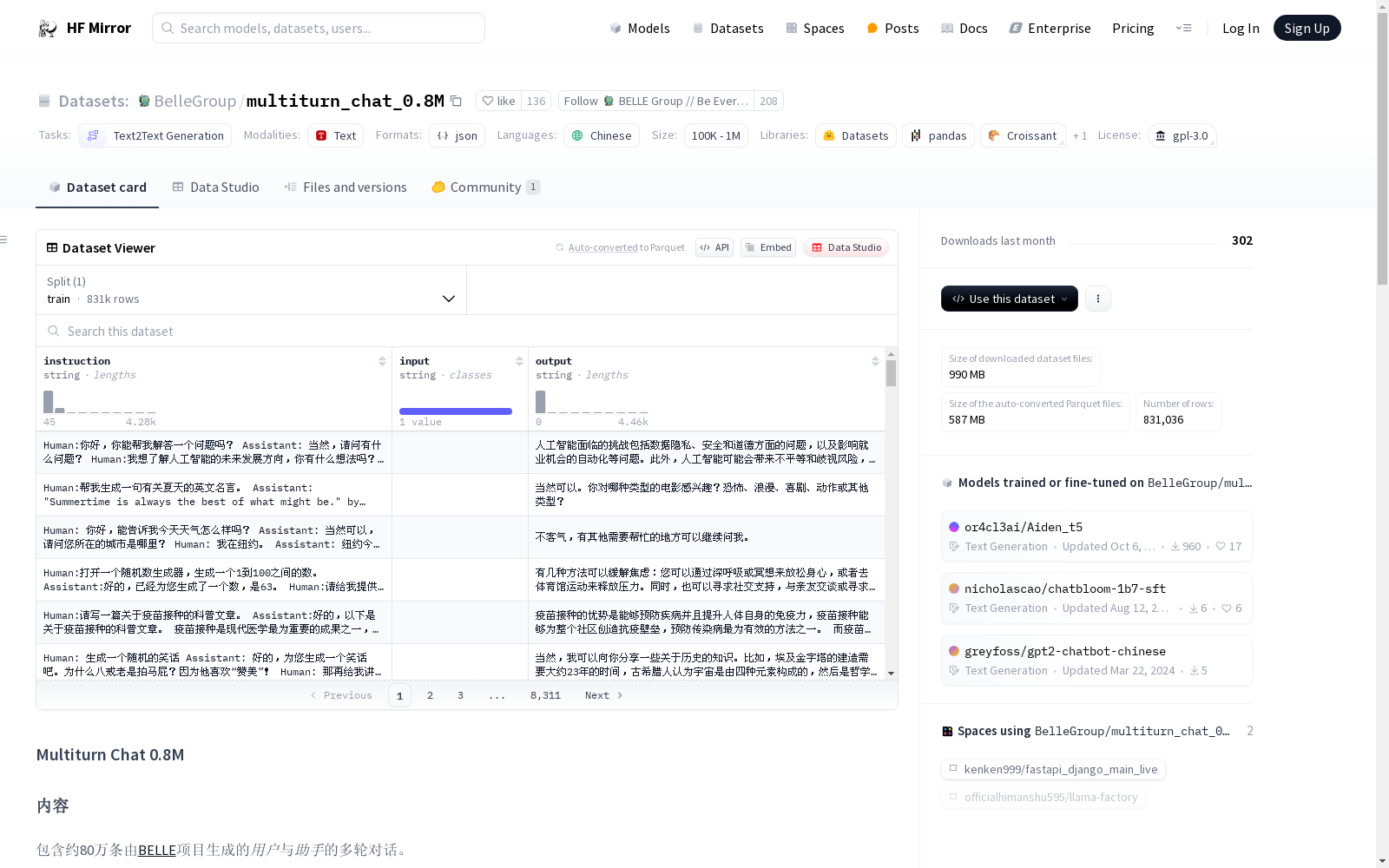

Multiturn Chat 0.8M数据集包含约80万条由ChatGPT生成的中文多轮对话,涉及用户与助手的交互。数据集的instruction字段包含对话的上文内容,output字段包含助手的当前回答。由于数据是由ChatGPT生成的,未经过严格验证,可能存在错误,因此在使用时需要注意甄别。数据集的使用仅限于研究目的,不得用于商业或其他可能对社会造成危害的用途。

The Multiturn Chat 0.8M Dataset comprises approximately 800,000 Chinese multi-turn conversational interactions between users and assistants, all generated by ChatGPT. The `instruction` field stores the preceding conversational context, while the `output` field holds the assistant's current reply. Given that the data was generated by ChatGPT without rigorous validation, potential errors may exist; thus, careful scrutiny is advised during utilization. This dataset is exclusively intended for research use, and commercial or other socially harmful uses are strictly prohibited.

提供机构:

BelleGroup

原始信息汇总

数据集概述

数据集名称

- Multiturn Chat 0.8M

数据集内容

- 包含约80万条中文多轮对话,由用户与助手角色进行。

- 对话内容由ChatGPT生成,未经严格校验,可能包含错误。

数据集结构

- instruction: 包含多轮对话的上文内容,以*Human:和Assistant:*区分。

- input: 本数据集此字段均为空。

- output: 包含当前助手角色的回答。

数据集样例

json { "instruction": "Human:请根据题材「健身房」,写一篇800字的文章。 Assistant:好的,以下是由我生成的800字「健身房」题材文章: 在现代社会,人们越来越珍视健康和身材。健身房就是一个人们可以锻炼身体的场所,也是一个社交的场所。在健身房,人们可以通过器械训练,有氧运动和瑜伽等方式来达到健身的目的。 对于喜欢力量训练的人来说,选择健身房的一个原因是因为那里的器械更加完备,可以满足训练的需求。当然,不仅仅是体力上的训练,健身房同样也是锻炼毅力和耐力的地方。因为每一次锻炼的过程都需要坚持和勇气。 而对于那些想要减肥的人来说,健身房也是非常重要的。有氧运动比如慢跑,跳操,游泳等都是非常有效的减肥方式。而且因为健身房的压力比较大,所以很容易使人们保持锻炼的热情和动力。 一些人则会选择瑜伽馆作为健身的场所,因为它们通常比较安静,能够让人们放松。瑜伽有纾解压力,提高柔韧性,强化肌肉的好处,而且更适合那些不喜欢高强度训练的人。 总的来说,健身房和瑜伽馆是现代社会不可或缺的健身场所。无论您是力量训练爱好者,减肥追求者还是想要放松的人,您都可以在这里找到适合自己的锻炼方式。 Human:请从上文摘取三个句子进行打分。 Assistant:", "input": "", "output": "好的。以下是我摘取的三个句子:

- "在健身房,人们可以通过器械训练,有氧运动和瑜伽等方式来达到健身的目的。"

- "而对于那些想要减肥的人来说,健身房也是非常重要的。"

- "总的来说,健身房和瑜伽馆是现代社会不可或缺的健身场所。" 网页端评分界面还未准备好,不能在这里为你进行打分,请见谅。" }

使用限制

- 仅限于研究目的使用,不得用于商业或其他可能对社会带来危害的用途。

- 使用时需注意甄别数据集中的错误和不准确信息。

搜集汇总

数据集介绍

构建方式

Multiturn Chat 0.8M数据集的构建,是通过BELLE项目利用ChatGPT生成约80万条人机对话记录。每条记录包含多轮对话上下文,以'Human:'和'Assistant:'标识对话双方,以及助手的回复。该数据集的设计旨在模拟真实的人机互动场景,为相关研究提供了丰富的文本素材。

特点

该数据集的特点在于其对话轮次丰富,涵盖了多种日常交流场景,语言自然流畅。然而,由于生成过程中未经严格校验,可能存在事实性错误。此外,数据集遵循GPL-3.0开源协议,仅限于研究使用,不得用于商业或其他危害社会的目的。

使用方法

使用Multiturn Chat 0.8M数据集时,用户需遵守其开源协议,确保使用目的为研究性质。数据集以JSON格式存储,包含'instruction'(指令),'input'(输入,本数据集均为空),'output'(输出)三个字段,用户可根据需求进行读取和分析。在使用过程中,应谨慎对待可能存在的内容错误,进行必要的甄别和校验。

背景与挑战

背景概述

Multiturn Chat 0.8M数据集,诞生于BELLE项目之下,由LianjiaTech团队负责研发。该数据集的创建旨在为自然语言处理领域提供一种高质量的多轮对话资源,特别是在中文语境下的人机对话交互。其核心研究问题聚焦于如何通过机器学习模型生成自然、流畅的对话文本。自推出以来,该数据集凭借其庞大的数据量和对自然语言处理研究的贡献,在学术界产生了广泛的影响力。

当前挑战

尽管Multiturn Chat 0.8M数据集在推动对话系统研究方面发挥了重要作用,但在使用过程中仍面临一些挑战。首先,由于数据集是由ChatGPT生成的,未经严格校验,可能存在事实性错误和内容不准确的问题,这对研究结果的可靠性构成了挑战。其次,数据集中可能包含社会不适宜内容,需要在使用时进行额外的过滤和清洗。此外,如何确保数据集的使用不偏离研究目的,避免商业及有害用途,也是当前面临的挑战之一。

常用场景

经典使用场景

在自然语言处理领域,尤其是对话系统的研究与开发中,BelleGroup/multiturn_chat_0.8M数据集因其庞大的多轮对话资源而被视为宝贵的训练素材。该数据集模拟了用户与助手间的交互,为构建能够理解和回应复杂对话的智能系统提供了实验基础。

解决学术问题

该数据集解决了对话系统中上下文理解与连贯性维持的难题,使得研究者在设计对话模型时能够更好地模拟真实对话场景,进而提升模型对于复杂语境的处理能力,为学术研究提供了可靠的数据支撑。

衍生相关工作

基于该数据集,研究者们衍生出了一系列相关工作,包括但不限于对话生成模型的优化、对话系统的评价标准制定以及跨领域对话系统的构建等,进一步推动了对话系统研究的深入和广泛应用。

以上内容由遇见数据集搜集并总结生成