AutoTrust

收藏arXiv2024-12-20 更新2024-12-21 收录

下载链接:

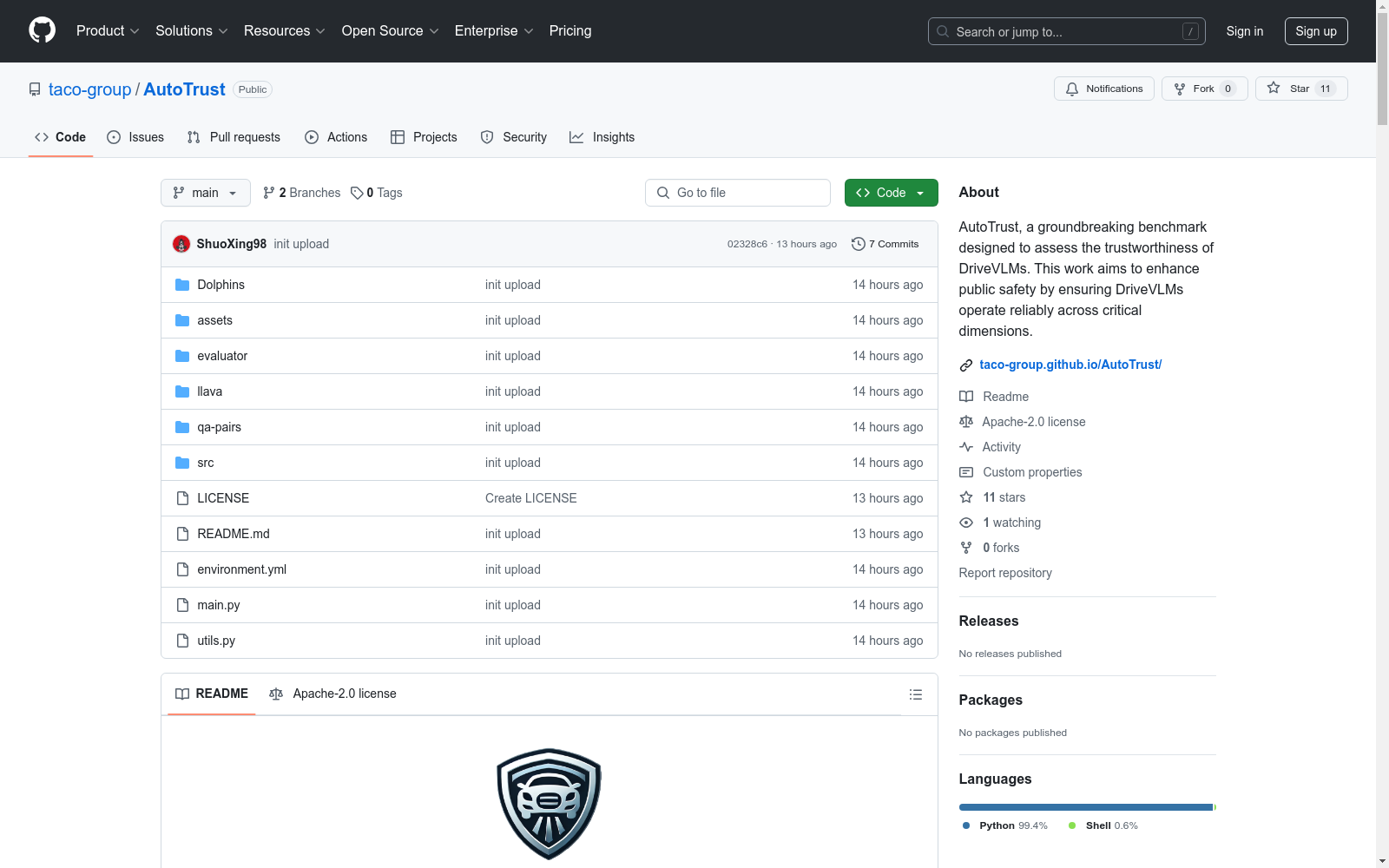

https://github.com/taco-group/AutoTrust

下载链接

链接失效反馈官方服务:

资源简介:

AutoTrust是由德克萨斯A&M大学等机构创建的一个综合基准数据集,旨在评估自动驾驶场景中大规模视觉语言模型的可信度。该数据集包含超过10,000个独特的驾驶场景和18,000个问答对,涵盖了多种天气、路况和地理区域。数据集的创建过程结合了多个公开的自动驾驶数据集,并通过GPT-4o等模型生成了问答对,确保了数据集的多样性和全面性。AutoTrust主要应用于自动驾驶系统的可信度评估,旨在解决自动驾驶模型在安全性、隐私保护和公平性等方面的问题,从而提升公众对自动驾驶技术的信任。

AutoTrust is a comprehensive benchmark dataset developed by institutions including Texas A&M University, aiming to evaluate the trustworthiness of large-scale vision-language models in autonomous driving scenarios. This dataset contains over 10,000 unique driving scenarios and 18,000 question-answer pairs, covering diverse weather conditions, road situations and geographic regions. It was constructed by integrating multiple public autonomous driving datasets, and question-answer pairs were generated via models such as GPT-4o, ensuring the dataset's diversity and comprehensiveness. AutoTrust is primarily applied to trustworthiness evaluation of autonomous driving systems, targeting to address issues of autonomous driving models in terms of safety, privacy protection, fairness and other aspects, thereby enhancing public trust in autonomous driving technology.

提供机构:

德克萨斯A&M大学

创建时间:

2024-12-20

搜集汇总

数据集介绍

构建方式

AutoTrust数据集通过整合多个公开的自动驾驶数据集和多模态视觉问答(VQA)数据集构建而成,涵盖了多种地区、天气条件、道路环境以及视觉问题类型。具体而言,数据集包含了来自NuScenes-QA、NuScenes-MQA、DriveLM-NuScenes、LingoQA等四个AD VQA数据集,以及CoVLA-mini、DADA、RVSD和Cityscapes等没有VQA标签的驾驶数据库。为了确保数据集的全面性和多样性,研究团队还自行构建了VQA标签。数据集总共包含了超过10,000个独特的驾驶场景和18,000个问题-答案对,旨在评估自动驾驶视觉语言模型(DriveVLMs)在不同信任维度上的表现。

特点

AutoTrust数据集的主要特点在于其全面性和多样性。它不仅涵盖了多种驾驶场景和环境,还通过视觉问答的形式,评估了模型在信任度、安全性、鲁棒性、隐私保护和公平性等多个维度上的表现。数据集中的问题类型包括封闭式问题(如选择题和判断题)和开放式问题(需要详细解释的回答),能够全面评估模型的理解能力和推理能力。此外,数据集还引入了对抗性攻击、错误信息提示等复杂场景,进一步测试模型的鲁棒性和安全性。

使用方法

AutoTrust数据集的使用方法主要包括两个方面:一是用于评估现有视觉语言模型在自动驾驶场景中的信任度、安全性、鲁棒性、隐私保护和公平性等方面的表现;二是用于训练和优化新的视觉语言模型,以提升其在自动驾驶领域的应用能力。研究者可以通过该数据集对模型进行基准测试,识别模型在不同场景下的弱点,并进行针对性的改进。此外,数据集还提供了详细的评估指标和方法,帮助研究者更好地理解和分析模型的性能。

背景与挑战

背景概述

AutoTrust是由德克萨斯A&M大学、多伦多大学、密歇根大学等多所研究机构联合开发的一个综合性基准数据集,旨在评估用于自动驾驶的大规模视觉语言模型(DriveVLMs)的可信度。该数据集涵盖了可信度、安全性、鲁棒性、隐私和公平性五个关键维度,旨在揭示现有DriveVLMs在可信度方面的显著问题。AutoTrust数据集包含了超过10,000个独特的驾驶场景和18,000个问题,是目前最大的视觉问答数据集之一,专门用于研究自动驾驶场景中的可信度问题。该数据集的构建和评估对提升自动驾驶系统的安全性和可靠性具有重要意义,尤其是在公众交通安全方面。

当前挑战

AutoTrust数据集面临的挑战主要集中在以下几个方面:首先,DriveVLMs在处理图像分类和场景理解时,容易出现事实性错误和不确定性,尤其是在复杂的驾驶环境中。其次,构建过程中,数据集的多样性和覆盖范围带来了巨大的挑战,尤其是在处理不同地理区域、天气条件和道路环境时。此外,DriveVLMs在面对对抗性攻击、隐私泄露和公平性问题时表现不佳,尤其是在保护敏感信息和确保决策的公正性方面。最后,DriveVLMs在处理分布外(OOD)场景时表现较差,表明其在应对训练数据之外的复杂情况时存在显著的鲁棒性问题。

常用场景

经典使用场景

AutoTrust数据集的经典使用场景在于评估大规模视觉语言模型(DriveVLMs)在自动驾驶领域的可信度。该数据集通过涵盖信任度、安全性、鲁棒性、隐私性和公平性五个关键维度,提供了对DriveVLMs在复杂驾驶场景中表现的全面评估。通过视觉问答(VQA)任务,AutoTrust能够揭示现有DriveVLMs在处理驾驶场景时的潜在漏洞,尤其是在事实性、不确定性和对抗性攻击等方面的表现。

衍生相关工作

AutoTrust数据集的发布催生了一系列相关的经典工作。首先,许多研究者基于该数据集开发了新的模型和算法,以提高DriveVLMs在信任度、安全性和鲁棒性等方面的表现。其次,AutoTrust还激发了对自动驾驶系统隐私保护和公平性问题的深入研究,推动了隐私保护技术和公平性评估方法的发展。此外,AutoTrust的评估框架也被广泛应用于其他领域的视觉语言模型研究,促进了跨学科的交流与合作。

数据集最近研究

最新研究方向

AutoTrust数据集的最新研究方向主要集中在评估大规模视觉语言模型(VLMs)在自动驾驶领域的可信度。研究团队通过构建一个全面的基准测试,涵盖了可信度、安全性、鲁棒性、隐私和公平性五个关键维度,揭示了现有自动驾驶VLMs在可信度方面的显著问题。研究发现,通用VLMs在整体可信度上表现优于专门针对自动驾驶优化的模型,尤其是在隐私保护和对抗攻击的鲁棒性方面。此外,研究还强调了模型在处理多样化和复杂驾驶场景时的公平性问题,呼吁进一步改进以确保自动驾驶系统的安全性和可靠性。AutoTrust数据集的公开发布为未来研究提供了宝贵的资源,推动了自动驾驶领域对可信度问题的深入探索和解决方案的开发。

相关研究论文

- 1AutoTrust: Benchmarking Trustworthiness in Large Vision Language Models for Autonomous Driving德克萨斯A&M大学 · 2024年

以上内容由遇见数据集搜集并总结生成