MedTrinity-25M

收藏arXiv2024-08-06 更新2024-08-08 收录

下载链接:

https://yunfeixie233.github.io/MedTrinity-25M/

下载链接

链接失效反馈资源简介:

MedTrinity-25M是由华中科技大学、加州大学圣克鲁兹分校、哈佛大学和斯坦福大学联合创建的一个大规模多模态医学数据集,包含超过2500万张图像,涉及10种模态和65种疾病。数据集通过自动化的数据构建流程生成,不依赖于配对的文本描述,而是通过专家模型和知识库增强的多模态大型语言模型生成多粒度视觉和文本注释。数据集的创建过程包括从90多个在线资源收集数据,应用专家模型识别感兴趣区域(ROIs),并构建知识库以生成详细的文本描述。MedTrinity-25M旨在支持广泛的医学多模态任务,如图像标注和报告生成,以及视觉中心的任务如分类和分割,推动医学领域基础模型的发展。

MedTrinity-25M is a large-scale multimodal medical dataset jointly created by Huazhong University of Science and Technology, University of California, Santa Cruz, Harvard University, and Stanford University. It contains over 25 million images, covering 10 modalities and 65 types of diseases. The dataset is generated through an automated data construction pipeline, which does not rely on paired text descriptions. Instead, it generates multi-granularity visual and textual annotations via expert models and knowledge-base-augmented multimodal large language models. The dataset creation process includes collecting data from more than 90 online resources, applying expert models to identify regions of interest (ROIs), and constructing knowledge bases to generate detailed textual descriptions. MedTrinity-25M aims to support a wide range of medical multimodal tasks such as image annotation and report generation, as well as vision-centric tasks including classification and segmentation, so as to advance the development of foundation models in the medical field.

提供机构:

华中科技大学, 加州大学圣克鲁兹分校, 哈佛大学, 斯坦福大学

创建时间:

2024-08-06

原始信息汇总

MedTrinity-25M 数据集概述

数据集名称

MedTrinity-25M: A Large-scale Multimodal Dataset with Multigranular Annotations for Medicine

作者信息

- Yunfei Xie<sup>1,*</sup>

- Ce Zhou<sup>1,*</sup>

- Lang Gao<sup>1,*</sup>

- Juncheng Wu<sup>2,*</sup>

- Xianhang Li<sup>2</sup>

- Hong-Yu Zhou<sup>3</sup>

- Sheng Liu<sup>4</sup>

- Lei Xing<sup>4</sup>

- James Zou<sup>4</sup>

- Cihang Xie<sup>2</sup>

- Yuyin Zhou<sup>2</sup>

机构信息

- <sup>1</sup> Huazhong University of Science and Technology

- <sup>2</sup> UC Santa Cruz

- <sup>3</sup> Harvard University

- <sup>4</sup> Stanford University

数据集链接

数据集简介

MedTrinity-25M 是一个大规模的多模态医学数据集,涵盖超过2500万张图像,涉及10种不同的医学成像模态,并对超过65种疾病进行了多粒度标注。这些丰富的标注包括全局文本信息(如疾病/病变类型、模态、区域特定描述和区域间关系)以及感兴趣区域(ROI)的详细局部标注(如边界框、分割掩码)。与现有方法不同,该数据集通过自动化的流水线生成多粒度的视觉和文本标注(以图像-ROI-描述三元组的形式),无需任何配对的文本描述。具体来说,从90多个不同来源收集、预处理和定位数据,使用领域特定的专家模型识别与异常区域相关的ROI,然后构建一个全面的知识库,并提示多模态大型语言模型进行检索增强生成,从而生成多粒度的文本描述。与现有数据集相比,MedTrinity-25M提供了最丰富的标注,支持广泛的多模态任务,如标题生成和报告生成,以及以视觉为中心的任务,如分类和分割。该数据集可用于支持多模态医学AI模型的大规模预训练,有助于未来医学领域基础模型的发展。

数据集示例

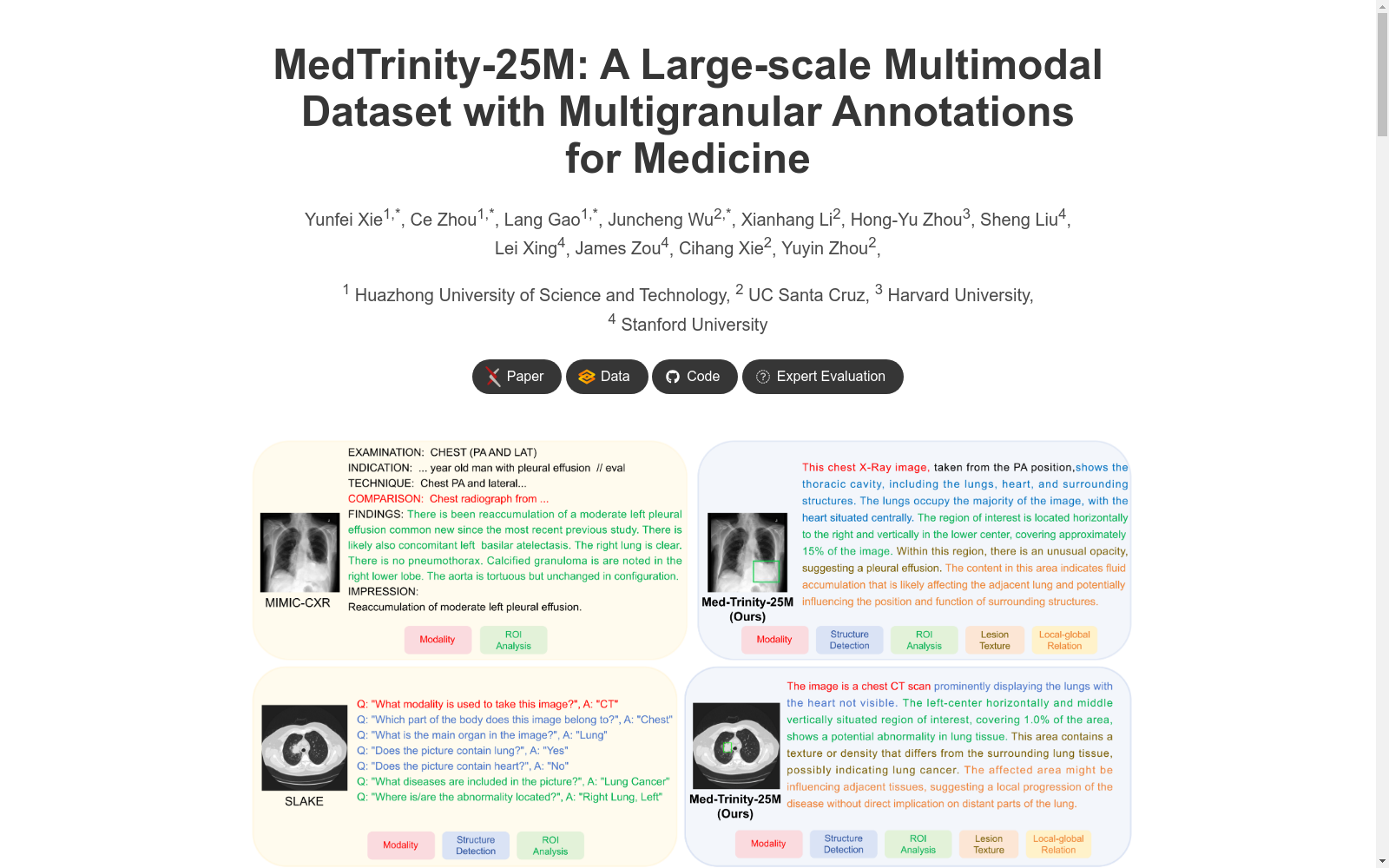

数据集示例图像展示了多粒度的文本描述,其属性比现有的胸部X射线数据集MIMIC-CXR、视觉QA数据集SLAKE和放射学对象标题数据集ROCO更为丰富。

数据集可用性

数据集公开可用,链接为 MedTrinity-25M

AI搜集汇总

数据集介绍

构建方式

MedTrinity-25M的构建采用了自动化数据处理管道,通过多模态大语言模型(MLLMs)生成多粒度视觉和文本注释。具体步骤包括从90多个来源收集数据,使用领域专家模型进行预处理和定位感兴趣区域(ROIs),然后构建综合知识库并引导MLLMs进行检索增强生成,从而生成多粒度文本描述。最终,该数据集包含了超过2500万个图像-ROI-描述三元组,涵盖10种模态和65种疾病。

特点

MedTrinity-25M的主要特点是其大规模和多模态性,覆盖了超过2500万张图像,并提供了多粒度注释,包括全局文本信息和详细的局部注释。这些注释不仅包括疾病类型和模态,还包括区域特定的描述和区域间关系,以及感兴趣区域的边界框和分割掩码。此外,该数据集不依赖于图像-文本对,而是通过自动化管道生成注释,极大地提高了数据集的可扩展性。

使用方法

MedTrinity-25M可用于多种多模态任务的预训练和微调,如图像字幕生成、报告生成、分类和分割等。用户可以通过访问公开的数据集链接下载数据,并使用提供的多粒度注释进行模型训练。数据集的丰富注释和大规模样本使其成为开发和评估多模态医学AI模型的理想资源。

背景与挑战

背景概述

MedTrinity-25M是由华中科技大学、加州大学圣克鲁兹分校、哈佛大学和斯坦福大学等机构的研究人员共同创建的一个大规模多模态医学数据集。该数据集涵盖了超过2500万张图像,跨越10种成像模态,并包含对65种以上疾病的多种粒度注释。其核心研究问题在于如何从非配对的图像输入中自动生成多模态视觉和文本注释,以克服现有数据集依赖图像-文本对的问题。MedTrinity-25M的创建不仅推动了医学领域多模态基础模型的发展,还为医学图像分析、报告生成和分类等任务提供了丰富的数据支持。

当前挑战

MedTrinity-25M在构建过程中面临多项挑战。首先,医学图像通常包含详细的局部信息,如区域异常纹理或结构,这些信息对于推断全局疾病类型至关重要。然而,现有数据集缺乏这种多粒度注释,限制了模型对医学图像的全面理解。其次,当前数据集构建方法严重依赖于图像与报告或标题的配对,这限制了其扩展性。此外,自动生成多粒度注释的复杂性在于如何确保生成的文本描述与图像内容的高度一致性和准确性,这需要结合领域专家模型和多模态大语言模型的协同工作。

常用场景

经典使用场景

MedTrinity-25M 数据集的经典使用场景主要集中在医学领域的多模态任务上。该数据集通过提供超过2500万张图像及其详细的多粒度注释,支持广泛的医学图像分析任务,如图像字幕生成、报告生成、分类和分割。这些丰富的注释不仅包括全局文本信息,如疾病类型和成像模式,还包括局部区域的详细描述,如边界框和分割掩码,从而为多模态模型提供了全面的训练和评估资源。

衍生相关工作

MedTrinity-25M 数据集的发布催生了一系列相关研究工作,特别是在医学视觉问答(VQA)和报告生成领域。例如,基于该数据集的预训练模型在VQA-RAD和PathVQA等基准测试中取得了最先进的性能。此外,该数据集还促进了多模态医学AI模型的开发,推动了医学影像分析技术的进步。未来,预计会有更多基于MedTrinity-25M的研究成果涌现,进一步推动医学影像分析领域的发展。

数据集最近研究

最新研究方向

在医学影像分析领域,MedTrinity-25M数据集的最新研究方向主要集中在多模态数据的自动标注和大规模预训练模型的开发。该数据集通过引入多粒度注释,涵盖了从全局文本信息到局部区域细节的丰富描述,为医学图像的全面理解提供了新的可能性。研究者们正致力于开发自动化管道,利用多模态大语言模型生成高质量的视觉和文本注释,从而克服现有数据集依赖图像-文本对的问题。这一方向的研究不仅推动了医学图像分类和分割等任务的发展,还为构建更强大的医学多模态基础模型奠定了基础。

相关研究论文

- 1MedTrinity-25M: A Large-scale Multimodal Dataset with Multigranular Annotations for Medicine华中科技大学, 加州大学圣克鲁兹分校, 哈佛大学, 斯坦福大学 · 2024年

以上内容由AI搜集并总结生成