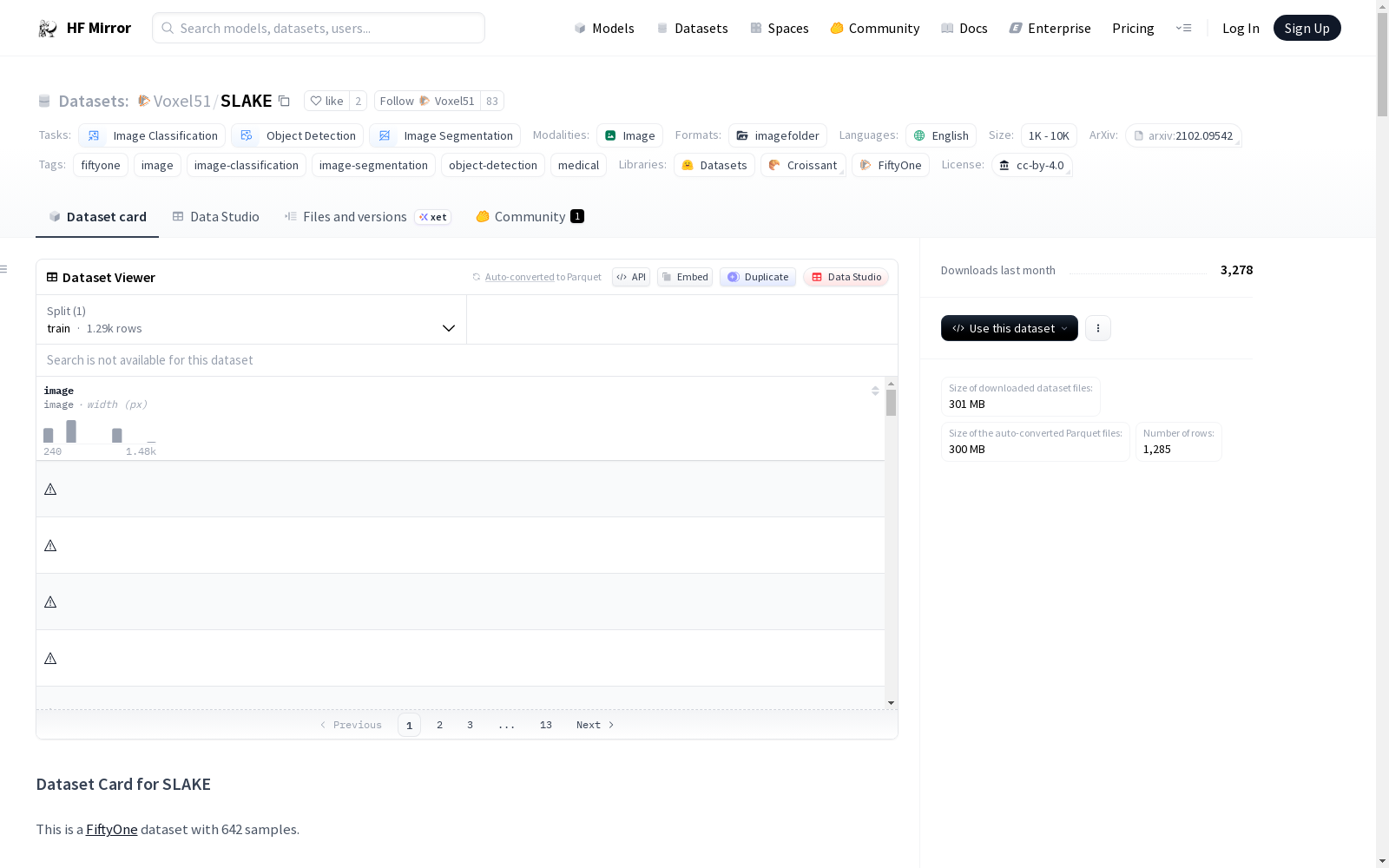

Voxel51/SLAKE

收藏Hugging Face2025-05-23 更新2025-07-05 收录

下载链接:

https://hf-mirror.com/datasets/Voxel51/SLAKE

下载链接

链接失效反馈官方服务:

资源简介:

SLAKE(语义标注知识增强)是一个大规模的双语(英文和中文)医疗视觉问答(Med-VQA)数据集。它包含了跨多种成像模式(CT、MRI、X射线)的放射学图像,具有详细的语义注释、全面的问题-答案对和一个结构化的医疗知识图谱。SLAKE涵盖了五个身体部位(头部、颈部、胸部、腹部和骨盆腔),并包括视觉推理和基于知识的推理任务。该数据集旨在推动能够理解临床图像并回答医疗问题的医疗AI系统的发展。

SLAKE (Semantically-Labeled Knowledge-Enhanced) is a large-scale bilingual (English and Chinese) dataset for Medical Visual Question Answering (Med-VQA). It consists of radiology images across multiple modalities (CT, MRI, X-Ray) with detailed semantic annotations, comprehensive question-answer pairs, and a structured medical knowledge graph. SLAKE covers five body parts (head, neck, chest, abdomen, and pelvic cavity) and includes both visual reasoning and knowledge-based reasoning tasks. The dataset is specifically designed to advance the development of medical AI systems that can understand clinical images and answer medical questions.

提供机构:

Voxel51

搜集汇总

数据集介绍

构建方式

在医学视觉问答领域,SLAKE数据集的构建体现了多模态医学数据的系统性整合。该数据集从公开医学影像资源中精选了642幅放射学图像,涵盖CT、MRI和X射线三种模态,并覆盖头部、颈部、胸部、腹部及盆腔五个解剖区域。构建过程中,经验丰富的医师利用专业标注软件对图像中的39个器官和12种疾病进行了精细的语义分割与边界框标注。同时,研究团队设计了一套包含十类临床问题的模板,由医师生成并审核了14,028对双语问答数据。此外,数据集还集成了从结构化知识库中提取并人工校验的医学知识图谱,形成了影像、标注、问答与知识三元组深度融合的数据体系。

使用方法

针对医学人工智能的研究与应用,SLAKE数据集为开发先进的视觉问答系统提供了完备的试验平台。使用者可通过FiftyOne库便捷地加载数据集,利用其统一的接口访问影像、检测框、分割掩码及附带的问答对与元数据。研究人员可基于此训练端到端的Med-VQA模型,探索多模态特征融合与外部知识注入机制。数据集的结构化设计也支持对模型进行细粒度评估,例如分析其在特定问题类型或身体部位上的表现。在具体操作中,开发者可调用`load_from_hub`函数导入数据,并利用配套工具进行可视化分析与模型迭代。

背景与挑战

背景概述

在医学人工智能领域,视觉问答任务旨在构建能够理解临床影像并回答相关医学问题的智能系统。SLAKE数据集由香港理工大学、四川大学华西医院及四川省医学科学院的研究团队于2021年联合创建,其核心研究问题是推动医学视觉问答模型的发展,通过整合多模态影像数据、语义标注及结构化医学知识图谱,以支持更复杂的临床推理。该数据集涵盖CT、MRI和X射线三种影像模态,包含超过1.4万个双语问答对,显著提升了医学视觉推理任务的深度与广度,为后续研究提供了重要的基准资源。

当前挑战

SLAKE数据集致力于解决医学视觉问答领域的核心挑战,即如何使模型不仅识别影像中的视觉特征,还能结合外部医学知识进行逻辑推理。其构建过程面临多重困难:在数据收集阶段,需从公开医学影像库中筛选并协调多模态、多身体部位的影像,确保临床代表性与多样性;在标注环节,依赖资深医师手动完成器官分割、疾病标注及问答对设计,过程耗时且要求极高的专业一致性;此外,构建与影像匹配的双语知识图谱需从庞杂的医学知识源中提取、过滤并结构化,以保障其准确性与实用性。

常用场景

经典使用场景

在医学人工智能领域,SLAKE数据集为医学视觉问答(Med-VQA)研究提供了关键支撑。该数据集整合了多模态医学影像与双语问答对,覆盖CT、MRI及X射线等多种成像技术,并辅以详尽的语义标注与结构化知识图谱。研究者通常利用其训练端到端的Med-VQA模型,通过联合学习视觉特征与医学知识,实现对影像内容的深度理解与临床问题的精准回答,从而推动诊断辅助系统的智能化演进。

解决学术问题

SLAKE数据集有效应对了医学视觉问答研究中长期存在的若干挑战。它通过提供器官分割掩码与边界框标注,解决了模型难以定位感兴趣区域的难题;其内嵌的大规模医学知识图谱,为回答需依赖外部知识的复杂临床问题提供了结构化信息支撑;同时,数据集涵盖多身体部位与影像模态,并平衡了答案分布,有助于缓解模型因数据偏差而产生的过拟合,为开发更具鲁棒性与可解释性的医疗AI系统奠定了数据基础。

实际应用

超越纯学术探索,SLAKE数据集支撑的系统在临床实践中展现出潜在价值。基于该数据集训练的Med-VQA模型,可作为第二意见系统辅助放射科医生进行影像解读,提升诊断效率与一致性。在医学教育场景中,此类系统能够模拟临床问答,帮助医学生或住院医师深化对影像解剖与病理特征的理解。此外,它还可集成到患者门户或健康管理平台,以通俗语言向患者解释影像报告,增强医患沟通与健康素养。

数据集最近研究

最新研究方向

在医学视觉问答领域,SLAKE数据集凭借其双语特性、丰富的语义标注及结构化医学知识图谱,已成为推动多模态医学人工智能发展的关键资源。当前研究前沿聚焦于探索如何深度融合视觉特征与外部知识,以提升模型在复杂临床场景下的推理能力。具体而言,学者们正致力于开发新型的跨模态注意力机制与图神经网络架构,旨在更精准地关联影像中的解剖结构与知识图谱中的医学概念,从而回答需要深层医学知识的问题。此外,利用SLAKE进行模型可解释性研究也是一个热点,旨在使AI的决策过程对临床医生更为透明可信。这些探索不仅推动了Med-VQA技术的进步,也为构建辅助诊断、医学教育等实用系统奠定了重要基础,具有显著的科研与应用价值。

以上内容由遇见数据集搜集并总结生成