SUPS

收藏arXiv2023-02-25 更新2024-06-21 收录

下载链接:

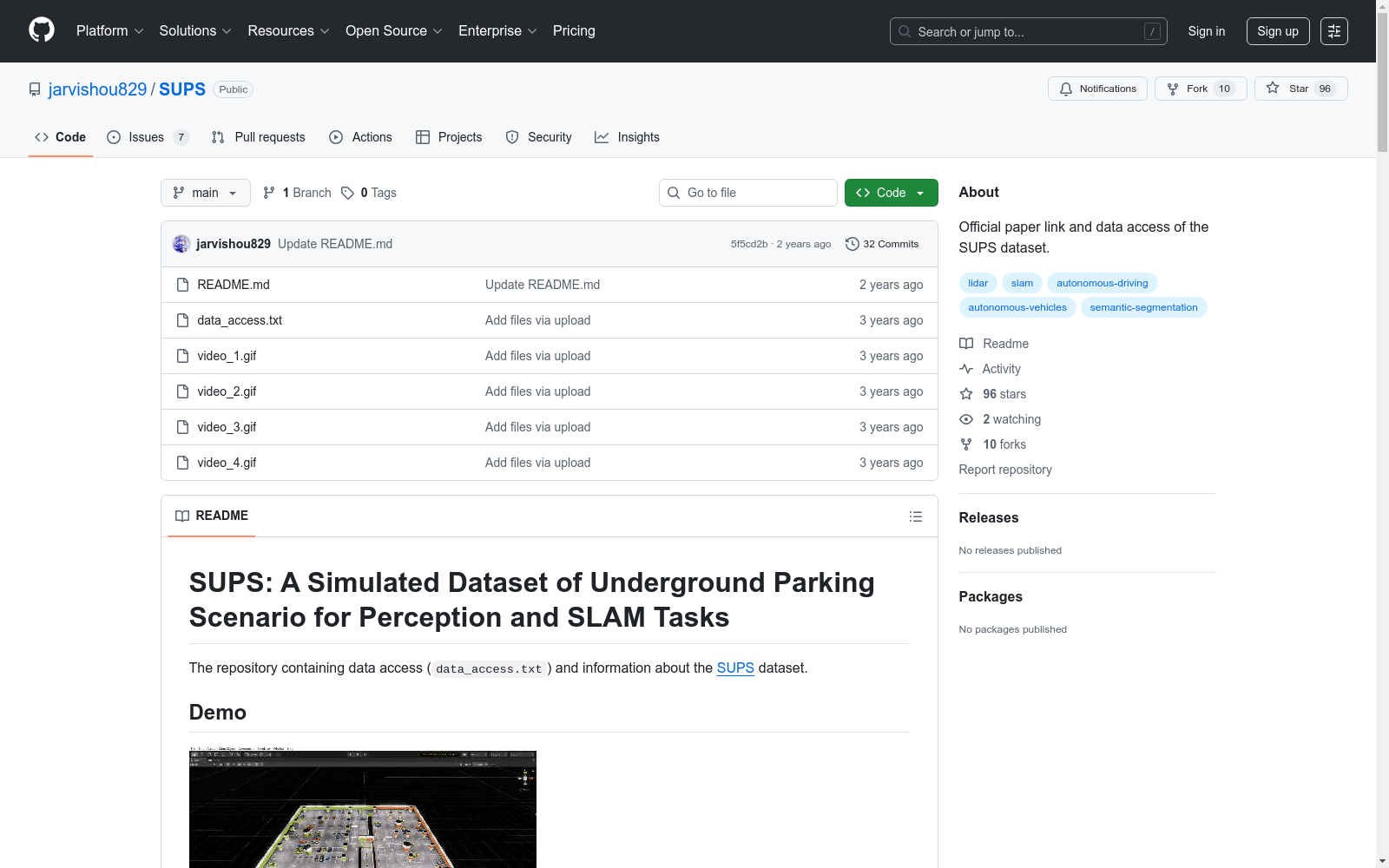

https://github.com/jarvishou829/SUPS

下载链接

链接失效反馈资源简介:

SUPS数据集是由复旦大学计算机科学与技术学院创建的模拟地下停车场景数据集,专为自动驾驶研究设计。该数据集包含多种传感器数据,如鱼眼相机、前向针孔相机、深度相机、激光雷达、惯性测量单元和全球导航卫星系统,支持感知、3D重建、深度估计和SLAM等任务。数据集通过Unity引擎模拟创建,场景复杂度与真实地下停车场景相似,旨在解决自动驾驶在地下环境中的定位和地图构建问题。

The SUPS dataset is a simulated underground parking scene dataset created by the School of Computer Science and Technology, Fudan University, specifically designed for autonomous driving research. This dataset includes multiple types of sensor data, such as fisheye cameras, forward pinhole cameras, depth cameras, LiDAR, inertial measurement units (IMU) and global navigation satellite systems (GNSS), supporting tasks including perception, 3D reconstruction, depth estimation and SLAM. Developed via the Unity engine, the dataset features scene complexity comparable to real underground parking scenarios, aiming to address the challenges of positioning and map construction for autonomous driving in underground environments.

提供机构:

复旦大学计算机科学与技术学院

创建时间:

2023-02-25

AI搜集汇总

数据集介绍

构建方式

为了应对自动驾驶在地下停车场场景中遇到的挑战,SUPS数据集应运而生。该数据集通过LGSVL平台模拟了一个地下停车场场景,并使用Unity Engine构建了一个三维虚拟场景。场景中包含了道路、车位、交通标志、照明等多种元素,以模拟真实世界中的地下停车场环境。数据集记录了来自四个鱼眼相机、两个前视针孔相机、一个深度相机和激光雷达的数据,以及来自惯性测量单元(IMU)和GNSS的数据。同时,数据集还提供了像素级语义标签,包括地面标志、车道线、车位线、速度等。为了支持SLAM任务和感知任务,数据集还提供了连续图像的时间戳和语义标签的对应关系。

特点

SUPS数据集具有以下特点:1)多传感器数据:数据集包含了多种传感器的数据,包括鱼眼相机、针孔相机、深度相机、激光雷达、IMU和GNSS,可以支持多种任务,如语义分割、车位检测、深度估计、视觉SLAM和基于激光雷达的SLAM。2)语义标签丰富:数据集提供了像素级语义标签,包括地面标志、车道线、车位线、速度等,可以支持多种感知任务。3)环境多样性:虚拟场景包含了多种不同的道路循环、交叉路口、入口、单行道、眩光、暗区、低纹理区域等,可以模拟真实世界中的地下停车场环境。4)数据集开放:数据集和虚拟场景已经开源,可以供研究人员进行自定义修改。

使用方法

使用SUPS数据集时,首先需要下载数据集和虚拟场景。然后,可以根据需要选择不同的传感器数据,如鱼眼相机、针孔相机、深度相机、激光雷达、IMU和GNSS。对于感知任务,可以使用数据集中的语义标签进行训练和测试。对于SLAM任务,可以使用数据集中的连续图像和时间戳进行训练和测试。此外,数据集还提供了鸟瞰图(BEV)图像和语义分割真值,可以用于支持感知和决策。最后,数据集还提供了车位检测的描述形式,可以用于支持车位检测算法的开发。

背景与挑战

背景概述

随着自动驾驶技术的不断发展,自动地下停车场成为自动驾驶技术的重要组成部分。然而,现有的自动驾驶数据集大多针对地面场景设计,缺乏专门针对地下停车场场景的数据集。为了填补这一空白,复旦大学计算机科学学院的Jiawei Hou等人于2023年2月25日在arXiv上发布了SUPS数据集,该数据集是一个模拟的地下自动停车场场景数据集,旨在支持多任务、多传感器和多语义标签,为自动驾驶算法提供基准测试和挑战。SUPS数据集的创建为自动驾驶领域的研究提供了宝贵的资源,有助于推动自动地下停车场技术的发展。

当前挑战

SUPS数据集的构建面临着多个挑战。首先,地下停车场场景具有狭窄的道路、障碍物、光线昏暗或炫目、墙壁纹理差等特点,这些因素增加了传感器测量的噪声和不确定性,对SLAM和感知算法提出了更高的要求。其次,现有的自动驾驶数据集大多只支持SLAM或感知任务,而SUPS数据集需要同时支持这两类任务,因此需要提供更全面和准确的数据标签。此外,地下停车场场景中障碍物和地面标志的语义信息密度较大,包括墙壁、柱子、可行驶区域、车道、停车位、箭头和凸起等,这些信息的标注需要大量的人力。为了解决这些挑战,SUPS数据集采用了虚拟仿真技术,模拟了真实的地下停车场场景,并提供了多种传感器数据和像素级语义标签,为自动驾驶算法的研究提供了重要的支持。

常用场景

经典使用场景

在自动驾驶领域,地下停车场是一个复杂且具有挑战性的场景。SUPS数据集通过模拟真实环境,为研究自动驾驶车辆在地下停车场中的感知、定位和建图等任务提供了丰富的数据支持。该数据集包含了多传感器数据,包括鱼眼相机、针孔相机、深度相机、激光雷达、惯性测量单元(IMU)和全球导航卫星系统(GNSS),以及与时间戳对齐的多语义标签。这些数据可以用于训练和评估自动驾驶车辆的算法,使其能够准确地感知周围环境、定位自身位置并建立可靠的环境地图。

衍生相关工作

基于SUPS数据集,研究人员可以进行一系列相关研究。例如,可以进一步探索语义分割、车位检测、深度估计和SLAM等算法在地下停车场场景中的应用,以提高自动驾驶车辆的感知和定位能力。此外,还可以研究如何利用SUPS数据集进行自动驾驶车辆的运动规划和决策控制,使其能够更加安全、高效地完成地下停车场中的停车任务。此外,基于SUPS数据集还可以进行虚拟场景的构建和仿真,为自动驾驶车辆的测试和验证提供更加真实的环境。

数据集最近研究

最新研究方向

针对自动驾驶领域自动地下停车场景的需求,SUPS数据集的提出填补了现有数据集在多传感器融合、多任务支持以及环境多样性方面的空白。该数据集模拟了真实地下停车环境,提供了多源传感器数据,包括鱼眼相机、针孔相机、深度相机、激光雷达、惯性测量单元(IMU)和全球导航卫星系统(GNSS),并针对每个传感器提供了像素级语义分割标签,支持语义分割、车位检测、深度估计、视觉SLAM和激光雷达SLAM等任务。SUPS数据集的提出,为自动驾驶领域的研究人员提供了丰富的数据资源,有助于提升自动驾驶车辆在复杂环境下的感知和定位能力,推动自动驾驶技术在地下停车场景中的应用。

相关研究论文

- 1SUPS: A Simulated Underground Parking Scenario Dataset for Autonomous Driving复旦大学计算机科学与技术学院 · 2023年

以上内容由AI搜集并总结生成