csebuetnlp/xlsum

收藏Hugging Face2023-04-18 更新2024-03-04 收录

下载链接:

https://hf-mirror.com/datasets/csebuetnlp/xlsum

下载链接

链接失效反馈资源简介:

XL-Sum是一个包含1.35百万个经过专业注释的文章-摘要对的多样化数据集,涵盖了从低资源到高资源的45种语言。该数据集适用于摘要生成和文本生成任务,具有高度的抽象性、简洁性和高质量。数据来源于BBC新闻,经过精心设计的启发式方法提取。

提供机构:

csebuetnlp

原始信息汇总

数据集概述

数据集名称

- 名称: XL-Sum

- 别名: XLSum

数据集描述

- 概述: XL-Sum 是一个包含1.35百万个专业标注的文章-摘要对的全面且多样化的数据集,这些数据从BBC提取,使用了一套精心设计的启发式方法。该数据集覆盖了45种语言,涵盖了从低资源到高资源的语言,其中许多语言目前没有公开可用的数据集。XL-Sum 高度抽象、简洁且质量高,这一点已通过人类和内在评估得到证实。

支持的任务和排行榜

- 任务: 摘要生成、文本生成

语言

- 支持的语言: 包括但不限于阿姆哈拉语、阿拉伯语、阿塞拜疆语、孟加拉语、缅甸语、简体中文、繁体中文、英语、法语、古吉拉特语、豪萨语、印地语、伊博语、印度尼西亚语、日语、基隆迪语、韩语、吉尔吉斯语、马拉地语、尼泊尔语、奥罗莫语、普什图语、波斯语、皮钦语、葡萄牙语、旁遮普语、俄语、苏格兰盖尔语、塞尔维亚语(西里尔字母)、塞尔维亚语(拉丁字母)、僧伽罗语、索马里语、西班牙语、斯瓦希里语、泰米尔语、泰卢固语、泰语、提格里尼亚语、土耳其语、乌克兰语、乌尔都语、乌兹别克语、越南语、威尔士语、约鲁巴语。

数据集结构

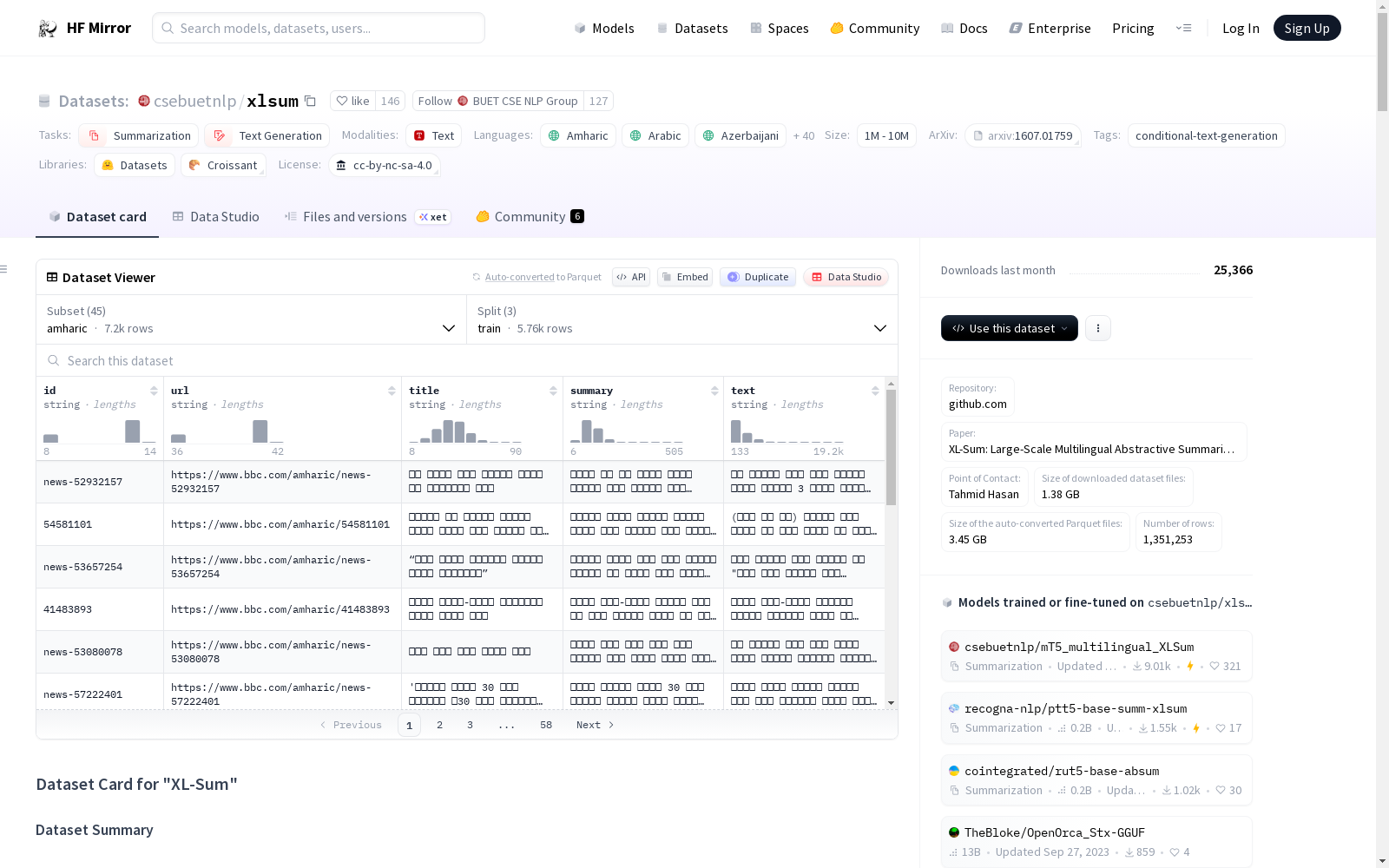

- 数据实例: 每个实例包括文章ID、URL、标题、摘要和全文。

- 数据字段: 包括id, url, title, summary, text。

- 数据分割: 大多数语言采用80%-10%-10%的分割,但英语、苏格兰盖尔语、吉尔吉斯语和僧伽罗语有特殊分割比例。

数据集创建

- 来源数据: 来自BBC新闻。

- 许可证: 数据集内容受Creative Commons Attribution-NonCommercial-ShareAlike 4.0 International License (CC BY-NC-SA 4.0)限制,仅用于非商业研究目的。

引用信息

-

引用: 如果使用该数据集,请引用以下论文:

@inproceedings{hasan-etal-2021-xl, title = "{XL}-Sum: Large-Scale Multilingual Abstractive Summarization for 44 Languages", author = "Hasan, Tahmid and Bhattacharjee, Abhik and Islam, Md. Saiful and Mubasshir, Kazi and Li, Yuan-Fang and Kang, Yong-Bin and Rahman, M. Sohel and Shahriyar, Rifat", booktitle = "Findings of the Association for Computational Linguistics: ACL-IJCNLP 2021", month = aug, year = "2021", address = "Online", publisher = "Association for Computational Linguistics", url = "https://aclanthology.org/2021.findings-acl.413", pages = "4693--4703", }

搜集汇总

数据集介绍

构建方式

在自然语言处理领域,多语言摘要生成任务长期面临数据稀缺的挑战。XL-Sum数据集的构建采用了系统化的方法,从BBC新闻的多语言子站点中自动采集原始文章,并运用精心设计的启发式规则提取对应的摘要。这一过程确保了数据来源的权威性与一致性,最终形成了涵盖45种语言、总计135万篇高质量文章-摘要对的大规模语料库,为低资源语言的摘要研究提供了宝贵的数据基础。

特点

作为当前规模最大的多语言摘要数据集,XL-Sum的显著特征在于其卓越的语言覆盖广度与数据质量。它不仅包含了英语、中文等高资源语言,更收录了大量如阿姆哈拉语、约鲁巴语等低资源语言的样本,有效填补了相关领域的空白。数据集中的摘要由专业编辑撰写,具备高度的抽象性、简洁性和一致性,其内在质量通过了严格的人工与自动评估,为构建稳健的多语言摘要模型提供了可靠支撑。

使用方法

该数据集主要服务于文本摘要与文本生成的研究与应用。使用者可通过HuggingFace平台直接加载数据集,并依据其预设的80%-10%-10%标准划分进行模型训练、验证与测试。对于英语等特定语言,数据划分比例经过了特殊调整,以适配主流基准测试的评估规模。研究人员可利用该数据集训练跨语言或语言特定的抽象摘要模型,评估模型在多语言场景下的泛化能力,并推动面向全球语言的摘要技术发展。

背景与挑战

背景概述

在自然语言处理领域,多语言文本摘要任务长期面临数据稀缺的困境,尤其是对于资源匮乏的语言。2021年,孟加拉国工程技术大学计算机科学与工程系的研究团队推出了XL-Sum数据集,旨在填补这一空白。该数据集由Tahmid Hasan等人构建,收录了来自BBC新闻的135万篇高质量文章-摘要对,涵盖44种语言,从高资源的英语到低资源的约鲁巴语均有所涉及。其核心研究问题聚焦于推动多语言抽象摘要模型的发展,通过提供大规模、多样化的语料,显著促进了跨语言摘要技术的进步,并为全球语言平等访问信息提供了重要支持。

当前挑战

XL-Sum数据集致力于解决多语言抽象摘要中的核心挑战,即如何为资源匮乏的语言构建高质量、抽象化的摘要模型。在构建过程中,研究团队面临多重困难:首先,需从BBC多语言子域名中精准提取并清洗数据,确保文章与摘要的对齐质量;其次,针对不同语言的数据量差异,特别是如苏格兰盖尔语等低资源语言,需设计平衡的数据划分策略以避免评估偏差;此外,数据集的抽象性要求摘要高度凝练且忠于原文,这对自动标注流程的启发式设计提出了严峻考验。这些挑战共同塑造了数据集的复杂性与实用价值。

常用场景

经典使用场景

在自然语言处理领域,多语言摘要生成任务长期面临数据稀缺的挑战,尤其对于资源匮乏的语言。XL-Sum数据集以其涵盖44种语言的百万级文章-摘要对,为跨语言抽象摘要研究提供了标准化的评测基准。研究者常利用该数据集训练与评估多语言序列到序列模型,探索模型在低资源语言上的迁移能力,以及多语言联合训练对摘要质量的影响。其数据源自BBC专业新闻内容,确保了摘要的抽象性和语言规范性,成为推动多语言摘要技术发展的核心资源。

实际应用

在实际应用层面,XL-Sum数据集支撑了多语言新闻聚合、跨语言信息检索以及全球化内容分发系统的开发。基于该数据集训练的模型能够自动为不同语言的新闻文章生成简洁摘要,助力媒体机构快速生产多语言新闻简报,或为跨国企业提供跨语言市场情报分析。此外,其在教育科技领域可用于开发语言学习工具,帮助学习者通过对比原文与摘要提升阅读理解能力。

衍生相关工作

围绕XL-Sum数据集,学术界涌现了一系列经典研究工作。例如,有研究利用其探索多语言预训练模型如mT5、mBART在摘要任务上的微调策略与性能极限。另有工作专注于低资源语言的少样本与零样本摘要生成,通过跨语言迁移改善模型在稀缺语言上的表现。此外,该数据集也常被用于构建多任务学习框架,或将摘要与其他自然语言生成任务结合,以提升模型的通用语言理解与生成能力。

以上内容由遇见数据集搜集并总结生成