M-DAIGT

收藏arXiv2025-11-14 更新2025-11-18 收录

下载链接:

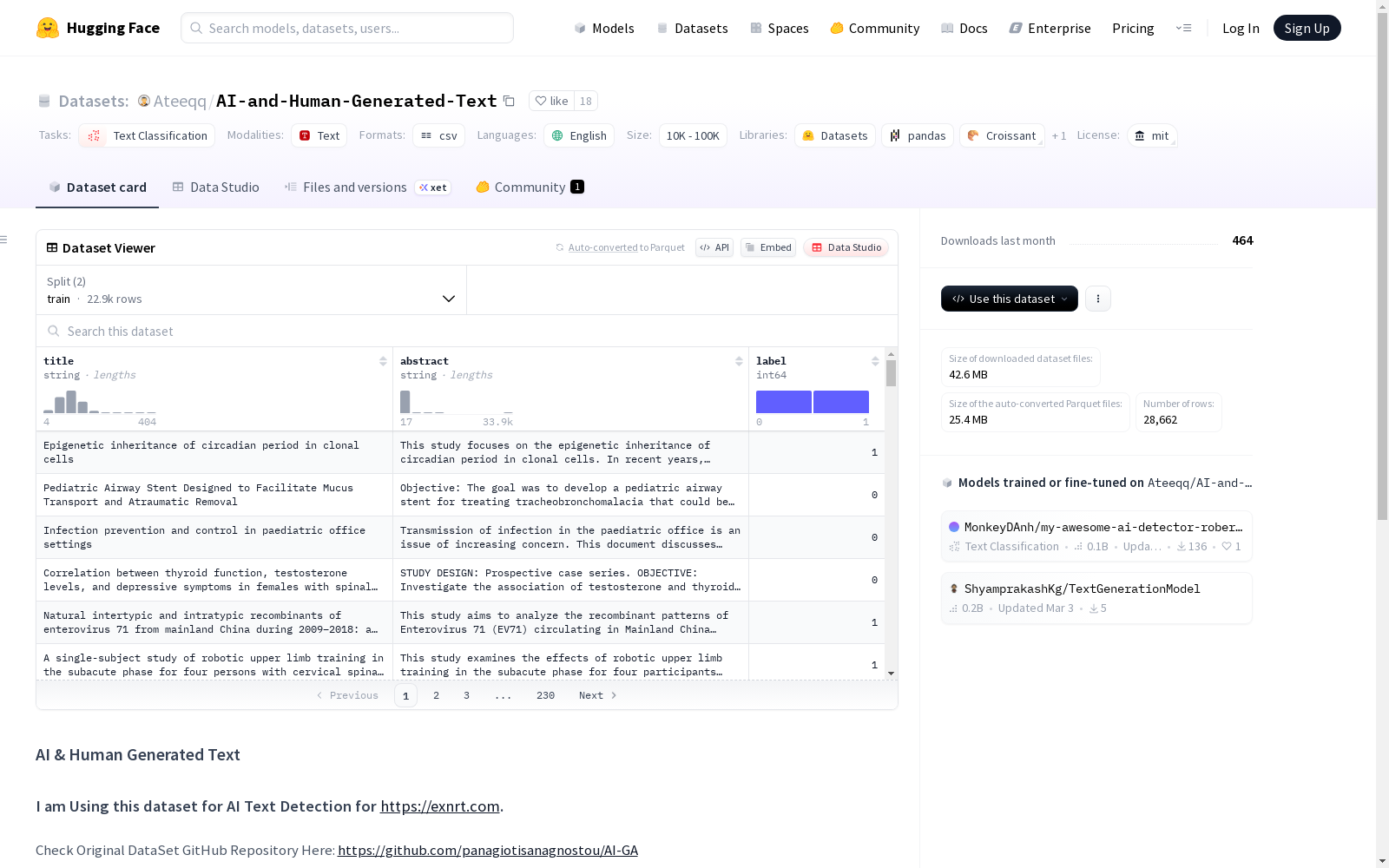

https://huggingface.co/datasets/Ateeqq/AI-and-Human-Generated-Text

下载链接

链接失效反馈资源简介:

M-DAIGT是由多国研究机构联合构建的大规模AI生成文本检测基准数据集,涵盖新闻与学术两大关键领域。该数据集包含三万条平衡样本,其中人类撰写与AI生成文本各半,覆盖GPT-4、Claude等前沿模型生成的多样化内容。数据通过提取新闻标题与论文摘要作为提示词,采用角色随机分配策略生成风格各异的文本。该资源专为提升数字信息生态完整性而设计,支持跨领域AI文本检测模型的开发与评估,对防范虚假新闻与学术不端具有重要价值。

提供机构:

卢森堡大学, 法赫德国王石油与矿产大学, 穆罕默德六世理工大学, 西迪·穆罕默德·本·阿卜杜拉大学

创建时间:

2025-11-14

原始信息汇总

AI & Human Generated Text 数据集概述

数据集基本信息

- 许可证: MIT

- 语言: 英语

- 规模: 10K-100K

- 任务类别: 文本分类

数据集描述

- 全称: Artificial Intelligence Generated Abstracts (AI-GA)

- 内容构成: 包含摘要和标题

- 数据分布: 50%为AI生成摘要,50%为原始摘要

- 样本数量: 28,662个样本

- 样本结构: 每个样本包含摘要、标题和标签

标签说明

- 标签0: 原始摘要

- 标签1: AI生成摘要

技术特征

- AI生成摘要采用最先进的语言生成技术

- 主要基于GPT-3模型生成

应用用途

- 主要用于自然语言处理研究

- 特别适用于语言生成和机器学习实验

- 可用于AI文本检测研究

相关资源

- 原始GitHub仓库: https://github.com/panagiotisanagnostou/AI-GA

- 大型替代数据集: https://github.com/sakibsh/LLM

AI搜集汇总

数据集介绍

构建方式

在人工智能生成文本检测领域,构建高质量数据集是推动技术发展的关键。M-DAIGT数据集通过精心设计的流程,汇集了新闻与学术两大关键领域的文本样本。该数据集包含三万个平衡样本,其中人类撰写文本源自CNN新闻网站与2019年前发布的arXiv论文摘要,确保内容真实性;AI生成文本则采用多样化生成策略,通过GPT-4、Claude等前沿大语言模型,配合随机角色设定与结构化提示模板,模拟不同写作风格与语言特征,最终形成覆盖多领域、多风格的基准数据集。

使用方法

为支持系统化评估,数据集采用标准化的任务框架与评估体系。研究社区可通过两个二分类子任务展开探索:新闻文本检测与学术文本检测,分别针对不同领域的生成文本识别需求。数据集按7:1.5:1.5比例划分为训练集、开发集与测试集,确保模型训练与验证的可靠性。评估采用F1分数作为核心指标,辅以准确率、精确率与召回率等多维度度量,同时支持对文本长度、主题领域等特性的细粒度分析,为检测算法的鲁棒性评估提供全面支撑。

背景与挑战

背景概述

随着大语言模型生成文本的流畅度不断提升,信息完整性与学术研究面临严峻挑战。M-DAIGT数据集由卢森堡大学、法赫德国王石油矿产大学等机构于2025年联合创建,聚焦新闻与学术写作两大关键领域,旨在构建跨领域AI生成文本检测基准。该数据集包含三万个平衡样本,涵盖GPT-4、Claude等多种生成模型输出,通过46支团队参与的共享任务验证,为数字内容真实性研究提供了重要基础设施。

当前挑战

在领域问题层面,AI生成文本检测面临语义混淆性挑战,现代大语言模型生成的文本兼具语法准确性与风格连贯性,使人类判别准确率仅略高于随机水平。构建过程中需应对数据多样性难题,需平衡多领域文本风格差异,同时规避训练数据递归退化风险。技术层面需解决对抗性攻击漏洞,如转述攻击与文本人工化处理导致的检测失效,以及跨语言泛化能力不足等核心问题。

常用场景

解决学术问题

该数据集主要解决了大语言模型时代文本真实性鉴别的关键学术难题。针对传统检测方法在跨领域泛化、对抗性攻击和风格迁移等方面的脆弱性,M-DAIGT通过构建多模型生成策略和多样化提示词体系,为研究社区提供了系统评估检测算法鲁棒性的实验平台。其学术意义在于突破了单一领域检测的局限性,通过新闻与学术双领域的对比研究,揭示了不同文本类型中AI生成内容的特征差异。该数据集进一步推动了检测方法从基于统计特征向深度学习模型的范式转变,为解决递归退化问题——即未来语言模型可能基于互联网大量AI生成文本训练导致性能下降——提供了重要的数据支撑。

实际应用

在实际应用层面,M-DAIGT数据集支撑的检测技术已在多个关键领域产生深远影响。新闻行业利用该数据集训练的检测模型,能够有效识别自动化生成的不实信息,维护新闻传播生态的完整性。教育机构通过学术写作检测系统,可辨识学生作业中可能存在的AI代笔现象,保障学术诚信评估的公正性。出版领域借助此类技术对投稿内容进行初步筛查,防止AI生成文本对学术出版质量的潜在侵蚀。这些应用不仅体现了技术落地的现实价值,更在数字信息生态治理层面构建了重要的技术防线,为应对日益复杂的AI生成内容挑战提供了实践解决方案。

数据集最近研究

最新研究方向

随着大语言模型生成文本的流畅度不断提升,AI生成内容检测已成为维护信息完整性与学术诚信的前沿课题。M-DAIGT数据集聚焦新闻与学术写作两大关键领域,通过构建包含三万个平衡样本的多领域基准,推动了检测技术向跨领域泛化与对抗性鲁棒性方向演进。当前研究热点集中于融合统计特征与Transformer架构的混合模型,例如结合风格计量学指标与预训练语言模型的方案,以应对提示策略变异与语义改写攻击。该数据集通过共享任务形式吸引了46支团队参与,其成果揭示了学术文本因结构规整而更易检测的领域特性,同时凸显了轻量级传统方法在新闻领域的持续竞争力,为构建多语言、抗干扰的下一代检测系统奠定了实验基础。

相关研究论文

- 1M-DAIGT: A Shared Task on Multi-Domain Detection of AI-Generated Text卢森堡大学, 法赫德国王石油与矿产大学, 穆罕默德六世理工大学, 西迪·穆罕默德·本·阿卜杜拉大学 · 2025年

以上内容由AI搜集并总结生成