【我遇到的问题】 • 现象:该数据集的下载链接已失效 【相关信息】 • 可考虑访问这个链接获取类似文件~https://www.selectdataset.com/dataset/3688356173feccbcf1f1e490ddc6bc72

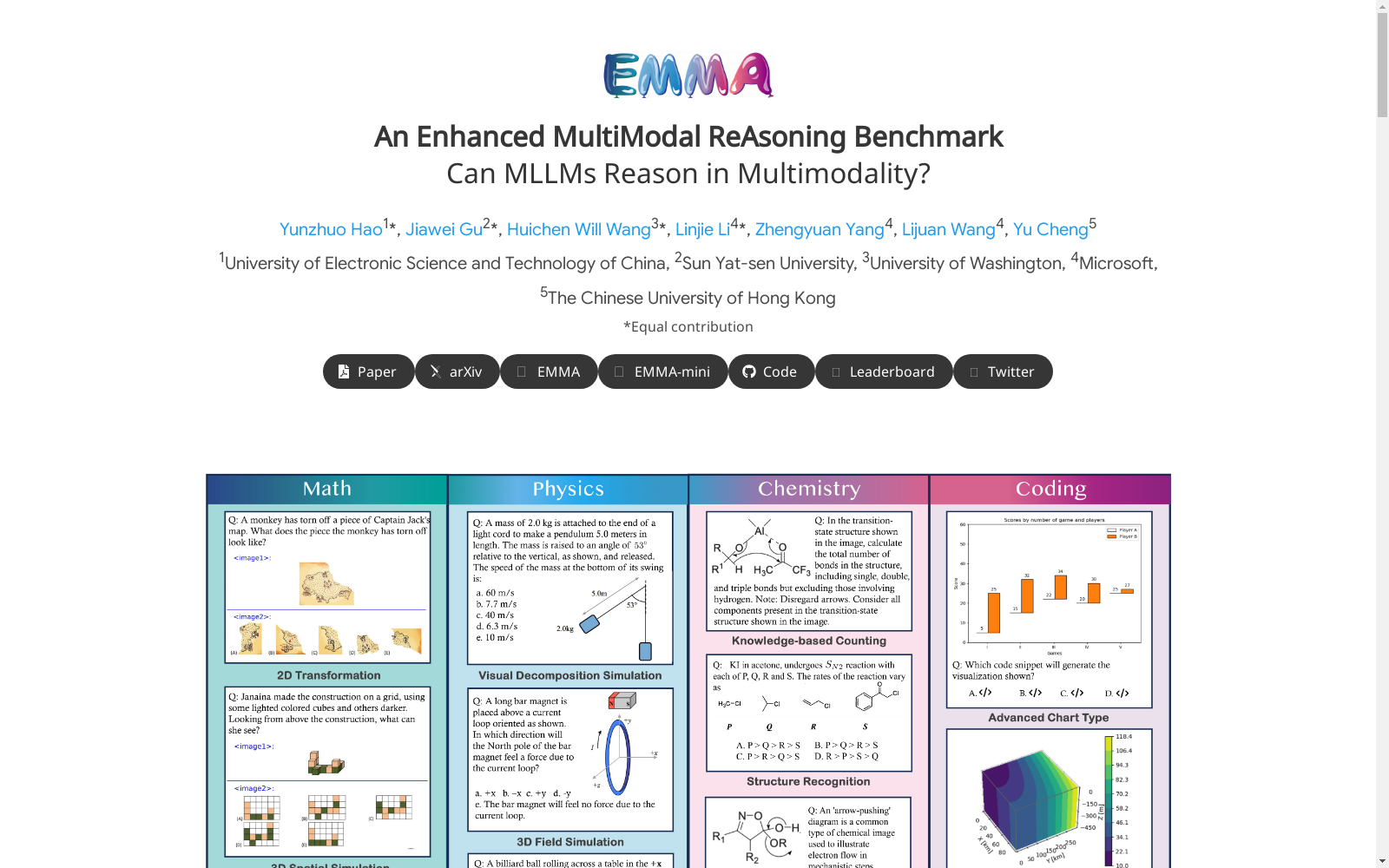

EMMA (Enhanced MultiModal reAsoning)

收藏arXiv2025-01-10 更新2025-01-14 收录

下载链接:

https://emma-benchmark.github.io/

下载链接

链接失效反馈官方服务:

资源简介:

EMMA(增强多模态推理)数据集由电子科技大学、中山大学、华盛顿大学、微软和香港中文大学的研究团队共同创建,旨在评估多模态大语言模型在数学、物理、化学和编程领域的多模态推理能力。该数据集包含2788个问题,其中1796个是新构建的,问题类型涵盖选择题和开放式问题,涉及图像和文本的多模态推理任务。数据集的构建过程包括从现有基准中筛选问题,并通过与领域专家合作手动创建新问题。EMMA的应用领域主要集中在多模态推理能力的评估,旨在解决当前MLLMs在处理复杂多模态和多步推理任务时的局限性。

EMMA (Enhanced Multimodal Reasoning) dataset was co-created by research teams from the University of Electronic Science and Technology of China, Sun Yat-sen University, the University of Washington, Microsoft, and The Chinese University of Hong Kong. It is designed to evaluate the multimodal reasoning capabilities of multimodal large language models (MLLMs) across the domains of mathematics, physics, chemistry, and programming. This dataset contains 2,788 questions, among which 1,796 are newly constructed. The question types cover both multiple-choice questions and open-ended questions, involving multimodal reasoning tasks with both images and text. The construction process of EMMA includes screening questions from existing benchmarks and manually creating new questions in collaboration with domain experts. The primary application scenario of the EMMA dataset is the evaluation of multimodal reasoning capabilities, aiming to address the limitations of current MLLMs in handling complex multimodal and multi-step reasoning tasks.

提供机构:

电子科技大学, 中山大学, 华盛顿大学, 微软, 香港中文大学

创建时间:

2025-01-10

搜集汇总

数据集介绍

构建方式

EMMA数据集的构建过程分为两个主要步骤:首先,从现有的多模态推理基准中筛选出无法仅通过文本推理或单一视觉处理解决的问题;其次,通过与领域专家合作,手动构建新的问题,确保这些问题需要跨模态的深度推理。数据集涵盖了数学、物理、化学和编程四个领域,共包含2788个问题,其中1796个是新构建的。每个问题都经过严格的过滤流程,确保其真正需要多模态推理能力。

特点

EMMA数据集的特点在于其强调跨模态的深度推理能力,尤其是视觉推理与文本推理的结合。数据集中的问题设计复杂,通常需要多次视觉处理和多步推理,无法通过单一模态独立解决。例如,物理问题中的3D场模拟、化学中的反应模拟以及编程中的可视化生成任务,都要求模型在视觉和文本之间进行有机的推理。此外,EMMA还提供了细粒度的标签,帮助分析模型在不同推理技能上的表现。

使用方法

EMMA数据集的使用方法主要包括对多模态大语言模型(MLLMs)的评估和测试。用户可以通过直接提示或链式思维(Chain-of-Thought, CoT)提示来评估模型在多模态推理任务中的表现。数据集中的问题分为选择题和开放式问题,用户可以根据任务需求选择合适的评估方式。此外,EMMA还支持测试时计算扩展方法,如多数投票、最佳N选择和锦标赛式选择,以进一步探索模型在多模态推理中的潜力。

背景与挑战

背景概述

EMMA(Enhanced MultiModal reAsoning)是一个专注于评估多模态大语言模型(MLLMs)在多模态推理能力上的基准测试数据集。该数据集由来自中国电子科技大学、中山大学、华盛顿大学、微软和香港中文大学的研究团队于2025年创建,旨在解决现有基准测试中多模态推理能力评估不足的问题。EMMA涵盖了数学、物理、化学和编程四个领域,提出了需要跨模态推理的任务,要求模型在文本和视觉信息之间进行有机的推理。EMMA的创建填补了现有基准测试的空白,尤其是在复杂多模态推理任务上的评估,推动了多模态模型在跨模态推理能力上的研究。

当前挑战

EMMA面临的主要挑战包括两个方面:首先,多模态推理任务的复杂性要求模型能够同时处理文本和视觉信息,并进行多步推理,这对现有的MLLMs提出了极高的要求。尽管模型在单模态任务上表现出色,但在跨模态推理任务上表现不佳,尤其是在需要空间想象、视觉分解和多步推理的任务中。其次,数据集的构建过程中也面临挑战,尤其是在筛选和构建真正需要多模态推理的问题时,研究人员需要通过严格的过滤流程,确保问题无法仅通过文本或单次视觉处理解决。此外,EMMA还揭示了现有模型在视觉推理上的瓶颈,尤其是在需要精细空间模拟和多步视觉推理的任务中,模型的表现远低于人类专家水平。

常用场景

经典使用场景

EMMA数据集主要用于评估多模态大语言模型(MLLMs)在数学、物理、化学和编程等领域的多模态推理能力。其经典使用场景包括通过结合文本和图像信息,解决复杂的多模态推理问题。例如,在物理问题中,模型需要通过图像中的力矢量图来推断电场力的方向,或在化学问题中,通过分子结构图推断化学反应后的分子形态。

解决学术问题

EMMA数据集解决了多模态推理中的关键学术问题,特别是模型在处理需要跨模态推理的任务时的局限性。现有的基准测试大多侧重于文本主导的推理或浅层次的视觉理解,而EMMA通过设计复杂的多模态问题,要求模型在视觉和文本之间进行深度的交互推理。这些问题无法通过单一模态的独立推理解决,从而为评估和改进MLLMs的多模态推理能力提供了新的测试平台。

衍生相关工作

EMMA数据集衍生了许多相关的研究工作,特别是在多模态推理模型的改进和评估方面。例如,基于EMMA的研究提出了新的视觉推理架构和训练范式,以提升模型在复杂多模态任务中的表现。此外,EMMA还推动了多模态推理基准测试的发展,如MMMU-Pro等后续工作,进一步细化和扩展了多模态推理任务的评估范围。这些工作不仅提升了模型的多模态推理能力,还为未来的多模态人工智能研究提供了重要的参考。

以上内容由遇见数据集搜集并总结生成