Skylion007/openwebtext

收藏Hugging Face2024-05-17 更新2024-03-04 收录

下载链接:

https://hf-mirror.com/datasets/Skylion007/openwebtext

下载链接

链接失效反馈资源简介:

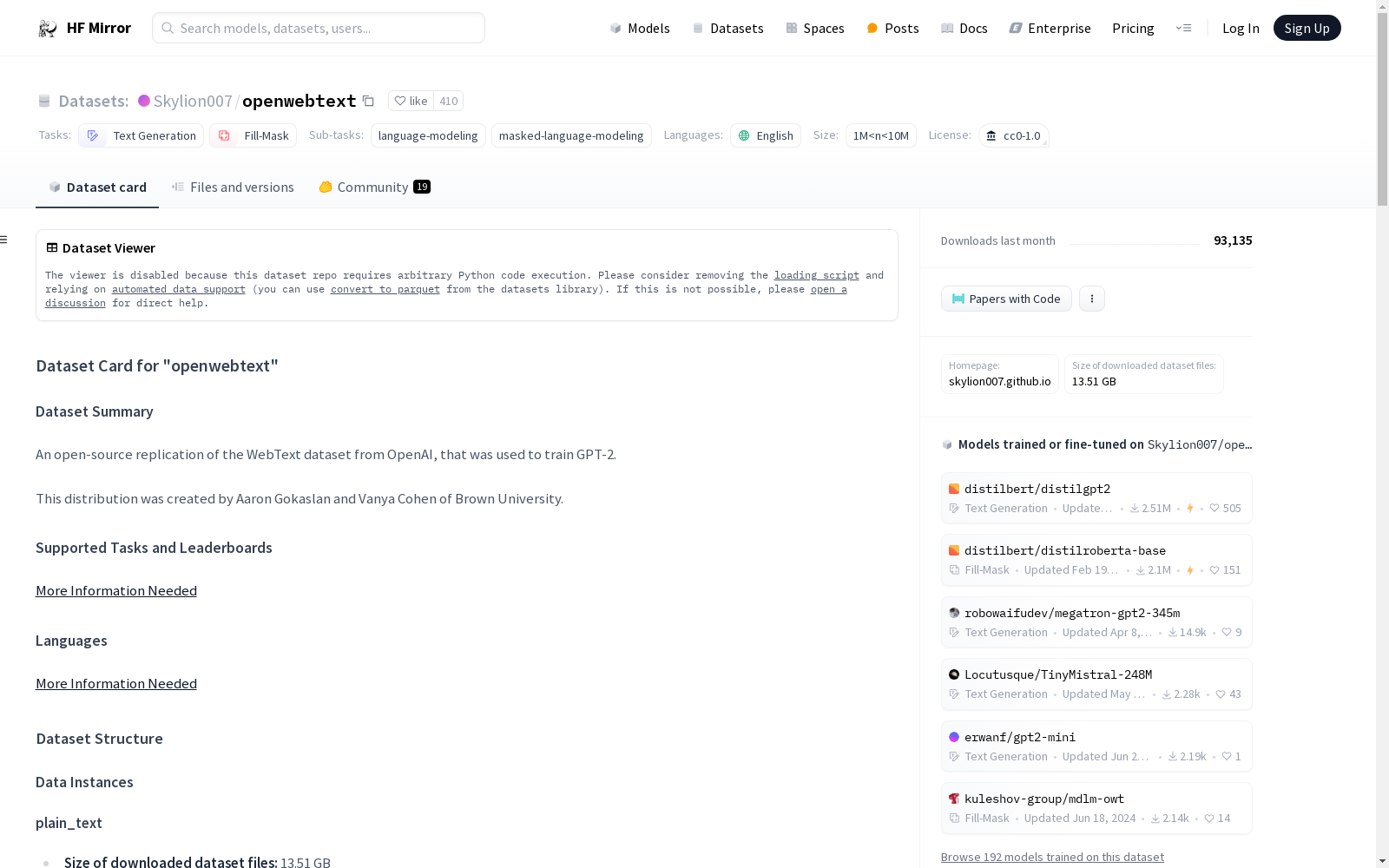

OpenWebText数据集是OpenAI WebText数据集的开源复制版本,用于训练GPT-2模型。该数据集由Brown大学的Aaron Gokaslan和Vanya Cohen创建,包含从Reddit帖子中提取的URL,经过去重、过滤和随机化处理后,使用newspaper python包提取网页内容,并使用Facebook FastText过滤非英文网页。数据集不包含注释,且数据量较大,下载文件大小为13.51 GB,生成数据集大小为41.70 GB,总磁盘使用量为55.21 GB。

The OpenWebText dataset is an open-source replica of the OpenAI WebText dataset, designed for training GPT-2 models. Developed by Aaron Gokaslan and Vanya Cohen from Brown University, this dataset includes URLs extracted from Reddit posts. After undergoing deduplication, filtering and randomization processing, web content is extracted using the Python newspaper package, and non-English webpages are filtered out with Facebook FastText. The dataset contains no annotations, and has a large scale: the size of the downloaded files is 13.51 GB, the size of the generated dataset is 41.70 GB, and the total disk usage reaches 55.21 GB.

提供机构:

Skylion007

原始信息汇总

数据集概述

名称: OpenWebText

语言: 英语 (en)

许可证: CC0-1.0

多语言性: 单语

大小类别: 1M<n<10M

源数据集: 原始

任务类别:

- 文本生成

- 填充掩码

任务ID:

- 语言建模

- 掩码语言建模

论文代码ID: openwebtext

数据集结构

特征:

- text: 字符串类型

配置名称: plain_text

分割:

- train:

- 字节数: 39769491688

- 示例数: 8013769

下载大小: 12880189440字节

数据集大小: 39769491688字节

数据集创建

来源数据:

- 初始数据收集和规范化:

- 从Reddit提交数据集中提取所有Reddit帖子URL。

- 去重,过滤非HTML内容,随机洗牌。

- 使用newspaper python包下载并提取网页。

- 使用Facebook FastText过滤非英语网页。

- 使用局部敏感哈希(LSH)识别近似重复文档。

- 文档被哈希成5-gram集合,相似度阈值大于0.5的文档被移除。

- 剩余文档被分词,少于128个词的文档被移除。

- 剩余38GB文本数据(使用SI单位为40GB)来自8,013,769个文档。

注释: 无注释

许可证信息:

引用信息:

@misc{Gokaslan2019OpenWeb, title={OpenWebText Corpus}, author={Gokaslan, Aaron and Cohen, Vanya and Pavlick, Ellie and Tellex, Stefanie}, howpublished={url{http://Skylion007.github.io/OpenWebTextCorpus}}, year={2019} }

搜集汇总

数据集介绍

构建方式

Skylion007/openwebtext数据集的构建起始于对Reddit帖子的URL进行提取,进而去重、过滤非HTML内容并随机打乱顺序。随后,通过并行分配至多台机器下载网页内容,并利用newspaper包提取所有网页文本。通过Facebook FastText对非英文页面进行过滤,再使用局部敏感哈希(LSH)技术识别并移除近似重复的文档。最终,经过分词和删除少于128个token的文档,形成了包含8013769个文档的38GB文本数据集。

特点

该数据集的特点在于其是一个开放复制的OpenAI的WebText数据集,用于GPT-2模型的训练。数据集包含单一的英文文本字段,采用CC0协议进行发布,即无版权声明,任何人都可以自由使用。此外,数据集在构建过程中对非英文内容以及近似重复的文档进行了过滤,保证了数据的质量和多样性。

使用方法

使用该数据集时,用户可以下载压缩后的文件,然后解压以获取文本数据。数据集分为训练集,适用于文本生成、填空等任务。用户可以直接利用数据集中的文本字段进行语言模型训练或掩码语言模型训练等NLP相关的研究与应用。

背景与挑战

背景概述

OpenWebText数据集,由布朗大学的Aaron Gokaslan和Vanya Cohen于2019年创建,旨在为自然语言处理任务提供一个大规模的文本数据集。该数据集是对OpenAI的WebText数据集的开源复制,后者用于训练GPT-2模型。OpenWebText数据集的构建基于从Reddit帖子中提取的URLs,经过一系列的数据清洗和过滤过程,最终形成了一个包含8,013,769个文档的文本数据集。该数据集在自然语言处理领域具有一定的影响力,尤其是在文本生成和填空任务中。

当前挑战

OpenWebText数据集在构建过程中遇到了多个挑战。首先,如何有效地从Reddit中提取并处理大量的URLs,以确保数据的多样性和质量。其次,数据清洗过程中,去除非英语内容和近似的重复文档,以及过滤掉少于128个token的文档,都是技术上的挑战。此外,数据集的构建还需要考虑到个人隐私和敏感信息的处理问题。在使用该数据集时,还需关注可能存在的偏见和局限性,以及如何确保数据的使用不会引发社会负面影响。

常用场景

经典使用场景

Skylion007/openwebtext数据集,作为开源的WebText数据集复制版本,其经典使用场景主要在于自然语言处理模型的预训练。该数据集包含了大量从互联网上收集的文本,为模型提供了丰富的语言学习材料,使其能够学习到语言的多样性和复杂性。

解决学术问题

该数据集解决了自然语言处理领域在模型预训练阶段缺乏大规模、多样化文本数据的难题。通过使用openwebtext,研究者能够训练出在语言建模和填空等任务上表现更为优异的模型,进而推动学术研究的深入发展。

衍生相关工作

基于Skylion007/openwebtext数据集,已经衍生出了一系列相关工作,包括但不限于在自然语言处理任务上的模型训练与评估,以及针对数据集中的偏见和敏感性问题的研究,进一步推动了数据集的完善和应用的深化。

以上内容由遇见数据集搜集并总结生成