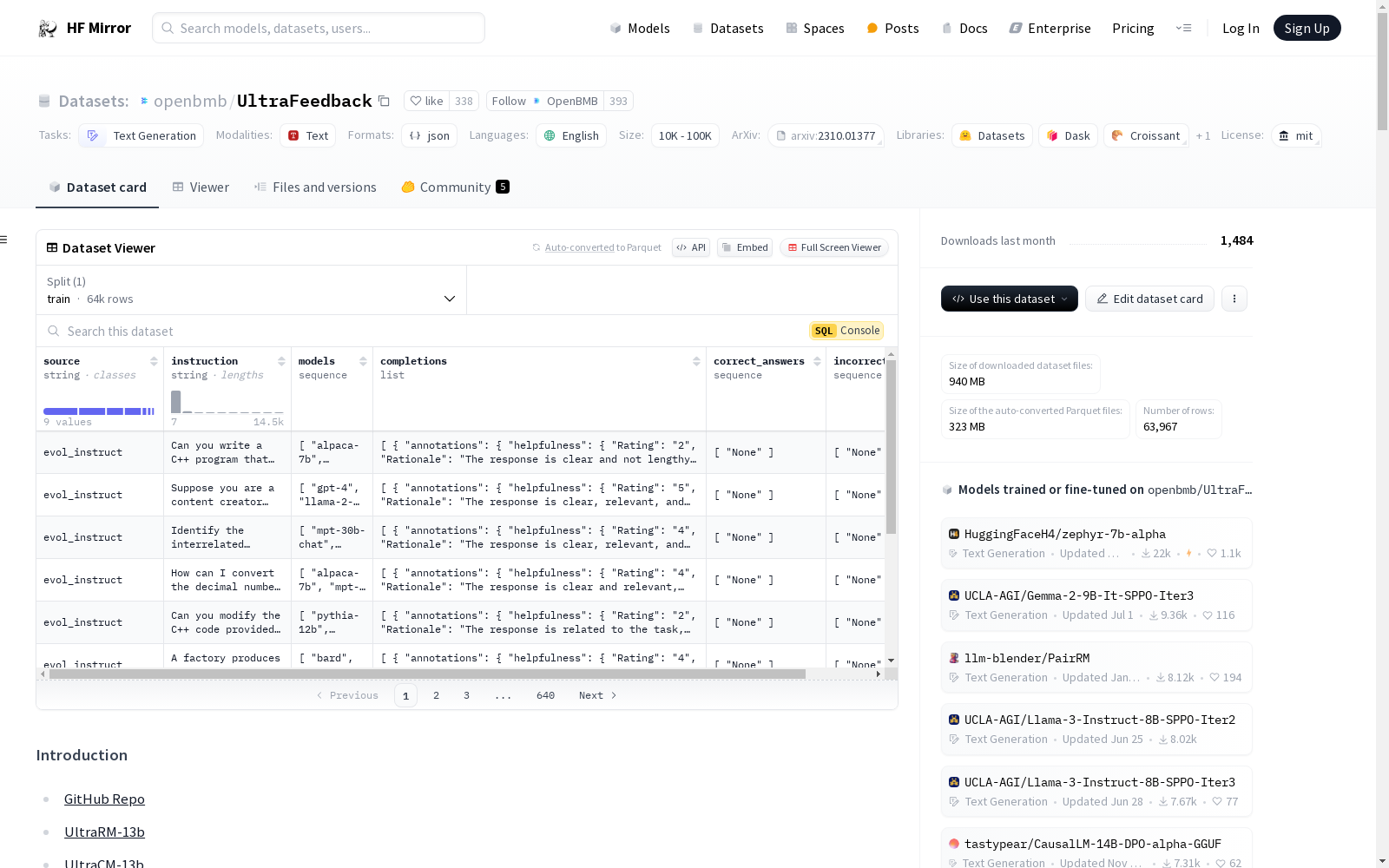

openbmb/UltraFeedback

收藏Hugging Face2023-12-29 更新2024-03-04 收录

下载链接:

https://hf-mirror.com/datasets/openbmb/UltraFeedback

下载链接

链接失效反馈资源简介:

UltraFeedback是一个大规模、细粒度、多样化的偏好数据集,用于训练强大的奖励模型和批评模型。该数据集收集了约64k个来自不同资源(包括UltraChat、ShareGPT、Evol-Instruct、TruthfulQA、FalseQA和FLAN)的提示,并使用这些提示查询多个大型语言模型,生成每个提示的4个不同响应,总共256k个样本。为了收集高质量的偏好和文本反馈,设计了包含指令遵循、真实性、诚实性和帮助性四个维度的细粒度注释指令,并使用GPT-4对收集的样本进行注释。

UltraFeedback是一个大规模、细粒度、多样化的偏好数据集,用于训练强大的奖励模型和批评模型。该数据集收集了约64k个来自不同资源(包括UltraChat、ShareGPT、Evol-Instruct、TruthfulQA、FalseQA和FLAN)的提示,并使用这些提示查询多个大型语言模型,生成每个提示的4个不同响应,总共256k个样本。为了收集高质量的偏好和文本反馈,设计了包含指令遵循、真实性、诚实性和帮助性四个维度的细粒度注释指令,并使用GPT-4对收集的样本进行注释。

提供机构:

openbmb

原始信息汇总

数据集概述

基本信息

- 许可证: MIT

- 任务类别: 文本生成

- 语言: 英语

- 数据集大小: 100K<n<1M

数据集描述

- 名称: UltraFeedback

- 用途: 用于训练强大的奖励模型和批评模型

- 数据来源: 收集了约64k来自多个资源的提示(包括UltraChat, ShareGPT, Evol-Instruct, TruthfulQA, FalseQA, FLAN),并使用这些提示查询多个大型语言模型(LLMs),生成4种不同响应,总计256k样本。

- 注释设计: 设计了包含4个不同方面的精细注释指令(遵循指令、真实性、诚实性和帮助性),并使用GPT-4进行样本注释。

数据集特征

- 规模: 包含64k提示,256k响应和380k高质量反馈。研究人员可以进一步构建约100万个比较对来训练他们的奖励模型。

- 多样性: 从多个来源收集提示,并查询多样化的开源和著名模型。为了增加多样性,选择了不同的基础模型(如LLaMA, Falcon, StarChat, MPT, GPT, Bard),并应用多种原则以不同方式完成指令。

- 高密度: 提供数值和文本反馈,并编写了精细的注释文档以帮助在所有维度上评价响应。

数据集构建

- 指令采样: 从6个公开可用的高质量数据集中采样63,967条指令。

- 模型采样: 选择不同级别、大小、架构和训练数据的基础模型,以防止奖励模型过度拟合特定文本风格或捕捉文本风格与奖励之间的虚假相关性。

- 原则采样: 定义了一组原则以明确对齐不同方面的模型行为。对于每个指令,随机选择4个模型完成指令,并为每个完成选择一个原则,添加到系统提示中以对齐模型行为。

数据集格式

- 数据集以JSON格式存储,包含以下字段:

- source: 指令来源的数据集

- id: 指令在源数据集中的ID

- instruction: 指令内容

- models: 完成指令的模型列表

- completions: 每个模型的响应及其相关信息(模型、原则、系统提示、响应、注释)

数据集示例

- 提供了一个用户查询及其由四个不同模型生成的响应示例,每个响应都附带了详细的注释,包括遵循指令、真实性、诚实性和帮助性的评分和理由。

数据集限制

- 尽管GPT-4可以提供大多数样本的良好对齐注释和文本反馈,但GPT-4也可能犯错并提供不准确的反馈。

引用信息

bib @misc{cui2023ultrafeedback, title={UltraFeedback: Boosting Language Models with High-quality Feedback}, author={Ganqu Cui and Lifan Yuan and Ning Ding and Guanming Yao and Wei Zhu and Yuan Ni and Guotong Xie and Zhiyuan Liu and Maosong Sun}, year={2023}, eprint={2310.01377}, archivePrefix={arXiv}, primaryClass={cs.CL} }

搜集汇总

数据集介绍

构建方式

UltraFeedback数据集的构建基于大规模、细粒度的偏好数据收集。首先,从多个高质量数据源(如UltraChat、ShareGPT、Evol-Instruct、TruthfulQA、FalseQA和FLAN)中抽取约64,000条指令。随后,利用这些指令查询多个大型语言模型(LLMs),每个指令生成4种不同的响应,总计产生256,000个样本。为确保反馈的高质量,设计了包含指令遵循、真实性、诚实性和帮助性四个维度的细粒度标注指南,并由GPT-4进行标注。

特点

UltraFeedback数据集具有显著的规模和多样性。它包含64,000条指令、256,000条响应和380,000条高质量反馈,为强化学习从人类反馈(RLHF)研究者提供了约100万对比较样本。数据集的多样性体现在从多种来源收集指令,并查询包括LLaMA、Falcon、StarChat、MPT、GPT和Bard在内的多种模型。此外,通过应用不同的原则来激发模型以不同方式完成指令,进一步增强了数据的多样性。

使用方法

UltraFeedback数据集适用于训练强大的奖励模型和批评模型。研究者可以利用数据集中的指令和响应对,结合GPT-4提供的细粒度反馈,进行模型训练和优化。数据集的JSON格式清晰,包含指令来源、ID、指令内容、模型列表、响应及其对应的系统提示和反馈。这种结构化的数据格式便于直接导入和处理,支持多种自然语言处理任务,如文本生成和偏好建模。

背景与挑战

背景概述

UltraFeedback数据集由清华大学自然语言处理与社会人文计算实验室(THUNLP)于2023年创建,旨在为强化学习从人类反馈(RLHF)研究提供大规模、细粒度且多样化的偏好数据。该数据集的核心研究问题是如何通过高质量的反馈数据训练出强大的奖励模型和批评模型。UltraFeedback的创建不仅丰富了文本生成领域的数据资源,还为模型自我校准和行为对齐提供了新的研究方向,对推动自然语言处理技术的发展具有重要意义。

当前挑战

UltraFeedback数据集在构建过程中面临多重挑战。首先,数据集的多样性要求从多个公开且高质量的数据集中采样指令,并确保这些指令能够覆盖广泛的应用场景。其次,为了防止奖励模型过度拟合特定文本风格,数据集采用了多种不同级别、架构和训练数据的模型来完成指令,这增加了数据生成的复杂性。此外,通过GPT-4进行细粒度标注时,尽管GPT-4能够提供高质量的反馈,但其自身也可能产生不准确的反馈,这需要在后续研究中加以解决。

常用场景

经典使用场景

UltraFeedback数据集在自然语言处理领域中被广泛用于训练强大的奖励模型和批评模型。其经典使用场景包括通过大规模、细粒度的偏好数据集来评估和改进语言模型的响应质量。通过收集来自多个数据源的64k提示,并使用这些提示查询多个大型语言模型(LLMs),生成4种不同的响应,从而形成256k样本。这些样本通过GPT-4进行细粒度标注,涵盖指令遵循、真实性、诚实性和帮助性四个方面,为模型训练提供了丰富的反馈数据。

衍生相关工作

UltraFeedback数据集的发布催生了一系列相关研究和工作。例如,研究人员利用该数据集开发了新的奖励模型训练方法,进一步提升了模型的性能。此外,UltraFeedback还被用于验证和改进现有的自我对齐技术,如Sun等人的“Principle-Driven Self-Alignment”方法。这些工作不仅扩展了UltraFeedback的应用范围,还推动了自然语言处理领域的技术进步。

数据集最近研究

最新研究方向

在自然语言处理领域,UltraFeedback数据集的最新研究方向主要集中在提升大型语言模型的自我校准和反馈机制上。该数据集通过收集多样化的提示和生成多样的响应,结合GPT-4进行细粒度的注释,旨在训练更强大的奖励模型和批评模型。研究者们利用UltraFeedback的高密度反馈和多样性,探索如何在最小化人工监督的情况下,实现语言模型的自我校准和行为对齐。这一方向的研究不仅有助于提升模型的指令遵循能力和真实性,还对推动人工智能的透明度和可解释性具有重要意义。

以上内容由遇见数据集搜集并总结生成