Wiki-FACTOR, News-FACTOR, Expert-FACTOR

收藏arXiv2024-02-04 更新2024-06-21 收录

下载链接:

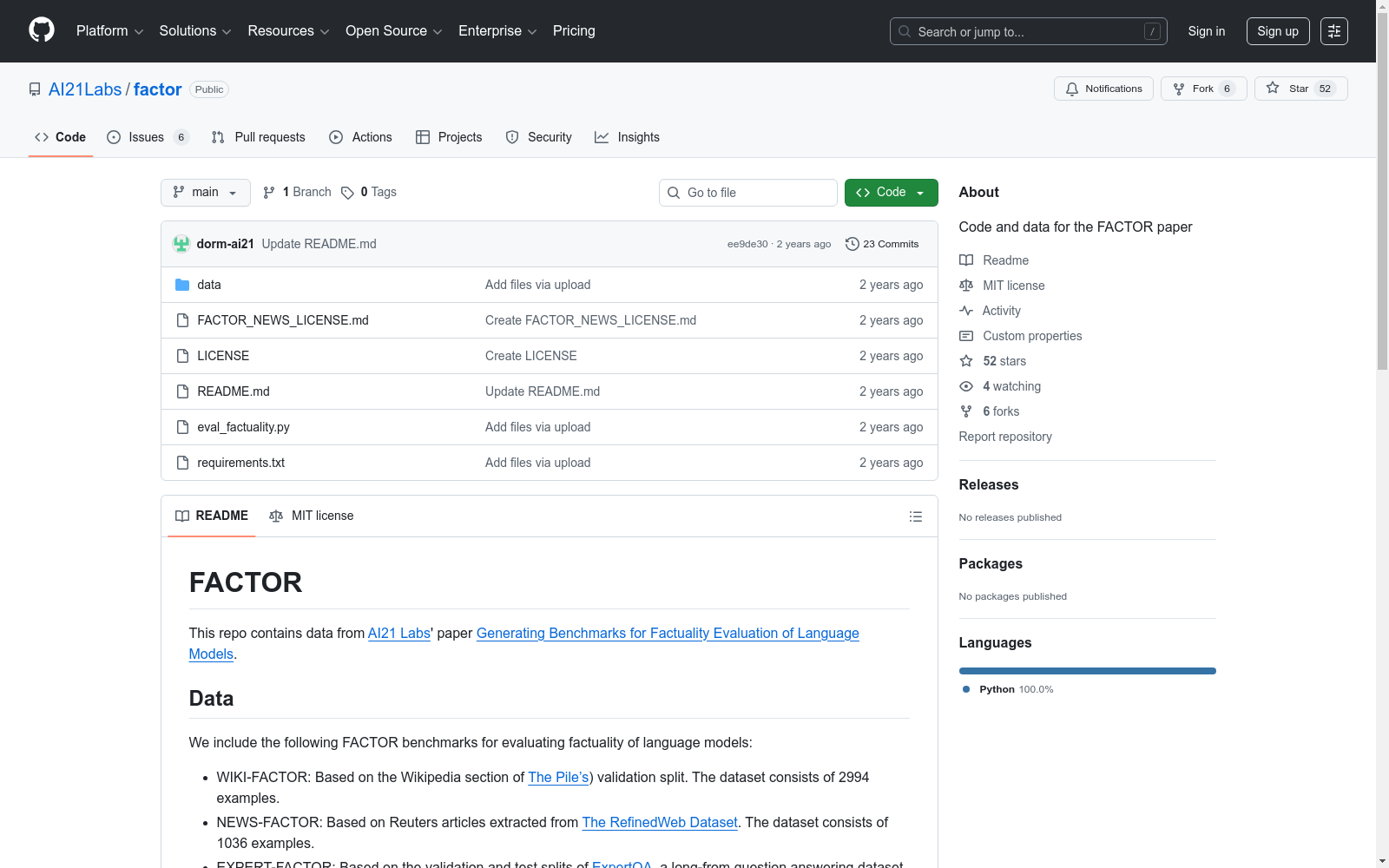

https://github.com/AI21Labs/factor

下载链接

链接失效反馈资源简介:

本研究介绍了三个用于评估语言模型在特定领域事实准确性的基准数据集:Wiki-FACTOR、News-FACTOR和Expert-FACTOR。这些数据集是通过FACTOR框架创建的,该框架将事实性语料库转换为基准,用于评估语言模型区分真实事实与相似但错误陈述的能力。Wiki-FACTOR基于维基百科内容,News-FACTOR基于新闻文章,而Expert-FACTOR则基于专家策划的问答数据,涵盖多个领域。这些数据集旨在通过对比真实与错误信息,提高模型在开放式生成中的事实性。

This study introduces three benchmark datasets for evaluating the factual accuracy of large language models (LLMs) in specific domains: Wiki-FACTOR, News-FACTOR, and Expert-FACTOR. These datasets are developed via the FACTOR framework, which converts factual corpora into benchmarks designed to assess the ability of language models to distinguish between verifiable facts and plausible but erroneous statements. Wiki-FACTOR is built on Wikipedia content, News-FACTOR draws upon news articles, and Expert-FACTOR is sourced from expert-curated question-answer (QA) data spanning multiple domains. These datasets aim to enhance the factual reliability of models in open-ended generation by contrasting verifiable facts and misinformation.

提供机构:

AI21 Labs

创建时间:

2023-07-14

搜集汇总

数据集介绍

构建方式

FACTOR数据集通过将真实语料库中的事实性陈述自动扰动,为每个真实陈述创建一个恒定数量的相似但错误的变体,从而构建了一个基准测试。这种方法确保了在评估语言模型(LM)的生成真实性时,能够控制评估的事实集合,并且能够更好地代表领域特定或罕见的事实。例如,Wiki-FACTOR基于维基百科,News-FACTOR基于新闻文章,Expert-FACTOR基于特定领域的问题和答案对。这些数据集的构建遵循了一个四阶段的流水线,包括前缀和事实性完成选择的确定、非事实性完成的生成、非事实性完成的过滤以及非事实性完成的选择。

使用方法

使用FACTOR数据集评估LM的事实性时,需要执行以下步骤:首先,从数据集中选择一个示例,该示例包含一个前缀文本和一个事实性完成以及三个非事实性替代完成。然后,将LM应用于该示例,计算每个完成(包括事实性和非事实性)的概率。最后,比较LM对事实性完成的概率分配与对非事实性完成的概率分配,以确定LM的事实性准确率。这种方法可以用于比较不同LM在特定领域中的事实性生成能力,并且可以作为评估检索增强LM的一种有效手段。

背景与挑战

背景概述

随着大型语言模型(LM)在生成文本方面能力的迅速提升,其在特定领域生成事实性准确信息的能力也变得尤为重要。现有的方法主要关注从LM自身抽取的事实样本,无法控制评估的事实集,并且可能无法充分代表特定领域或罕见的事实。为了解决这一问题,AI21Labs的研究人员提出了FACTOR(Factual Assessment via Corpus TransfORmation)框架,旨在通过自动将感兴趣的语料库中的事实性语句转换为评估基准,来评估LM生成事实性信息的倾向。该框架创建了三个基准:Wiki-FACTOR、News-FACTOR和Expert-FACTOR,分别针对维基百科、新闻和专家问答领域。研究结果表明,随着模型规模的增加,基准分数也随之提高,并且当LM通过检索增强时,分数也会有所改善。此外,基准分数与困惑度并不总是对模型的排名达成一致,而在困惑度和基准分数不一致的情况下,后者的得分更能反映开放生成中的事实性,这由人工注释者进行评估。

当前挑战

FACTOR框架在评估LM事实性方面面临一些挑战。首先,自动生成的基准可能不完全符合预定义的要求。其次,为不同领域生成FACTOR基准可能需要新的方法来识别事实性语句。例如,在知识密集型领域,几乎每个句子都包含事实性信息,但在其他领域,可能需要更复杂的策略来识别这些语句。此外,生成非事实性完成语句依赖于提示模型,这可能导致在不同领域中的效果差异。最后,基于样本的方法可能在评估模型的事实性知识方面存在局限性,因为许多生成文本可能对最小事实保持中立。

常用场景

经典使用场景

FACTOR数据集旨在评估语言模型在开放生成场景中的事实性。它通过将事实语料库中的语句转换为包含正确和错误陈述的多项选择题,自动生成基准测试。语言模型在基准测试中的表现反映了其从语料库中生成真实事实的能力。Wiki-FACTOR、News-FACTOR和Expert-FACTOR分别针对维基百科、新闻和专家知识问答领域构建了三个基准测试。

解决学术问题

该数据集解决了现有事实性评估方法中存在的偏见问题。现有的方法通常关注模型生成的常见事实,而忽略了领域特定或罕见的事实。FACTOR通过自动生成类似但错误的陈述,提供了一个控制的事实集合,从而更好地代表真实世界中的事实分布。此外,FACTOR还揭示了模型规模、检索增强和事实性之间的关系,为模型评估和优化提供了新的视角。

实际应用

FACTOR数据集在实际应用中可用于评估语言模型在特定领域的准确性和可靠性。例如,新闻机构可以使用News-FACTOR来评估其自动摘要工具的准确性,确保生成的摘要不会包含错误的信息。专家问答系统可以利用Expert-FACTOR来评估其模型在回答复杂问题时的事实性,提高系统的可信度。此外,FACTOR还可以作为语言模型训练和优化的工具,帮助模型更好地学习和生成真实信息。

数据集最近研究

最新研究方向

FACTOR(Factual Assessment via Corpus TransfORmation)是一种新颖的评估语言模型(LM)生成事实性信息倾向的方法。该方法通过自动地将一个事实性语料库转换为评估基准,从而评估LM从语料库中生成真实事实相对于类似但错误陈述的倾向。FACTOR旨在解决现有事实性评估方法存在的偏差问题,这些方法依赖于从LM本身采样的事实,并可能低估特定领域或罕见的事实。本文提出了三个基准:Wiki-FACTOR、News-FACTOR和Expert-FACTOR,并展示了这些基准在评估LM事实性方面的有效性。研究结果表明,FACTOR分数随着模型规模的增加而提高,并且当LM与检索增强时,其表现会得到改善。此外,研究还发现,在开放性生成中,FACTOR分数比困惑度更能反映LM的事实性。因此,FACTOR作为一种评估LM在特定领域生成事实性信息倾向的方法,具有重要的意义和应用价值。

相关研究论文

- 1Generating Benchmarks for Factuality Evaluation of Language ModelsAI21 Labs · 2024年

以上内容由遇见数据集搜集并总结生成