SynGrasp-1B

收藏github2025-05-07 更新2025-05-08 收录

下载链接:

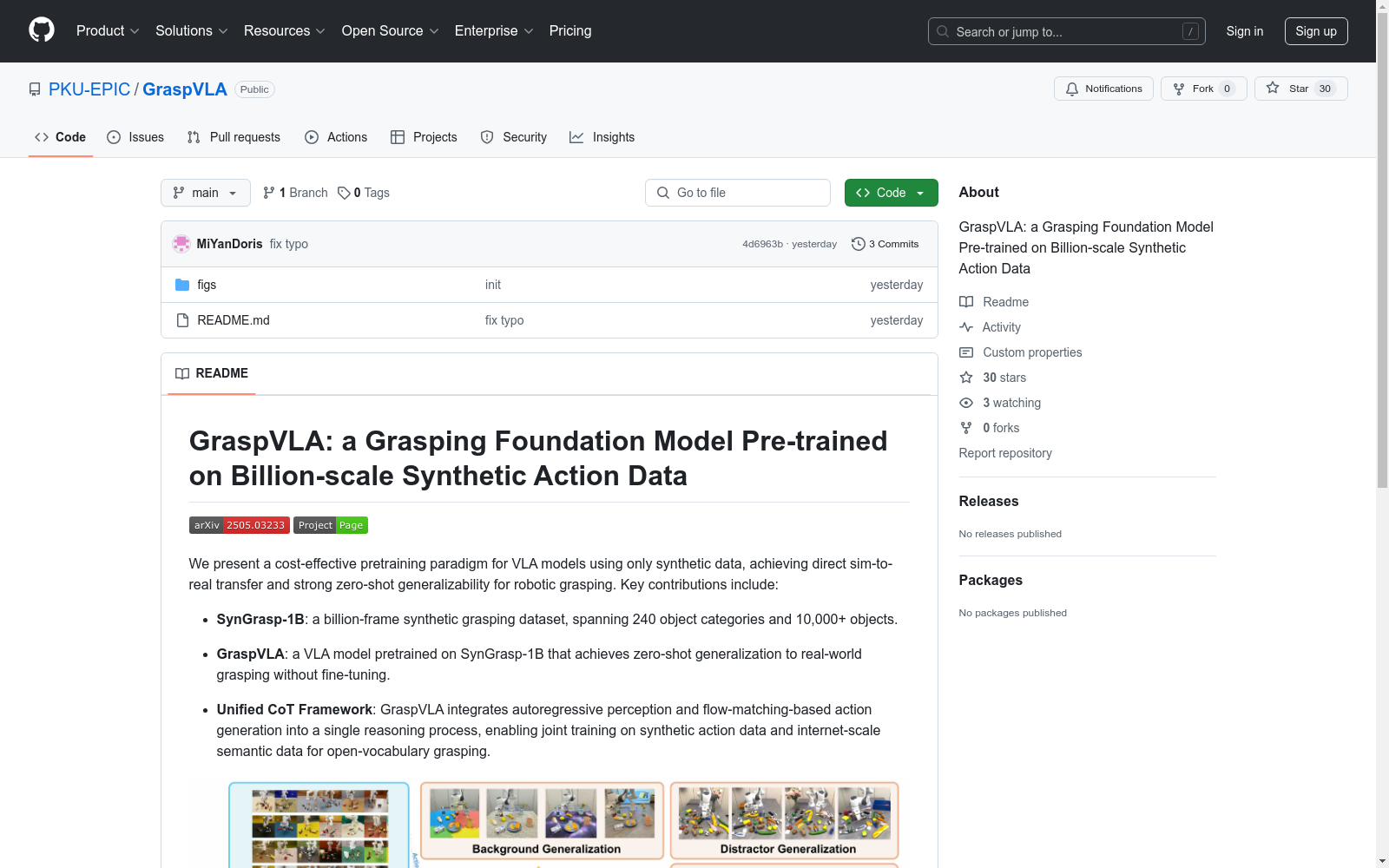

https://github.com/PKU-EPIC/GraspVLA

下载链接

链接失效反馈官方服务:

资源简介:

一个包含十亿帧合成抓取动作的数据集,涵盖240个物体类别和10,000多个物体。

A dataset containing one billion frames of synthetic抓取action, encompassing 240 object categories and over 10,000 objects.

创建时间:

2025-05-06

原始信息汇总

GraspVLA 数据集概述

基本信息

- 数据集名称: GraspVLA

- 研究领域: 机器人抓取

- 相关论文: arXiv:2505.03233

- 项目主页: GraspVLA Project Page

- 许可证: CC BY-NC 4.0

核心贡献

-

SynGrasp-1B

- 规模: 十亿帧合成抓取数据

- 覆盖范围: 240个物体类别,超过10,000个物体

-

GraspVLA模型

- 特点: 基于合成数据预训练的视觉语言动作(VLA)模型

- 能力: 实现零样本迁移到真实世界抓取任务,无需微调

-

统一推理框架

- 方法: 结合自回归感知和基于流匹配的动作生成

- 优势: 支持合成动作数据和互联网规模语义数据的联合训练

待发布内容

- [ ] 补充材料

- [ ] 模型权重

- [ ] SynGrasp-1B数据集

搜集汇总

数据集介绍

构建方式

在机器人抓取领域,SynGrasp-1B数据集通过大规模合成数据生成技术构建而成,其规模达到十亿帧级别。该数据集覆盖240个物体类别和超过10,000个具体物体,采用先进的仿真环境进行数据采集。研究人员设计了统一的CoT框架,将感知与动作生成整合到单一推理流程中,使得合成数据能够直接迁移到真实场景。这种构建方式突破了传统数据采集的成本限制,为机器人抓取研究提供了前所未有的数据规模。

特点

SynGrasp-1B作为目前规模最大的合成抓取数据集,其最显著的特点是实现了仿真到现实的零样本迁移能力。数据集不仅包含丰富的物体类别,还通过统一框架整合了感知与动作生成,支持开放词汇的抓取任务。特别值得注意的是,基于该数据集训练的GraspVLA模型无需微调即可在真实场景中表现出色,这为机器人抓取研究提供了新的可能性。数据集的高质量和多样性使其成为该领域的重要基准资源。

使用方法

SynGrasp-1B数据集主要用于训练和评估视觉语言动作模型在机器人抓取任务中的表现。研究人员可以直接使用该数据集预训练基础模型,如GraspVLA,实现零样本的仿真到现实迁移。数据集支持端到端的训练流程,用户可通过统一的CoT框架同时处理感知和动作生成任务。对于特定应用场景,开发者还可以将预训练模型与互联网规模的语义数据结合,进一步提升开放词汇抓取能力。该数据集为机器人抓取研究提供了标准化的评估基准。

背景与挑战

背景概述

SynGrasp-1B数据集由北京大学前沿计算研究中心团队于2024年提出,作为GraspVLA项目的重要组成部分,旨在推动机器人抓取领域的视觉语言动作模型发展。该数据集包含十亿规模的合成抓取动作帧,涵盖240个物体类别和超过10,000个物体实例,通过大规模合成数据预训练实现了从仿真到现实的直接迁移。其创新性体现在构建了首个面向开放词汇抓取任务的亿级合成动作数据集,为机器人抓取领域的基础模型研究提供了关键数据支撑。该工作发表在计算机视觉与机器人学交叉领域顶级会议,对推动具身智能的视觉动作联合建模具有里程碑意义。

当前挑战

在解决机器人开放词汇抓取这一核心问题上,SynGrasp-1B需要克服仿真与现实间的语义鸿沟和动作域差异。传统方法受限于真实数据采集成本,难以覆盖长尾物体类别,而该数据集通过合成数据生成技术突破了这一瓶颈。数据集构建过程中面临多模态数据对齐的挑战,包括视觉观测、语言指令与动作轨迹的精确匹配。同时,保持十亿规模数据中物体物理属性和抓取动力学的真实性,以及处理不同材质、形状物体的抓取策略泛化性,都是需要解决的关键技术难题。

常用场景

经典使用场景

在机器人抓取领域,SynGrasp-1B数据集为视觉语言动作模型(VLA)的预训练提供了丰富的合成数据支持。该数据集通过模拟240种物体类别和超过10,000个物体的抓取场景,为研究人员提供了多样化的训练样本。其经典使用场景包括零样本抓取任务,模型无需经过真实数据的微调即可直接迁移到现实世界的抓取场景中。

实际应用

在实际应用中,SynGrasp-1B数据集为工业自动化、物流分拣等场景提供了高效的解决方案。基于该数据集预训练的GraspVLA模型能够直接应用于真实环境,显著降低了机器人抓取系统的部署成本。其强大的零样本泛化能力使得机器人能够快速适应新物体和新场景,提升了自动化系统的灵活性和可靠性。

衍生相关工作

SynGrasp-1B的发布催生了一系列围绕合成数据预训练和零样本抓取的研究工作。其中,GraspVLA模型作为该数据集的代表性衍生成果,展示了合成数据在机器人学习中的巨大潜力。相关研究进一步探索了多模态融合、跨领域迁移等技术,推动了机器人抓取领域的快速发展。

以上内容由遇见数据集搜集并总结生成