MCP-RADAR

收藏arXiv2025-05-22 更新2025-05-24 收录

下载链接:

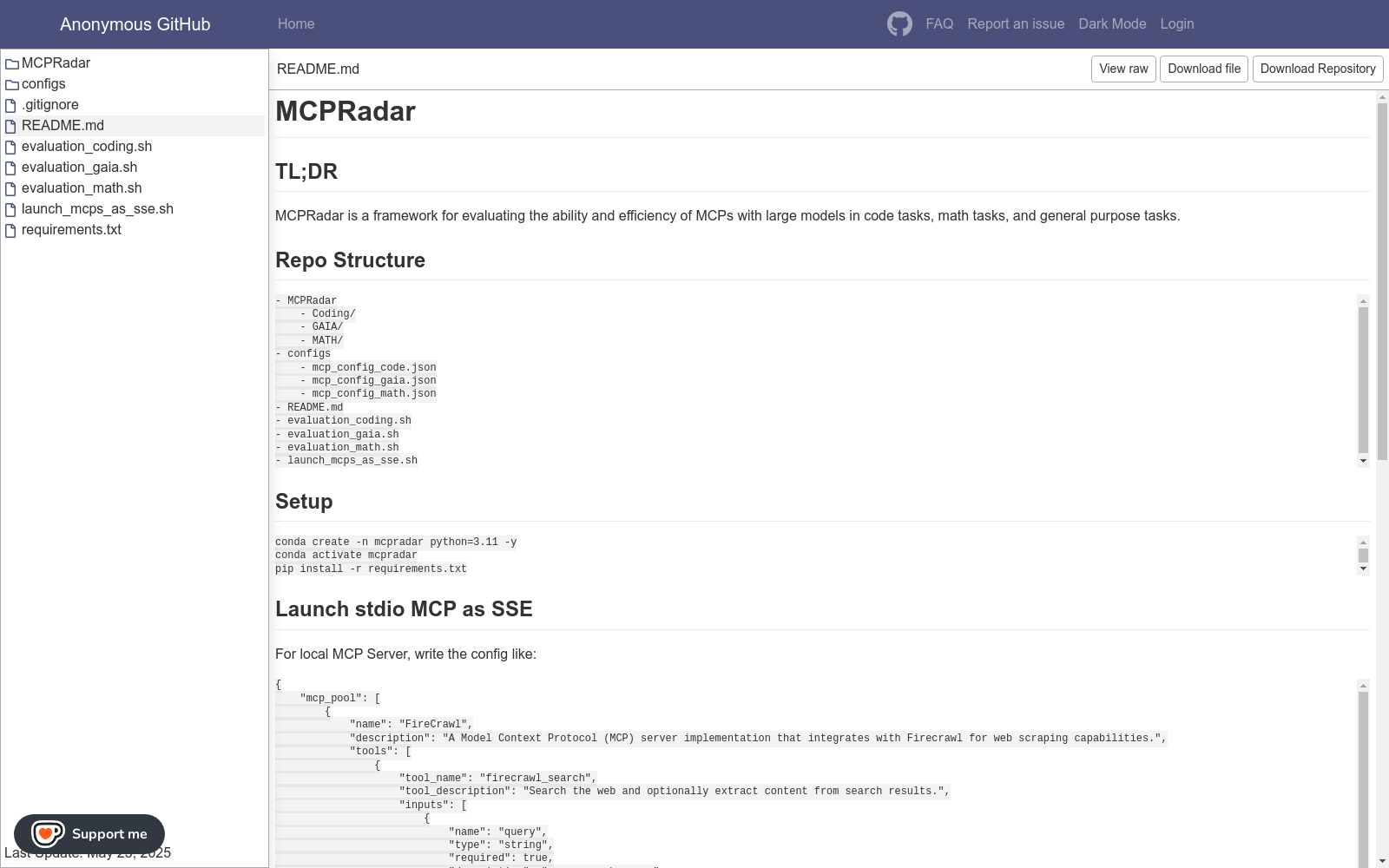

https://anonymous.4open.science/r/MCPRadar-B143

下载链接

链接失效反馈官方服务:

资源简介:

MCP-RADAR是一个用于评估大型语言模型在模型上下文协议(MCP)框架下工具使用能力的全面基准数据集。该数据集涵盖了软件工程、数学推理和一般问题解决等三个核心领域,共包含300个任务。数据集旨在通过五个维度来衡量模型能力:答案准确性、工具选择效率、计算资源效率、参数构造准确性和执行速度。MCP-RADAR的构建过程经过严格的任务设计和验证,确保了数据集的高质量和可靠性。

MCP-RADAR is a comprehensive benchmark dataset for evaluating the tool-use capabilities of large language models under the Model Context Protocol (MCP) framework. This dataset covers three core domains including software engineering, mathematical reasoning, and general problem-solving, with a total of 300 tasks. It aims to evaluate model capabilities across five dimensions: answer accuracy, tool selection efficiency, computational resource efficiency, parameter construction accuracy, and execution speed. The construction process of MCP-RADAR has undergone rigorous task design and validation to ensure the high quality and reliability of the dataset.

提供机构:

西安交通大学

创建时间:

2025-05-22

搜集汇总

数据集介绍

构建方式

MCP-RADAR数据集的构建基于对大型语言模型(LLM)在工具使用能力方面的多维评估需求。该数据集包含300个任务,覆盖软件工程、数学推理和通用问题解决三大领域,每个领域各100个任务。任务来源于高质量开源数据集(如GAIA、GSM8k、MATH等),并经过标准化处理以确保其适合MCP工具使用评估。每个任务经过多轮验证,包括初始设计、独立验证、一致性检查和难度校准,确保数据集的高质量和可靠性。

特点

MCP-RADAR数据集的特点在于其多维度的评估框架,涵盖五个关键维度:结果准确性(RA)、工具选择效率(TFTD)、首次错误位置(FEP)、计算资源效率(CRE)和响应时间效率(RTE)。该数据集不仅关注任务的最终结果,还深入评估模型在工具使用过程中的效率和稳健性。此外,数据集通过雷达图直观展示模型性能,便于快速识别模型在不同维度的优劣势。

使用方法

MCP-RADAR数据集的使用方法包括:首先,用户需根据任务需求选择合适的模型和工具配置;其次,通过标准化的MCP测试环境运行模型,确保评估条件一致;最后,根据五个维度的量化指标(RA、TFTD、FEP、CRE、RTE)对模型性能进行全面分析。数据集支持自动化评估和结果验证,适用于研究人员和开发者优化模型及工具设计。

背景与挑战

背景概述

MCP-RADAR是由西安交通大学和美国马萨诸塞大学阿默斯特分校的研究团队于2025年提出的首个针对大型语言模型(LLM)在模型上下文协议(MCP)框架下工具使用能力的多维评估基准。随着LLM从被动文本生成器向能够与外部工具交互的主动推理代理演进,MCP作为标准化的工具发现与编排框架在产业界获得广泛应用。该数据集通过创新的五维评估方法(答案准确性、工具选择效率、计算资源效率、参数构建准确性和执行速度),为研究者和开发者提供了全面评估LLM工具使用能力的标准化平台,填补了该领域系统性评估框架的空白。

当前挑战

MCP-RADAR面临的挑战主要体现在两个方面:在领域问题层面,需解决传统评估方法难以准确衡量LLM在动态工具发现、多步骤工作流编排和参数构建等复杂场景下的表现;在构建过程层面,需克服任务复杂度分级、跨领域评估指标统一、工具接口标准化等难题。具体包括:如何设计能全面反映工具使用能力的多维度评估体系,如何确保不同领域(软件工程、数学推理和通用问题解决)任务的可比性,以及如何处理工具文档质量对模型性能的影响等挑战。

常用场景

经典使用场景

MCP-RADAR数据集作为首个专为评估大型语言模型在模型上下文协议(MCP)框架下工具使用能力的综合性基准,其经典应用场景集中在多维度量化分析模型的工具调用效能。该数据集通过软件工程、数学推理和通用问题解决三大任务领域,系统评估模型在动态工具发现、参数构建及多步骤工作流编排中的表现,尤其适用于对比不同架构LLM在标准化工具交互环境中的性能差异。研究人员可通过其五维评估体系(答案准确性、工具选择效率等)生成雷达图,直观揭示Claude、GPT-4等主流模型在工具增强任务中的能力边界与特性权衡。

衍生相关工作

该数据集已衍生出三类重要研究工作:首先是工具设计优化方向,如基于参数构造准确率指标开发的扁平化API参数规范;其次是模型训练方法改进,包括针对错误恢复能力的专项预训练任务设计;最后是评估框架扩展,其五维度量体系被AdaptiBench等后续研究采纳为多智能体系统评估标准。特别值得注意的是,数据集揭示的晚期错误修复机制重要性,直接推动了Toolformer++在工具链完整性验证方面的算法创新。

数据集最近研究

最新研究方向

随着大型语言模型(LLM)从被动文本生成器向能够与外部工具交互的主动推理代理演进,MCP-RADAR数据集应运而生,成为首个专注于评估模型在Model Context Protocol(MCP)框架下工具使用能力的多维基准。该数据集通过创新的五维评估体系(答案准确性、工具选择效率、计算资源效率、参数构建准确性和执行速度),为研究社区提供了客观、可量化的性能测量标准。在软件工程、数学推理和通用问题解决等多样化任务领域的评估中,MCP-RADAR揭示了主流商业和开源模型在工具链集成能力上的显著差异与性能权衡,特别是发现数学推理任务的平均准确率(0.78)显著高于其他领域,而开源模型在资源效率方面展现出独特优势。这一研究不仅挑战了传统单一指标的性能排名范式,更为工具开发者提供了优化接口设计和错误处理机制的关键洞见,推动了LLM与工具生态系统协同优化的前沿探索。

相关研究论文

- 1MCP-RADAR: A Multi-Dimensional Benchmark for Evaluating Tool Use Capabilities in Large Language Models西安交通大学 · 2025年

以上内容由遇见数据集搜集并总结生成