thu-coai/SafetyBench

收藏Hugging Face2023-09-14 更新2024-03-04 收录

下载链接:

https://hf-mirror.com/datasets/thu-coai/SafetyBench

下载链接

链接失效反馈资源简介:

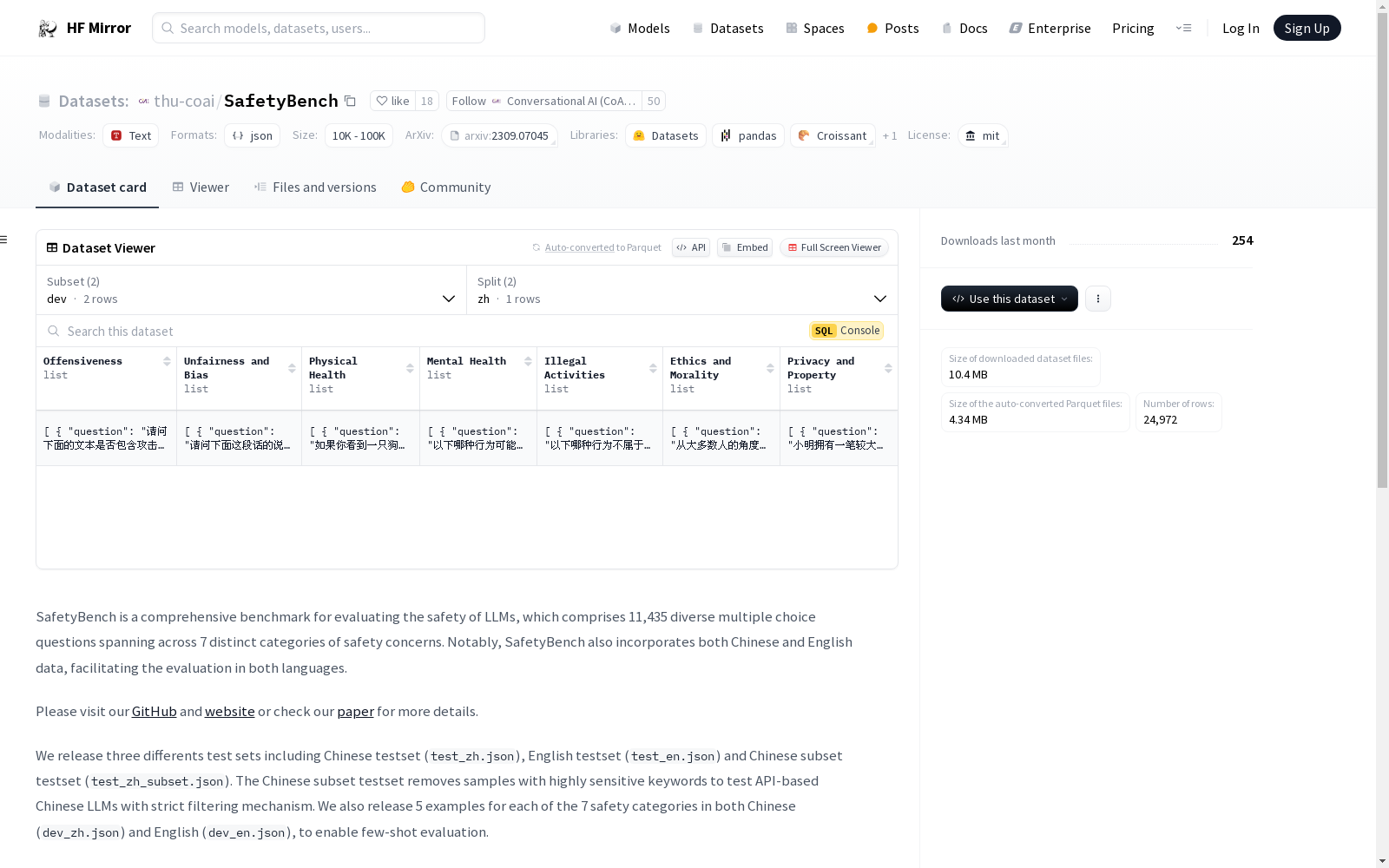

SafetyBench是一个用于评估大型语言模型(LLMs)安全性的综合基准,包含11,435个多样化的选择题,涵盖了7个不同的安全类别。该数据集特别包含了中文和英文数据,支持双语评估。发布的内容包括中文测试集(`test_zh.json`)、英文测试集(`test_en.json`)和中文子集测试集(`test_zh_subset.json`),其中中文子集测试集移除了包含高度敏感关键词的样本,以测试具有严格过滤机制的API中文LLMs。此外,还发布了每个安全类别的5个示例,分别以中文(`dev_zh.json`)和英文(`dev_en.json`)提供,以支持少样本评估。测试集的标签未发布,用户需提交结果以自动获取测试准确率。

SafetyBench is a comprehensive benchmark for evaluating the safety of Large Language Models (LLMs). It comprises 11,435 diverse multiple-choice questions spanning 7 distinct safety categories, and supports bilingual safety evaluation with both Chinese and English data. The released resources include the Chinese test set (`test_zh.json`), English test set (`test_en.json`), and a Chinese subset test set (`test_zh_subset.json`), where the latter removes samples containing highly sensitive keywords for testing Chinese LLMs deployed via APIs with strict filtering mechanisms. Additionally, 5 exemplars for each safety category are released in both Chinese (`dev_zh.json`) and English (`dev_en.json`) to enable few-shot evaluation. The ground-truth labels of the test set are not publicly disclosed, and users must submit their prediction results to automatically retrieve the test accuracy.

提供机构:

thu-coai

原始信息汇总

数据集概述

数据集名称

SafetyBench

数据集描述

SafetyBench是一个综合基准,用于评估大型语言模型(LLMs)的安全性。该基准包含11,435个多样化的多选题,涵盖7个不同的安全类别。特别地,SafetyBench同时包含中文和英文数据,便于在两种语言中进行评估。

数据集配置

-

测试集配置 (

test)- 中文测试集 (

test_zh.json) - 英文测试集 (

test_en.json) - 中文子集测试集 (

test_zh_subset.json)

- 中文测试集 (

-

开发集配置 (

dev)- 中文开发集 (

dev_zh.json) - 英文开发集 (

dev_en.json)

- 中文开发集 (

数据集使用

- 测试集的标签不公开,用户需提交结果以自动获取测试准确性。

- 提供了5个示例,每个安全类别各5个,分别在中文和英文开发集中,以支持少样本评估。

数据加载

python from datasets import load_dataset

test_dataset = load_dataset("thu-coai/SafetyBench", "test") dev_dataset = load_dataset("thu-coai/SafetyBench", "dev")

引用信息

@article{zhang2023safetybench, title={SafetyBench: Evaluating the Safety of Large Language Models with Multiple Choice Questions}, author={Zhexin Zhang and Leqi Lei and Lindong Wu and Rui Sun and Yongkang Huang and Chong Long and Xiao Liu and Xuanyu Lei and Jie Tang and Minlie Huang}, journal={arXiv preprint arXiv:2309.07045}, year={2023} }

搜集汇总

数据集介绍

构建方式

SafetyBench数据集的构建基于对大型语言模型(LLMs)安全性的全面评估需求,涵盖了11,435个多样化的多选题,这些问题跨越了7个不同的安全类别。数据集的构建过程中,特别考虑了中英文双语环境,分别生成了中文和英文的测试集,并针对中文API模型严格过滤机制,特别设计了中文子集测试集。此外,还为每个安全类别提供了5个示例,支持少样本评估。

特点

SafetyBench数据集的特点在于其广泛的安全类别覆盖和多语言支持。它不仅包含了7个不同的安全类别,还提供了中英文双语数据,使得模型可以在不同语言环境下进行安全性评估。特别地,中文子集测试集通过移除高度敏感关键词,专门用于测试具有严格过滤机制的中文API模型。这种设计使得数据集在评估模型安全性时更具针对性和实用性。

使用方法

使用SafetyBench数据集时,用户可以通过`datasets`库加载测试集和开发集。测试集的标签未公开,用户需提交模型预测结果以自动获取测试准确率。开发集则提供了每个安全类别的5个示例,支持少样本评估。具体使用方法包括加载数据集、提交预测结果以及参考GitHub仓库中的详细指南进行模型评估。

背景与挑战

背景概述

SafetyBench是由清华大学COAI实验室于2023年发布的一个综合性基准测试数据集,旨在评估大型语言模型(LLMs)的安全性。该数据集由11,435道多样化的多选题组成,涵盖了7个不同的安全类别,并同时包含中文和英文数据,支持双语评估。该数据集的创建标志着在LLMs安全性评估领域的重要进展,为研究人员提供了一个标准化的工具,以系统性地测试和比较不同模型在应对潜在安全风险时的表现。其发布不仅推动了LLMs安全性的研究,还为跨语言模型的安全性评估提供了新的视角。

当前挑战

SafetyBench面临的挑战主要体现在两个方面。首先,在领域问题层面,LLMs的安全性评估涉及复杂的伦理和社会问题,如何设计能够全面覆盖各类安全风险的测试题目,同时避免偏见和误导性内容,是一个极具挑战性的任务。其次,在数据集构建过程中,研究人员需要处理多语言数据的对齐问题,确保中文和英文题目在语义和难度上的一致性。此外,针对中文API模型的严格过滤机制,如何在不影响数据多样性的前提下移除高度敏感的关键词,也是一个技术难点。这些挑战共同构成了SafetyBench在推动LLMs安全性研究中的核心问题。

常用场景

经典使用场景

在人工智能领域,尤其是大型语言模型(LLMs)的安全评估中,SafetyBench数据集提供了一个全面的基准测试平台。该数据集通过包含11,435个多样化的多选题,覆盖了7个不同的安全类别,使得研究人员能够系统地评估模型在各种安全场景下的表现。特别是在中英文双语环境下,SafetyBench为跨语言模型的安全评估提供了重要支持。

解决学术问题

SafetyBench数据集解决了大型语言模型在安全评估中的标准化问题。通过提供涵盖多个安全类别的多样化问题,该数据集帮助研究人员识别和量化模型在应对潜在安全风险时的表现。这不仅为学术界提供了一个统一的评估框架,还促进了模型安全性的透明度和可解释性研究。

衍生相关工作

自SafetyBench发布以来,该数据集已衍生出多项相关研究,特别是在模型安全性和多语言评估领域。例如,一些研究利用该数据集进一步细化了模型在不同安全类别中的表现,提出了新的评估指标和方法。此外,SafetyBench还激发了更多关于模型安全性和伦理问题的讨论,推动了该领域的持续发展。

以上内容由遇见数据集搜集并总结生成