RenalCLIP

收藏arXiv2025-08-23 更新2025-08-26 收录

下载链接:

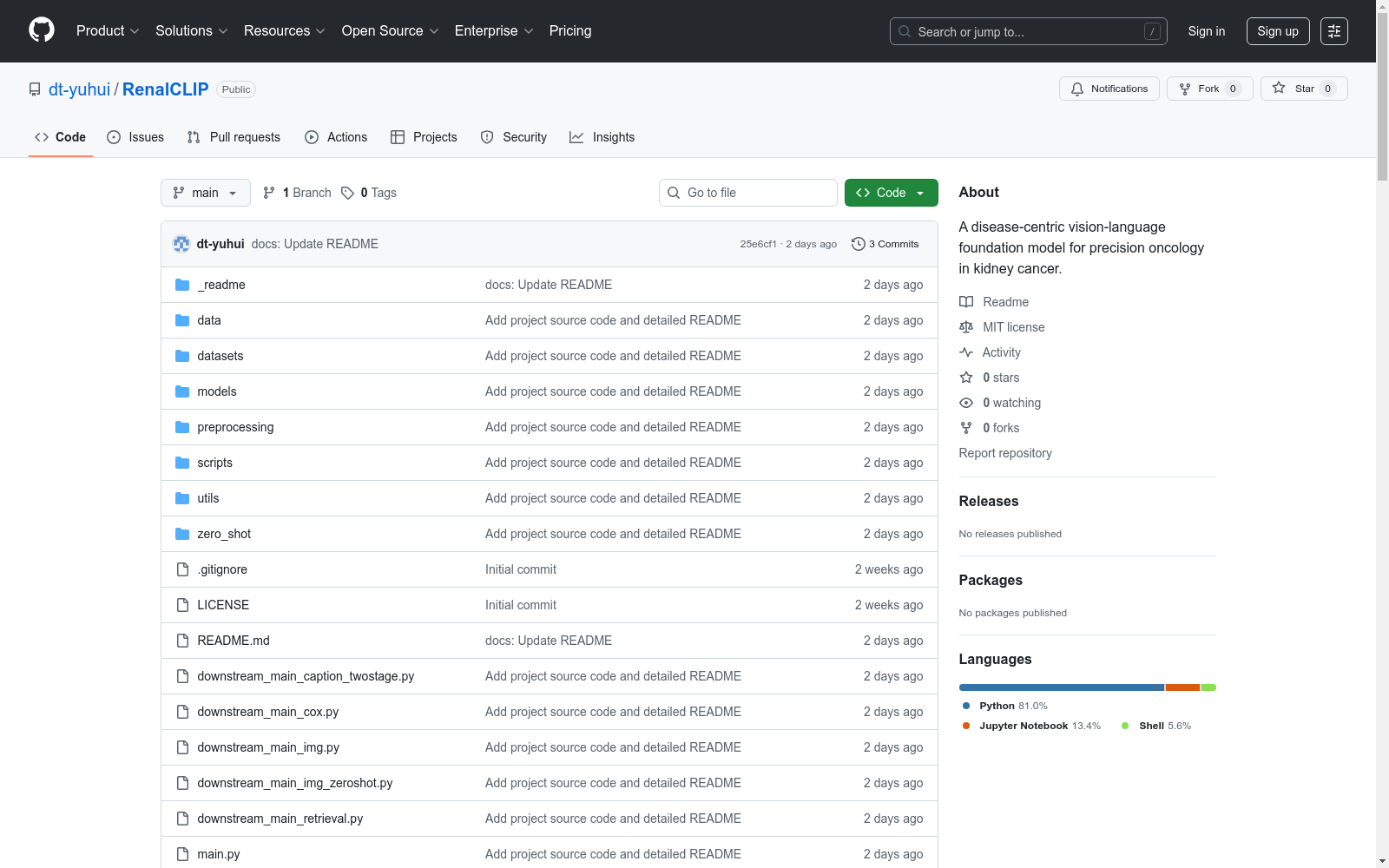

https://github.com/dt-yuhui/RenalCLIP

下载链接

链接失效反馈官方服务:

资源简介:

RenalCLIP是一个多任务、以疾病为中心的视觉语言基础模型,用于对肾脏癌进行综合评估。该模型在包含21819个CT扫描序列及其对应的放射学报告的大规模多机构数据集上进行了预训练。该数据集是从中国四个主要医疗中心收集的6867名患者的数据。通过将CT扫描的视觉表示与从文本报告中提取的临床病理语义对齐,RenalCLIP学习到肾脏肿瘤的鲁棒、上下文感知嵌入。该模型在一系列临床相关任务上的性能得到了系统的评估,包括自动解剖评分、良性与恶性鉴别、侵袭性分层、多终点生存预后和跨模态检索。在所有基准测试中,RenalCLIP始终优于现有最先进的模型。此外,该模型在零样本学习和放射学报告生成方面表现出先进的能力,这使其成为肾脏癌成像和决策的精确医学基础模型的潜在候选者。

RenalCLIP is a multi-task, disease-centric vision-language foundation model intended for comprehensive assessment of kidney cancer. It is pre-trained on a large-scale multi-institutional dataset containing 21,819 CT scan sequences and their corresponding radiology reports, which are derived from data of 6,867 patients collected from four major medical centers in China. By aligning the visual representations of CT scans with the clinicopathological semantics extracted from the text reports, RenalCLIP learns robust, context-aware embeddings for renal tumors. The model's performance has been systematically evaluated across a series of clinically relevant tasks, including automatic anatomical scoring, benign vs. malignant differentiation, aggressiveness stratification, multi-endpoint survival prognosis, and cross-modal retrieval. In all benchmark tests, RenalCLIP consistently outperforms existing state-of-the-art models. Furthermore, the model exhibits advanced capabilities in zero-shot learning and radiology report generation, positioning it as a potential candidate for a precision medicine foundation model for kidney cancer imaging and clinical decision-making.

提供机构:

复旦大学数字医学研究中心、复旦大学基础医学院、山东大学齐鲁医院泌尿外科、微软亚洲研究院等

创建时间:

2025-08-23

原始信息汇总

RenalCLIP 数据集概述

数据集基本信息

- 数据集名称:RenalCLIP

- 核心目标:为肾癌精准肿瘤学构建疾病中心的视觉-语言基础模型

- 主要功能:通过CT成像对肾脏肿块进行全面评估

数据预处理流程

CT图像预处理

- 输入格式:单肾脏3D体积数据

- 处理步骤:

- 使用预训练nnU-Net模型自动分割肾脏和肾脏病变

- 基于分割掩码进行ROI裁剪和离线预处理

- 参考资源:https://github.com/MIC-DKFZ/nnUNet

报告预处理

- 原始语言:中文放射学报告

- 处理流程:

- 使用LLM解析报告,分离左右肾脏描述

- 翻译为英文文本

模型架构与训练

预训练策略

- 两阶段知识增强预训练:

- 单模态预训练

- 图像编码器:3D ResNet-18,基于病理属性多任务学习

- 文本编码器:基于Llama3,采用LLM2Vec方法训练

- 跨模态预训练:视觉-语言联合对齐训练

- 单模态预训练

硬件要求

- 训练硬件:NVIDIA A100 80GB GPU

- 单GPU任务:下游微调和推理

- 多GPU需求:跨模态预训练阶段(4×A100 80GB)

下游任务评估

临床工作流任务(微调)

- 解剖特征分析:R.E.N.A.L.评分(R、E、N、A、L分量)

- 诊断任务:

- 恶性肿瘤检测(BMC)

- 侵袭性/侵袭程度评估(IC)

- 预后预测:无复发生存预测(RFS)

- 多相位融合:多相位晚期融合策略示例

高级能力任务

- 零样本分类:确定性最大相似度和随机提示采样策略

- 跨模态检索:图像-文本检索任务

- 报告生成:自动生成放射学报告

模型获取

- 发布平台:Hugging Face

- 模型仓库:https://huggingface.co/taoyh/RenalCLIP

- 包含内容:图像编码器和文本编码器(LLM2Vec)的预训练权重

学术引用

bibtex @article{Tao2025RenalCLIP, title={A Disease-Centric Vision-Language Foundation Model for Precision Oncology in Kidney Cancer}, author={Yuhui Tao and Zhongwei Zhao and Zilong Wang and Xufang Luo and Feng Chen and et al.}, journal={arXiv preprint}, year={2025} }

搜集汇总

数据集介绍

构建方式

RenalCLIP数据集的构建采用了多中心回顾性研究设计,涵盖来自中国九家医疗中心和公共TCIA队列的8,809名患者的27,866例CT扫描。通过半自动化流程定位肾脏区域兴趣点,并结合大型语言模型解析放射学报告,将中文报告按左右肾脏分区并翻译为英文。数据预处理包括多期相CT对齐、固定尺寸裁剪和强度标准化,确保空间一致性和输入 uniformity。

使用方法

数据集支持端到端的视觉-语言基础模型训练,采用两阶段预训练策略:首先通过多任务学习增强图像编码器的领域知识,利用14个临床问题监督训练;文本编码器基于Llama3架构经医学语料微调。第二阶段通过对比学习目标对齐视觉与文本表征。下游任务涵盖零样本分类、跨模态检索、报告生成及预后预测,可通过微调适配具体临床应用场景。

背景与挑战

背景概述

RenalCLIP是由复旦大学、山东大学齐鲁医院及微软亚洲研究院等机构于2025年联合开发的肾脏癌精准医学多模态基础模型。该模型针对肾癌CT影像与病理报告的多模态对齐问题,通过两阶段预训练策略融合视觉与文本语义,旨在解决肾肿瘤良恶性鉴别、侵袭性分层及生存预后预测等核心临床挑战。其基于8,809例患者27,866次CT扫描的大规模多中心数据集,显著提升了肾癌诊疗的自动化水平,为肿瘤影像学提供了疾病专属的基础模型范式。

当前挑战

该数据集需解决肾肿瘤影像分类、侵袭性评估及生存预测等多任务挑战,其构建面临多中心数据异构性、跨模态语义对齐及标注一致性等难题。具体包括:1)肾肿瘤解剖特征(如R.E.N.A.L评分)的细粒度标注需专家共识;2)多期相CT影像与文本报告的跨模态对齐需克服语言差异;3)预后预测需整合长期随访数据与病理金标准,且需应对不同扫描协议的域适应问题。

常用场景

经典使用场景

在肾脏肿瘤的精准影像评估领域,RenalCLIP数据集通过整合多中心CT影像与对应放射学报告,构建了疾病专属的视觉-语言基础模型。该数据集典型应用于肾脏肿瘤的解剖特征量化(R.E.N.A.L.评分)、恶性鉴别、侵袭性分层及生存预后预测等全流程临床任务,其多模态对齐机制支持模型从影像与文本的联合表征中提取深层语义信息。

解决学术问题

该数据集解决了肾脏肿瘤影像分析中泛化性不足与语义理解缺失的核心学术问题。通过疾病中心的预训练策略,显著提升了模型在外部验证集上的诊断一致性,尤其针对侵袭性分层和生存预测等高阶任务,在TCIA队列中实现了20%的C-index提升。其对比学习框架突破了传统单任务模型的局限性,为医学影像的跨模态表示学习提供了可解释的理论基础。

实际应用

临床实践中,RenalCLIP支持非侵入性肾脏肿瘤风险评估,辅助制定个性化诊疗方案。其零样本分类与数据高效学习能力显著降低了对标注数据的依赖,仅需20%的训练样本即可达到基线模型全量数据性能,适用于医疗资源稀缺场景。此外,模型在放射报告生成和跨模态检索方面的优势,为临床教学与病例检索提供了智能化工具。

数据集最近研究

最新研究方向

RenalCLIP作为肾癌精准医疗领域的疾病中心化视觉-语言基础模型,正推动医学影像分析范式的变革。该模型通过两阶段预训练策略,深度融合CT影像特征与放射学报告的临床语义,在肾肿瘤解剖评分、良恶性鉴别、侵袭性分层及生存预后预测等10项核心任务中展现出卓越性能。其零样本诊断能力仅需20%标注数据即可达到基线模型全量训练的性能峰值,显著解决了医学AI模型对大规模标注数据的依赖问题。当前研究聚焦于跨中心泛化验证,在TCIA国际公开数据集上复发风险预测C-index达0.726,较最优基线提升约20%,证实了疾病中心化策略在肿瘤影像分析中的必要性。该模型同时具备放射报告生成与跨模态检索能力,为构建可解释的临床决策支持系统提供了新路径,有望重塑肾癌术前评估标准并推动个性化治疗策略的发展。

相关研究论文

- 1A Disease-Centric Vision-Language Foundation Model for Precision Oncology in Kidney Cancer复旦大学数字医学研究中心、复旦大学基础医学院、山东大学齐鲁医院泌尿外科、微软亚洲研究院等 · 2025年

以上内容由遇见数据集搜集并总结生成