Human3.6m

收藏arXiv2025-11-19 更新2025-11-21 收录

下载链接:

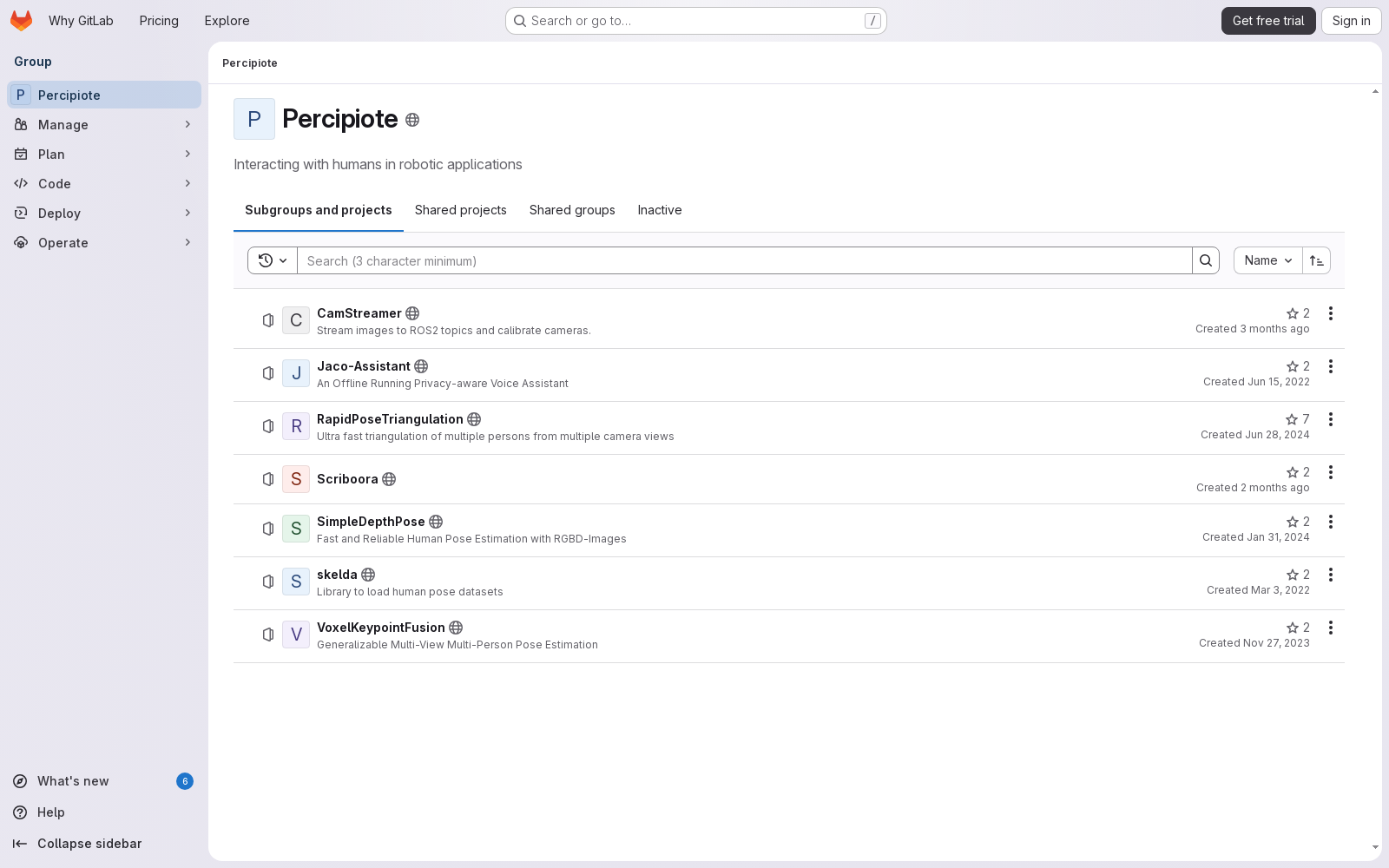

https://gitlab.com/Percipiote/

下载链接

链接失效反馈资源简介:

Human3.6m是由奥格斯堡大学等机构采用的经典人体姿态数据集,包含7名演员执行15类动作的3D骨骼序列。该数据集以50Hz频率采集,包含32个关节点,经预处理后常采用22个动态关节进行模型训练,每段序列采样256个随机样本。数据通过专业运动捕捉系统在受控环境中录制,经指数映射转换为三维坐标。该资源主要应用于人体姿态预测研究,通过分析历史关节序列预测未来运动轨迹,为自动驾驶、人机交互等场景提供关键运动建模支持。

Human3.6m is a classic human pose dataset adopted by institutions such as the University of Augsburg. It contains 3D skeletal motion sequences of 7 actors performing 15 distinct action categories. Captured at a sampling rate of 50 Hz, the dataset includes 32 joint points. After preprocessing, 22 dynamic joints are commonly used for model training, and 256 random samples are extracted from each sequence. The data was recorded in a controlled environment using professional motion capture systems, and converted to 3D coordinates via exponential mapping. This resource is primarily applied in human pose prediction research, where future motion trajectories are predicted by analyzing historical joint sequences, providing critical support for motion modeling in scenarios such as autonomous driving and human-computer interaction.

提供机构:

奥格斯堡大学

创建时间:

2025-11-19

搜集汇总

数据集介绍

构建方式

Human3.6M数据集通过多视角摄像系统在自然环境中捕捉七名表演者执行十五种日常活动的三维人体运动数据,采用专业运动捕捉技术记录32个关节点的精确坐标,并以50Hz的帧率保存原始数据。为适配预测任务,研究团队通过剔除静态髋关节与重复节点,筛选出22个核心关节点构建标准化序列,并通过指数映射与三维坐标转换实现数据规范化处理,最终形成包含时空连续动作序列的结构化数据集。

特点

该数据集以高精度三维关节坐标为核心特征,涵盖行走、饮食等多样化人体动作模式,其多视角同步采集机制确保了运动轨迹的空间真实性。区别于合成数据,该数据集通过真实环境下的动作捕捉呈现人体运动的自然协方差特性,且提供绝对坐标与相对坐标双重视角,支持全局运动预测与局部姿态分析的交叉验证。数据规模与质量使其成为评估长期运动预测模型泛化能力的基准标准。

使用方法

研究者可通过加载预处理后的关节坐标序列,以50帧历史动作为输入预测未来25帧运动轨迹,采用均值关节位置误差(MPJPE)作为核心评估指标。该数据集支持跨模型性能对比,需注意输入序列需通过减去末帧髋关节坐标实现中心化处理以提升泛化能力。对于噪声鲁棒性研究,可结合姿态估计网络生成的带噪坐标进行零样本迁移或无监督微调实验。

背景与挑战

背景概述

Human3.6M数据集由Catalin Ionescu等人于2014年创建,作为三维人体感知研究领域的重要基准。该数据集通过多视角相机系统捕捉11名专业演员在室内环境中执行的15类日常活动,包含超过360万帧高精度运动序列。数据集采用Vicon运动捕捉系统记录32个关节点的三维坐标信息,采样频率达到50Hz,为人体姿态分析提供了前所未有的数据规模与精度保障。其核心研究目标在于推进自然环境下的人体运动理解与预测,对计算机视觉、人机交互及自动驾驶等领域产生了深远影响,成为评估姿态估计与运动预测算法性能的黄金标准。

当前挑战

该数据集面临的领域挑战主要集中于人体姿态预测任务的复杂性,包括运动模式的时空建模、长期依赖关系捕捉以及多动作类别的泛化能力。在构建过程中,研究人员需克服多视角数据同步、关节标注一致性、运动序列对齐等技术难题。当前研究更揭示出算法评估中的可复现性危机,包括预处理流程不统一、评价指标实现差异以及代码开放不完整等问题。此外,从标记式运动捕捉到无标记姿态估计的迁移过程中,模型对结构性噪声的鲁棒性不足,导致实际部署时出现显著性能衰减,这要求构建更具现实意义的噪声评估范式与自适应优化策略。

常用场景

经典使用场景

Human3.6m数据集作为三维人体姿态估计领域的基准数据集,其最经典的应用场景在于人体运动预测研究。该数据集通过多视角相机系统捕捉7名表演者执行15类日常活动的完整运动序列,为研究者提供了丰富的时空运动模式样本。在运动预测任务中,模型利用历史50帧(约1秒)的关节坐标序列,预测未来25帧(约1秒)的人体姿态变化,这种设定直接对应自动驾驶中行人轨迹预测、人机协作中动作预判等实际需求。

实际应用

在现实应用层面,Human3.6m支撑了多个重要领域的技术落地。自动驾驶系统利用其训练的行人运动预测模型,可提前预判道路上人体的移动意图;工业机器人通过学习的协作动作模式,能实现更自然的人机交互流程;虚拟现实领域则借助其精细的运动数据,生成逼真的数字人动画。特别在智能监控系统中,基于该数据集开发的算法能准确识别异常行为模式,为公共安全提供技术保障。

衍生相关工作

该数据集催生了众多里程碑式的研究工作。SoMoFormer首次将Transformer架构引入绝对姿态预测,开创了时空注意力建模的新范式;MotionConformer通过跨领域迁移语音识别模型,证明了通用序列建模架构的适应性;DePOSit采用扩散模型处理带噪声输入,推动了鲁棒性预测的发展。这些衍生研究不仅持续刷新性能基准,更逐步构建起从实验室环境到真实场景的技术桥梁。

以上内容由遇见数据集搜集并总结生成